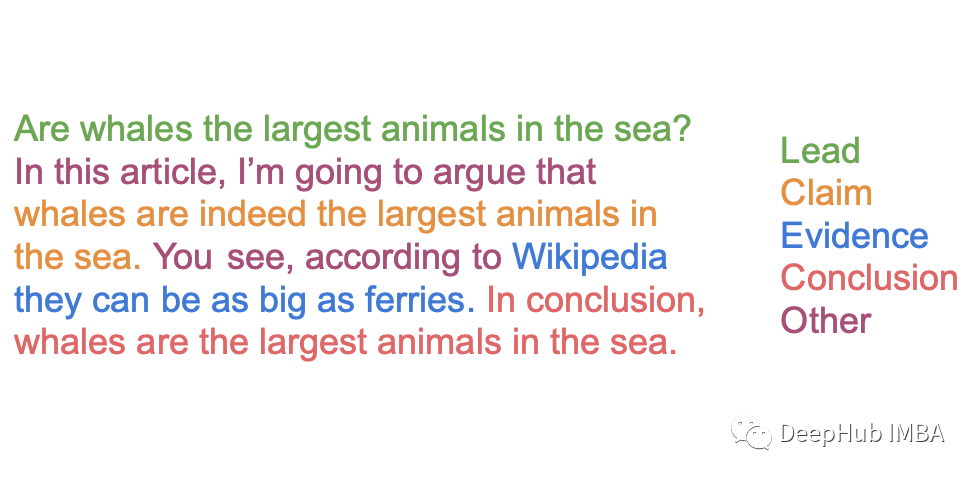

ArgMiner:一个用于对论点挖掘数据集进行处理、增强、训练和推理的 PyTorch 的包

对kaggle中Feedback Prize比赛该兴趣的小伙伴推荐了解下。ArgMiner可以用于对SOTA论点挖掘数据集进行标准化处理、扩充、训练和执行推断。

深度学习与神经网络之开宗明义: 详解人工智能

人工指的是人类生产制造而来,与之对应的是自然产生(进化)的。所以与人工智能相对应的就是`自然智能`。但两者并不是完全对立或者互斥的关系。所谓阴在阳之内,不在阳之对。大胆预测一下,未来的发展方向是将人工智能和自然智能进行融合。......

Geoffrey Hinton:我的五十年深度学习生涯与研究心法

“如果能弄清一大批聪明人正在研究什么,然后你再去做不一样的研究,总是一个好主意。”

CS231n-2022 Module1: 神经网络要点概述(2)

本文编译自斯坦福大学的CS231n课程(2022) Module1课程中神经网络部分的内容: 【1】Neural Networks Part 2: Setting up the Data and the Loss To be added.

【深度学习】(2) Transformer 网络解析,代码复现,附Pytorch完整代码

今天和各位分享一下如何使用 Pytorch 构建 Transformer 模型。本文的重点在代码复现,部分知识点介绍的不多,我会在之后的四篇博文中详细介绍 Encoder,Decoder,(Mask)MutiHeadAttention,以及实战案例。之前我也介绍过 Vision Tranformer

基于BP神经网络识别手写字体MINST字符集

问题描述: 本次实验所要解决的问题是使用人工神经网络实现识别手写字体。实验采用MINST手写字符集作为识别对象。其中60000张作为训练集,剩余10000张作为测试集。实验采用python语言进行编程,使用到一些python的第三方库。使用的神经网络模型为BP神经网络,这是一种按照误差逆向传播算法

神经网络-最大池化的使用

池化层的官方文档中介绍了很多种的池化方法,但是最常用的还是MaxPool2d,这里我们也用MaxPool2d来讲解,其他的类似,关键还是要学会看官方文档概述:最大池化目的就是为了保留输入的特征,但是同时把数据量减少,最大池化之后数据量就减少了,对于整个网路来说,进行计算的参数就变少了,就会训练的更快

分享本周所学——人工智能语音识别模型CTC、RNN-T、LAS详解

本人是一名人工智能初学者,最近一周学了一下AI语音识别的原理和三种比较早期的语音识别的人工智能模型,就想把自己学到的这些东西都分享给大家,一方面想用浅显易懂的语言让大家对这几个模型有所了解,另一方面也想让大家能够避免我所遇到的一些问题。然后因为我也只是一名小白,所以有错误的地方还希望大佬们多多指正。

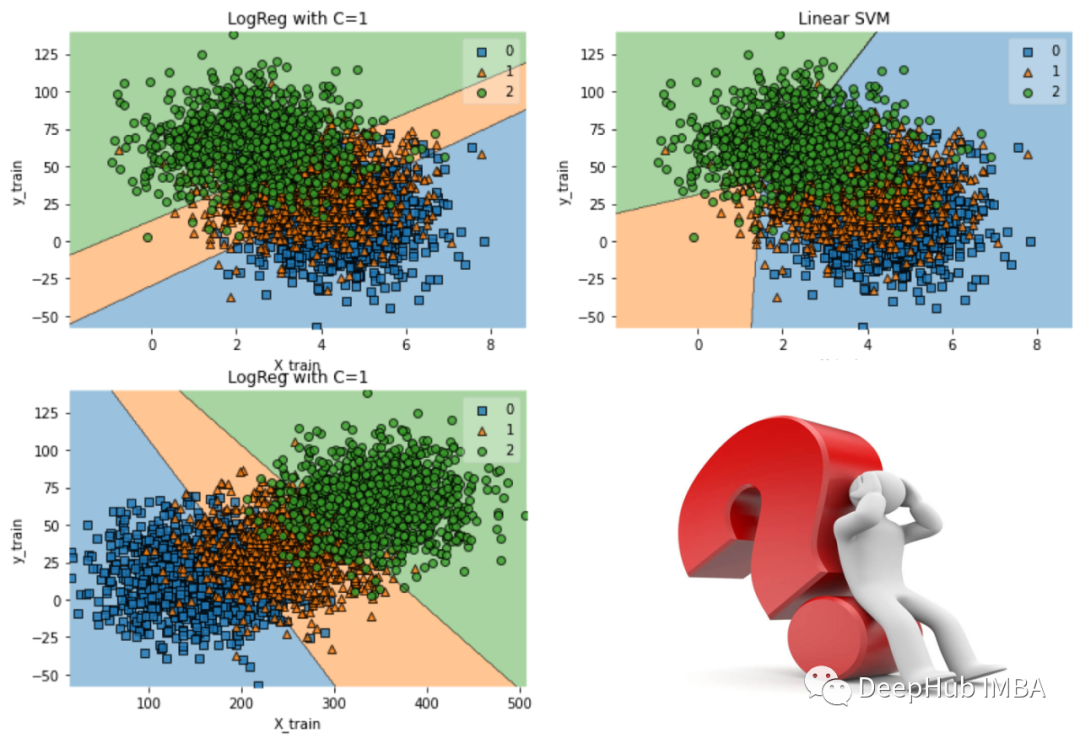

评估和选择最佳学习模型的一些指标总结

在评估模型时,虽然准确性是训练阶段模型评估和应用模型调整的重要指标,但它并不是模型评估的最佳指标,我们可以使用几个评估指标来评估我们的模型。

位置编码(PE)是如何在Transformers中发挥作用的

Transformers不像LSTM具有处理序列排序的内置机制,它将序列中的每个单词视为彼此独立。所以使用位置编码来保留有关句子中单词顺序的信息。

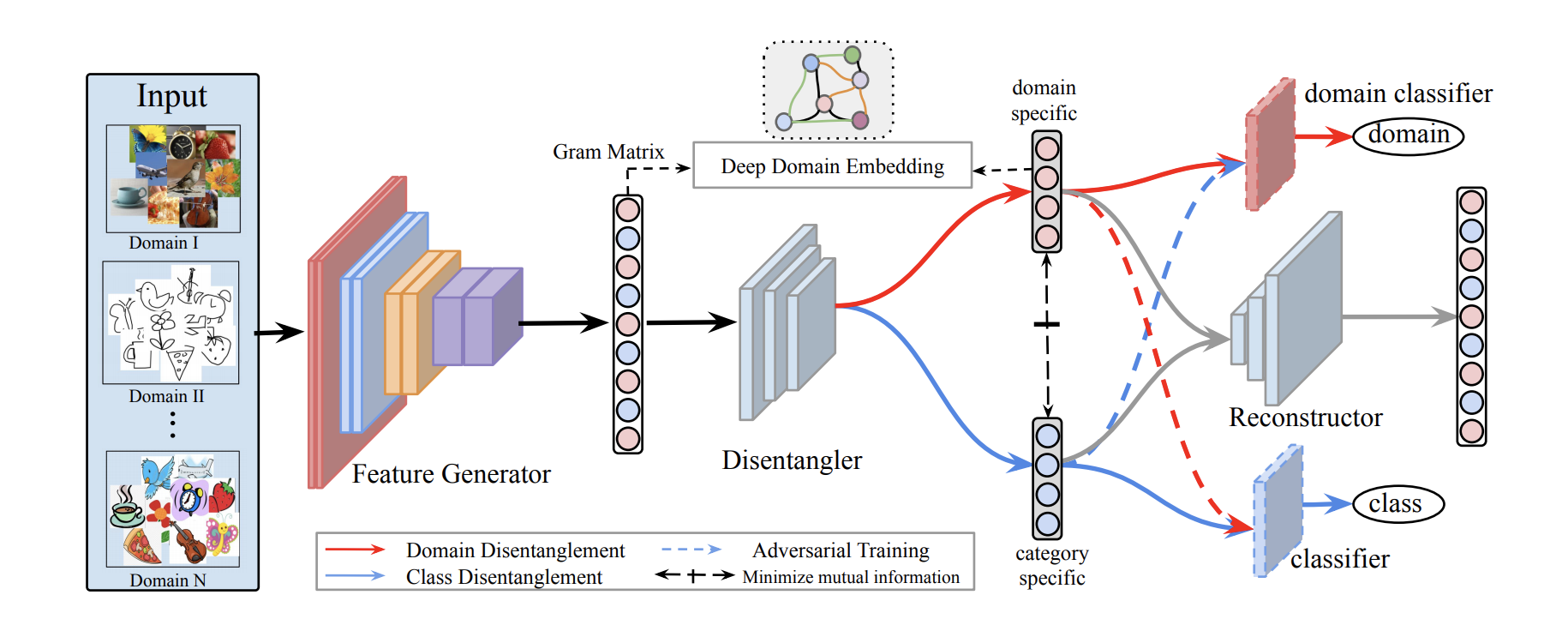

Keras深度学习实战(10)——迁移学习

迁移学习 (Transfer Learning) 是机器学习中的一个重要研究方向,指将一个预训练的模型重新用于另一个任务中,和从零开始训练卷积神经网络相比,利用迁移学习,只需要少量样本即可训练得到性能较好的模型。本文我们将使用预训练的 VGG16 模型利用迁移学习进行性别分类任务实战。...

使用神经网络模型创建一个龙与地下城怪物生成器

龙与地下城(DND)于1974年发行第一版,现在所有RPG游戏都有它的影子,在本文中我们将使用神经网络构建一个能够生成平衡数据的怪物生成器

5篇关于特征嵌入的研究论文推荐

5篇最新的论文推荐

《MATLAB 神经网络43个案例分析》:第1章 BP神经网络的数据分类——语音特征信号分类

《MATLAB 神经网络43个案例分析》是MATLAB技术论坛(www.matlabsky.com)策划,由王小川老师主导,2013年北京航空航天大学出版社出版的关于MATLAB为工具的一本MATLAB实例教学书籍,是在《MATLAB神经网络30个案例分析》的基础上修改、补充而成的,秉承着“理论讲解

猫狗图像识别(卷积神经网络算法,TensorFlow安装)-运行篇

一、tensorflow库安装(1)TensorFlow的历史版本与对应Python版本(2)Python版本查询win+R或者在搜索框搜索cmd打开Windows的终端,在终端输入python --version(3)找到上面的版本框进行对应的TensorFlow下载当时安装时并没有想到版本问题会

神经网络常见评价指标超详细介绍(ROC曲线、AUC指标、AUROC)

ROC曲线:接受者操作特征曲线(receiver operating characteristic curve)。ROC空间将伪阳性率(FPR)定义为 X 轴,真阳性率(TPR)定义为 Y 轴。从 (0, 0) 到 (1,1) 的对角线将ROC空间划分为左上/右下两个区域,在这条线的以上的点代表了一

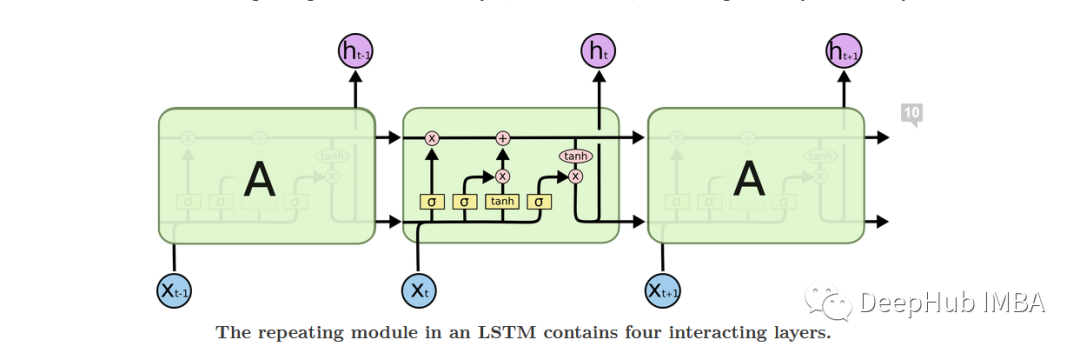

如何计算LSTM层中的参数数量

长短期记忆网络(通常称为“ LSTM”)是一种特殊的RNN,经过精心设计LSTM能够学习长期的依赖

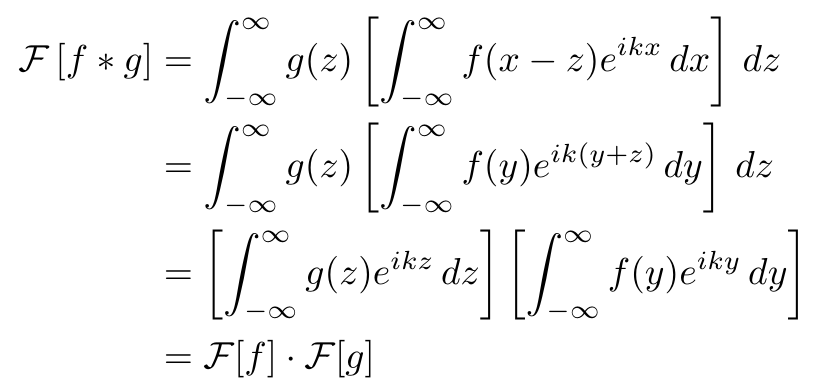

卷积神经网络中的傅里叶变换:1024x1024 的傅里叶卷积

本文介绍了卷积和DFT背后的数学理论,通过观察不同的光谱获得了一些想发,并且通过TensorFlow进行了实现,并验证了结果的正确性。

机器学习——从0开始构建自己的GAN网络

机器学习——从0开始构建自己的GAN网络

论文推荐:TResNet改进ResNet 实现高性能 GPU 专用架构并且效果优于 EfficientNet

论文首先讨论了面向 FLOP 的优化引起的瓶颈。然后建议更好地利用 GPU 结构的设计。最后引入了一个新的 GPU 专用模型,称其为 TResNet。