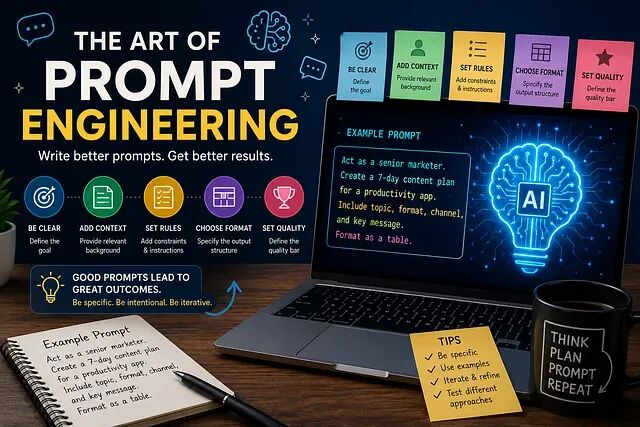

Prompt Engineering 的本质:角色、任务、上下文、格式、约束

Prompt engineering 就是用来填这个坑的,它是一种和 AI 系统沟通的方法——表达得足够清晰、足够精确,让模型的第一反应就了解你的真实意图。

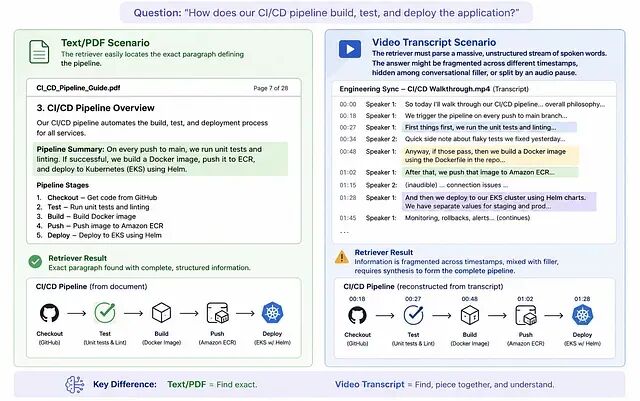

视频 RAG 中分块策略:基于停顿、滑动窗口与基于 LLM 的方法

文本的RAG我们都已经很熟悉了,但是如果数据以原始视频转录文本的形式存储,没有合适的时间结构,那么相比标准的 PDF 或文本文档,如何检索视频里面的内容呢?

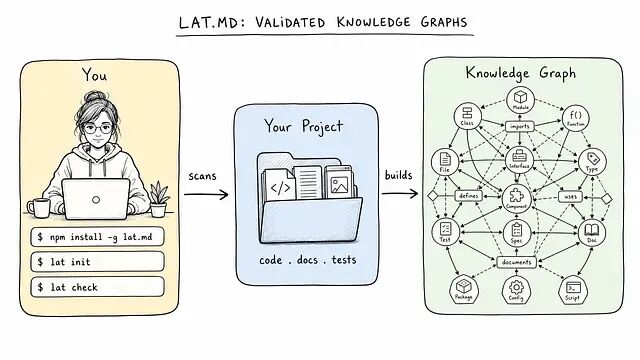

lat.md:将任意项目代码转换为可查询的知识图谱

lat.md让我们不再停留在“搜索”信息,而是面向一张组织有序、经过校验的项目地图。把笔记直接挂到代码上,再让它们的一致性接受自动校验,AI 工具因此变得更聪明、更可靠。

四种无向量RAG 方案实测:BM25、GraphRAG、Tree Search、Agent

四种方法都查这一份数据集,但每种方法分别使用刻意挑选、能发挥其长处的查询。得到的结果是:没有任何一种方法是通用的。

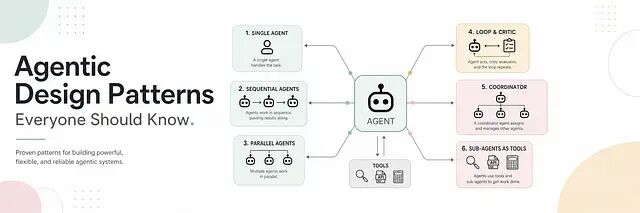

Agentic 设计模式拆解:6 种结构的优缺点与应用场景

所以这篇文章总结一些常见的设计模式,这些模式归纳了在大量已验证实现中反复出现的共性,可以视为一组结构化的骨架,用来理解智能体(Agent)、用户、模型和工具之间的核心交互。

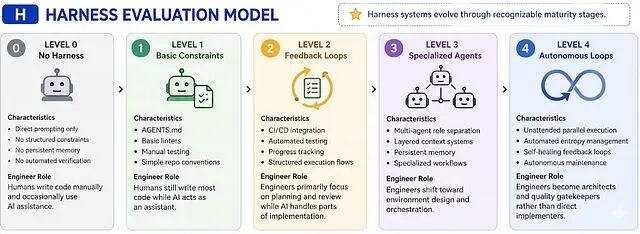

从零搭建 Harness Engineering 框架 :Rule、Skill、Sub-Agent等工程落完整路径

Harness 这个词听起来宽泛而且像一种抽象的方法论。如果它没法落到具体的目录结构、文档、脚本和工作流上,那就只是一句漂亮口号。

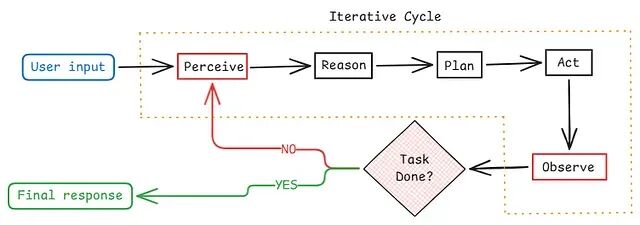

推理 → 行动 → 观察:用 LangChain + Python 实现一个智能体循环

下面这篇介绍会说明它是什么、如何工作,以及如何把它实现出来。

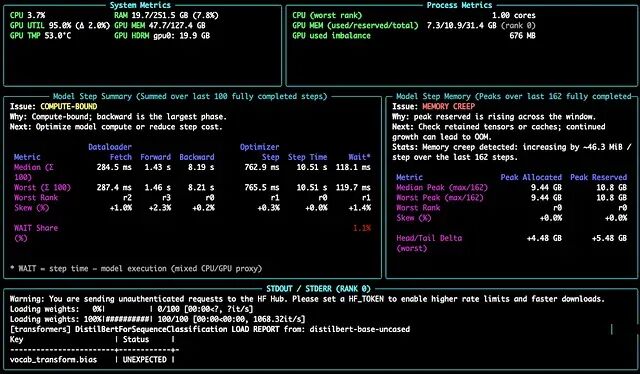

TraceML:用三行代码为训练循环加入 step 级诊断

TraceML 是开源的目前支持单 GPU 以及单节点 DDP/FSDP;多节点支持很快会推出。

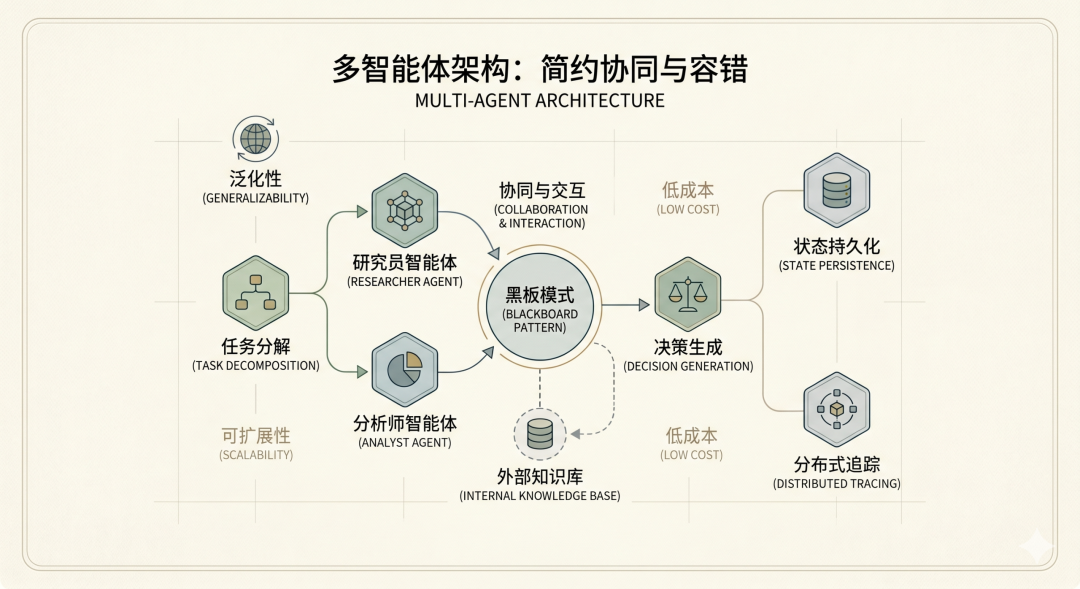

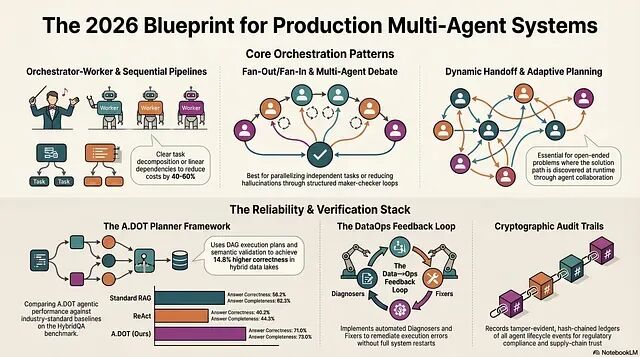

告别脆弱的单体应用,用多智能体网络构建稳定的生产力工具

本文深度解析了 AI 应用从单体大模型向多智能体(Multi-Agent)架构演进的技术趋势与工程实践。面对复杂业务,多智能体系统凭借角色分工与优雅降级展现出极强的泛化性

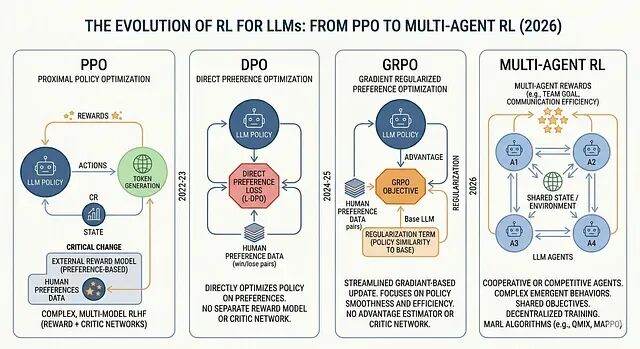

2026 年面向 LLM 的 RL方法总结:从 PPO 到 DPO 到 GRPO,再到多智能体 RL

本文是对当前格局的一次梳理。会用一点篇幅讲历史,更多篇幅留给 PPO、DPO、GRPO 和 MARL——它们是什么、各自适合什么场景、实际中会在哪里坏掉,以及今天的开源技术栈大概长什么样。

构建一个可自我改进的多 Agent RAG 系统:架构、评估,以及带人工审核的 Prompt 反馈闭环

本文描述的系统包含一个自我改进的评估闭环:自动定位表现不佳的 Prompt 维度,给出有针对性的改写方案,并通过一道由量化回归检测把关的人工审批步骤来决定是否上线。

Agent = Model + Harness:模型决定上限Harness 决定下限

Harness 不是一块单一的基础设施而是一层一层叠起来的能力栈。

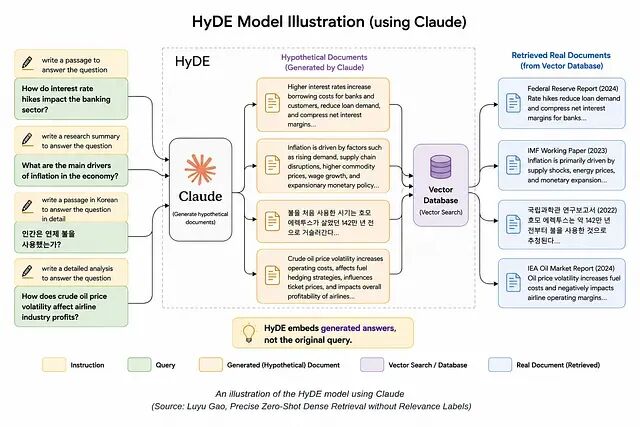

HyDE :让 RAG 检索从"匹配关键词"升级到"理解意图"

**Hypothetical Document Embeddings(HyDE)** 不是"搜索文档",而是让系统在检索开始之前,先想清楚理想答案应该长什么样。

让机器学习 Pipeline 更稳的 5 个 Python 装饰器代码

下面介绍 5 个适合现代 AI 开发流程的 Python 装饰器。

Feature Engineering 实战:Pandas + Scikit-learn的机器学习特征工程的完整代码示例

Feature engineering 是机器学习 pipeline 里最关键的一环。

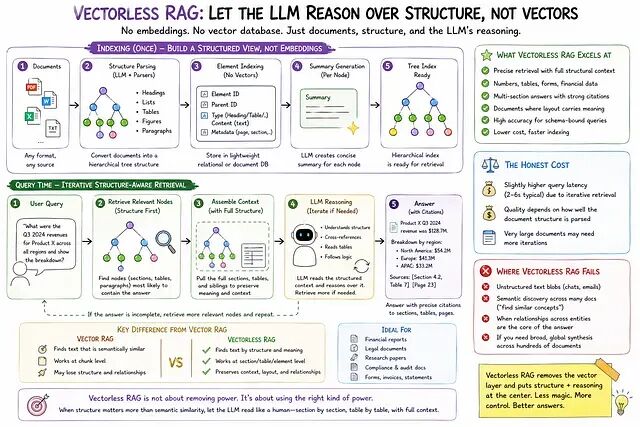

2026 RAG 选型指南:Vector、Graph、Vectorless 该怎么挑

这篇文章将介绍它们之间的差异,让你不必花三周读论文也能为自己的系统做出正确选择。

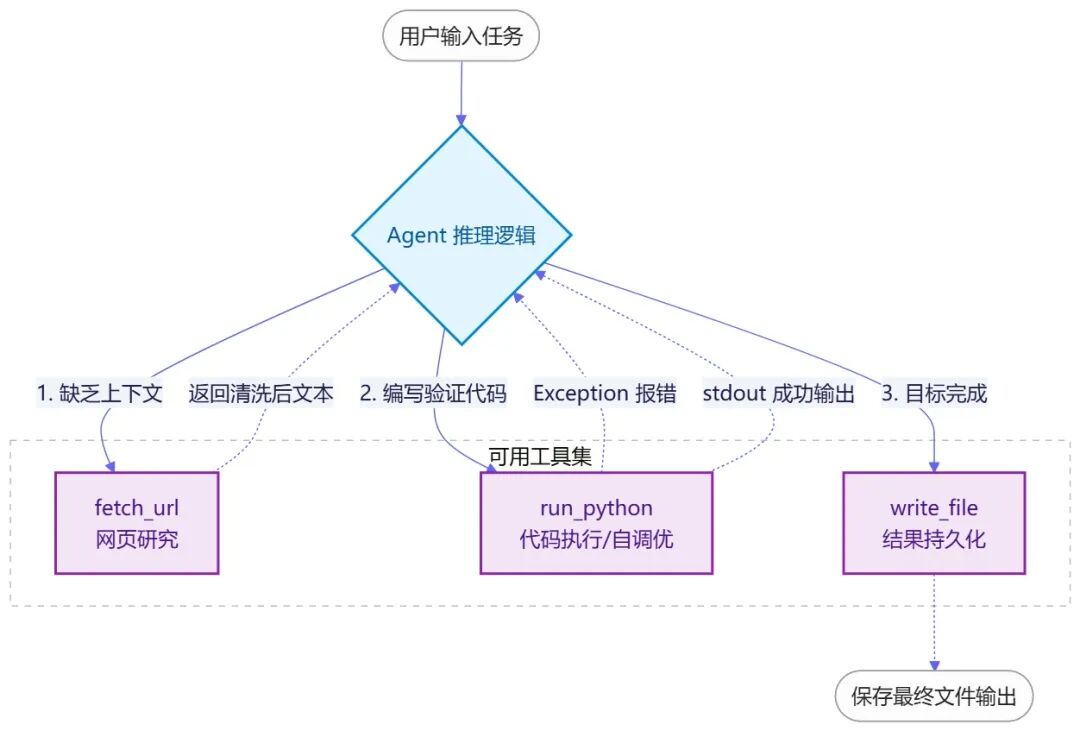

三个工具,让 agent 在一次对话里完成研究、写码、调试与保存

其实只要有三个工具就能把 agent 从聊天机器人变成能干活的东西

用 Playwright 和 LLM 实现自愈测试自动化

Playwright 是一个用于 Web 自动化和端到端测试的开源框架。

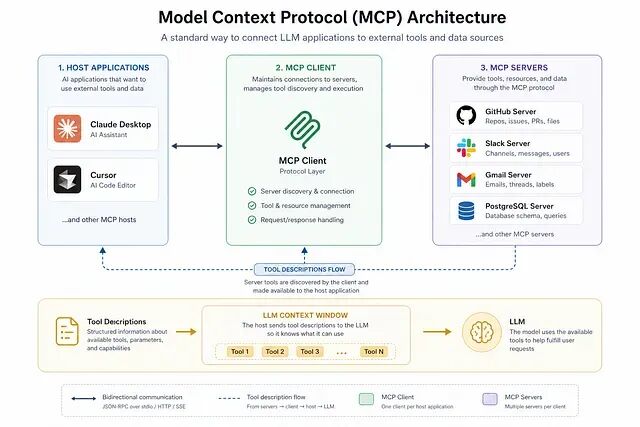

为什么 MCP 在协议层会有 prompt injection的问题:工具描述如何劫持 agent 上下文

MCP(Model Context Protocol)当初被设计成 AI agent 的通用集成层,但它的架构有一个根本缺陷:

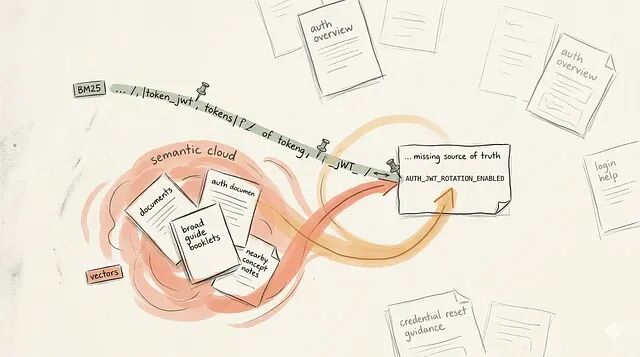

BM25 + Vectors:为什么真实 RAG 系统通常两者都需要

RAG 是一个先选内容再做生成的系统;retriever 不搜索文档,它搜索 chunks。