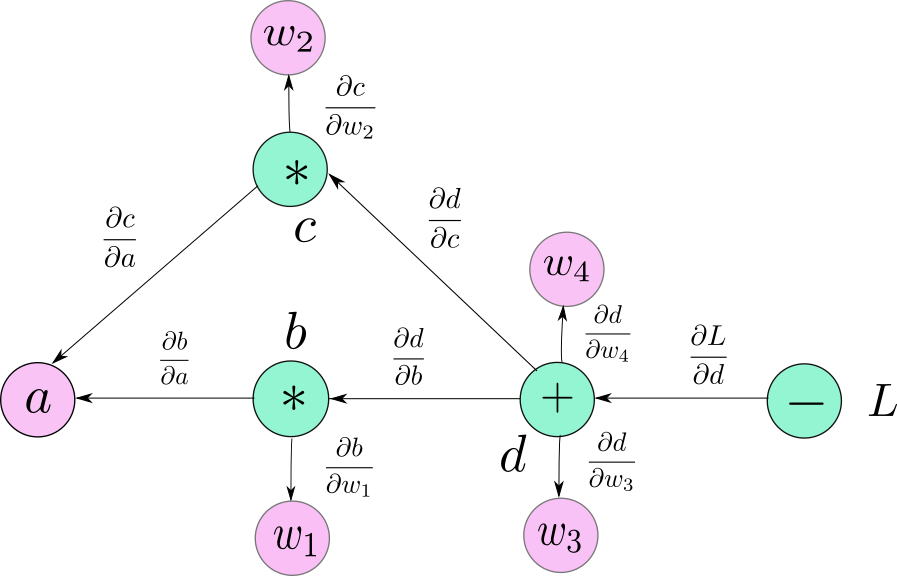

使用 Numpy 创建自己的深度学习框架

本文并不是为了造轮子,只是通过手动实现来介绍建基本深度学习框架所需组件和步骤

PyTorch----实现手写数字的识别

加载手写数字的数据组成训练集和测试集,这里已经下载好了,所以download为Falseimport torchvision# 是否支持gpu运算# device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')# prin

项目实战解析:基于深度学习搭建卷积神经网络模型算法,实现图像识别分类

项目交流群(源码获取,问题解答):617172764文章目录前言一、基础知识介绍二、数据集收集三.模型训练四.图像识别分类总结前言随着人工智能的不断发展,深度学习这门技术也越来越重要,很多人都开启了学习机器学习,本文将通过项目开发实例,带领大家从零开始设计实现一款基于深度学习的图像识别算法。学习本章

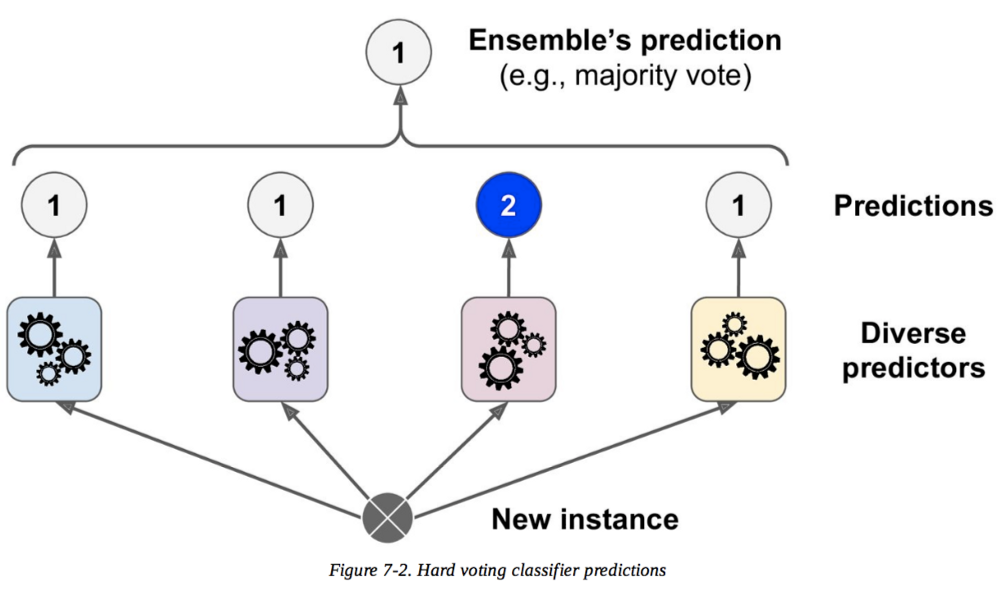

基于神经网络集成学习的研究论文推荐

集成 的概念在机器学习中很常见。集成可以被认为是一种学习技术,可以将许多模型连接起来解决一个问题

PyTorch 全连接层权值共享的手势识别网络

机器人学实验课的考核是,利用机械臂做一下拓展应用,所以花了很多时间来设计了这个神经网络因为这个神经网络的思路比较新颖,而且尝试了一些防止过拟合、性能优化的手段,所以决定记录一下模型性能time FPS FLOTs Params (float16) 4.195 ms 238 9,

微调大型语言模型示例:使用T5将自然语言转换成SQL语句

在本文中,我们将使用谷歌的文本到文本生成模型T5和我们的自定义数据进行迁移学习,这样它就可以将基本问题转换为SQL查询。

深度对抗神经网络(DANN)笔记

一 总体介绍DANN是一种迁移学习方法,是对抗迁移学习方法的代表方法。基本结构由特征提取层f,分类器部分c和对抗部分d组成,其中f和c其实就是一个标准的分类模型,通过GAN(生成对抗网络)得到迁移对抗模型的灵感。但此时生成的不是假样本,而是假特征,一个足以让目标域和源域区分不开的假特征。而领域判别器

吴恩达机器学习——第五周学习笔记

神经网络代价函数(Cost Function)正则化逻辑回归的代价函数:神经网络的代价函数:L:是神经网络架构的层数Sl:l层的单元个数K:输出单元的个数sigmoid函数:def sigmoid(z): return 1 / (1 + np.exp(-z))前向传播函数:#前向传播函数def

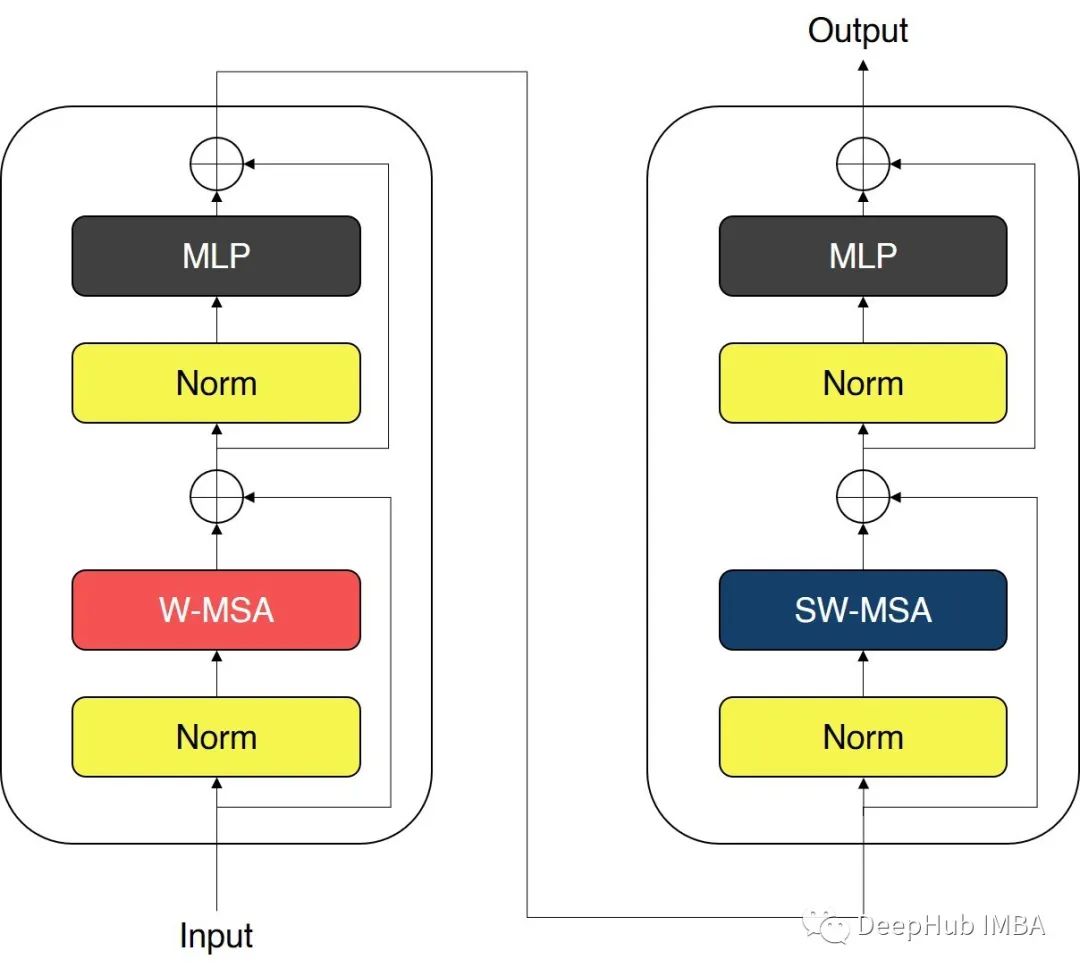

使用动图深入解释微软的Swin Transformer

本文旨在使用插图和动画为Swin Transformers提供全面的指南,以帮助您更好地理解这些概念。

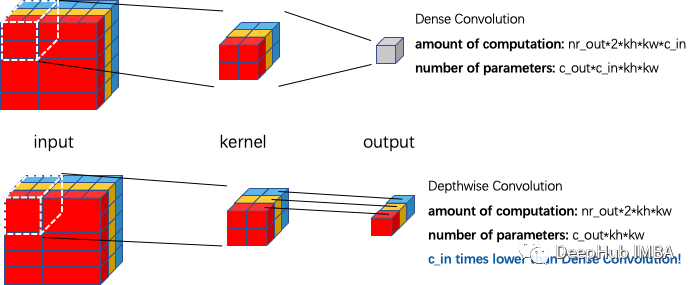

【深度学习】常见的神经网络层(上)

在深度学习中常见的神经网络层的讲解

数据科学中的 10 个重要概念和图表的含义

“当算法给你一条曲线时,一定要知道这个曲线的含义!”

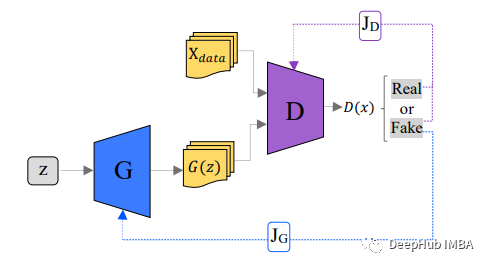

GAN 初学者指南

GAN是一个非常巧妙并且非常有用的模型。当有大量关于 GAN 的论文时,但是你会发现这些论文通常很难理解,你可能会想要一些对初学者更友好的东西。所以本文的对非传统机器学习人员来说,是我能想到的最好的例子。

Python学习记录 使用tensorflow 2.8 完成猫狗识别 使用keras构建CNN神经网络

猫狗识别项目数据分为带标签和不带标签带标签:25000张不带标签:12500张数据分类处理下载的数据存放在data文件夹下# 定义数据存储的文件夹data_dir = './data/'train是25000张带标签的猫狗图片test1是12500张无标签的猫狗图片使用代码核对一下# 进入图片数据的

神经网络入门(详细 )

机器学习流程、K近邻算法,以及详细介绍了神经网络的基本框架。

梯度和法向量的统一理解

在学习梯度和曲面上一点处的法向量的时候,发现它们的计算方法非常相似,但是一开始进入了误区,甚至以为梯度应该是模最大的切向量。想了好久才从几何意义的角度把梯度和法向量统一,希望下面的内容能帮助你加深理解。1.梯度严格意义上梯度只能说是只是函数的梯度。以二元函数为例,对应的平面方程:在某一点=处,如果我

多层感知机还在进步,关于深度学习中MLP的5篇最新的论文推荐

2002年最新的5篇MLP论文推荐

笔记:基于keras的不同神经网络模型Minst手写体识别

基于keras不同神经网络模型的mnist手写体识别

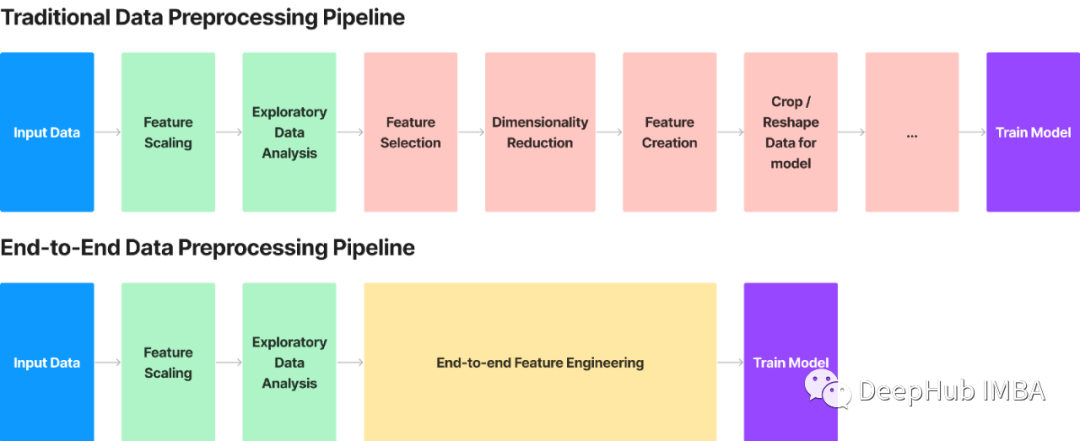

端到端的特征转换示例:使用三元组损失和 CNN 进行特征提取和转换

通过卷积和三元组损失学习数据的表示,并提出了一种端到端的特征转换方法,这种使用无监督卷积的方法简化并应用于各种数据。