神经网络实验报告-tensorflow基础

NumPy是Python中最重要的科学计算库之一,提供了多维数组、矩阵等数值计算功能,具有良好的数据处理能力和高效的计算性能,并且拥有丰富的函数库,可以进行数据加工、处理、筛选等操作。而TensorFlow则是一个由Google开发的机器学习框架,可以用来构建和训练神经网络等深度学习模型,提供灵活的

BERT+TextCNN实现医疗意图识别项目

BERT+TextCNN实现医疗意图识别项目

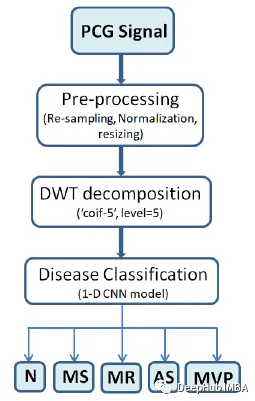

一种用于心音分类的轻量级1D-CNN+DWT网络

利用离散小波变换(DWT)得到的多分辨率域特征对1D-CNN模型进行心音分类训练。

2.树莓派4B 64位操作系统 从零搭建深度学习项目运行环境

树莓派的系统烧录树莓派的基础配置树莓派的开机连接树莓派的文件传输树莓派的软件安装树莓派的运行环境树莓派的系统备份测试运行现有模型。

通道信息,空间信息,通道注意力以及空间注意力

通道信息,空间信息,通道注意力以及空间注意力

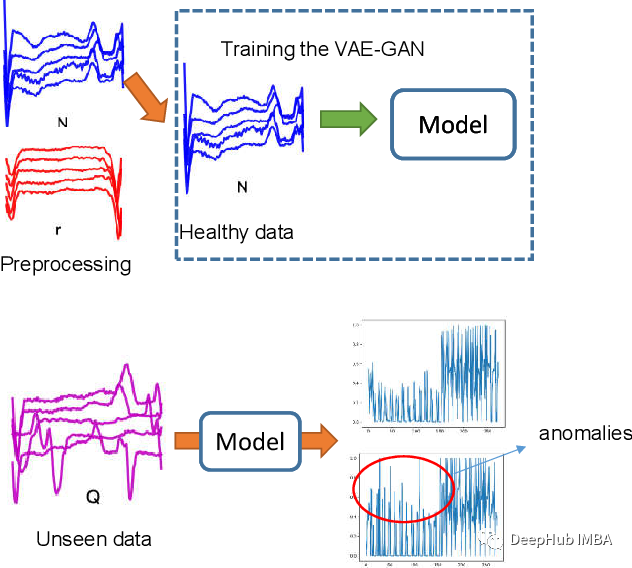

使用GAN进行异常检测

GAN是一种深度学习模型,可以学习生成与给定数据集相似的真实数据样本。这一特性表明它们可以成功地用于异常检测

Pytorch学习笔记(5):torch.nn---网络层介绍(卷积层、池化层、线性层、激活函数层)

Pytorch学习笔记(5):torch.nn---网络层介绍(卷积层、池化层、线性层、激活函数层)

深度学习算法:探索人工智能的前沿

深度学习,作为人工智能领域的瑰宝,已经在过去的几年里引起了广泛关注。这一领域的快速发展为解决复杂的问题提供了新的工具和方法。本文将深入探讨深度学习算法的核心概念、应用领域以及未来发展趋势,以期为读者提供对这一领域的全面理解。

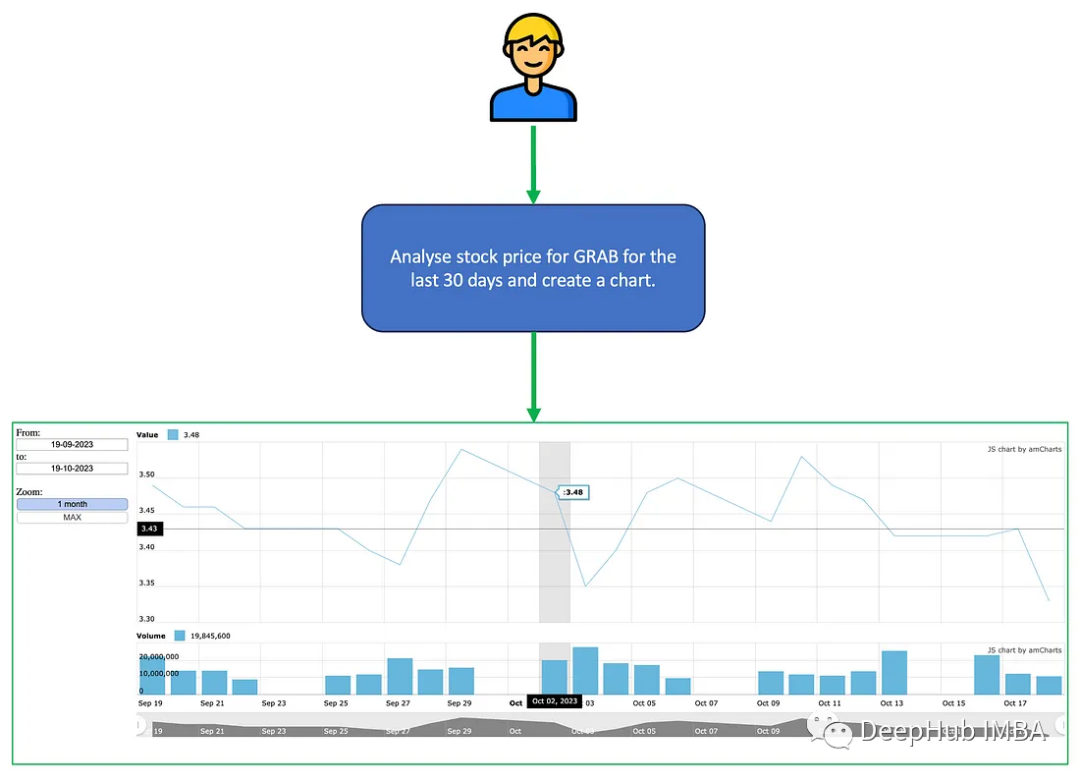

AutoGen多代理对话项目示例和工作流程分析

在这篇文章中,我将介绍AutoGen的多个代理的运行。这些代理将能够相互对话,协作评估股票价格,并使用AmCharts生成图表。

GAN(Generative Adversarial Nets (生成对抗网络))

②部分,此时判别器D的输入为G(z),为假图像,但是我们期望的是生成器的效果好,即尽可能的瞒过D,也就是期望D(G(z))尽可能大,越大表示D判定假图像为真实数据的概率越大,也就表明生成器G生成的图像效果好,可以成功的骗过D。在训练的时候,D(G(z))越大越接近于1,y越小,生成器生成的假图越被判

GPU服务器安装显卡驱动、CUDA和cuDNN

gpu服务器中容器调用显卡运算

深度学习模型组件系列二:最常用的特征提取器

深度学习模型组件的特折提取器

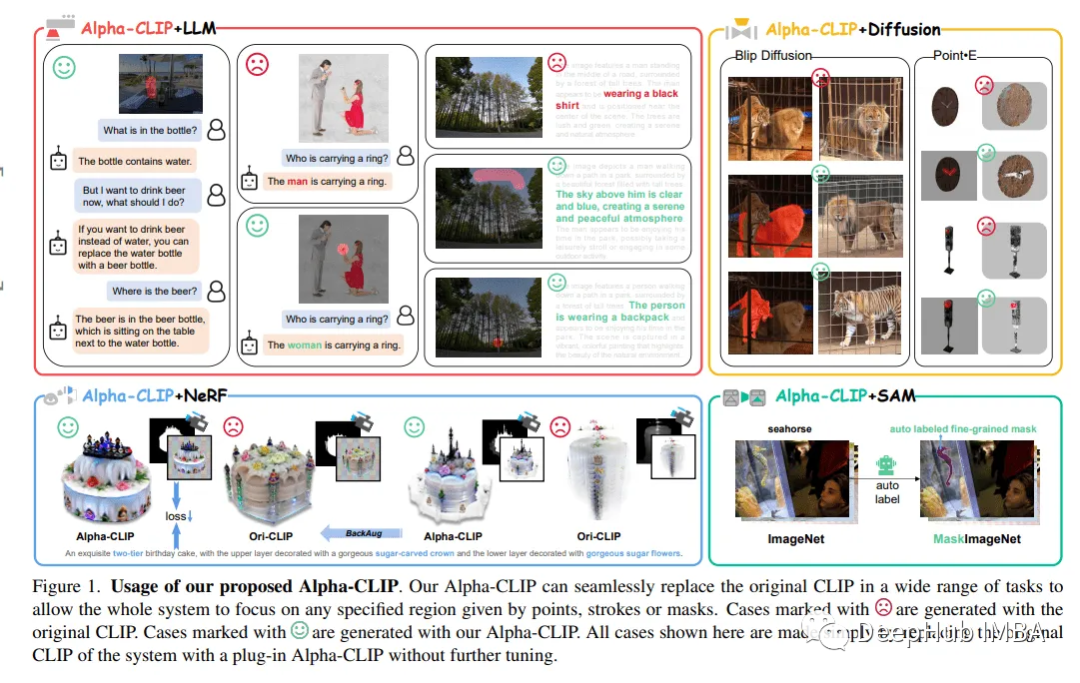

CLIP的升级版Alpha-CLIP:区域感知创新与精细控制

Alpha-CLIP不仅保留了CLIP的视觉识别能力,而且实现了对图像内容强调的精确控制,使其在各种下游任务中表现出色。

深度学习模型的参数、计算量和推理速度统计

在没有过拟合的情况下,相同模型结构下,一般模型的参数量和计算量与最终的性能成正比,在比较不同模型性能时,最好能保持模型参数量和计算量在相同水平下,因此相应参数的统计很重要。这里只进行理论计算,最终的效果(内存和速度)还和网络结构,代码实现方式、应用的平台性能等条件有关系,例如使用GEMM实现CNN时

Wav2Vec & HuBert 自监督语音识别模型

自监督预训练语言模型,wav2vec, wav2vec2.0,HUBert

AI:90-基于深度学习的自然灾害损害评估

基于深度学习的自然灾害损害评估自然灾害如地震、飓风、洪水和火灾常常带来严重的人员伤亡和财产损失。快速、准确的自然灾害损害评估对于有效的救援和恢复工作至关重要。在过去,这种评估通常是由人工进行的,费时费力且容易出错。然而,现代技术和深度学习的出现为自然灾害损害评估带来了全新的可能性。

水果分割论文、代码和数据集汇总

果园、分割、算法

经典神经网络论文超详细解读(六)——DenseNet学习笔记(翻译+精读+代码复现)

DenseNet论文(《Densely connected convolutional networks》)超详细解读。翻译+总结。文末有代码复现

目标检测评价指标

检测精度指标:IoU、TP、TN、FP、FN、查准率、查全率、F1-Score、ROC曲线、P-R曲线、AP、mAP以及MS COCO评价指标和PASCAL VOC的评价指标的理解;检测速度指标:FPS、FLOPS和FLOPs

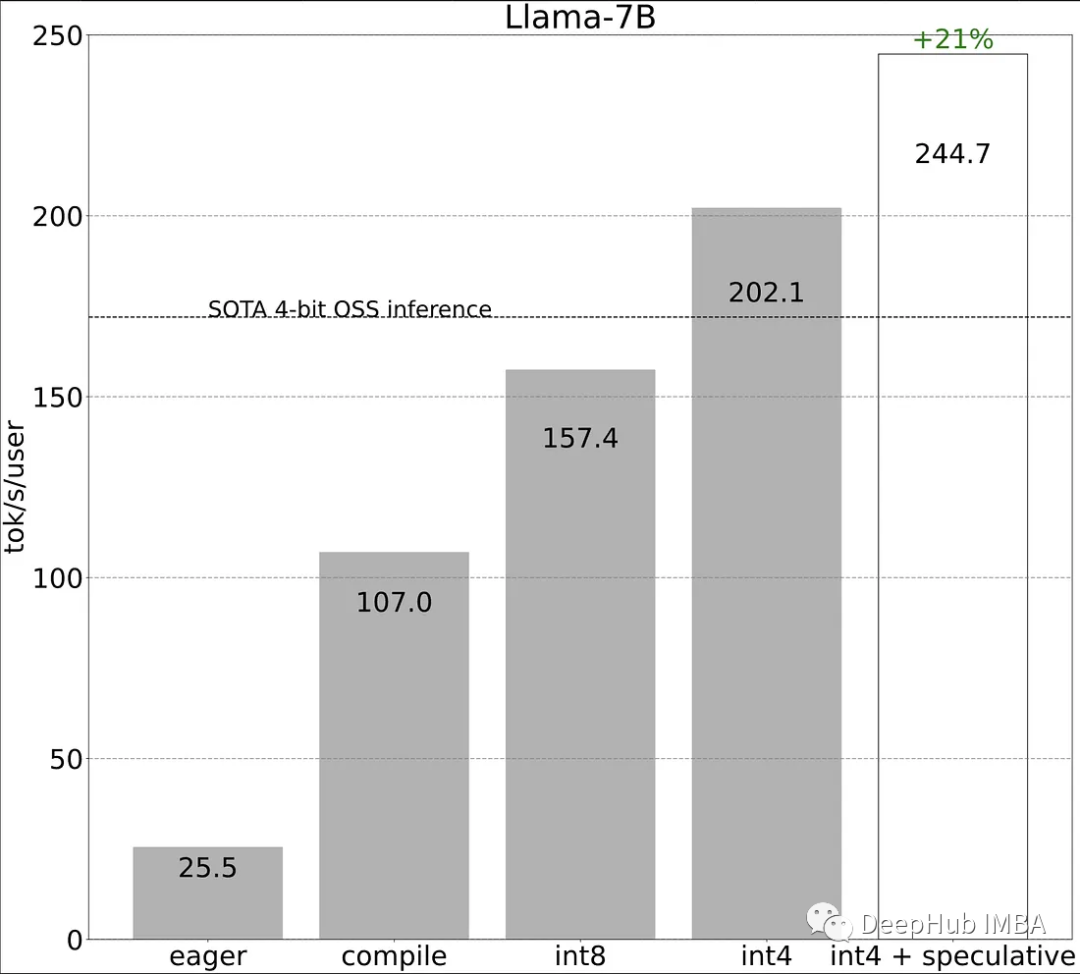

使用PyTorch II的新特性加快LLM推理速度

Pytorch团队提出了一种纯粹通过PyTorch新特性在的自下而上的优化LLM方法