深度学习——制作自己的VOC图像分割数据集

labelme主要是制作语义分割数据集(ImageSets,JPEGImages,SegmentationClass,SegmentationObject几个文件夹),labelImg主要是制作目标检测数据集(主要是Annoations中的xml文件),最后把两个合在一起就可以使用maskR-CNN

DETR(DEtection TRansformer)要点总结

DETR翻译过来就是检测transformer,是Detection Transformers的缩写。这是一个将2017年大火的transformer结构首次引入目标检测领域的模型,是transformer模型步入目标检测领域的开山之作。利用transformer结构的自注意力机制为各个目标编码,依

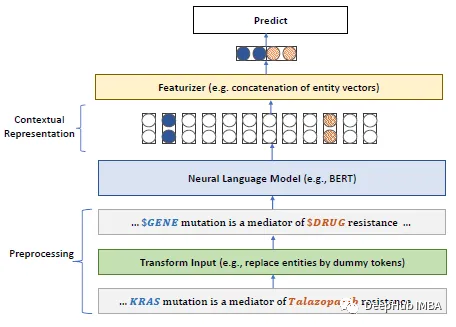

PubMedBERT:生物医学自然语言处理领域的特定预训练模型

语言模型并不一定就是最优的解决方案,“小”模型也有一定的用武之地

RuntimeError: stack expects each tensor to be equal size ??

RuntimeError: stack expects each tensor to be equal size

MNIST数据集ubyte格式数据解析

MNIST数据集格式解析

上采样,下采样,卷积,反卷积,池化,反池化,双线性插值【基本概念分析】

然而,确实有一些缩放方法能够增加图像的信息,从而使得缩放后的图像质量超过原图质量的。在右边的等式中的字母f(Q11)、f(Q12)、f(Q21)、f(Q22)、x1、x2、x都是已知的,求出的f(x,y1)与f(x,y2)即为R1、R2的像素值。那么就从左上角到右下角,生成卷积之后的矩阵的大小是(5

多模态技术综述

多模态机器学习是对计算机算法的研究,通过使用多模态数据集来学习和提高性能。多模式深度学习是一个机器学习子领域,旨在训练人工智能模型来处理和找到不同类型的数据(模式)之间的关系,通常是图像、视频、音频和文本。通过组合不同的模式,深度学习模型可以更普遍地理解其环境,因为一些线索只存在于某些模式中。想象一

Tensorflow在pycharm中安装不上怎么办

Tensorflow在pycharm中安装不上怎么办

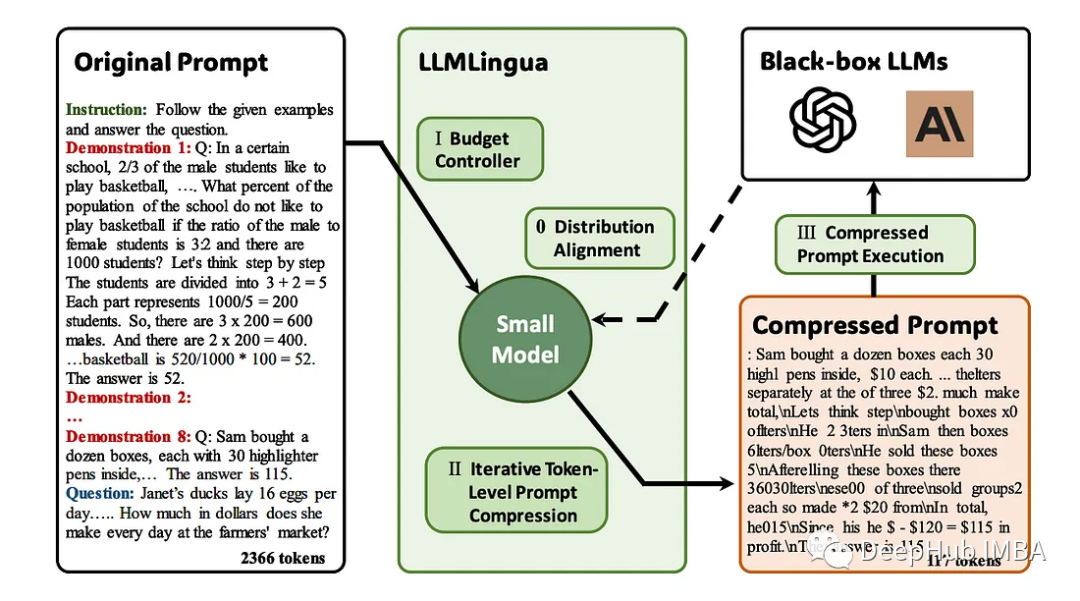

LLMLingua:集成LlamaIndex,对提示进行压缩,提供大语言模型的高效推理

大型语言模型(llm)的出现刺激了多个领域的创新。但是在思维链(CoT)提示和情境学习(ICL)等策略的驱动下,提示的复杂性不断增加,这给计算带来了挑战。

pytorch:参数pin_memory=True和non_blocking=True的作用

参数pin_memory=True和non_blocking=True的作用

深度学习|BP神经网络

讲述BP神经网络原理,并通过Python语言,分别导入numpy、sklearn和pytorch库完成编程。

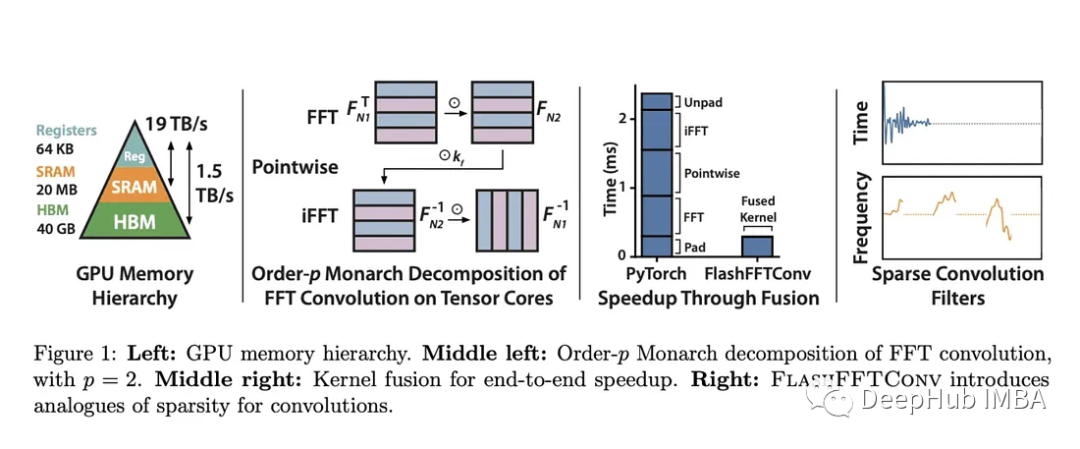

斯坦福大学引入FlashFFTConv来优化机器学习中长序列的FFT卷积

斯坦福大学的FlashFFTConv优化了扩展序列的快速傅里叶变换(FFT)卷积。该方法引入Monarch分解,在FLOP和I/O成本之间取得平衡,提高模型质量和效率。

人工智能中的文本分类:技术突破与实战指导

在本文中,我们全面探讨了文本分类技术的发展历程、基本原理、关键技术、深度学习的应用,以及从RNN到Transformer的技术演进。文章详细介绍了各种模型的原理和实战应用,旨在提供对文本分类技术深入理解的全面视角。

经典神经网络论文超详细解读(五)——ResNet(残差网络)学习笔记(翻译+精读+代码复现)

RseNet论文(《Deep Residual Learning for Image Recognition》)超详细解读。翻译+总结。文末有代码复现

使用ExLlamaV2量化并运行EXL2模型

量化大型语言模型(llm)是减少这些模型大小和加快推理速度的最流行的方法。在这些技术中,GPTQ在gpu上提供了惊人的性能。与非量化模型相比,该方法使用的VRAM几乎减少了3倍,同时提供了相似的精度水平和更快的生成速度。

听懂未来:AI语音识别技术的进步与实战

本文全面探索了语音识别技术,从其历史起源、关键技术发展到广泛的实际应用案例,揭示了这一领域的快速进步和深远影响。文章深入分析了语音识别在日常生活及各行业中的变革作用,展望了其未来发展趋势。

【计算机视觉】ViT:代码逐行解读

【计算机视觉】ViT:代码逐行解读

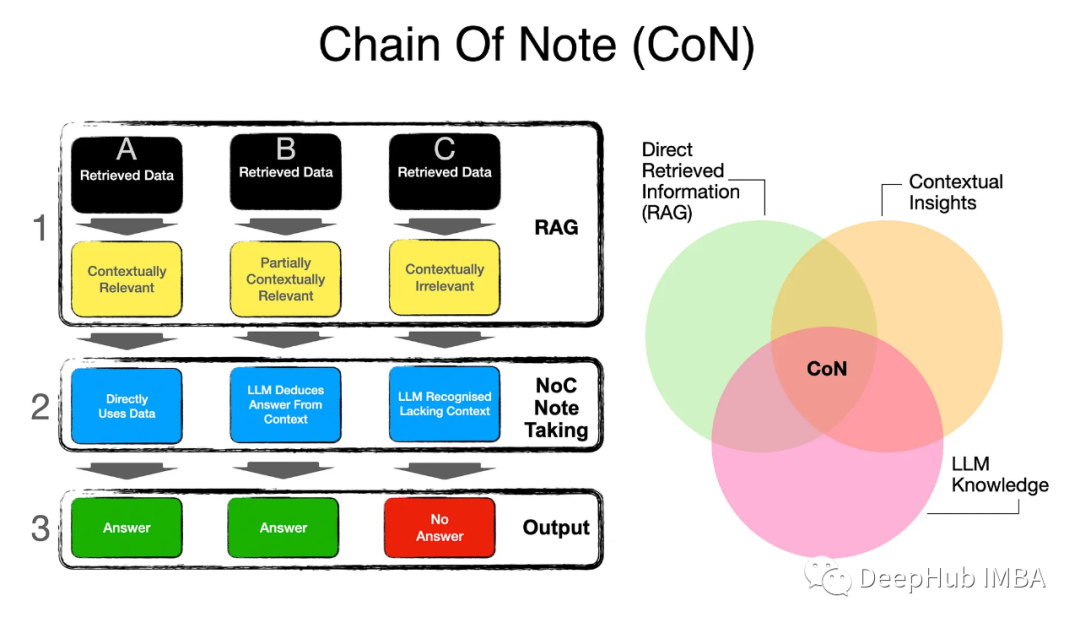

Chain-Of-Note:解决噪声数据、不相关文档和域外场景来改进RAG的表现

这是腾讯实验室在11月最新发布的一篇论文,CoN的核心思想是生成连续的阅读笔记对于检索到的文档,能够对其与给出问题并综合这些信息来形成最终的答案,提高了RAG的表现。

使用冻结层进行迁移学习

使用冻结层进行迁移学习

Swin-transformer详解

这篇论文提出了一个新的 Vision Transformer 叫做 Swin Transformer,它可以被用来作为一个计算机视觉领域一个通用的骨干网络.但是直接把Transformer从 NLP 用到 Vision 是有一些挑战的,这个挑战主要来自于两个方面一个就是尺度上的问题。因为比如说现在有