Window10环境搭建2:下载CUDA

首先要知道自己电脑支持的最高CUDA版本,按下Win+R,输入cmdnvidia-smi这里显示的就是你的设备允许安装的最大版本CUDA。

毕业设计-基于深度学习玉米叶病虫害识别系统 YOLO python 机器学习 目标检测 人工智能 算法

基于深度学习的玉米叶病虫害识别系统,用于毕业设计。该系统利用先进的深度学习算法,通过对玉米叶片图像进行分析和处理,实现对不同类型的叶病和虫害的准确识别。我们采用了经典的CNN架构和数据增强技术,提高了模型的鲁棒性和泛化能力。通过大规模的数据集训练和验证,我们的系统在测试集上取得了令人满意的准确性和稳

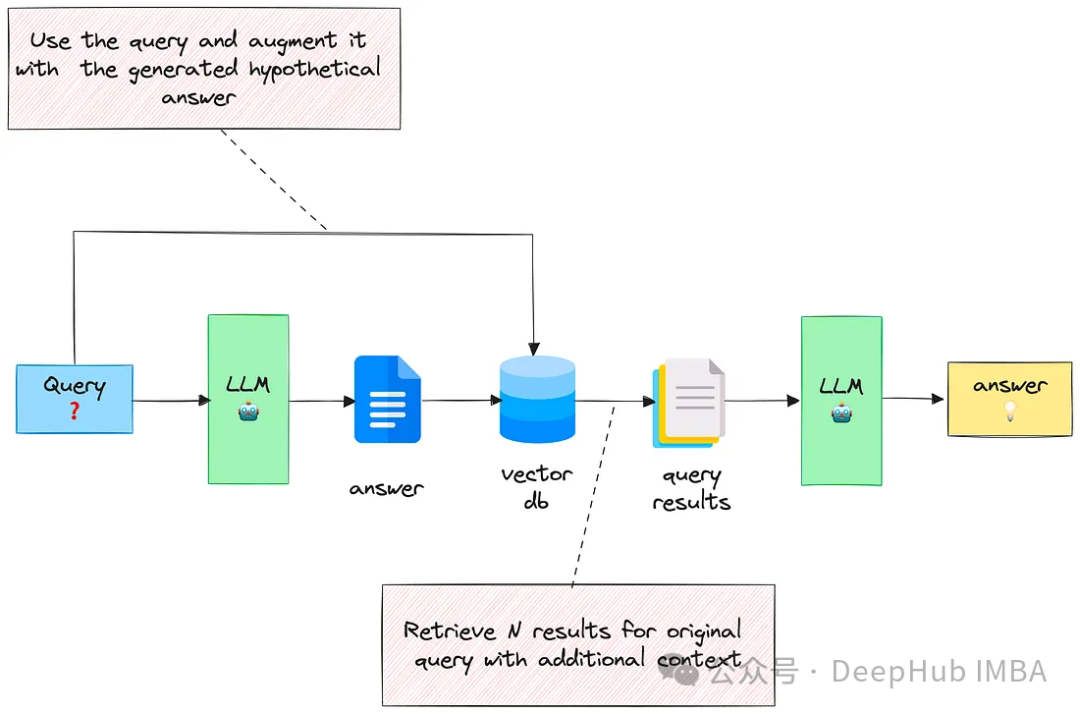

RAG中的3个高级检索技巧

本文将探讨三种有效的技术来增强基于rag的应用程序中的文档检索,通过结合这些技术,可以检索与用户查询密切匹配的更相关的文档,从而生成更好的答案。

MMSeg框架segformer模型训练自己的数据集

mmsegmentation训练跑自己的数据集改配置文件,包含多卡跑、单卡跑、可视化日志等

机器学习、人工智能、深度学习的关系

传统的机器学习方法在面对数据量激增的情况下,其性能表现得差强人意,与此形成鲜明对比的是,深度学习反而表现出卓越的性能,特别是在2010年之后,各种深度学习框架的发布及其在各领域的突出表现,更进一步促进了深度学习算法的发展。人工智能范围很广,它是一门新的科学与工程,是研究、开发用于模拟、延伸和扩展人的

【深度学习基础】反向传播BP算法原理详解及实战演示(附源码)

【深度学习基础】反向传播BP算法原理详解及实战演示(附源码)

AI:11-基于深度学习的鱼类识别

当今,人工智能和深度学习已经成为许多领域的关键技术。在生态学和环境保护领域,鱼类识别是一项重要的任务,因为准确识别和监测鱼类种群对于保护水生生物多样性和可持续渔业管理至关重要。基于深度学习的鱼类识别系统能够自动识别和分类不同种类的鱼类,为生态学研究和渔业管理提供有力的工具。基于深度学习的鱼类识别系统

4种通过LLM进行文本知识图谱的构建方法对比介绍

本文将介绍和比较使用LLM转换非结构化文本的四种方法,这些方法在不同的场景中都可能会用到。

transformer概述和swin-transformer详解

transformer和swin-transformer

Tokenization 指南:字节对编码,WordPiece等方法Python代码详解

计算机要处理语言,首先需要将文本转换成数字形式。这个过程由一个称为标记化 Tokenization。

聊聊关于分类和分割的损失函数:nn.CrossEntropyLoss()

解释分类和分割中,CrossEntropyLoss 交叉熵损失函数的作用

AI:105-基于深度学习的手术操作监控与辅助

AI:105-基于深度学习的手术操作监控与辅助随着人工智能技术的飞速发展,深度学习作为其重要组成部分,在医学领域取得了显著的成就。其中,基于深度学习的手术操作监控与辅助系统成为医学界的研究热点。本文将深入探讨深度学习在手术领域的应用,重点关注手术操作的实时监控与辅助技术,并提供一个简单的代码实例来说

AI:05- - 基于深度学习的道路交通信号灯的检测与识别

随着人工智能的快速发展,基于深度学习的视觉算法在道路交通领域中起到了重要作用。本文将探讨如何利用深度学习技术实现道路交通信号灯的检测与识别,通过多处代码实例展示技术深度。道路交通信号灯是指示交通参与者行驶和停止的重要信号。准确地检测和识别交通信号灯对于智能交通系统和自动驾驶技术的发展至关重要。传统的

Swin Transformer详解

Vit出现后虽然让大家看到了Transformer在视觉领域的潜力,但并不确定Transformer可以做掉所有视觉任务。Swin Transformer可以作为一个通用的骨干网络。面对的挑战:1、多尺度。2、高像素。移动窗口提高效率,并通过Shifted操作变相达到全局建模能力。层次结构:灵活,可

Anaconda安装及配置(简单清晰版)

Anaconda安装与配置

【古诗生成AI实战】之四——模型包装器与模型的训练

中存储的正是这些词的概率。为了生成文本,我们提取每个位置上概率最高的词的索引,然后根据这些索引在词典中查找对应的词。此外,为了提高配置的灵活性和可维护性,我们将所有的配置项(如批量大小、数据集地址、训练周期数、学习率等)抽取出来,统一放置在一个名为。为此,我们采取了进一步的措施:在模型外面再套上一个

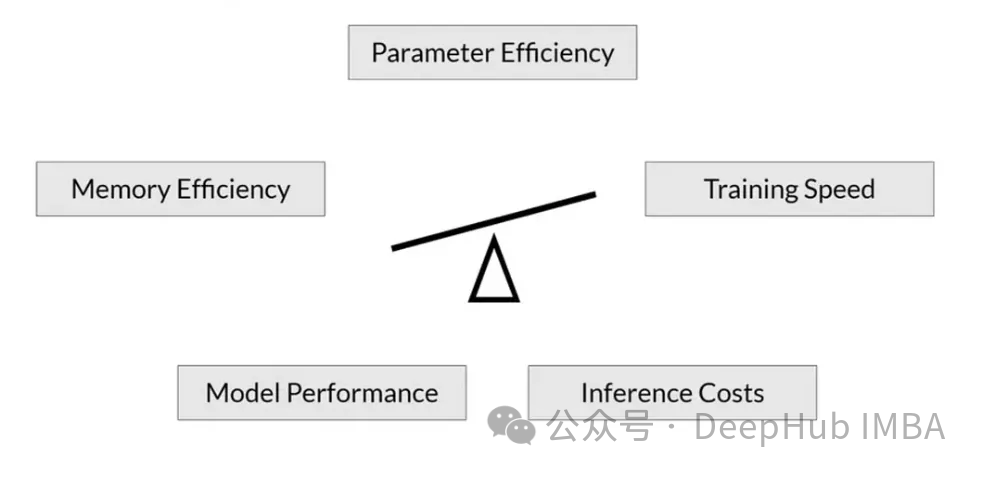

RoSA: 一种新的大模型参数高效微调方法

随着语言模型不断扩展到前所未有的规模,对下游任务的所有参数进行微调变得非常昂贵,PEFT方法已成为自然语言处理领域的研究热点。PEFT方法将微调限制在一小部分参数中,以很小的计算成本实现自然语言理解任务的最先进性能。

从零开始使用MMSegmentation训练Segformer

写在前面:最新想要用最新的分割算法如:Segformer or SegNeXt 在自己的数据集上进行训练,但是有不是搞语义分割出身的,而且也没有系统的学过MMCV以及MMSegmentation。所以就折腾了很久,感觉利用MMSegmentation搭建框架可能比较系统,但是对于不熟悉的或者初学者非

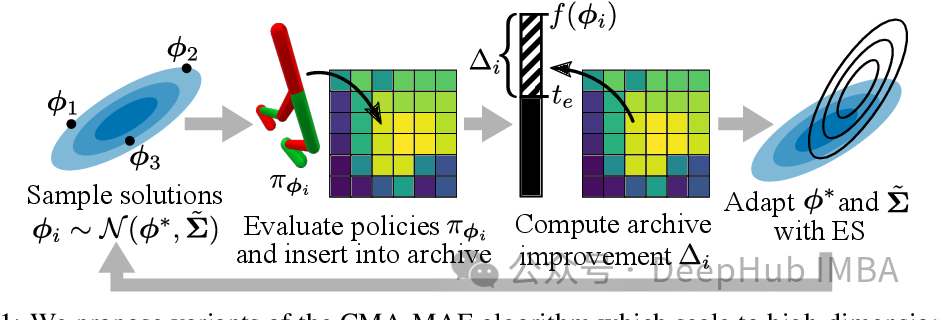

基于协方差矩阵自适应演化策略(CMA-ES)的高效特征选择

特征选择是指从原始特征集中选择一部分特征,以提高模型性能、减少计算开销或改善模型的解释性。