从视频到音频:使用VIT进行音频分类

在本文中,我们将利用ViT - Vision Transformer的是一个Pytorch实现在音频分类数据集GTZAN数据集-音乐类型分类上训练它。

【深度学习】(三)图像分类

上一章介绍了深度学习的基础内容,这一章来学习一下图像分类的内容。图像分类是计算机视觉中最基础的一个任务,也是几乎所有的基准模型进行比较的任务。从最开始比较简单的10分类的灰度图像手写数字识别任务mnist,到后来更大一点的10分类的cifar10和100分类的cifar100任务,到后来的image

手把手带你调参Yolo v5 (v6.2)(验证)

解析val.py文件中21个参数含义!

可解释深度学习:从感受野到深度学习的三大基本任务:图像分类,语义分割,目标检测,让你真正理解深度学习

深度学习一直作为一个“盲盒”被大家诟病,我们可以借助深度学习实现端到端的训练,简单,有效,但是我们并不了解神经网络的中间层到底在做什么,每一层卷积的关注点是什么。我在之前的专题浅谈图像处理与深度学习中提到,我们在深度学习刚开始的时候,我们要实现一个任务,比如:把不清晰的图像变清晰,我们随意的搭建了

人工智能学习——模糊控制

模糊控制文章目录模糊控制前言一、模糊控制是什么?与神经网络的区别?二、模糊控制原理1.模糊化2.模糊规则3.模糊推理4.解模糊化三、模糊控制算法实例解析(含代码)1、选择观测量和控制量参考前言鉴于个人学习方向并不在此,所以此文章仅作为个人学习笔记使用,主要介绍理论以及学习过程,仅供参考!一、模糊控制

【ResNet】Pytorch从零构建ResNet18

Pytorch从零构建ResNet18ResNet 目前是应用很广的网络基础框架,所以有必要了解一下.本文从简单的ResNet18开始,详细分析了ResNet18的网络结构,并研究BasicBlock的结构。,使得整个结构非常清晰,再之后手工构建ResNet18网络就没有那么困难了。

基于BP神经网络的PID智能控制

PID控制要获得较好的控制效果,就必须通过调整好比例、积分和微分三种控制作用,形成控制量中既相互配合又相互制约的关系,这种关系不一定是简单的“线性组合”,从变化无穷的非线性组合中可以找出最佳的。神经网络所具有的任意非线性表达的能力,可以通过对系统性能的学习来实现具有最佳组合的PID控制。

ECCV2022论文列表(中英对照)

ECCV2022论文列表(中英对照)

深度学习中的FPN详解

深度学习入门小菜鸟,希望像做笔记记录自己学的东西,也希望能帮助到同样入门的人,更希望大佬们帮忙纠错啦~侵权立删。一、提示:这里可以添加本文要记录的大概内容:例如:随着人工智能的不断发展,机器学习这门技术也越来越重要,很多人都开启了学习机器学习,本文就介绍了机器学习的基础内容。提示:以下是本篇文章正文

在CPU上跑yolov5(详细步骤+适合入门)

非常详细的步骤,适合新手,不要一天就可以跑通!

神经网络加上注意力机制,精度不升反降?

明明人家论文里都证实了显著涨点的,到我这咋就不行了呢?

深度学习之BP神经网络

算法是神经网络深度学习中最重要的算法之一,是一种按照误差逆向传播算法训练的多层前馈神经网络,是应用最广泛的神经网络模型之一。基本结构如图:其主要包含三部分(由左到右)1:输入层:输入数据2:隐含层:输入与输出之间的数据分析加工厂,通过各种参数(权重,偏差值)以及激活函数等其他数据处理方法与两边建立联

常用的激活函数(Sigmoid、Tanh、ReLU等)

目录一、激活函数定义二、梯度消失与梯度爆炸 1.什么是梯度消失与梯度爆炸2.梯度消失的根本原因3.如何解决梯度消失与梯度爆炸问题 三、常用激活函数1.Sigmoid2.Tanh3.ReLU4.Leaky ReLU5.ELU6.softmax7.Swish 激活函数 (Activatio

利用LSTM实现预测时间序列(股票预测)

目录1、作者介绍2、tushare 简介3、LSTM简介3.1 循环神经网络 (Recurrent Neural Networks)3.2 LSTM网络3.2.1 LSTM的核心思想3.2.2 一步一步理解LSTM4 代码实现4.1 导入相关资源包4.2 定义模型结构4.3 制作数据集4.4 模型

用pointnet++分类自己的点云数据

这篇博客主要是针对于现有的热门的激光点云处理算法pointnet++如何分类自己的数据集展开的。在介绍基本的pointnet++算法的概念、基本步骤及思想、部分代码讲解之后,会介绍如何使用自己的数据集进行分类(涉及到详细的代码改进方法及步骤)以及打印利用自己数据集跑出的模型后的点云坐标。

如何检测时间序列中的异方差(Heteroskedasticity)

异方差性影响时间序列建模。因此检测和处理这种情况非常重要。

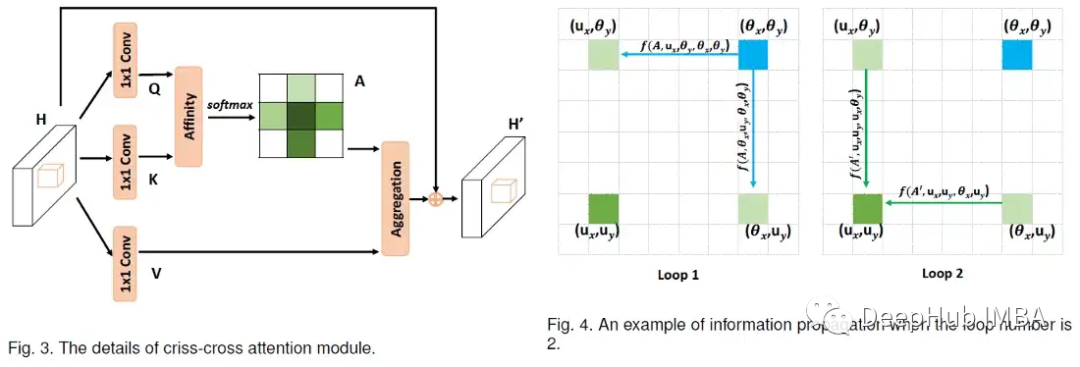

论文推荐:CCNet用于语义分割的交叉注意力

CCNet, Transformer递归交叉自注意力,比非局部神经网络更有效。华中科技大学、地平线、ReLER 和伊利诺伊大学香槟分校联合研发

汇编语言之母逝世,71岁时还和儿子合写神经网络论文

凯瑟琳・布斯被称为汇编语言之母,具体来说就是她创造了第一个“汇编语言”。 在1940年代中期,第一台通用电子计算机最初并没有用于代码的内部存储。如果我们想要用它编程,就要操纵数千个开关和电缆,而这些开关和电缆所在的位置,就是程序。科学家们必须手动更改数千根电缆和开关,或者在卡片上打孔,然后将卡片送入

Matlab深度学习入门实例:从0搭建卷积神经网络CNN(附完整代码)

Matlab的功能十分强大,其自带的深度学习工具箱可以使我们免于编写底层算法,迅速地搭建出一个卷积神经网络,同时,其自带手写数字图片以供学习,地址如下,笔者使用的是Matlab2022a。网上已具有大量卷积神经网络的讲解,故本文不在对此赘述,这篇文章针对已了解CNN基础结构和原理者,以一个例子搭建一

机器学习——BP神经网络详细介绍及案例Python代码实现

机器学习——BP神经网络详细介绍及案例Python代码实现BP(Back Propagation)网络 也称误差反向传播,1985年由Rumelhart 和 McCelland提出