GAN生成漫画脸

GAN生成漫画脸

NeurIPS 2022-10大主题、50篇论文总结

2672篇主要论文,63场研讨会,7场受邀演讲,包括语言模型、脑启发研究、扩散模型、图神经网络……NeurIPS包含了世界级的AI研究见解,本文将对NeurIPS 2022做一个全面的总结。

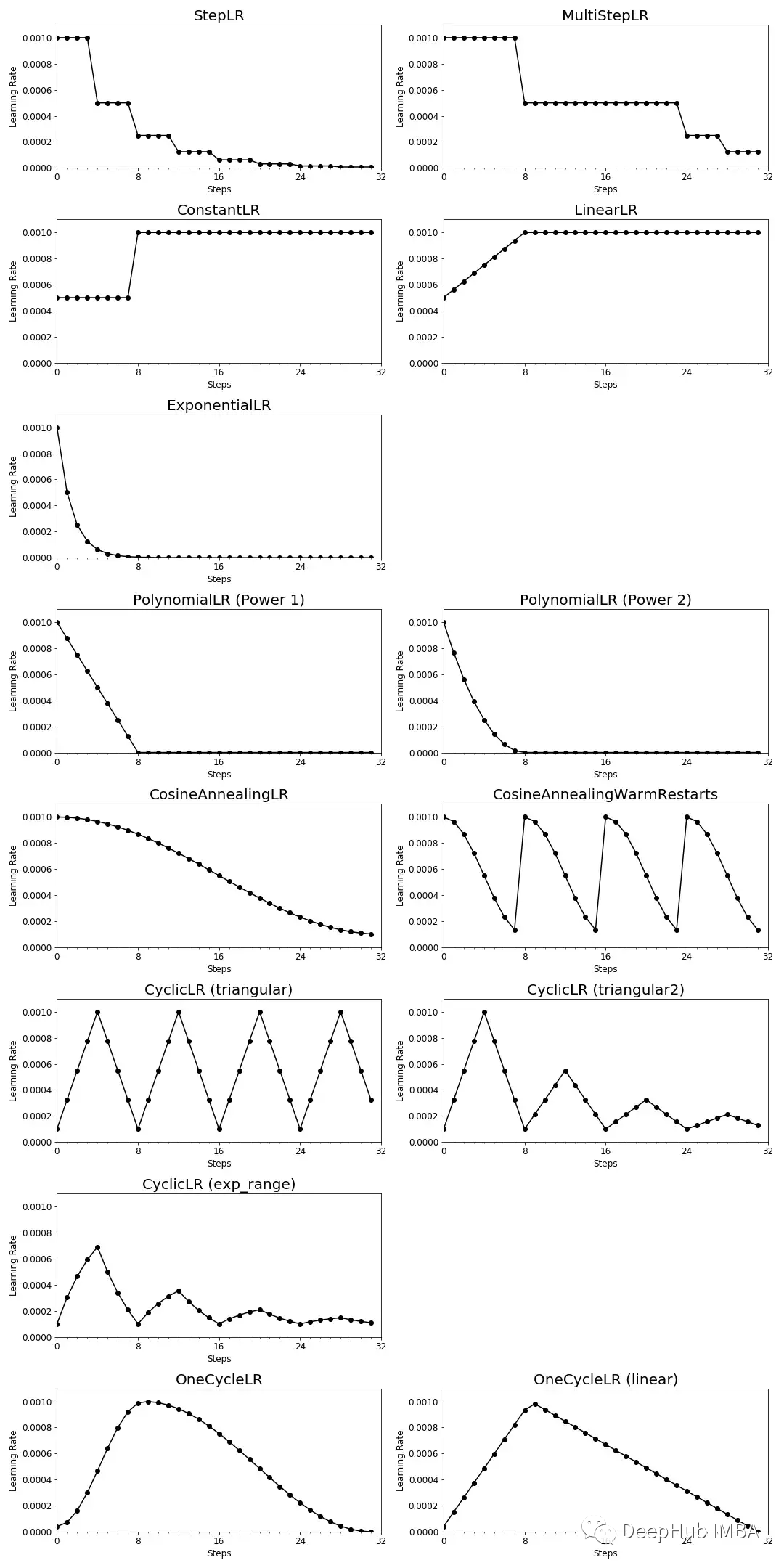

PyTorch中学习率调度器可视化介绍

学习率调度器有很多个,并且我们还可以自定义调度器。本文将介绍PyTorch中不同的预定义学习率调度器如何在训练期间调整学习率

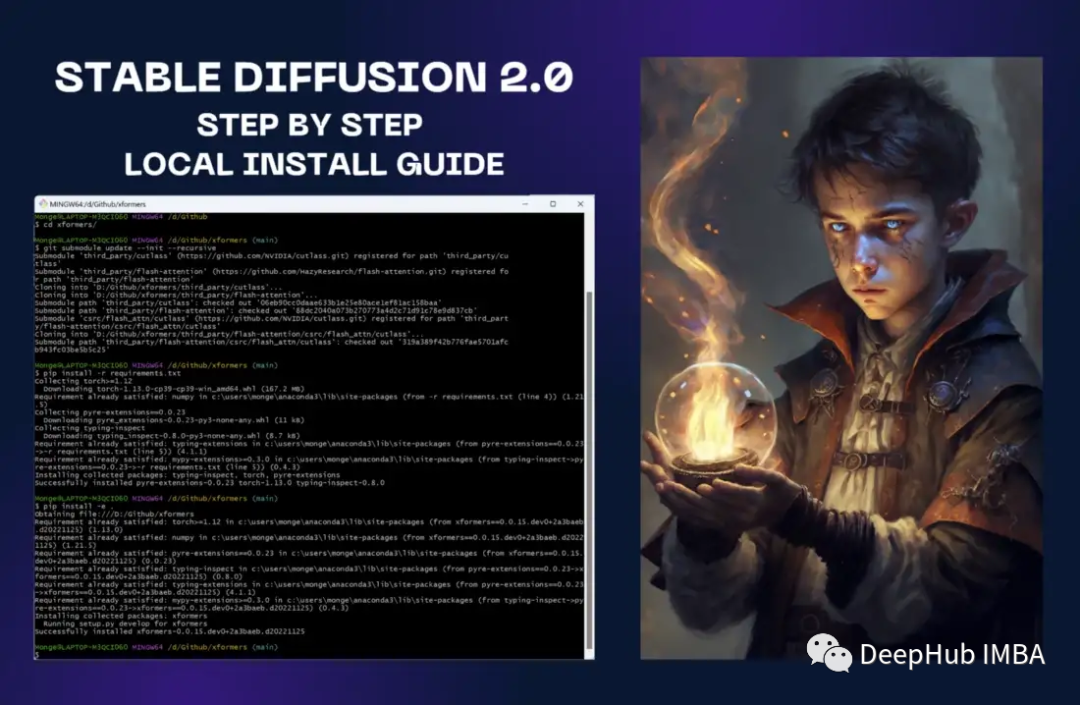

在本地PC运行 Stable Diffusion 2.0

这里我们将介绍如何在本地PC上尝试新版本

粒子群算法(PSO)优化的BP神经网络预测

BP神经网络是一种常见的多层前馈神经网络,本文通过粒子群算法(PSO)对BP神经网络的网络参数进行寻优,得到最优化的网络参数,并与未使用PSO的BP网络对同一测试样本进行预测,对比分析并突出PSO-BP的优越性。

用强化学习玩《超级马里奥》

Pytorch的一个强化的学习教程( Train a Mario-playing RL Agent)使用超级玛丽游戏来学习双Q网络(强化学习的一种类型)

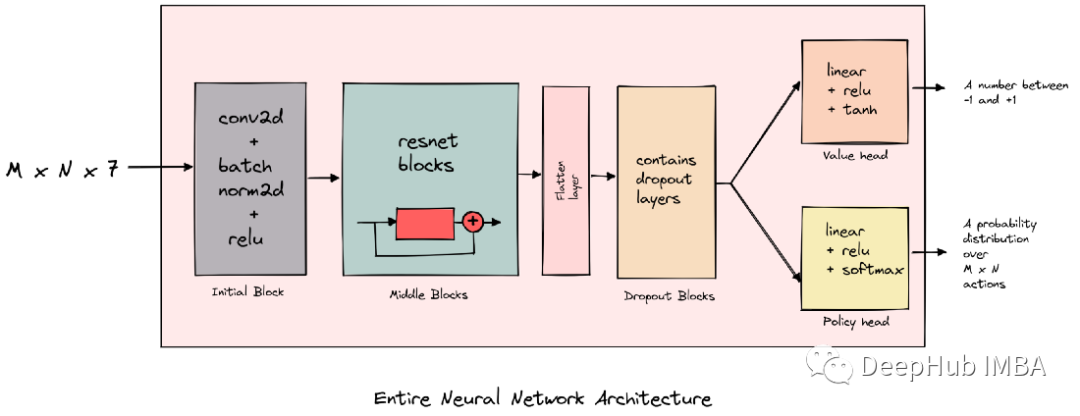

使用PyTorch实现简单的AlphaZero的算法(3):神经网络架构和自学习

神经网络架构和训练、自学习、棋盘对称性、Playout Cap Randomization,结果可视化

华为开源自研AI框架昇思MindSpore应用实践:DCGAN生成漫画头像

华为开源自研AI框架昇思MindSpore教程:DCGAN生成漫画头像

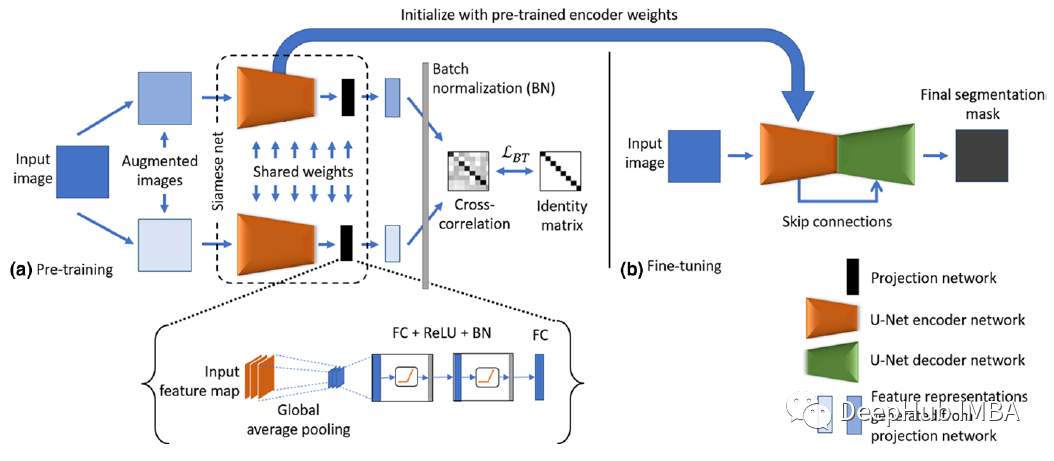

BT - Unet:生物医学图像分割的自监督学习框架

BT-Unet采用Barlow twin方法对U-Net模型的编码器进行无监督的预训练减少冗余信息,以学习数据表示。之后,对完整网络进行微调以执行实际的分割。

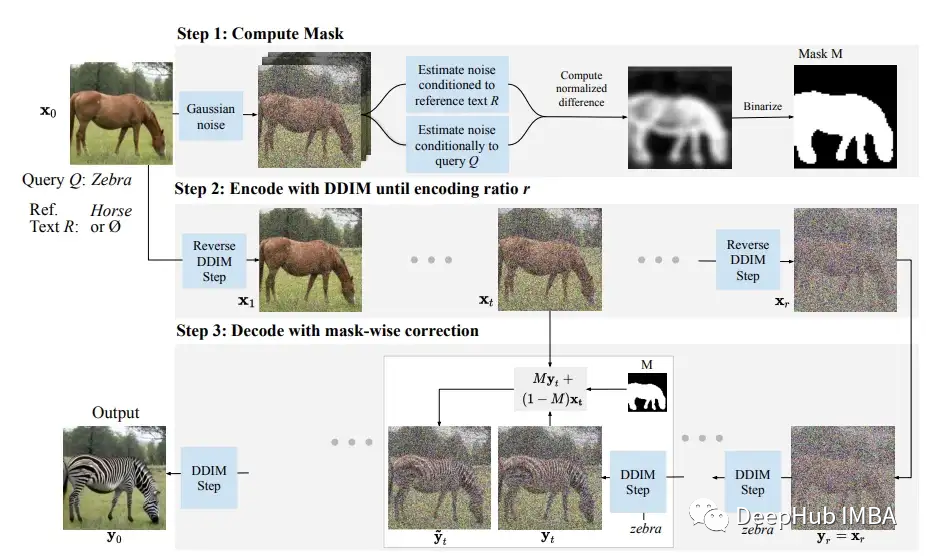

使用HuggingFace实现 DiffEdit论文的掩码引导语义图像编辑

在本文中,我们将实现Meta AI和Sorbonne Universite的研究人员最近发表的一篇名为DIFFEDIT的论文。对于那些熟悉稳定扩散过程或者想了解DiffEdit是如何工作的人来说,这篇文章将对你有所帮助。

基于BP神经网络的PID智能控制

PID控制要获得较好的控制效果,就必须通过调整好比例、积分和微分三种控制作用,形成控制量中既相互配合又相互制约的关系,这种关系不一定是简单的“线性组合”,从变化无穷的非线性组合中可以找出最佳的。神经网络所具有的任意非线性表达的能力,可以通过对系统性能的学习来实现具有最佳组合的PID控制。

从感知机到神经网络

将输入信号的总和转换为输出信号输入:输入信号的加权总和激活函数:h(a)计算得到结果可以在神经元内部中明确的显示出激活函数的激活过程激活函数是连接感知机和神经网络的桥梁函数输入大于0时,直接输出该值否则输出0。

2022年顶会、顶刊SNN相关论文----------持续更新中

2022年顶会、顶刊脉冲神经网络相关优秀论文收集

一文通俗入门·脉冲神经网络(SNN)·第三代神经网络

一文通俗入门脉冲神经网络(snn)动力学方程,前向传播过程,学习算法,脉冲编码方式

ECCV2022论文列表(中英对照)

ECCV2022论文列表(中英对照)

【ResNet】Pytorch从零构建ResNet18

Pytorch从零构建ResNet18ResNet 目前是应用很广的网络基础框架,所以有必要了解一下.本文从简单的ResNet18开始,详细分析了ResNet18的网络结构,并研究BasicBlock的结构。,使得整个结构非常清晰,再之后手工构建ResNet18网络就没有那么困难了。

【YOLO系列】YOLOv5、YOLOX、YOOv6、YOLOv7网络模型结构

YOLOv5、YOLOX、YOLOv6、YOLOv7模型结构图

超分之EDSR

这篇文章是SRResnet的升级版——EDSR,其对网络结构进行了优化(去除了BN层),省下来的空间可以用于提升模型的size来增强表现力。此外,作者提出了一种基于EDSR且适用于多缩放尺度的超分结构——MDSR。EDSR在2017年赢得了NTIRE2017超分辨率挑战赛的冠军。参考目录:①深度学习

深度学习之BP神经网络

算法是神经网络深度学习中最重要的算法之一,是一种按照误差逆向传播算法训练的多层前馈神经网络,是应用最广泛的神经网络模型之一。基本结构如图:其主要包含三部分(由左到右)1:输入层:输入数据2:隐含层:输入与输出之间的数据分析加工厂,通过各种参数(权重,偏差值)以及激活函数等其他数据处理方法与两边建立联

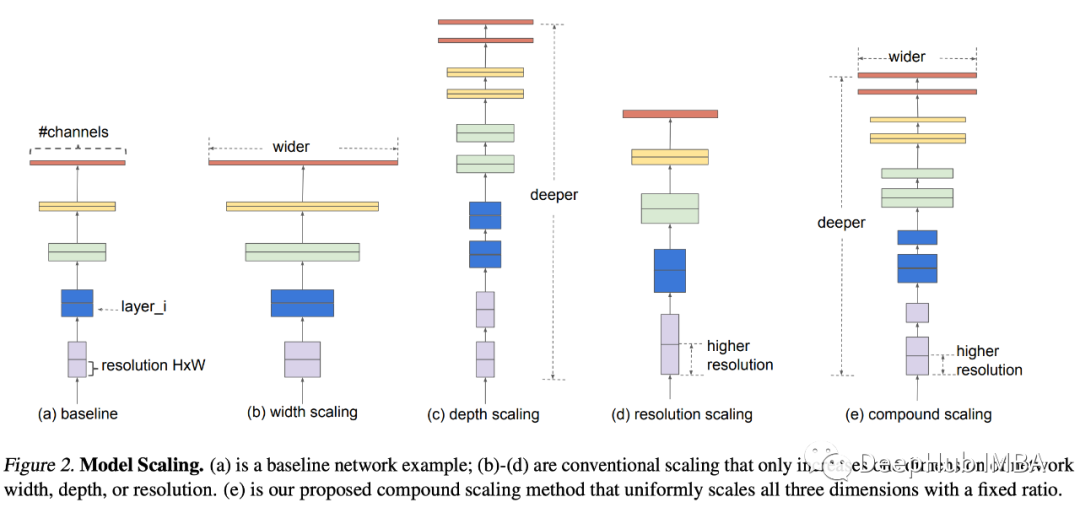

经典CNN设计演变的关键总结:从VGGNet到EfficientNet

卷积神经网络设计史上的主要里程碑:模块化、多路径、因式分解、压缩、可扩展