【使用Pytorch实现ResNet网络模型:ResNet50、ResNet101和ResNet152】

在深度学习和计算机视觉领域取得了一系列突破。尤其是随着非常深的卷积神经网络的引入,这些模型有助于在图像识别和图像分类等问题上取得最先进的结果。因此,多年来,深度学习架构变得越来越深(添加更多层)以解决越来越复杂的任务,这也有助于提高分类和识别任务的性能并使其变得健壮。但是当我们继续向神经网络添加更多

广义回归神经网络(GRNN)的实现(Python,附源码及数据集)

本文对广义回归神经网络(GRNN)的理论基础及建模步骤进行介绍,之后使用Python实现基于GRNN的数据预测,通俗易懂,适合新手学习,附源码及实验数据集。

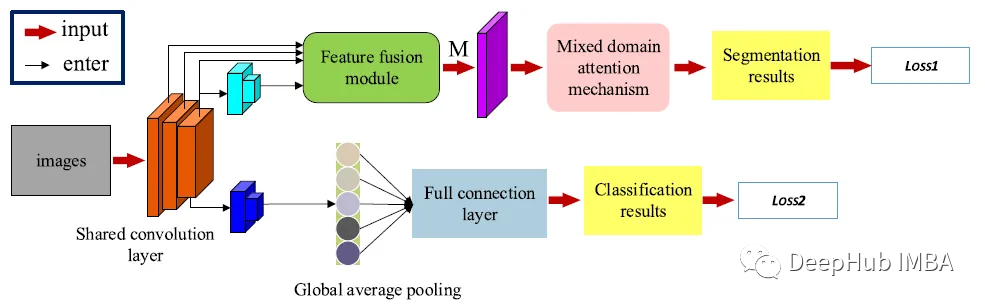

论文推荐:基于联合损失函数的多任务肿瘤分割

以FFANet为主干,加入分类的分支,将模型扩展为多任务图像分割框架,设计了用于分类和分割的联合损失函数。

基于PyTorch+CNN一维卷积实现短期电力负荷预测

本项目使用了一种基于一维卷积CNN短期电力负荷预测方法,该方法将历史负荷数据作为输入,将输入向量构造为时间序列形式作为 Conv1D 网络的输入,建模学习特征内部动态变化规律,最后完成短期负荷预测。

2022年顶会、顶刊SNN相关论文

2022年顶会、顶刊脉冲神经网络相关优秀论文收集

备战数学建模45-粒子群算法优化BP神经网络(攻坚站10)

BP神经网络主要用于预测和分类,对于大样本的数据,BP神经网络的预测效果较佳,BP神经网络包括输入层、输出层和隐含层三层,通过划分训练集和测试集可以完成模型的训练和预测,由于其简单的结构,可调整的参数多,训练算法也多,而且可操作性好,BP神经网络获得了非常广泛的应用,但是也存在着一些缺陷,例如学习收

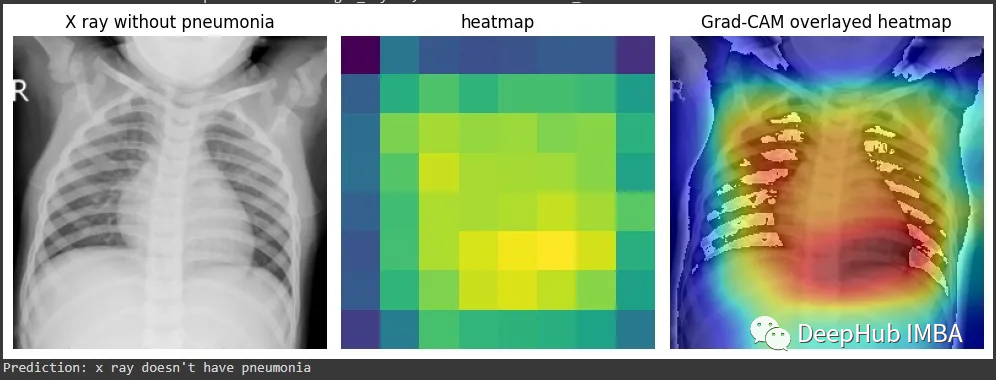

Grad-CAM的详细介绍和Pytorch代码实现

Grad-CAM (Gradient-weighted Class Activation Mapping) 是一种可视化深度神经网络中哪些部分对于预测结果贡献最大的技术。它能够定位到特定的图像区域,从而使得神经网络的决策过程更加可解释和可视化。

模糊神经网络(FNN)的实现(Python,附源码及数据集)

本文对模糊神经网络(FNN)的理论基础及建模步骤进行介绍,之后使用Python实现基于FNN的数据预测,通俗易懂,适合新手学习,附源码及实验数据集。

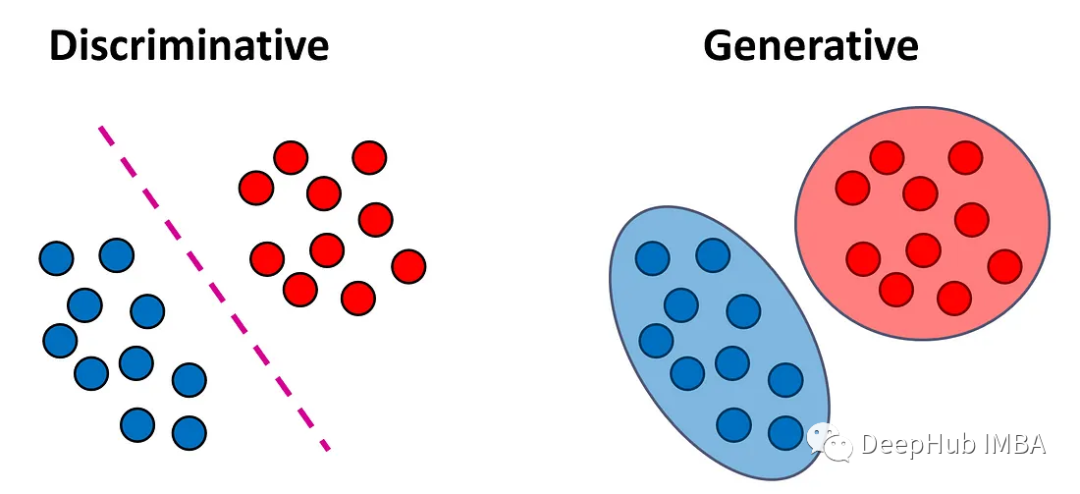

生成式模型与辨别式模型

分类模型可以分为两大类:生成式模型与辨别式模型。本文解释了这两种模型类型之间的区别,并讨论了每种方法的优缺点。

径向基神经网络(RBFNN)的实现(Python,附源码及数据集)

本文对径向基神经网络(RBFNN)的理论基础及建模步骤进行介绍,之后使用Python实现基于RBFNN的数据预测,通俗易懂,适合新手学习,附源码及实验数据集。

深度学习时间序列预测项目案例数据集介绍

高精度、可靠的风速预报是气象学家面临的挑战。由对流风暴引起的强风,造成相当大的破坏(大规模森林破坏、停电、建筑物/房屋损坏等)。雷暴、龙卷风以及大冰雹、强风等对流事件是有可能扰乱日常生活的自然灾害,特别是在有利于对流启动的复杂地形上。即使是普通的对流事件也会产生强风,造成致命和昂贵的损失。因此,风速

GoogLeNet详解

目录一、GoogLeNet网络的背景二、GooLeNet网络结构三、GooLeNet的亮点四、GooLeNet代码实现一、GoogLeNet网络的背景想要更好的预测效果,就要从网络深度和网络宽度两个角度出发增加网络的复杂度。但这个思路有两个较为明显的问题:首先,更复杂的网络意味着更多的参数,也很容

吴恩达《深度学习》笔记汇总

第一门课:神经网络和深度学习(第一周)——深度学习引言第一门课:神经网络和深度学习(第二周)——神经网络的编程基础第一门课:神经网络和深度学习(第三周)——浅层神经网络第一门课:神经网络和深度学习(第四周)——深层神经网络第二门课:改善深层神经网络:超参数调试、正则化以及优化(第一周)——深度学习的

PyTorch 深度学习实战 | DIEN 模拟兴趣演化的序列网络

DIEN 模拟兴趣演化的序列网络

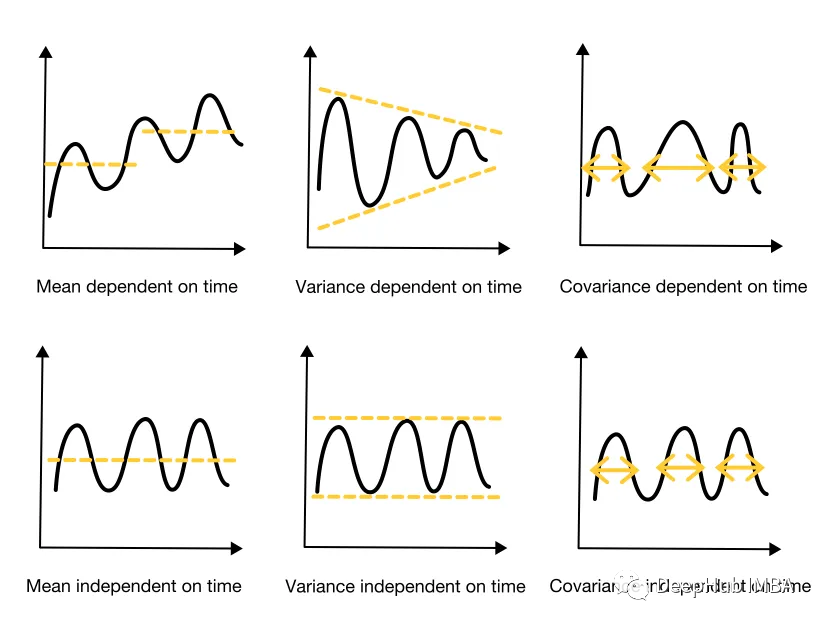

时间序列的平稳性

如何检查时间序列是否平稳,如果它是非平稳的,我们可以怎么处理

Diffusion-GAN: Training GANs with Diffusion 解读

Diffusion-GAN: Training GANs with Diffusion 解读

Cursor太强了,从零开始写ChatGLM大模型的微调代码

初试基于chatgpt4的写代码神器

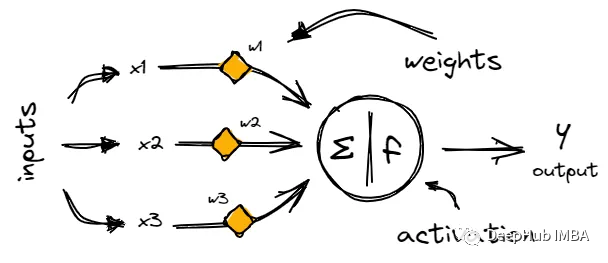

神经网络初学者的激活函数指南

如果你刚刚开始学习神经网络,激活函数的原理一开始可能很难理解。但是如果你想开发强大的神经网络,理解它们是很重要的。

物理信息神经网络PINNs : Physics Informed Neural Networks 详解

本博客主要分为两部分:1、PINN模型论文解读2、PINN模型相关总结一、PINN模型论文解读1、摘要:基于物理信息的神经网络(Physics-informed Neural Network, 简称PINN),是一类用于解决有监督学习任务的神经网络,同时尊重由一般非线性偏微分方程描述的任何给定的物理

BP神经网络python代码详细解答(来自原文)

翻译如下 ** &#160; &#160; &#160; &#160; <font color=black size=6.5> 在 SCRATCH采用pyt...