遗传算法(GA)优化的BP神经网络实现回归预测——附代码

遗传算法(GeneticAlgorithm,GA)的理论是根据达尔文进化论而设计出来的算法,大体意思是生物是朝着好的方向进化的,在进化的过程中会自动选择优良基因淘汰劣等基因。但是需要说明的是这种随机化操作选择操作方法和传统的随机搜索方法是不同的,GA进行的是高效有向的搜索而一般的随机搜索每次操作都是

【神经网络】GRU

GRU(Gate Recurrent Unit)门控循环单元,是循环神经网络(RNN)的变种种,与LSTM类似通过门控单元解决RNN中不能长期记忆和反向传播中的梯度等问题。与LSTM相比,GRU内部的网络架构较为简单。

送药小车集训总结

2021年电赛国赛F题,使用K210运行Tinyyolov2神经网络进行数字识别

从零构建自己的神经网络————数据集篇

例如,可以将图片文件命名为1.jpg,2.jpg,3.jpg等,对应的标注文件命名为1.txt,2.txt,3.txt等。其中,txt_path是包含数据集信息的文本文件的路径,transform是对数据集进行预处理的函数或变换。每张图片都有一个唯一的标识符(比如图片的文件名或者数据库中的id),在

AI大模型的神经网络模型量化技术:INT8 还是 INT4 ?

如果要量化的目的是实现硬件加速,则应首选确定性量化,因为可以预先指定适当的量化级别,以便在专用硬件上运行量化网络,对硬件的性能预期得到改善。QAT量化方法在付出重新训练的代价后,采用INT4的量化模型应用场合会较大,但稳定性还是需要大量的实验验证,尤其是安全性要求很高的自动驾驶领域,大家不得不慎重考

【AI底层逻辑】——篇章6:人工神经网络(深度学习算法)

任何一项技术的发展都不会一帆风顺,深度学习的发展也经历了“三起两落”!①第一代神经网络——单层感知器(MP)模型,感知器模型实际就是将神经元模型中的激活函数作为符号函数,写成向量形式,即它简洁且功能强大,可以实现自我迭代,只要有足够数量的样本,感知器模型就能找到一组合适的权重。但存在一个致命缺陷——

卷积神经网络识别人脸项目—使用百度飞桨ai计算

卷积神经网络,识别人脸或者其他图片,使用百度飞桨aiGPU计算

验证集精度来回震荡是什么原因,怎么解决

验证集精度来回震荡是什么原因,怎么解决

BP神经网络入门(原理+matlab代码实现)

对于很多刚入门的小伙伴来说,神经网络可能比较陌生。神经网络其实是对人认知物体的一种仿真。比如幼儿园老师再教小朋友认动物的时候,会让记住一些特征:比如兔子有长长的耳朵,爱吃萝卜和青菜.........,神经网络也是这样通过构建特征值之间的关系来预测一个较为可靠的结果,更值得一提的是BP神经网络因为有隐

YOLOV5的FPS计算问题

pre-process:图像预处理时间,包括图像保持长宽比缩放和padding填充,通道变换(HWC->CHW)和升维处理等;inference:推理速度,指预处理之后的图像输入模型到模型输出结果的时间;NMS :你可以理解为后处理时间,对模型输出结果经行转换等;data换为自己的数据集对应的yam

重新理解一个类中的forward()和__init__()函数

return out在上面的代码中,我们定义了一个名为SimpleNet的神经网络模型,它继承自 PyTorch 中的nn.Module类。我们在__init__()方法中定义了三层网络结构,分别是输入层fc1、激活层relu和输出层fc2。其中,输入层和输出层都使用了全连接层(nn.Linear)

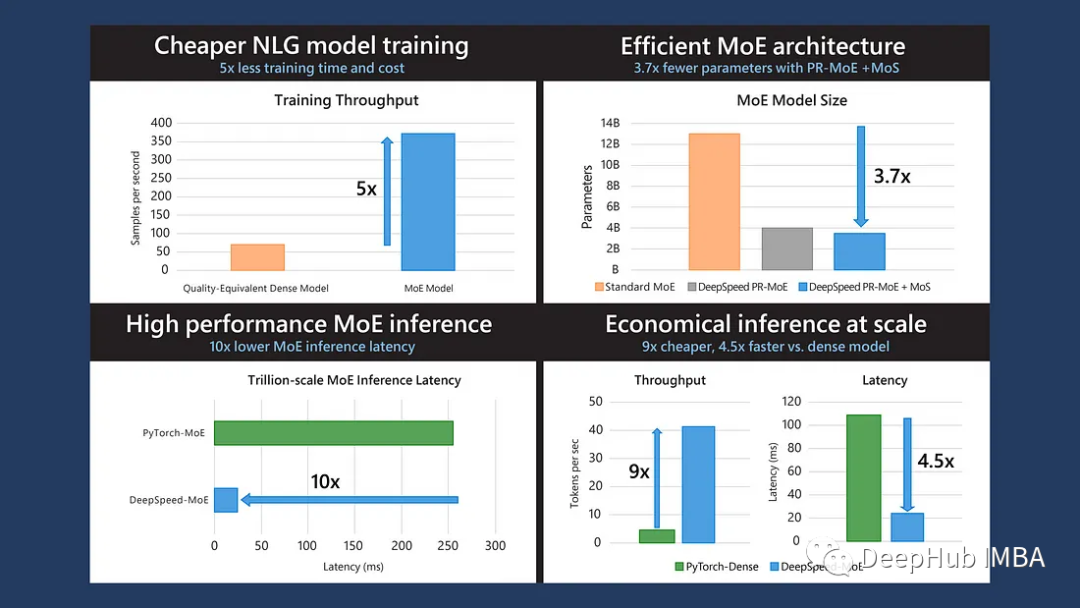

DeepSpeed-MoE:训练更大及更复杂的混合专家网络

这是微软发布在**2022 ICML**的论文,MoE可以降低训练成本,但是快速的MoE模型推理仍然是一个未解决的问题。所以论文提出了一个端到端的MoE训练和推理解决方案DeepSpeed-MoE:它包括新颖的MoE架构设计和模型压缩技术,可将MoE模型大小减少3.7倍;

Litmaps最新论文检索神器

最近有小伙伴私信我如何找到自己研究领域的相关论文,因为论文太多了,不知道如何找到优质的或者适合自己阅读的,然后我给大家推荐个论文检索工具 Citation Gecko ,但是这个网站好像不再维护了,但是不影响使用。

BP神经网络(Python代码实现)基于pytorch

BP神经网络(Python代码实现)基于pytorch

【神经网络绘制工具】PlotNeuralNet详解

PlotNeuralNet库是用于绘制神经网络的工具库,其绘制的神经网络较为干净整洁,比较适合用于科研论文写作插图。笔者整理了有关该库的使用方法,希望帮助更多朋友能够借助这个库绘制出更多优美的神经网络,在科研道路上能够更加顺利~

【高效炼丹】指数移动平均(EMA):深度学习中的神器

EMA的本质是对历史数据进行加权平均,其中每个数据点的权重随着它距离当前时间点的远近而不断减小。这样做的好处是可以有效地平滑时间序列数据,使其更加连续和稳定。在深度学习中,EMA被广泛应用于优化器的更新、模型参数的平均等方面,可以帮助提高模型的性能和泛化能力。同时,由于EMA的计算方式简单且易于实现

人工智能-神经网络

n)取值0或1,分别表示该神经元的抑制和兴奋,每个神经元的状态都受其他神经元的制约,单个的感知器(也叫单感知机)就构成了一个简单的模型(MP模型),但在现实世界中,实际的决策模型则要复杂得多,往往是由多个感知器组成的多层网络,如下图所示,这也是经典的神经网络模型(也叫多感知机,也叫人工神经网络),由

在自定义数据集上微调Alpaca和LLaMA

本文将介绍使用LoRa在本地机器上微调Alpaca和LLaMA

Pytorch激活函数最全汇总

为了更清晰地学习Pytorch中的激活函数,并对比它们之间的不同,这里对最新版本的Pytorch中的激活函数进行了汇总,主要介绍激活函数的公式、图像以及使用方法,具体细节可查看官方文档。

WGAN-gp模型——pytorch实现

【代码】WGAN-gp模型——pytorch实现。