7.卷积和Transformer结合的ViT

前面两节课我们讲了Swin Transformer的结构,以及其中的细节部分,进行了实现,其中由Swin Block 以及 Patch Merging等等,上节课讲了 SW-MSA的shift和mask,对于shift之后,其中window中需要的保留,不需要的去掉,用到了boardcasting等

下载及安装NCCL教程

nccl下载安装参考。

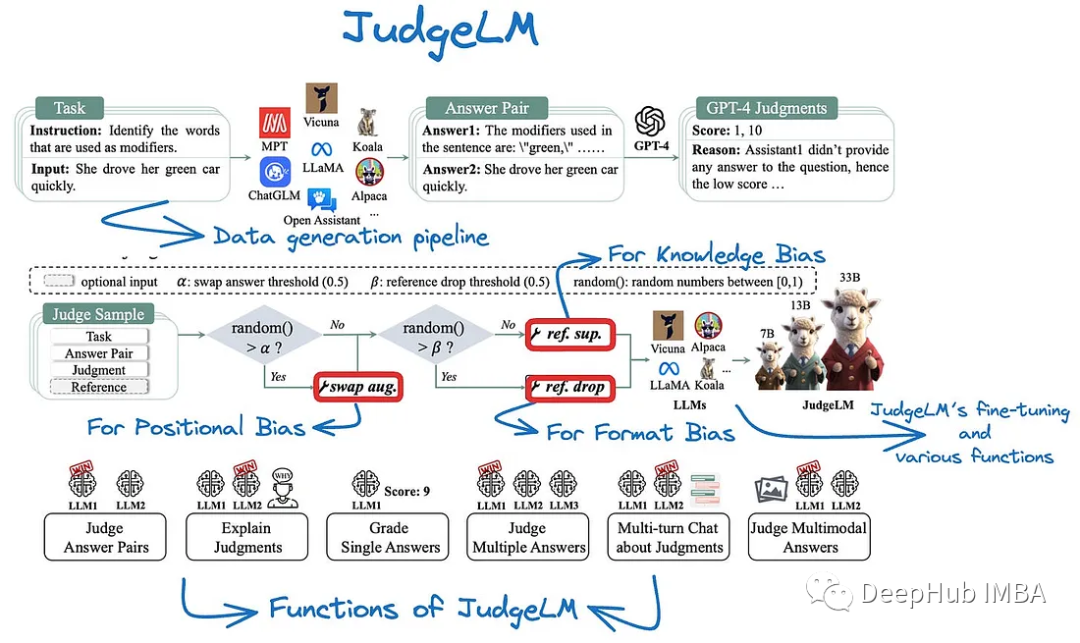

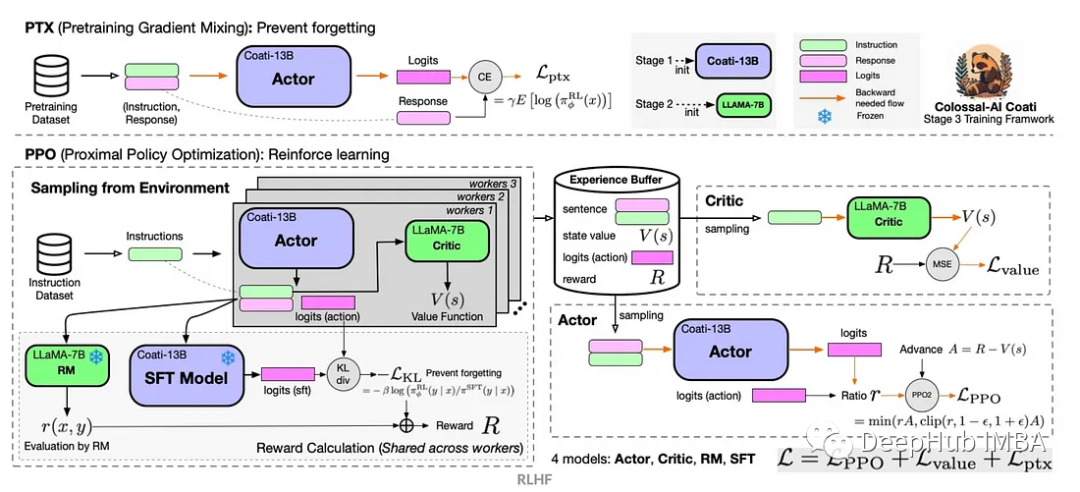

10月发布的5篇人工智能论文推荐

10月发布的5篇人工智能论文推荐

Tensorflow实现训练数据的加载—模型搭建训练保存—模型调用和加载全流程

在Tensorflow深度学习框架下,实现从模型训练数据的加载—模型训练保存—模型调用和加载。

深入了解 Hugging Face 中的生成工具:Generate方法

自然语言生成是自然语言处理领域的一个热门研究方向。Hugging Face 是当前最为流行的自然语言处理库之一,其在自然语言生成领域也提供了一系列实用的工具,以便开发者能够更方便地构建、训练和部署自然语言生成模型。本文将深入介绍 Hugging Face 中的生成工具,涵盖其原理、实现细节以及如何使

卷积核的尺寸、数量、通道数

torch.squeeze() 这个函数主要对数据的维度进行压缩,去掉维数为1的的维度,比如是一行或者一列这种,一个一行三列(1,3)的数去掉第一个维数为一的维度之后就变成(3)行。还有一种形式就是b=torch.squeeze(a,N) a就是在a中指定位置N加上一个维数为1的维度。给指定位置加上

Pytorch版Mask-RCNN图像分割实战(自定义数据集)

Mask R-CNN是一种广泛应用于目标检测和图像分割任务的深度学习模型,它是由Faster R-CNN(一种快速目标检测模型)和Mask R-CNN(一种实例分割模型)组成的。Mask R-CNN将Faster R-CNN中的RPN和RoI Pooling层替换成了RPN和RoI Align层,以

pytorch中nn.ModuleList()使用方法

我们可以将我们需要的层放入到一个集合中,然后将这个集合作为参数传入nn.ModuleList中,但是这个子类并不可以直接使用,因为这个子类并没有实现forward函数,所以要使用还需要放在继承了nn.Module的模型中进行使用。

深度学习——残差网络(ResNet)

残差的思想都是去掉相同的主体部分,从而突出微小的变化。

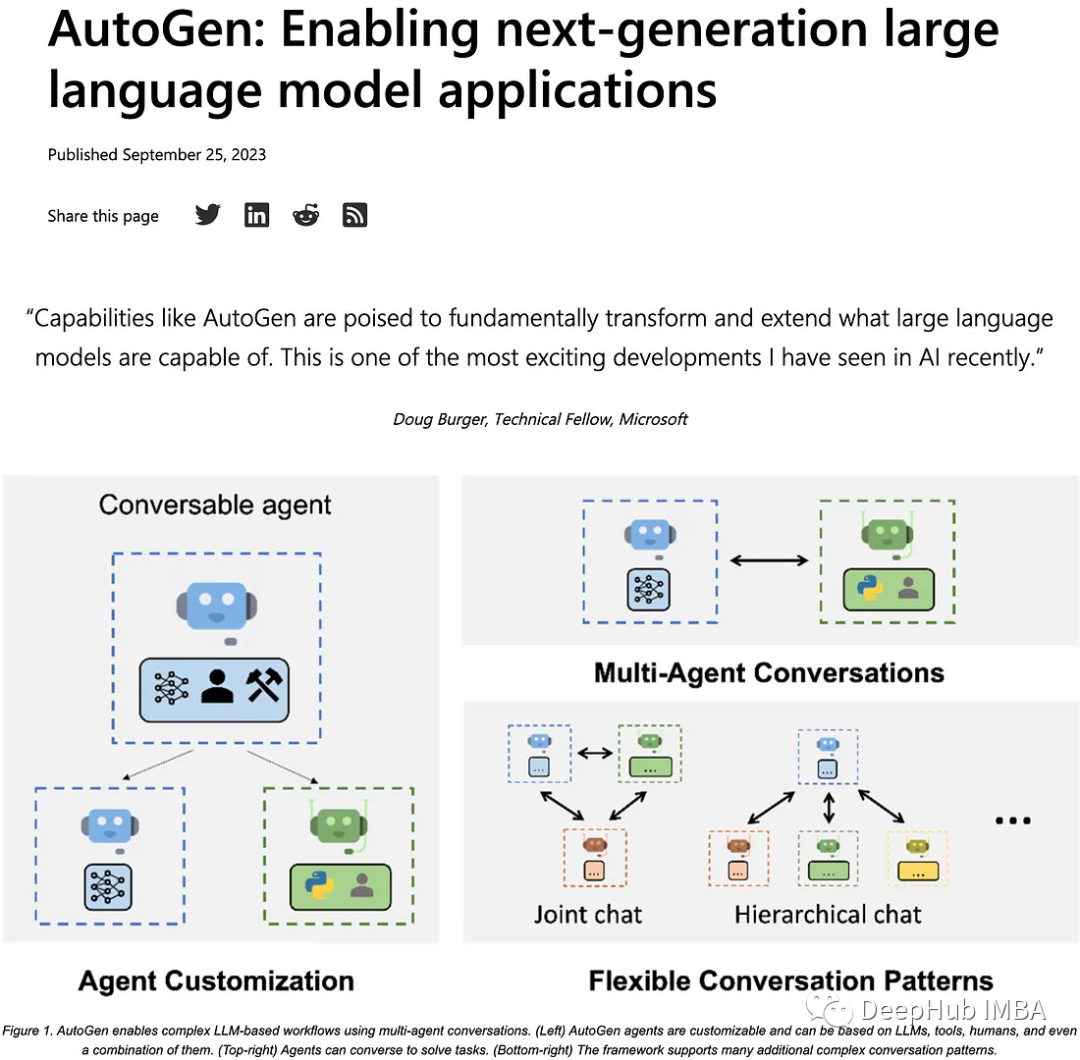

AutoGen完整教程和加载本地LLM示例

Autogen是一个卓越的人工智能系统,它可以创建多个人工智能代理,这些代理能够协作完成任务,包括自动生成代码,并有效地执行任务。

【深度学习】使用ffmpg及gstreamer进行视频拉流及编解码(一):ffmpg

GStreamer:一款功能强大的多媒体框架,可以用于音视频的采集、编码、解码、处理和传输。FFmpeg:一个开源的音视频处理工具,可以用于音视频的采集、编码、解码、转码、处理等。FFmpeg和GStreamer都是流媒体处理框架,它们在音视频编解码、转码、过滤、采集等方面都有广泛的应用。FFmpe

如何在kaggle上保存、加载文件,同时在output上删除已经保存的文件。

在kaggle的notebook下操作output,用torch对文件进行操作

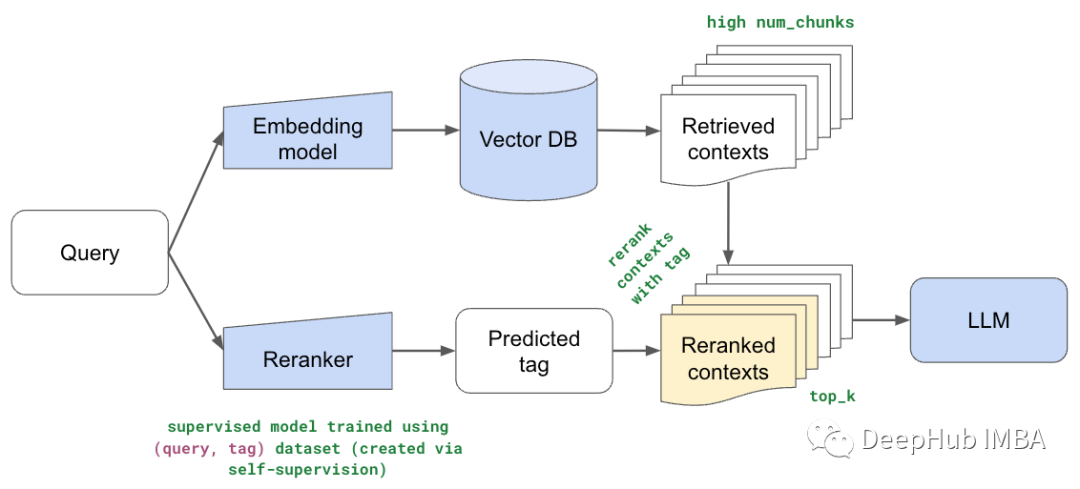

使用Llama index构建多代理 RAG

检索增强生成(RAG)已成为增强大型语言模型(LLM)能力的一种强大技术。通过从知识来源中检索相关信息并将其纳入提示,RAG为LLM提供了有用的上下文,以产生基于事实的输出。

最简单Anaconda+PyTorch深度学习环境配置教程

Anaconda,中文大蟒蛇,是一个开源的Python发行版本,其包含了conda、Python等180多个科学包及其依赖项。安装它可以方便我们后续进行conda环境管理器下的命令生成和跑各自深度学习模型。CUDA(Compute Unified Device Architecture),是显卡厂商

卷积神经网络CNN的经典模型

主要介绍卷积神经网络CNN的发展史,并详细剖析了经典网络模型的架构。

【人工智能】大模型的发展历史

2012年以后的深度学习热潮:2012年,AlexNet横空出世,以卷积神经网络(CNN)为代表的深度学习模型在计算机视觉任务中取得了巨大突破,吸引了越来越多的计算机科学家和工程师投入深度学习研究和应用。:2018年,Google推出了基于Transformer的预训练模型BERT,通过大量无标签文

【深度学习】自监督学习详解(self-supervised learning)

详解!自监督学习:对比学习和生成学习。

使用Panda-Gym的机器臂模拟进行Deep Q-learning强化学习

强化学习(RL)是一种机器学习方法,它允许代理通过试错来学习如何在环境中表现。行为主体因采取行动导致预期结果而获得奖励,因采取行动导致预期结果而受到惩罚。随着时间的推移,代理学会采取行动,使其预期回报最大化。

CTC-Loss

CTC-Loss

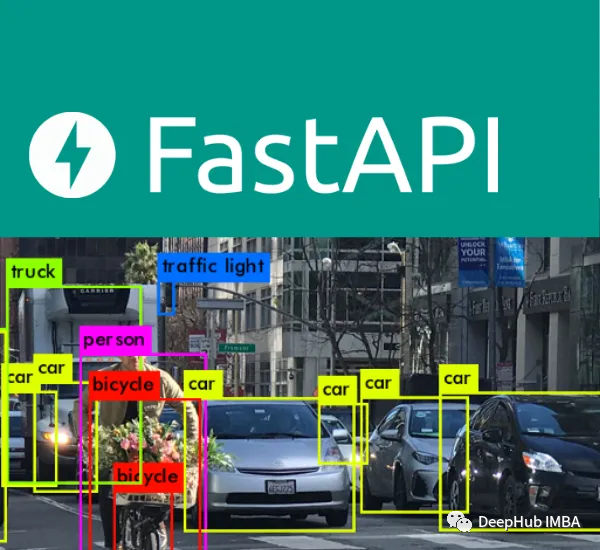

使用FastAPI部署Ultralytics YOLOv5模型

在本文中,我们将介绍如何使用FastAPI的集成YOLOv5,这样我们可以将YOLOv5做为API对外提供服务。