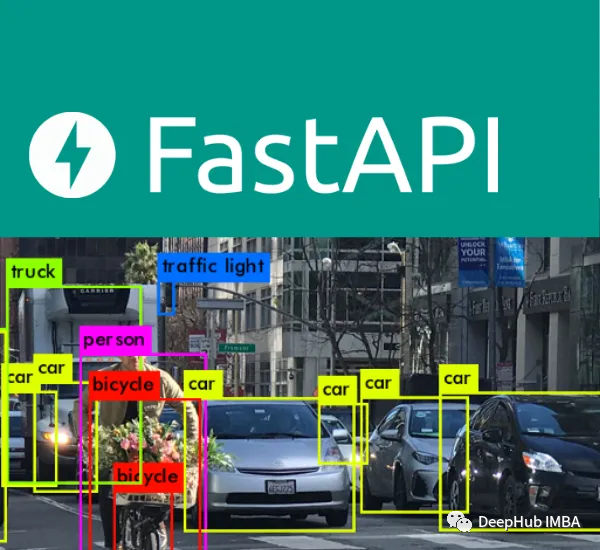

使用FastAPI部署Ultralytics YOLOv5模型

在本文中,我们将介绍如何使用FastAPI的集成YOLOv5,这样我们可以将YOLOv5做为API对外提供服务。

基于ChatGPT实现AI软件研发 | 神经网络 | 数据

这是一本讲解以ChatGPT/GPT-4为代表的大模型如何为软件研发全生命周期赋能的实战性著作。它以软件研发全生命周期为主线,详细讲解了ChatGPT/GPT-4在软件产品的需求分析、架构设计、技术栈选择、高层设计、数据库设计、UI/UX 设计、后端应用开发、Web 前端开发、软件测试、系统运维、技

深度学习中训练时经常碰到的train、val、test有啥区别?

train是训练集,val是训练过程中的测试集,是为了让你在边训练边看到训练的结果,及时判断学习状态。test就是训练模型结束后,用于评价模型结果的测试集。只有train就可以训练,val不是必须的,比例也可以设置很小。test对于model训练也不是必须的,但是一般都要预留一些用来检测,通常推荐比

基于深度学习的图像分割

摘要遥感图像分割是利用遥感技术获取的高分辨率图像进行像素级别的分类,将图像中的不同物体或不同地物提取出来的过程。这个过程对于遥感应用具有重要意义,因为它能够提取出地物和地表特征,如河流、道路、建筑、植被、水体等,并且这些特征是地面实际存在的。图像分割可以为地面覆盖分类、土地利用覆盖变化分析、城市规划

【1】深度学习之Pytorch——张量(tensor)的尺寸、储存偏移及步长等基本概念

这和我们python里面的numpy差不多的,多维数组如何索引,以及相关的概念,如果拥有线性代数的基础,你可以知道什么叫做矩阵,以及这一系列的相关操作,就可以理解这些概念。最开始的张量我们可以看到它是一个,一个数组里面包含2个数组,而这个单独的2个数组里面又包含3个蛋到户的数,那么现在互换维度就是,

图像风格迁移基础入门及实践案例总结

目录1图像的不同风格2何为图像风格迁移2.1基础概念及方法2.2示例3图像风格迁移的典型研究成果3.1deep-photo-styletransfer3.2CycleGAN3.3U-GAT-IT4风格迁移演进趋势5.使用训练好的模型来生成图像5.1环境5.2模型下载5.3使用训练好的模型6.训练一个

注意力机制详解

将attentionj机制全部都将其研究透彻,好好研究一下。

强化学习PPO从理论到代码详解(1)--- 策略梯度Policy gradient

笔者在强化学习的道路上看来很多书,看了很多代码,和很多大佬的博客,只是很多都是侧重一个方面,所以我在吸取百家之长后,决定完完整整的写一回PPO从算法理论到逐行代码手敲和详解的文章。

Pytorch使用Grad-CAM绘制热力图

使用grad_cam对不同预测目标的图像做activate图。需要模型feature的最后一层,模型训练权重。使用的是自己训练的MobileNetV2。原理与代码学习自B站。

Swin-Transformer 详解

用动画深入解释Swin-Transformer

安装anaconda3,并搭建一个python3.10开发环境【AI深度学习环境搭建】

完成上面操作之后你的目录 C:\Users\<你的电脑名字> 下就会生成配置文件.condarc,我的电脑中的这个文件位置是:C:\Users\Administrator\.condarc 然后用记事本把这个文件打开,手动删除-defaults,并把https换成http即可。conda activ

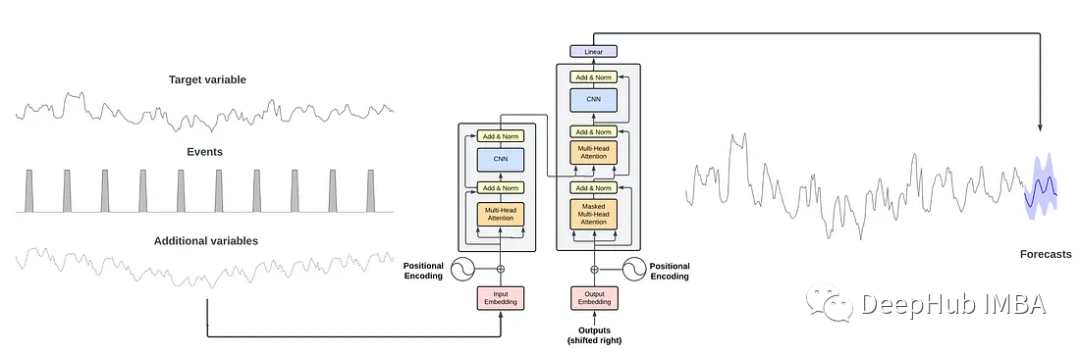

TimeGPT:时间序列预测的第一个基础模型

在本文中,我们将探索TimeGPT背后的体系结构以及如何训练模型。然后,我们将其应用于预测项目中,以评估其与其他最先进的方法(如N-BEATS, N-HiTS和PatchTST)的性能。

【深度学习】上采样,下采样,卷积

下采样的过程是一个信息损失的过程,而池化层是不可学习的,用stride为2的可学习卷积层来代替pooling可以得到更好的效果,当然同时也增加了一定的计算量。来讲,上采样和下采样的结构往往是对称的,我们可以在下采样做Max Pooling的时候记录下来最大值所在的位置,当做上采样的时候把最大值还原到

神经网络的发展历史

论文中提出了人工神经网络的概念,并给出了人工神经元的数学模型,从而开创了人工神经网络研究的时代。

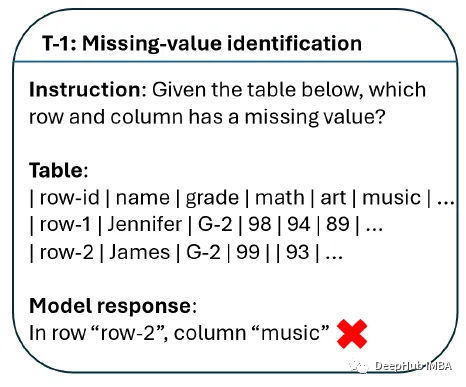

Table-GPT:让大语言模型理解表格数据

在这篇文章中,我们将介绍微软发表的一篇研究论文,“Table-GPT: Table- tuning GPT for Diverse Table Tasks”,研究人员介绍了Table-GPT

深度学习面试问题与答案(2023)

深度学习热门面试题。

人工智能基础部分11-图像识别实战(网络层联想记忆,代码解读)

大家好,我叫微学AI,今天给大家带来图像识别实战项目。图像识别实战是一个实际应用项目,下面介绍如何使用深度学习技术来识别和检测图像中的物体。主要涉及计算机视觉,实时图像处理和相关的深度学习算法。学习者将学习如何训练和使用深度学习模型来识别和检测图像中的物体,以及如何使用实时图像处理技术来处理图像。项

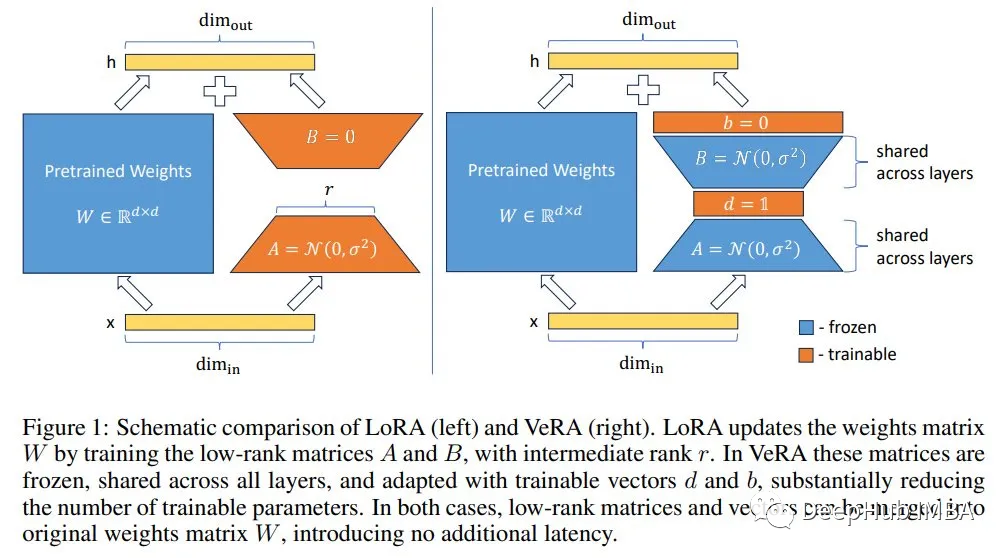

VeRA: 性能相当,但参数却比LoRA少10倍

VeRA在LoRA冻结的低秩张量上添加可训练向量,只训练添加的向量。论文中显示的大多数实验中,VeRA训练的参数比原始LoRA少10倍。

Multimodal Sentiment Analysis论文汇总

多模态情绪分析论文汇总

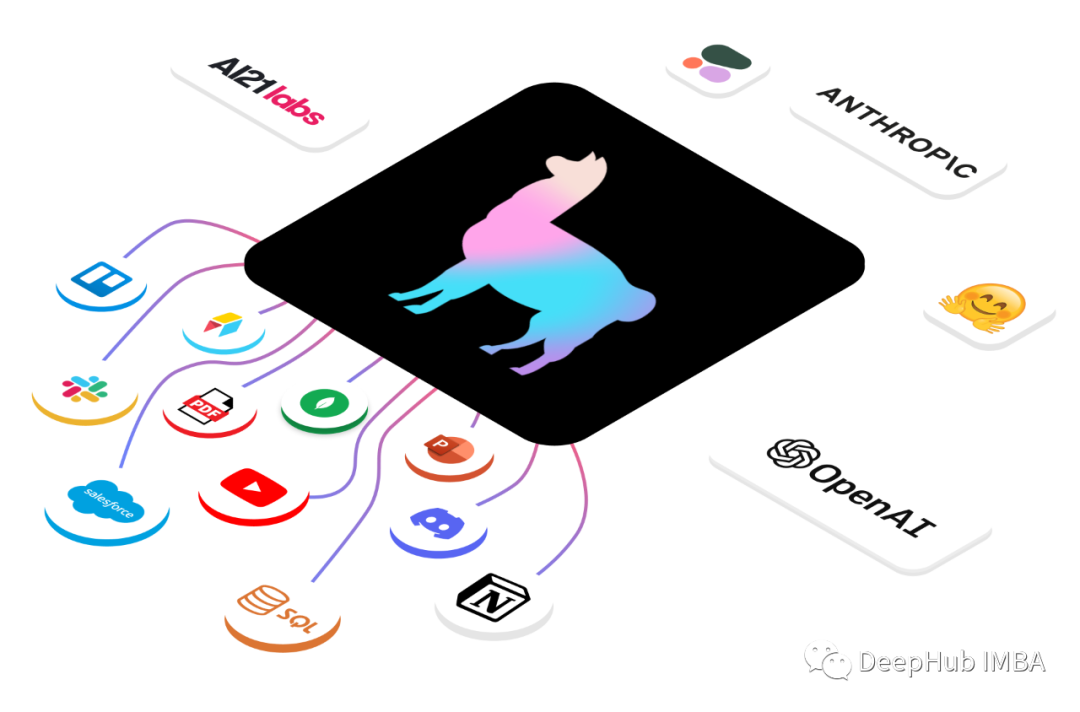

LlamaIndex使用指南

LlamaIndex是一个方便的工具,它充当自定义数据和大型语言模型(llm)(如GPT-4)之间的桥梁,大型语言模型模型功能强大,能够理解类似人类的文本