增加sklearn逻辑回归拟合能力的解决方案

本文主要介绍了增加sklearn逻辑回归拟合能力的解决方案,希望对新手有所帮助。文章目录1. 问题描述2. 解决方案 2.1 不建议的解决方案 2.2 推荐的解决方案

基于opencv的人脸检测

这篇文章,让你用短短的16行代码基于opencv检测一张图片上的人脸,很有意思,快快学起来吧!

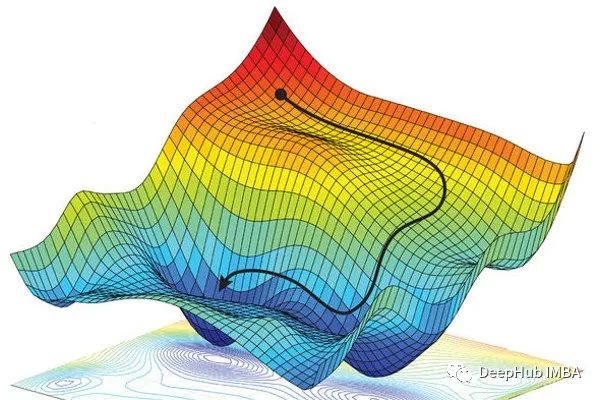

训练深度学习神经网络的常用5个损失函数

损失函数的选择与神经网络模型从示例中学习的特定预测建模问题(例如分类或回归)有关。在本文中我们将介绍常用的一些损失函数

《计算机视觉技术与应用》-----第四章 图像变换

第四章 图像变换

改进YOLOv5 | GSConv+Slim-neck 减轻模型的复杂度同时提升精度 | 附4套改进方式模板

GSConv+Slim-Neck助力YOLOv5涨点

【自然语言处理(NLP)】基于序列到序列的中-英机器翻译

【自然语言处理(NLP)】基于序列到序列的中-英机器翻译,基于百度飞桨开发,参考于《自然语言处理实践》所作。

基于粒子群优化深度置信网络的分类预测

基于粒子群优化深度置信网络的分类预测

你就想这样一辈子躺平,还是改变这个世界?

武林高手将自己毕生绝学刻在山洞里,几百年后,一个年轻人路过,学了山洞里的绝学,横空出世成为武林中一位高手。绝顶聪明的商人自己写一本书,将自己毕生的智慧和经验都总结在书里面。通过出版社将书卖到全世界,每个购买书的年轻人,看了那本书都有不少收获。其中还有不少人受到启发,总结成自己一套体系理论,横空出世成

OpenCV实战案例——车道线识别

方法:在图像中,黑色表示0,白色为1,那么要保留矩形内的白色线,就使用逻辑与,当然前提是图像矩形外也是0,那么就采用创建一个全0图像,然后在矩形内全1,之后与之前的canny图像进行与操作,即可得到需要的车道线边缘。TIPs:使用霍夫变换需要将图像先二值化。

使用基于注意力的编码器-解码器实现医学图像描述

使用计算机视觉和自然语言处理来为X 射线的图像生成文本描述。

Python通过二维数组制作单通道8位的索引图片

通过二维数组来生成单通道的索引图片,对生成的索引图片自己配置颜色,配置颜色的时候颜色表的数量如果小于17会使生成的图片位深度不是8。

python 矩阵运算

python 矩阵运算

自然语言处理之入门必学案例100例

自然语言处理之入门必学案例100例nlp自然语言处理之入门必学案例100例nlp自然语言处理之入门必学案例100例

Pytorch实战 | 第4天:猴痘病识别

本文为内部限免文章参考本文所写记录性文章,请在文章开头注明以下内容,复制粘贴即可本周的代码相对于上周增加指定图片预测与保存并加载模型这个两个模块,在学习这个两知识点后,时间有余的同学请自由探索更佳的模型结构以提升模型是识别准确率,模型的搭建是深度学习程度的重点。DL+45。

微信版大语言模型来了:跨时空对话李白、教你高情商说话,API在线试玩全都有...

鱼羊 梦晨 发自 凹非寺量子位 | 公众号 QbitAI大规模语言模型,微信版,来了!并且甫一登场,就没藏着掖着:论文、API接口、在线试玩网站……一条龙全都齐备。续写文本、阅读理解等常规任务就不说了,这个名叫WeLM的AI,竟然直接让我和李白跨时空聊起了杜甫:我:现在有一首关于你的歌,其中一句歌词

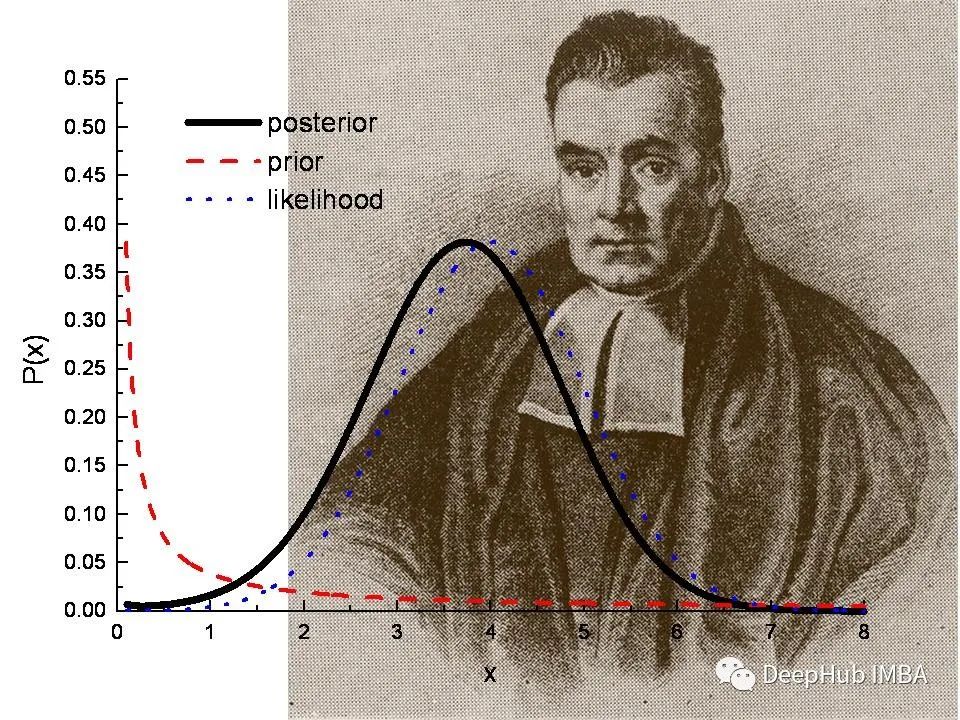

我们能从后验分布中学到什么?贝叶斯后验的频率解释

假设我们从未知分布 q 中观察到 N 个独立且同分布的 (iid) 样本 X = (x1, ... , xN)。统计学中的一个典型问题是“样本集 X 能告诉我们关于分布 q 的什么信息?”。

计算机科学每日分享

金融学生学习计算机科学的每日分享。

22下半年:来长沙建第二支团队,与所读的30本书(含20本哲学书单/笔记)

自从之前写了这三篇文章:《我的求学十年(00至10)》、《我的十年青春(10至20)》、《20 21九死一生、22上半年读20本书》之后,我便决心每隔半年便把过程中的创业历程与读书笔记记录下来,一为不断反思,二 也为自己的人生做个见证,见证自己始终在不断的创造价值、造福社会、推动社会,也算不枉此生。

基于导频的信道估计实现

这是我研一通信系统仿真的专题答辩内容,就是当做笔记记录的,如果有内容上的错误请及时私信我,我会做出修改的,本文代码是可以用的,自己要多调试调试。

文本生成图像工作简述--概念介绍和技术梳理

文本到图像的 AI 模型仅根据简单的文字输入就可以生成图像。用户可以输入他们喜欢的任何文字提示——比如,“一只可爱的柯基犬住在一个用寿司做的房子里”——然后,人工智能就像施了魔法一样,会产生相应的图像。