ViT论文详解

ViT是谷歌团队在2021年3月发表的一篇论文,论文全称是《AN IMAGE IS WORTH 16X16 WORDS:TRANSFORMERS FOR IMAGE RECOGNITION AT SCALE》一张图片分成16x16大小的区域:使用Transformer进行按比例的图像识别。ViT是V

HookNet- 用于病理全切片图像的多分辨率语义分割模型|顶刊精析·24-08-08

今天分享的这篇文章是关于一种名为HookNet的新型语义分割模型,它专为病理学全切片图像设计,于2021年发表于《Med Image Anal》,目前IF=10.7。HookNet结合了编码器-解码器卷积神经网络的多个分支,通过不同分辨率的同心区域来捕获上下文信息和细节。这种模型通过一种称为“钩连”

Transformer模型解析(附案例应用代码)

自注意力机制是Transformer模型的核心,它允许模型在编码每个单词时同时关注序列中的其他单词,从而捕捉到单词之间的依赖关系。位置编码的生成使用了正弦和余弦函数的不同频率,以确保编码在不同维度上具有不同的模式,从而使模型能够区分不同位置的单词。这样,每个头可以学习到序列的不同方面,最终的输出是所

Nat Med·UNI:开启计算病理学新篇章的自监督基础模型|顶刊精析·24-07-31

一作&通讯角色姓名单位(中文)第一作者哈佛医学院布里格姆和妇女医院病理科第一作者Tong Ding哈佛医学院工程与应用科学学院第一作者Ming Y. Lu哈佛医学院和麻省理工学院癌症项目通讯作者哈佛医学院布里格姆和妇女医院病理科这篇文章介绍了一个名为UNI的新型通用自监督模型,它在计算病理学领域通过

【有啥问啥】浅谈Scaling Law

在机器学习和深度学习领域,(扩展定律)描述了模型性能(如准确率、损失等)如何随着模型规模(参数数量)、数据量和计算资源(如计算时间、显存等)的变化而变化。这些定律有助于研究人员和工程师理解如何有效地扩展模型以获得更好的性能。在深度学习的早期阶段,人们主要通过经验和试验来确定模型规模和训练数据量。然而

动量迭代快速梯度符号方法(Momentum Iterative FGSM,MI-FGSM)原理及实现

而动量机制通过累积多次迭代的梯度信息,可以更全面地利用这些梯度信息,从而在更大范围内找到模型的弱点,增强对抗攻击的效果。而动量机制通过累积多个梯度信息,可以帮助模型摆脱局部最优解的困扰,更容易找到全局最优解或更好的局部最优解,从而生成更强的对抗样本。MI-FGSM 将动量引入到 FGSM 中,通过在

20240809 每日AI必读资讯

在多个数学基准测试中数学能力显著超越了开源模型包括Llama-3.1-405B,甚至超过了闭源模型 (包括GPT-4o、Claude-3.5-Sonnet、Gemini-1.5-Pro )。大多数方法要么在图像的像素层面上逐步生成,要么通过先训练一个压缩图像的模型,再在低分辨率的图像上进行处理。-

【大模型搭建】部署Ollama,pull失败,手动构建方案

Ollama 是一个专注于简化大规模机器学习模型开发的框架。它提供了一系列工具来帮助开发者轻松地定义、训练和部署大型语言模型。优点:• 提供了简洁的API,易于上手。• 支持多种硬件加速选项,如GPU和TPU。• 内置了许多预训练模型,方便快速开始实验。缺点:• 对一些高级功

【搜索核心技术】经典搜索核心算法:BM25及其变种

上篇介绍了TF-IDF算法和它的四个变种,相对于TF-IDF而言,在信息检索和文本挖掘领域,BM25算法则更具理论基础,而且是工程实践中当仁不让的重要基线(Baseline)算法。BM25在20世纪70年代到80年代被提出,到目前为止已经过去二三十年了,但是这个算法依然在很多信息检索的任务中表现优异

目前比较好用的AI大模型创作工具地址合集及亮点应用

2024年,可以说是AI人工智能大模型爆发的元年,各类AI模型应用层出不穷,令人应接不暇。从前年底国外OpenAI公司的ChatGPT大模型推出开始,到去年国内百度公司的文心一言大模型率先向全社会开放使用,很多人都为人工智能时代的到来感到震惊和无所适从;有的人感到了焦虑和恐惧,担心AI不久就会取代自

优化采样参数提升大语言模型响应质量:深入分析温度、top_p、top_k和min_p的随机解码策略

本文将详细解析并可视化定义LLM输出行为的采样策略。通过深入理解这些参数的作用机制并根据具体应用场景进行调优,可以显著提升LLM生成输出的质量。

【人工智能】Transformers之Pipeline(十五):总结(summarization)

本文对transformers之pipeline的总结(summarization)从概述、技术原理、pipeline参数、pipeline实战、模型排名等方面进行介绍,读者可以基于pipeline使用文中的2行代码极简的使用NLP中的总结(summarization)模型。

高通AI Engine SDK(QNN)使用教程(环境配置、模型转换、量化、推理、分析)

高通AI Engine使用教程

【深度学习详解】Task2 分段线性模型-引入深度学习 Datawhale X 李宏毅苹果书 AI夏令营

机器学习基础 -> 线性模型 -> 分段线性模型 -> 引入深度学习🍎 🍎

向李宏毅学深度学习(进阶)#task01#Datawhale X 李宏毅苹果书 AI夏令营

根据基于李宏毅老师机器学习课程编著的《深度学习详解》一书,结合自己的思考,阐释了深度学习中全局最优值、局部极值、鞍点等关键概念,以及批量(banch)和动量法

CVPR 2024最佳论文分享┆EventPS: 基于事件相机的实时光度立体视觉

本文介绍了CVPR 2024的最佳论文提名,该论文利用事件相机的独特属性,实现了实时光度立体视觉。该算法在传统和深度学习领域均取得成功。配合高速转台数据采集和GPU优化,算法实现了每秒超30帧的实时表面法线重建。

为什么多模态大模型中使用Q-Former的工作变少了?附Q-Former结构简介

面试中遇到的问题,自己在实践中注意到了却没有深究原因,没有回答好,特此记录和探讨这个问题。多模态大模型中需要一个输入投影模块,将视觉特征投射到LLM能理解的语言特征维度,这里就可以选择各种不同的模块。LLaVA最初用了简单的线性投射,然而作者提到这么做是为了做实验更快一点,使用复杂的模块可能会有更好

LSTM模型

LSTM(长短期记忆)是一种用于处理和预测时间序列数据的递归神经网络(RNN)架构旨在解决传统RNN在处理长序列数据时存在的梯度消失和梯度爆炸问题。LSTM的关键在于其特殊的单元结构,每个单元包含三个门:输入门、遗忘门和输出门。这些门通过控制信息的流动,允许LSTM在更长时间范围内保持和更新记忆。输

视觉 注意力机制——通道注意力、空间注意力、自注意力、交叉注意力

在计算机视觉领域,注意力机制(Attention Mechanism)已成为提升模型性能的关键技术之一。注意力机制通过模拟人类视觉的选择性注意力,能够在海量数据中自动聚焦于最相关的信息,从而提高模型的效率和准确性。下面将介绍通道注意力、空间注意力、自注意力和交叉注意力四种类型。

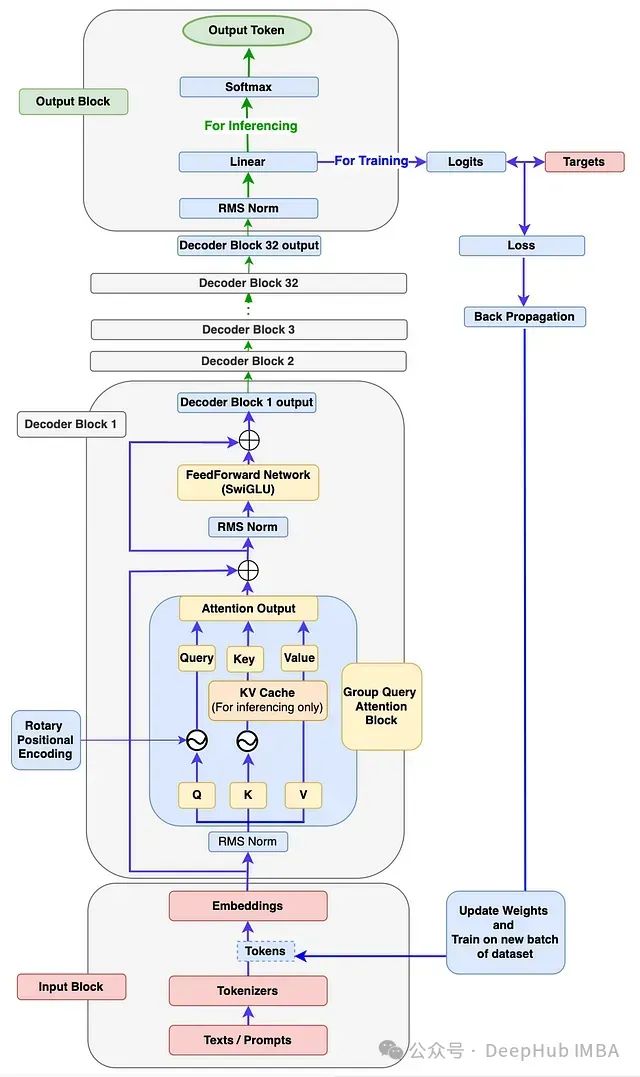

使用PyTorch从零构建Llama 3

本文将详细指导如何从零开始构建完整的Llama 3模型架构,并在自定义数据集上执行训练和推理。