ER-NeRF对话数字人模型训练与部署

数字人也称为Digital Human或Meta Human,是运用数字技术创造出来的、与人类形象接近的数字化人物形象。应用包括但不限于直播、软件制作、教育、科研等领域。目前数字人模型效果最好的是ER-NeRF,其借鉴了nerf体渲染的思路,在输入维度上添加了音频特征,通过音频来影响渲染效果(控制嘴

AI全知道-如何利用LLM来调用工具 (Call Tools)

工具调用是指通过语言模型生成的参数来触发外部工具的执行。这些工具可以是计算程序、数据库查询、API请求等。尽管工具调用这个名称暗示模型直接执行某些操作,但实际上,模型只是生成工具所需的参数,真正的工具执行仍然由用户或系统来完成。city=北京&date=2024-08-06我们需要定义几个API接口

时间序列预测方法概述

时间序列预测是数据分析的一个重要领域,涉及对未来事件的预测,基于过去的数据点。以下是几种常用的时间序列预测方法,包括其原理、优缺点。

2024.7.28周报

本周阅读了一篇题目为Physics-Informed Neural Networks for Modeling Water Flows in a River Channel的论文,这篇论文提出了一种新的基于物理信息神经网络(PINN)的河道水流代理模型。本文研究PINN的性能直接从圣维南方程的配置建

30_Swin-Transformer网络结构详解

https://www.bilibili.com/video/BV1pL4y1v7jC/?spm_id_from=333.999.0.0&vd_source=7dace3632125a1ef7fd32c285eb2fbac

AI中的核心概念解读:深度学习、机器学习、神经网络与自然语言处理

深度学习、机器学习、神经网络和自然语言处理是AI领域的重要组成部分。这些技术正在改变我们与世界互动的方式,从语音助手到图像识别,再到自动翻译,它们在各个领域的应用前景广阔。通过掌握这些核心概念和实现方法,您将能够更好地理解和应用AI技术,从而在这一快速发展的领域中占据一席之地。

动手学深度学习(预备知识)

当你为错过太阳而流泪时,你也要错过群星了。一起来动手学深度学习吧

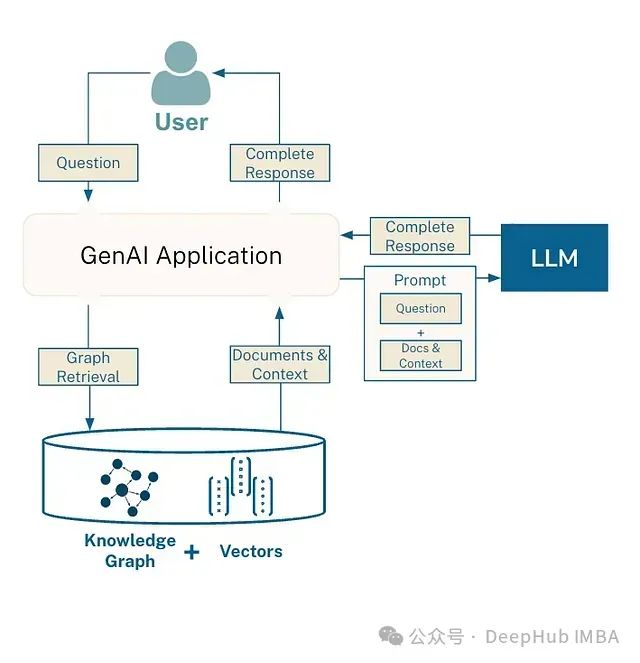

GraphRAG 与 RAG 的比较分析

Graph RAG 技术通过引入图结构化的知识表示和处理方法,显著增强了传统 RAG 系统的能力。它不仅提高了信息检索的准确性和完整性,还为复杂查询和多步推理提供了更强大的支持。

Datawhale X 李宏毅苹果书 AI夏令营_深度学习进阶_Datawhile_task3_批量归一化和卷积神经网络

批量归一化和卷积神经网络是深度学习中的重要技术。批量归一化通过减少内部协变量偏移,提高了网络的训练效率和性能;而卷积神经网络则通过卷积和池化操作,有效地处理具有网格结构的数据。两者的结合使得深度学习模型在多个领域取得了突破性的进展。

本地部署 fish-speech

本地部署 fish-speech

【深度学习入门篇 ④ 】Pytorch实现手写数字识别

通过前面的学习,我们已经掌握了PyTorch API的基本使用,今天我们使用PyTorch实现手写数字识别案例!通过前面的内容可知,调用MNIST返回的结果中图形数据是一个Image对象,需要对其进行处理,为了进行数据的处理,接下来学习的方法~是PyTorch中用于图像预处理和增强的一个重要模块,它

一文弄懂 Transformer模型(详解)

Transformer自注意力机制是一种在自然语言处理(NLP)领域中广泛使用的机制,特别是在Transformer模型中,这种机制允许模型在处理序列数据时,能够捕捉到序列内部不同位置之间的相互关系。1、查询(Query)、键(Key)、值(Value):自注意力机制将输入序列中的每个元素视为一个查

GPU介绍和入门知识整理

GPU入门介绍知识

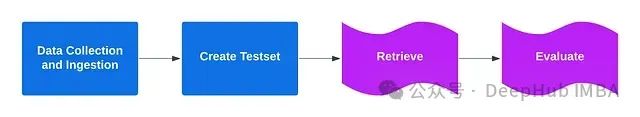

让模型评估模型:构建双代理RAG评估系统的步骤解析

我们将介绍一个基于双代理的RAG(检索增强生成)评估系统。该系统使用生成代理和反馈代理,基于预定义的测试集对输出进行评估。或者更简单的说,我们使用一个模型来评估另外一个模型的输出。

【AI大模型】LLM主流开源大模型介绍

随着ChatGPT迅速火爆,引发了大模型的时代变革,国内外各大公司也快速跟进生成式AI市场,近百款大模型发布及应用。目前,市面上已经开源了各种类型的大语言模型,本章节我们主要介绍其中的三大类...

python实现六种垃圾分类(基于mindspore深度学习框架)

本实验使用MindSpore框架进行AI模型的训练与部署,通过训练一个基于MobileNet V2架构的深度学习模型,实现六种垃圾分类。具体目标包括:1. 下载并预处理垃圾分类数据集。2. 利用预训练的MobileNet V2模型进行微调,训练出一个高精度的垃圾分类模型。3. 实现实时垃圾分类的功能

AI数字人硅基数字人模型训练模型网络结构和训练代码

AI数字人实时数字人硅基数字人模型推理代码和模型网络结构

Datawhale X 李宏毅苹果书 AI夏令营

阅读李宏毅老师苹果书及搭配视频的一次记录

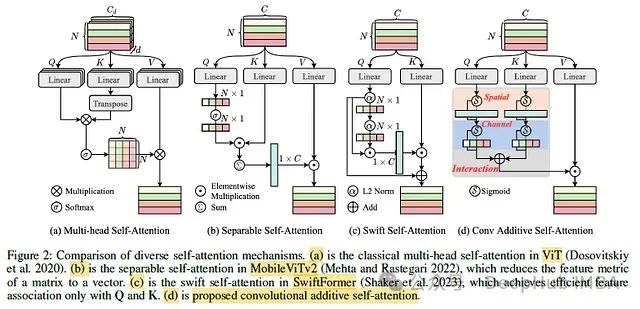

CAS-ViT:用于高效移动应用的卷积加法自注意力视觉Transformer

这是8月份再arxiv上发布的新论文,我们下面一起来介绍这篇论文的重要贡献

Datawhale X 李宏毅苹果书 AI夏令营(Task2)

根据GPU是否可用选择设备类型# 初始化模型,并将其放置在指定的设备上# 定义批量大小# 定义训练轮数# 如果在'patience'轮中没有改进,则提前停止# 对于分类任务,我们使用交叉熵作为性能衡量标准# 初始化优化器,您可以自行调整一些超参数,如学习率。