最基本的25道深度学习面试问题和答案

如果你最近正在参加深度学习相关的面试工作,那么这些问题会对你有所帮助。

拿下Transformer

对于每一个x向量,网络又可以通过乘WQ,WK,WV衍生出三个向量Q1,K1,V1向量。对于所有的Xi来说,其乘的WQ,WK,WV都是一模一样的(即权重是共享的)。Self attention所作的内容,总结一下就是一个包含三个参数矩阵WQ,WK,WV的模块,输出为m个Context vector,并

YOLOv7(目标检测)入门教程详解---环境安装

零基础入门yolov7 从环境安装到推理训练,再到c++实现yolov7

【31】GPU(下):为什么深度学习需要使用GPU?

GPU发展历史:1.加速卡(顶点处理仍在CPU完成,图像渲染受制于CPU的性能);2.带有顶点处理功能的显卡:NVidia推出GeForce 256 显卡;3.可编程管线(Programable Function Pipeline)的引入:2001年的Direct3D 8.0【微软第一次引入】;4.

Pytorch利用ddddocr辅助识别点选验证码

本篇文章的主要目的是识别点选验证码,其中利用ddddocr来辅助识别,这样整体识别验证码的步骤将会非常简单,具体有多简单,请看步骤首先展示一下点选验证码的数据集**数据集介绍:**可以看到,该点选验证码识别是有一张图主背景图,提示需要依次点击哪些字,基本上大部分点选验证码都是这样,按照语序点击主背景

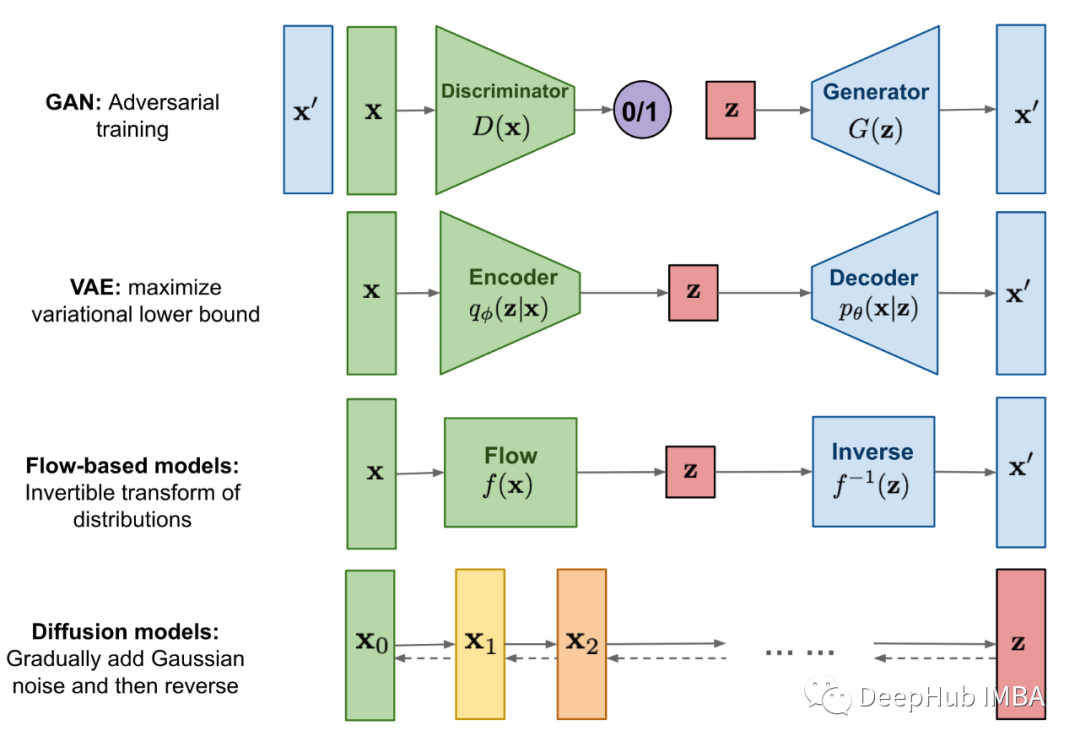

扩散模型的极简介绍

扩散模型是什么,如何工作以及他如何解决实际的问题

机器学习:过拟合、欠拟合、正则化之间的纸短情长~

正则化是何如解决过拟合的,机器学习的主要挑战是我们的算法能够在为观测的数据上误差较小,而不是在只在训练集上表现良好,我们这种能力我们称之为泛化。

CNN天气识别

本文将采用CNN实现多云、下雨、晴、日出四种天气状态的识别。本文为了增加模型的泛化能力,新增了Dropout层并且将最大池化层调整成了平均池化层。

猿创征文丨深度学习基于双向LSTM模型完成文本分类任务

大家好,我是猿童学,本期猿创征文的第三期,也是最后一期,给大家带来神经网络中的循环神经网络案例,基于双向LSTM模型完成文本分类任务,数据集来自kaggle,对电影评论进行文本分类。电影评论可以蕴含丰富的情感:比如喜欢、讨厌、等等.情感分析(Sentiment Analysis)是为一个文本分类问题

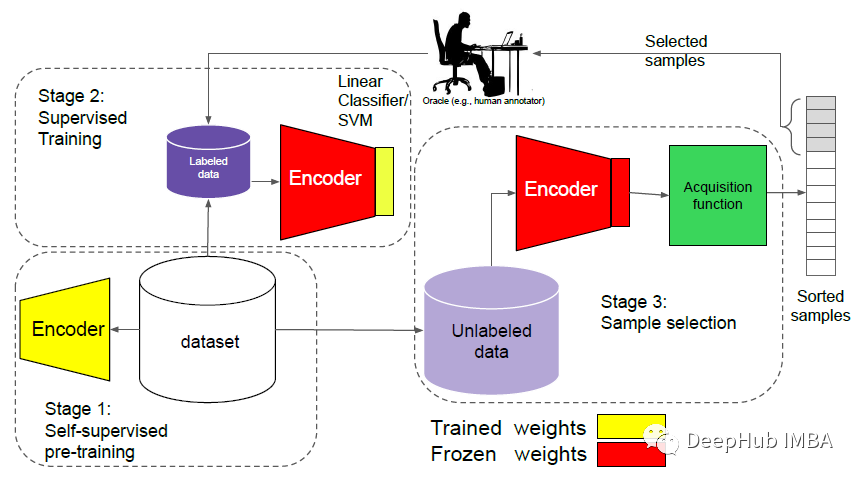

论文推荐:当自监督遇到主动学习

Reducing Label Effort: Self-Supervised meets Active Learning这篇论文将主动学习和自监督训练结合,减少了标签的依赖并取得了很好的效果。

花书——PyTorch版本

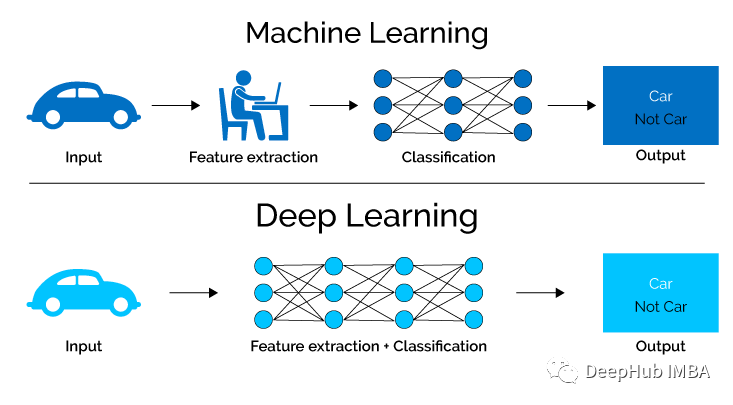

事实上,要想解读图像中的内容,需要寻找仅仅在结合成千上万的数值时才会出现的特征,如边缘、质地、形状、眼睛、鼻子等,最终才能判断图像中是否有猫。我们可以收集一些已知包含猫与不包含猫的真实图像,然后我们的目标就转化成如何从这些图像入手得到一个可以推断出图像中是否有猫的函数。这个函数的形式通常通过我们的知

Ubuntu22.04安装CUDA深度学习环境&&cuda principle

最后一行加上: blacklist nouveau。

人脸检测5种方法

5种人脸检测方法快速使用。

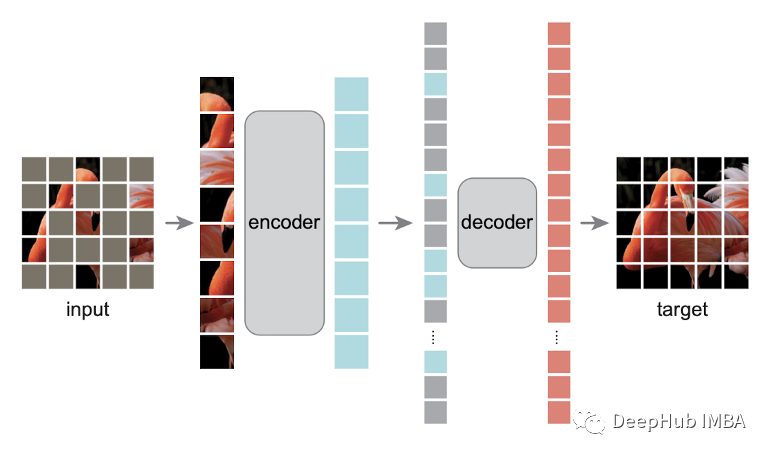

带掩码的自编码器MAE在各领域中的应用总结

NLP,图像,视频,多模态,设置时间序列和图机器学习中都出现了MAE的身影

计算机视觉项目-实时目标追踪

目标追踪技术对于民生、社会的发展以及国家军事能力的壮大都具有重要的意义。它不仅仅可以应用到体育赛事当中目标的捕捉,还可以应用到交通上,比如实时监测车辆是否超速等!对于国家的军事也具有一定的意义,比如说导弹识别目标等方向。所以说实时目标追踪技术对于整个社会来说都是非常重要的!目前被应用的比较多的,而且

使用机器学习创建自己的Emojis 表情

在本文中,我们将描述一种图像生成方法,该方法无需额外的模型训练和昂贵的设备就可以在不同的图像风格之间切换。

猿创征文|【深度学习前沿应用】文本生成

【自然语言处理(NLP)】文本生成,基于百度飞桨开发,参考于《机器学习实践》所作。

猿创征文|深度学习基于前馈神经网络完成鸢尾花分类

在梯度下降法中,目标函数是整个训练集上的风险函数,这种方式称为批量梯度下降法(Batch Gradient Descent,BGD)。 批量梯度下降法在每次迭代时需要计算每个样本上损失函数的梯度并求和。当训练集中的样本数量NN很大时,空间复杂度比较高,每次迭代的计算开销也很大。为了减少每次迭代的计算

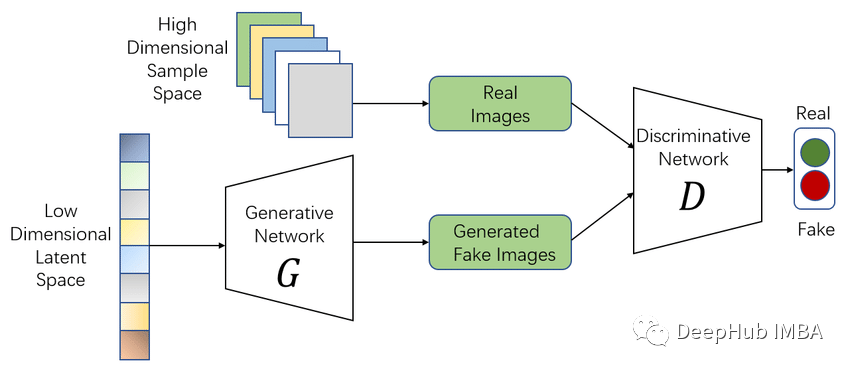

GANs的优化函数与完整损失函数计算

本文详细解释了GAN优化函数中的最小最大博弈和总损失函数是如何得到的。将介绍原始GAN中优化函数的含义和推理,以及它与模型的总损失函数的区别,这对于理解Generative Adversarial Nets是非常重要的

Pytorch优化器全总结(一)SGD、ASGD、Rprop、Adagrad

这是一个系列,以Pytorch为例,介绍所有主流的优化器,如果都搞明白了,对优化器算法的掌握也就差不多了。作为系列的第一篇文章,本文介绍Pytorch中的SGD、ASGD、Rprop、Adagrad,其中主要介绍SGD和Adagrad。因为这四个优化器出现的比较早,都存在一些硬伤,而作为现在主流优化