【YOLOv5】yolov5目标识别+DeepSort目标追踪

引言利用yolov5训练的目标识别模型,结合DeepSort实现目标追踪源码下载:(1)Yolov5_DeepSort_Pytorch (该源码下载下来的yolov5文件夹是空的,需要另外下载yolov5的源码)(2)yolov5实现步骤1 YOLO环境搭建+自定义模型训练1、参考【YOLOv5-5

CUDA error: device-side assert triggered

原因1:模型大小不匹配在定义模型的最终全连接层时,我没有将 196(斯坦福汽车数据集的类总数)作为输出单元的数量,而是使用了 195。错误通常在您执行反向传播的行中识别。您的损失函数将比较模型的输出和数据集中该观察的标签。万一您对标签和输出感到困惑,请参阅下面我如何定义它们:原因2:损失函数输入错误

Torch not compiled with CUDA enabled 解决办法

解决Torch not compiled with CUDA enabled 版本不兼容问题

yolov5 代码内容解析

122122<div id="MathJax_Message" style="display: none;"></div><div id="MathJax_Message" style="display: none;"></div>离开了122

yolov7开源代码讲解--训练代码

以前看CNN训练代码的时候,往往代码比较易懂,基本很快就能知道各个模块功能,但到了后面很多出来的网络中,由于加入了大量的trick,导致很多人看不懂代码,代码下载以后无从下手。训练参数和利用yaml定义网络详细过程可以看我另外的文章,都有写清楚。其实不管什么网络,训练部分大体都分几个部分:1.网络的

CVPR2022 多目标跟踪(MOT)汇总

CVPR2022 MOT文章汇总

模型部署入门教程(三):PyTorch 转 ONNX 详解

OpenMMLab:模型部署系列教程(一):模型部署简介OpenMMLab:模型部署系列教程(二):解决模型部署中的难题知道你们在催更,这不,模型部署入门系列教程来啦~在前二期的教程中,我们带领大家成功部署了第一个模型,解决了一些在模型部署中可能会碰到的困难。今天开始,我们将由浅入深地介绍 ONNX

windows下CUDA的卸载以及安装

一、缘由对于CUDA新手来说,安装问题里面有很多需要注意的细节,很多自定义的选项,如果漏选就会出现一些莫名奇妙的问题。为此,会经常出现卸载CUDA,再安装CUDA的问题,下面总结。二、卸载前的准备(1)卸载工具:①windows自带的控制面板,用来卸载主程序②腾讯电脑管家等类似杀毒软件,用来清除卸载

周志华《机器学习》第三章课后习题

目录3.1 试析在什么情形下式(3.2) 中不必考虑偏置项 b.3.2、试证明,对于参数w,对率回归的目标函数(3.18)是非凸的,但其对数似然函数(3.27)是凸的. 3.3、编程实现对率回归,并给出西瓜数据集3.0α上的结果.3.4 选择两个 UCI 数据集,比较 10 折交叉验证法和留一法所估

学习率设置

本篇主要学习神经网络超参数学习率的设置,包括人工调整和策略调整学习率。在模型优化中,常用到的几种学习率衰减方法有:分段常数衰减、多项式衰减、指数衰减、自然指数衰减、余弦衰减、线性余弦衰减、噪声线性余弦衰减。......

安装Pytorch-gpu版本(第一次安装 或 已经安装Pytorch-cpu版本后)

由于已经安装了cpu版本了,如果再在该环境下安装gpu版本会造成环境污染.因此,再安装gpu版本时,需要再新建一个虚拟环境才能安装成功。然后去官网下载所适配的版本。 安装完cuda和cudnn后,开始安装pytorch的gpu版本。1.安装cude首先查看windows电脑之前是否成功安装了CUDA

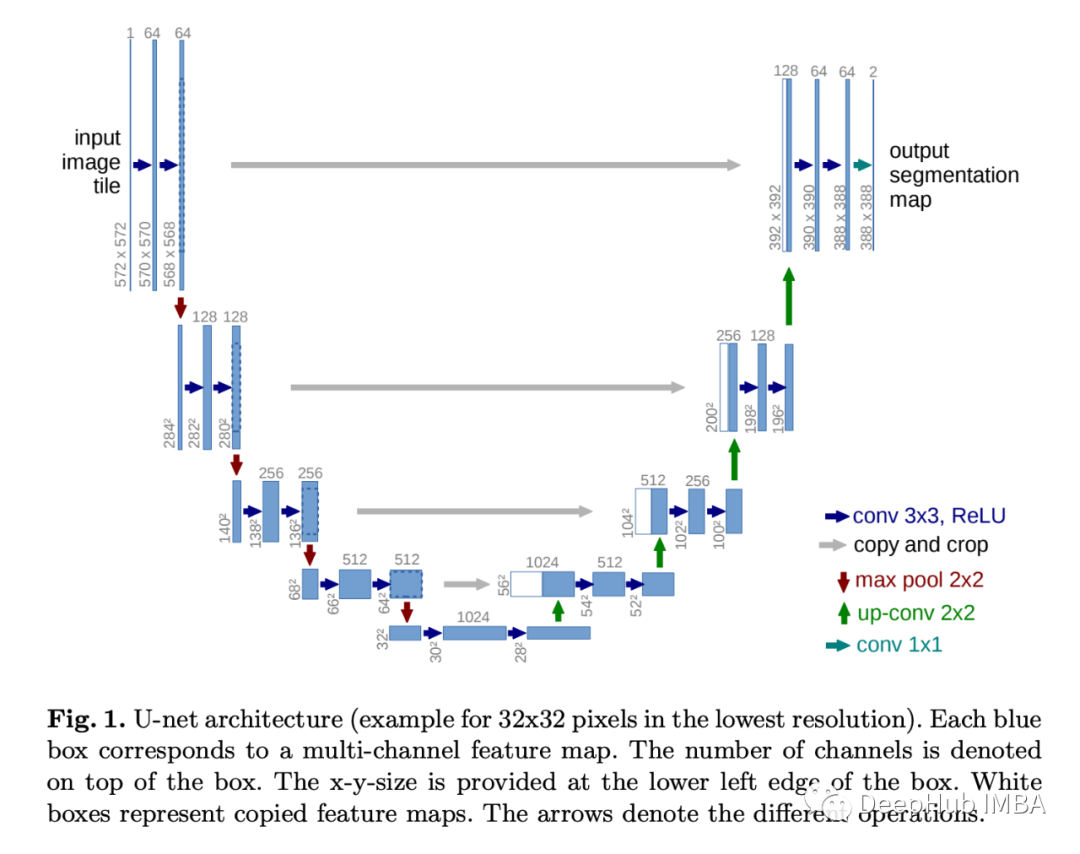

U-Net在2022年相关研究的论文推荐

UNet 可以算是 FCN 的一种变体,是最常用、最简单的一种分割模型,简单、高效、易懂、容易构建,且可以从小数据集中训练。2015 年,UNet 在论文 U-Net: Convolutional Networks for Biomedical Image Segmentation 中被提出 。

Deformable DETR源码解读

Deformable DETR源码解读

pytorch-lightning安装

一般pytorch-lightning 需要torch版本≥1.8.0。在安装pytorch-lightning时一定注意自己的torch是pip安装还是conda安装,两者要保持一致,不然会导致安装pytorch-lightning时会直接卸载掉你的torch,安装cpu版本的torch。http

Cuda与GPU显卡驱动版本一览

cuda版本是??gpu 驱动? 两者怎么对应

详解:yolov5中推理时置信度,设置的conf和iou_thres具体含义

详解:yolov5中推理时置信度,设置的conf和iou_thres具体含义

YOLOv5训练自己的数据集详解

入门小菜鸟,希望像做笔记记录自己学的东西,也希望能帮助到同样入门的人,更希望大佬们帮忙纠错啦~侵权立删。一、YOLOv5源码下载网址指路:GitHub - ultralytics/yolov5: YOLOv5 ???? in PyTorch > ONNX > CoreML > TF

CoCo数据集下载

文章目录1.介绍2.下载2.1 官网2.2 百度网盘2.3 下载到linux服务器1.介绍MS COCO的全称是Microsoft Common Objects in Context,起源于微软2014年的Microsoft COCO数据集COCO is a large-scale object d

联邦学习(FL)+差分隐私(DP)

联邦学习+差分隐私(FL+DP)

论文阅读笔记:ShuffleNet

背景由于深度学习模型结构越来越复杂,参数量也越来越大,需要大量的算力去做模型的训练和推理。然而随着移动设备的普及,将深度学习模型部署于计算资源有限基于ARM的移动设备成为了研究的热点。ShuffleNet[1]是一种专门为计算资源有限的设备设计的神经网络结构,主要采用了pointwise group