AI实现艺术品自动生成?太牛了

什么是AI艺术家?本文介绍了AI艺术家的基本原理以及使用流程,为艺术创作带来新的概念,希望能得到大家的鼓励支持!

信息熵是什么

信息熵是什么通过前两节的学习,我们对于决策树算法有了大体的认识,本节我们将从数学角度解析如何选择合适的“特征做为判别条件”,这里需要重点掌握“信息熵”的相关知识。信息熵这一概念由克劳德·香农于1948 年提出。香农是美国著名的数学家、信息论创始人,他提出的“信息熵”的概念,为信息论和数字通信奠定了基

语义分割之SegFormer分享

今年可以说是分割算法爆发的一年,首先Vit通过引入transform将ADE20K mIOU精度第一次刷到50%,超过了之前HRnet+OCR效果,然后再是Swin屠榜各大视觉任务,在分类,语义分割和实例分割都做到了SOTA,斩获ICCV2021的bset paper,然后Segformer有凭借对

机器学习算法——混淆矩阵(Confusion Matrix)之鸢尾花实例

什么是混淆矩阵?其实就是把所有类别的预测结果与真实结果按类别放置到了同一个表里,在这个表里我们可以清楚地看到每个类别正确识别的数量和错误识别的数量。混淆矩阵在什么情况下最好呢?答案是类别不平衡时。混淆矩阵是除了ROC曲线和AUC之外的另一个判别分类好坏程度的方法。TP=True Positive=真

AI时代来临,如何把握住文档处理及数据分析的机遇

在3月18日,由中国图象图形协会(CSIG)主办,合合信息、CSIG文档图像分析与识别专业委员会联合承办的“CSIG图像图形企业行”活动将正式举办,特邀来自上海交大、厦门大学、复旦、中科大的顶尖学府的学者与合合信息技术团队一道,以直播的形式分享文档处理实践经验及NLP发展趋势,探讨ChatGPT与文

一文讲解thop库计算FLOPs问题

计算模型的FLOPs及参数大小FLOPS是处理器性能的衡量指标,是“每秒所执行的浮点运算次数”的缩写。FLOPs是算法复杂度的衡量指标,是“浮点运算次数”的缩写,s代表的是复数。一般使用thop库来计算,GitHub:但官网的Readme中详细写出了是用来计算MACs,而不是FLOPs的MACs(M

基于Python实现五大常用分类算法(原理+代码)

编程算法常用

信号处理中简单实用的方法——消除趋势项

信号处理中简单实用的方法——消除趋势项

震撼,支持多模态模型的ChatGPT 4.0发布了

给几张论文的照片,GPT-4可以做总结,也可以对用户指定的图片的内容进行展开解释。

目标检测(Object Detection)学习笔记(概述与传统算法与基于深度学习算法)

目标检测(Object Detection)的任务是找出图像中所有感兴趣的目标(物体),不同于分类和回归问题,目标检测还需要确定目标在图像中的位置(定位),而确定识别目标的类别和位置(分类和定位),是计算机视觉领域的核心问题之一。

BERTopic:NLP主题模型的未来!

文| ZenMoore编| 小轶以前我一直以为,主题建模(提取文档的主题词)这种机器学习时代就开始研究的基础工具,现在肯定已经到头了,虽然...有时效果可能不是那么让人满意。但突然看到一则推文:“彻底疯了!不需要预先清洗数据,就能够快速拿到质量难以置信的主题!” “NLP 主题模型的未来!”好家伙!

D435i相机的标定及VINS-Fusion config文件修改

D435i相机的标定及VINS-Fusion config文件修改

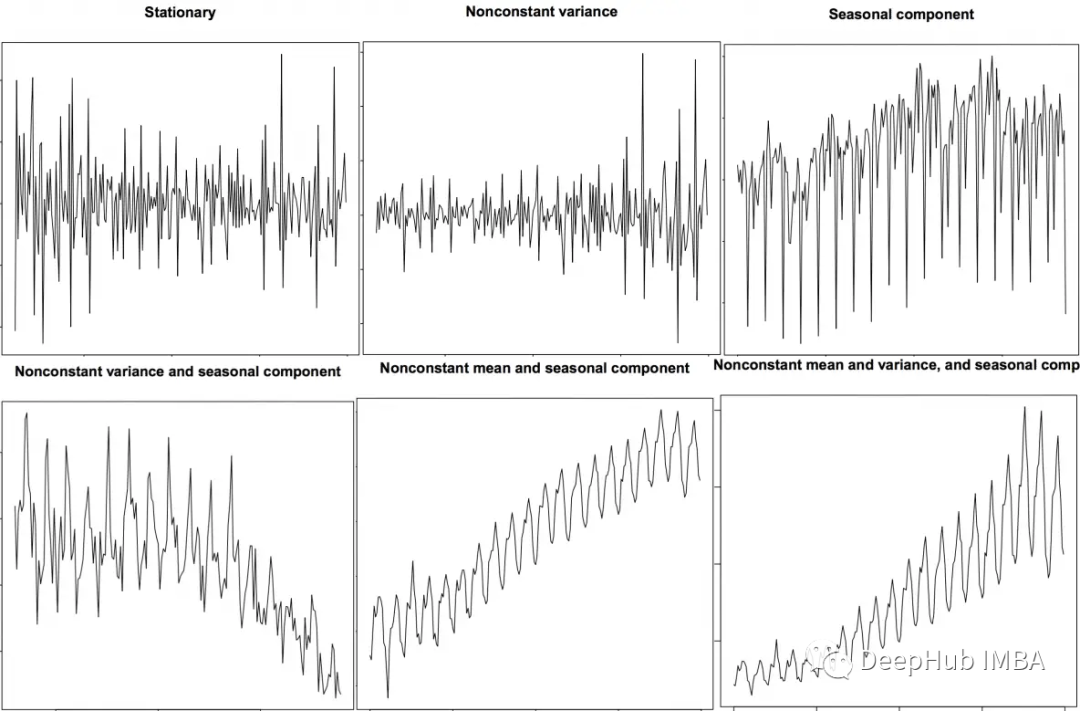

时间序列特征提取的Python和Pandas代码示例

使用Pandas和Python从时间序列数据中提取有意义的特征,包括移动平均,自相关和傅里叶变换。

到底什么是模型预测控制MPC(一)

1. 为什么使用MPC控制2. 什么是模型预测控制 MPC3. MPC的参数设计在我们驾驶汽车的时候,驾驶的目的就是让汽车行驶在安全的道路上。作为一个驾驶员我们可以控制的是汽车的油门和方向盘,也就是对应控制的是汽车的速度和方向。在驾驶的过程中我们会不断的调节方向盘的角度,这是因为我们知道当前角度如果

简单研究一下 OpenAI 的官方文档

介绍 openai 的tokenizer、模型、ChatGPT接口使用(gpt-3.5-turbo)、使用限制、定价。

ChatGLM-6B (介绍以及本地部署)

ChatGLM-6B 是一个开源的、支持中英双语问答的对话语言模型,基于架构,具有 62 亿参数。结合模型量化技术,用户可以在消费级的显卡上进行本地部署(INT4 量化级别下最低只需 6GB 显存)。ChatGLM-6B 使用了和ChatGLM相同的技术,针对中文问答和对话进行了优化。经过约 1T

[九]深度学习Pytorch-transforms图像增强(剪裁、翻转、旋转)

深度学习Pytorch-transforms图像增强(剪裁、翻转、旋转)

ChatGPT开源平替——OpenChatKit(前OpenAI团队打造)

OpenChatKit是一个由前OpenAI研究员共同打造的开源聊天机器人平台。它包含了训练好的大型语言模型、定制配方和可扩展的检索系统,可以帮助用户快速构建高精度、多功能的聊天机器人应用。其中,最核心的组件是一个经过微调的、具有200亿参数的语言模型——GPT-NeoXT-Chat-Base-20

本手、妙手、俗手?我用AI写2022高考全国作文题,会被看出来?

自然语言处理是人工智能领域的前沿学科和热点方向,本文试着用NLP文章生成模型写了2022年高考作文题,有点意思

Lift-Splat-Shoot算法理解及代码中文注释

对算法Lift-Splat-Shoot的理解以及源代码中文注释