AI时代再进化!GitHub上热门AI工具大PK!

作为如今备受推崇的开发者技术社区,GitHub 近来涌现出众多令人激动的 AI 工具。这些工具都有一些共同的特质:它们不仅简单易用,高效便捷,而且融入了引人注目的创新元素,能够显著提升您个人的工作效率和生产力。今天,我将带您深入了解一些备受欢迎的 GitHub 上的 AI 工具,这些工具将成为您日常

【端到端图像压缩】CompressAI运行记录

期末作业要求运行端到端的图像压缩代码,过程中学习了csdn上诸多教程。这里将运行的过程分享出来。

图像数据增强算法汇总(Python)

数据增强是一种通过使用已有的训练样本数据来生成更多训练数据的方法,可以应用于解决数据不足的问题。数据增强技术可以用来提高模型的泛化能力,减少过拟合现象。比如在狗猫识别项目中,通过随机旋转、翻转和裁剪等数据增强方法,可以使模型具有对不同角度和尺寸的狗猫图像的识别能力。增加训练样本数量:通过生成新样本,

用最通俗的方式理解LSTM和重要参数

LSTM---长短期记忆递归神经网络是一个非常常用的神经网络,其特点在于该网络引入了长时记忆和短时记忆的概念,因而适用于一些有着上下文语境的回归和分类,诸如温度预测或是语义理解。从利用pytorch来构造模型的角度来看,该模型相比于一般的模型会有一些不同的地方,尤其是在参数的设置上,本文尝试以一个相

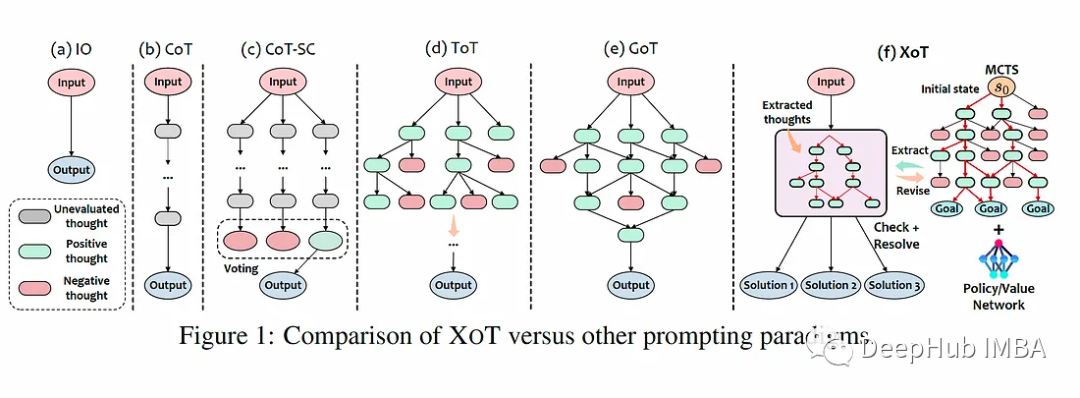

XoT:一种新的大语言模型的提示技术

这是微软在11月最新发布的一篇论文,它增强了像GPT-3和GPT-4这样的大型语言模型(llm)解决复杂问题的潜力。

常用的数据集网站

常用数据集网站

卷积总结篇(普通卷积、转置卷积、膨胀卷积、分组卷积和深度可分离卷积)

卷积总结篇(普通卷积、转置卷积、膨胀卷积、分组卷积和深度可分离卷积),分别从概念、背景、原理、参数量、计算量、感受野、各种卷积的优点以及在网络的应用展开讲解。

AI数字人:最强声音驱动面部表情模型VideoReTalking

VideoReTalking是一个强大的开源模型,是目前语音驱动面部表情的模型中效果最好的一个。此模型是由西安电子科技大学、腾讯人工智能实验室和清华大学联合开发的。

Pytorch学习笔记(8):正则化(L1、L2、Dropout)与归一化(BN、LN、IN、GN)

Pytorch学习笔记(8):正则化(L1、L2、Dropout)与归一化(BN、LN、IN、GN)超级详细!

【人工智能概论】 变分自编码器(Variational Auto Encoder , VAE)

变分自编码器(Variational Auto Encoder , VAE)

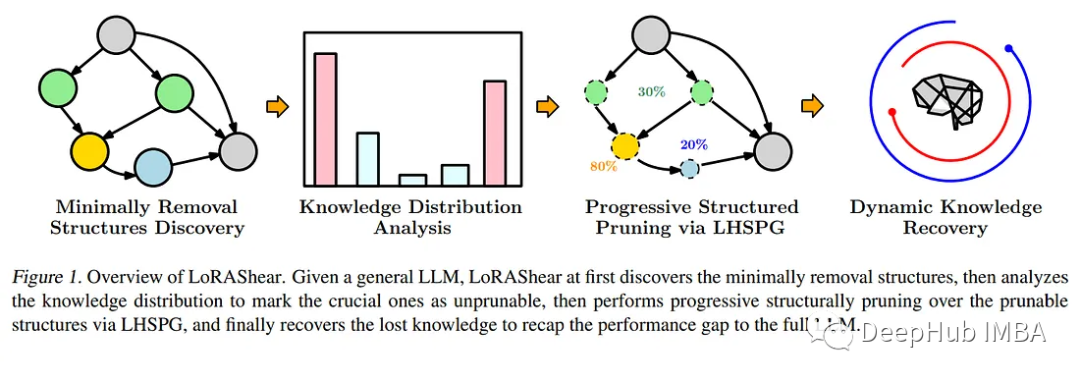

LoRAShear:微软在LLM修剪和知识恢复方面的最新研究

LoRAShear是微软为优化语言模型模型(llm)和保存知识而开发的一种新方法。它可以进行结构性修剪,减少计算需求并提高效率。

人工智能概览

1.人工智能定义2.人工智能发展历史3.人工智能产业生态4.人工智能落地挑战5.人工智能发展趋势

【深度学习】基于华为MindSpore的手写体图像识别实验

在MNIST文件夹下建立train和test两个文件夹,train中存放train-labels-idx1-ubyte和train-images-idx3-ubyte文件,test中存放t10k-labels-idx1-ubyte和t10k-images-idx3-ubyte文件。同时,因为全连接网

感受野是什么?

在卷积神经网络中,感受野(Receptive Field)是指特征图上的某个点能看到的输入图像的区域,即特征图上的点是由输入图像中感受野大小区域的计算得到的。因此感受野的值可以用来大致判断每一层的抽象层次。公式求取的感受野通常很大,而实际的有效感受野(Effective Receptive Fiel

【值得收藏】机器学习实战项目汇总(初级、中级、高级)

大家都知道,教科书上所学与实际操作还是有出入的,那关于机器学习有什么好的项目可以实操吗?这次给大家分享一个涵盖面向初学者,中级专家和专家的23种机器学习项目创意,以获取有关该增长技术的真实经验。这些机器学习项目构想将帮助你了解在职业生涯中取得成功、和当下就业所需的所有实践。通过项目学习是你短期内能做

人工智能、机器学习、深度学习的区别

人工智能涵盖范围最广,它包含了机器学习;而机器学习是人工智能的重要研究内容,它又包含了深度学习。

【深度学习】实验1答案:Softmax实现手写数字识别

【深度学习】实验1答案:Softmax实现手写数字识别

学习如何使用GPT2进行文本生成(torch+transformers)

GPT2是OPen AI发布的一个预训练语言模型,见论文《Language Models are Unsupervised Multitask Learners》,GPT-2利用单向Transformer的优势,做一些BERT使用的双向Transformer所做不到的事。那就是通过上文生成下文文本。

DINO在Windows环境下训练 自定义数据集

DINO: 让目标检测拥抱Transformer

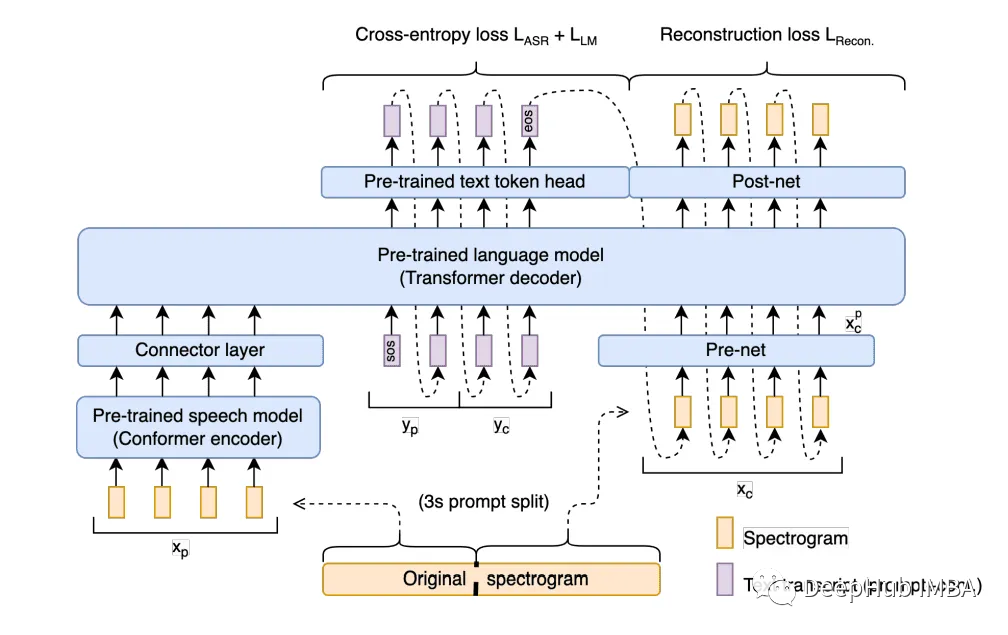

Spectron: 谷歌的新模型将语音识别与语言模型结合进行端到端的训练

Spectron是谷歌Research和Verily AI开发的新的模型。与传统的语言模型不同,Spectron直接处理频谱图作为输入和输出。该模型消除归纳偏差,增强表征保真度,提高音频生成质量。