Windows端CUDA11.3+CUDNN+pytorch环境搭建

1、显卡驱动的安装最近,在学习pytorch深度学习,遇到很多的坑,环境配置也出现过问题,忍不住和大家进行分享,现在把环境搭建过程分享给大家。1.1、查看自己的显卡。具体操作:我的电脑-——属性——设备管理器——显示适配器1.2、驱动的下载、安装。在找到自己的显卡后,去NVIDIA官网下载安装驱动选

AI安全技术总结与展望

1. AI安全的分类2. AI安全应用3. AI安全面临的威胁4. AI安全事件5. AI安全公司本文将从AI安全分类、AI安全应用、AI安全面临的威胁、AI安全事件、AI安全公司等几个角度分别进行阐述。

R语言使用tidyr包的pivot_longer函数将dataframe从宽表转化为长表

R语言使用tidyr包的pivot_longer函数将dataframe从宽表转化为长表

摄像头实时换脸,上网课老师都不认识我了,哈哈

摄像头实时换脸了

Python 中的 requirements.txt 与 setup.py

Python 中 requirements.txt、setup.py 和 setup.cfg 的用途

神经网络之激活函数

1.引言上一篇文章我们提到了神经网络中前向传播中数据经过线性变换后会传入一个激活函数(activation function),以满足我们解决非线性问题的需求。2.激活函数类常见的激活函数有以下四种。2.1 Sigmoid2.1.1 表达式与图像表达式:图像:2.1.2 优缺点优点:将整个实轴映射到

从零开始的神经网络构建历程(一)

这是构建神经网络历程系列的第一篇博文。本篇博文主要讲述Python中torch库在神经网络构建中的相关用法。torch库成员与神经网络中相关模块的对应关系由于逻辑回归以及其他机器学习算法解决不了非线性分类/回归问题,所以深度学习理论诞生了,上世纪60年代由此产生了神经网络模型。最早的一大批神经网络都

数据可视化—随机漫步

随机漫步顾名思义就是你也不知道它下一步走哪,可能这辈子你都找不到两个一模一样的随机漫步(不信可以试试)

11.1 迁移学习【李沐-斯坦福21秋季:实用机器学习中文版】

【李沐-斯坦福21秋季:实用机器学习中文版】笔记系列11.1 迁移学习1. 迁移学习是什么? 迁移学习就是能在一个任务上学习一个模型,然后用其来解决相关的别的任务,这样我们在一个地方花的时间,学习的一些知识,研究的一些看法可以在另外一个地方被使用到; 所以例如,也许你已经训练好一个神经网络,能够识

有人说低代码是:几个牛B的人让一群人失业,真的是这样吗?

随着低代码平台的日益成熟,模板越来越丰富、生态越来越完善,未来低代码的适用范围也会得到扩展,必将在某些领域绽放光彩!

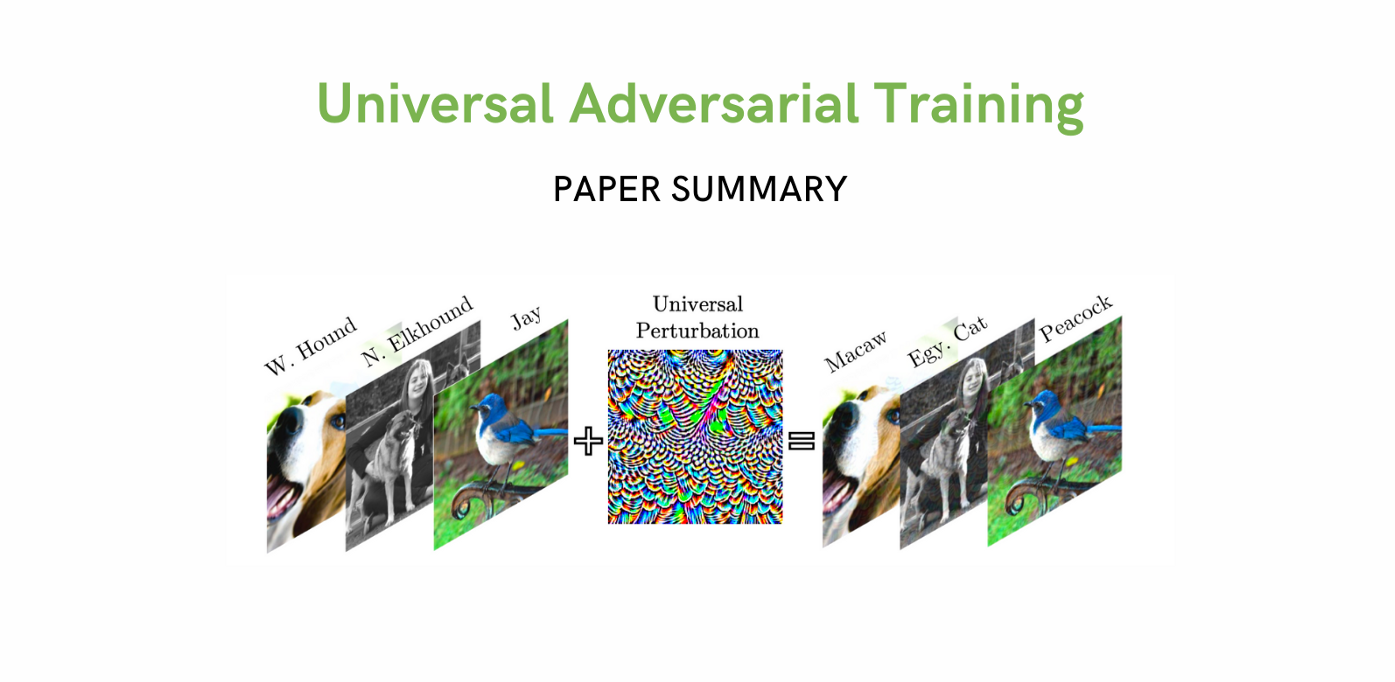

论文导读:Universal Adversarial Training

在这篇论文中,作者提出了一种优化的方法来找到给定模型的通用对抗样本(首先在 Moosavi-Desfooli 等人 [1] 中引入)。作者还提出了一种低成本算法来增强模型对此类扰动的鲁棒性。

强化学习 | 策略梯度 | Natural PG | TRPO | PPO

递进学习策略梯度:从 Gradient、Policy Gradient (REINFORCE、Q Actor-Critic、Advantage Actor-Critic ) 至 Natural Policy Gradient、TRPO、PPO 。逻辑清晰,含大量手写笔记,注释了黎曼流形、Hessia

【githubgirl】将 AI 艺术创作类的开源项目整合到了一起,包括图像风格迁移、图像卡通话

如果你正在尝试用 AI 来进行艺术创作,那么可以看下 ml4a 这个开源 Python 库。作者通过代码封装的方式,将 AI 艺术创作类的开源项目整合到了一起,包括图像风格迁移、基于素描的图像生成、图片分辨率增强、图像卡通话等模型。GitHub:github.com/ml4a/ml4a另外作者在每个

神经网络之基础理论

目录1.引言1.1 生物神经网络1.2 人工神经网络2.神经元基本结构2.1 输入2.2 处理2.2.1 加权求和2.2.2 激活函数2.3 输出3.神经网络结构3.1 输入层3.2 隐藏层3.3 输出层1.引言1.1 生物神经网络生物神经网络(Biological Neural Networks)

Python实现文字合成音频文件

Python技术哪家强?从此我是段子王!1. 创建应用2. 测试语音合成是否可用3. 工具人的觉悟——调个包,造个轮儿?4. 找段子素材合成音频(百度AI版本)5. 整个简单的——pyttsx3版本我将月亮缝入躯体,葬自我于山谷,如果那一天野花疯长,那便是我在讲最近正好有朋友找我问能不能把他的面试题

【基于Matlab和高斯-赛德尔迭代算法求电势及电场分布】

本项目利用高斯赛德尔迭代法。通过已知某区域边界的电势分布,可以求出内部电势及电场分布。下面写出代码供大家学习。

对Nuscenes数据集一无所知,手把手带你玩转Nusences数据集

文章目录Nuscenes数据集简介准备工作✨✨✨数据读取✨✨✨安装库导入相关模块和数据集场景scene⭐⭐⭐样本sample⭐⭐⭐样本数据 sample_data⭐⭐⭐样本标注 sample_annotation⭐⭐⭐实例 instance类别categories属性attributes⭐⭐⭐可视化

手把手教你绘制积分动图

手把手教你绘制积分动图

Pandas DataFrame 中的自连接和交叉连接

在本文中,介绍了如何在Pandas中使用连接的操作,以及它们是如何在 Pandas DataFrame 中执行的。

Pytorch教程[03]transforms

一.torchvision:计算机视觉工具包torchvision.transforms : 常用的图像预处理方法torchvision.datasets : 常用数据集的dataset实现,MNIST,CIFAR-10,ImageNet等torchvision.model : 常用的模型预训练,A