deeplab v3+ 源码详解

deeplab v3+默认使用voc数据集和cityspace数据集,图片预处理部分仅仅读取图片和对应的标签,同时对图片进行随机翻转、随机裁剪等常见图片预处理方式。

训练集、验证集、测试集的作用和划分比例?

训练集、验证集、测试集的作用和划分比例?

论文解读 ——TimesNet 模型

TimeNets 模型

YOLOV7训练自己的数据集以及训练结果分析(手把手教你)

YOLOV7训练自己的数据集以及训练结果分析(手把手教你)

high-resolution image synthesis with latent diffusion models

vae的生成器,是将标准高斯映射到数据样本,vae的后验是将数据样本映射到标准高斯(学出来的)。我现在想要设计一种方法A,使得A用一种简单的变分后验将数据样本映射到标准高斯,并且使得A的生成器,将标准高斯映射到数据样本,注意,因为生成器的搜索空间大于变分后验,vae的效率远不及A方法,因为A是学一个

Pytorch实现GCN(基于PyTorch实现)

本专栏整理了《图神经网络代码实战》,内包含了不同图神经网络的相关代码实现(PyG以及自实现),理论与实践相结合,如GCN、GAT、GraphSAGE等经典图网络,每一个代码实例都附带有完整的代码。

医学图像的深度学习的完整代码示例:使用Pytorch对MRI脑扫描的图像进行分割

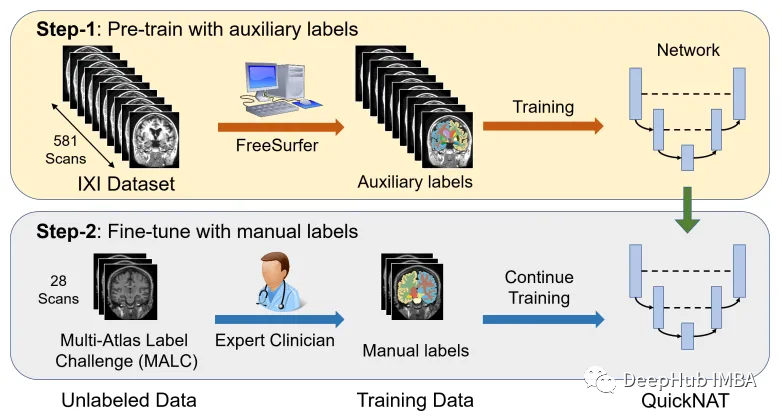

本文我们将介绍如何使用QuickNAT对人脑的图像进行分割。使用MONAI, PyTorch和用于数据可视化和计算的常见Python库,如NumPy, TorchIO和matplotlib。

反射填充详解ReflectionPad2d(padding)

这种填充方式是以输入向量的边界为对称轴,以设定的padding大小为步长,将输入向量的边界内padding大小的元素,对称填充。1)当padding=(2,2,1,1)时,表示向量以左、右、上、下边界为对称轴,左、右、上、下分别填充宽度为2,2,1,1的元素。1)当padding=(1,2)时,表示

2023年目标检测毕业设计(yolov5车辆识别、车辆检测、车牌识别、行人识别)

OpenCV提供的视觉处理算法非常丰富,并且它部分以C语言编写,加上其开源的特性,处理得当,不需要添加新的外部支持也可以完整的编译链接生成执行程序,所以很多人用它来做算法的移植,OpenCV的代码经过适当改写可以正常的运行在DSP系统和ARM嵌入式系统中。车牌区域的定位采用基于形状的方法。车牌的特征

注意力机制(四):多头注意力

多头注意力(Multi-Head Attention)是注意力机制的一种扩展形式,可以在处理序列数据时更有效地提取信息。在标准的注意力机制中,我们计算一个加权的上下文向量来表示输入序列的信息。而在多头注意力中,我们使用多组注意力权重,每组权重可以学习到不同的语义信息,并且每组权重都会产生一个上下文向

损失函数解读 之 Focal Loss

前言Focal loss 是一个在目标检测领域常用的损失函数,它是何凯明大佬在RetinaNet网络中提出的,解决了目标检测中正负样本极不平衡和 难分类样本学习的问题。论文名称:Focal Loss for Dense Object Detection目录什么是正负样本极不平衡?two-stage

数字孪生及深度学习资源分享专栏

数字孪生及深度学习(姿态识别方向)开源代码分享

YOLO V5 改进详解

YOLO V5 论文详解

关于硕士毕业论文中会议conference的参考文献格式修正GB7714-87#outputstyle#endnote

1问题描述在硕士毕业论文中需要按照GB7714-87的参考文献引用标准对会议论文进行参考文献格式规范GB7714-87中的要求如图:(因为我们文中引用的论文一般 不会是论文集,而是论文集合中析出的一篇文章,so这个格式非常复杂,原本下载的outputstyle中没有现成的格式,所以需要手动修正)![

ControlNet引导生成图像的详细教程

controlnet引导stable diffusion生成图像使用教程,边缘检测、深度估计、涂鸦、分割等

使用新版FLIR (FLIR_ADAS_v2) 红外数据集训练基于pytorch的YOLOv7模型

本文主要介绍了如何使用新版FLIR (FLIR_ADAS_v2) 红外数据集来训练基于pytorch的YOLOv7模型

【Linux】CUDA Toolkit和cuDNN版本对应关系(更新至2022年6月,附官网永久更新链接)

NVIDIA® CUDA® Toolkit 为创建高性能 GPU 加速应用程序提供了一个开发环境。借助 CUDA 工具包,您可以在 GPU 加速的嵌入式系统、桌面工作站、企业数据中心、基于云的平台和 HPC 超级计算机上开发、优化和部署您的应用程序。该工具包包括 GPU 加速库、调试和优化工具、C/

目标检测算法——YOLOv5/v7/v8改进结合涨点Trick之Wise-IoU(超越CIOU/SIOU)

WIoU 可以聚焦于普通质量的锚框,并提高检测器的整体性能。将WIoU应用于最先进的单级检测器 YOLOv7 时,在 MS-COCO 数据集上的 AP-75 从 53.03% 提升到 54.50%。

道路裂缝坑洼图像开源数据集汇总

数据集下载链接:http://suo.nz/2wdNdXCrackForest数据集是一个带注释的道路裂缝图像数据库,可以大致反映城市路面状况。道路裂缝坑洼图像数据集数据集下载链接:http://suo.nz/3eEDlj这个数据集是一个极具挑战性的集合,包含 5,000 多张野外道路上的坑洼图像。

深度学习常用损失MSE、RMSE和MAE

三种常见损失总结,MSE、RSME、MAE