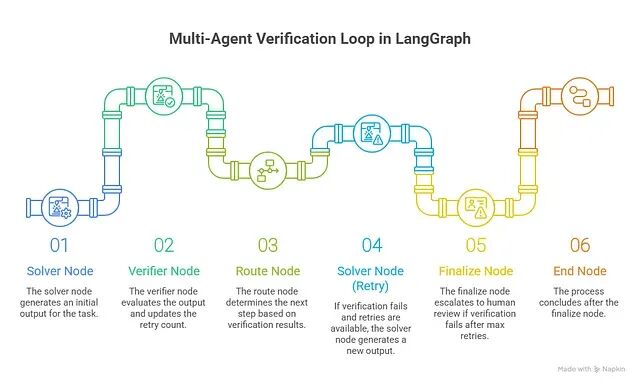

多 Agent 验证架构实战:从输出评分到过程验证

正确构建验证层需要理解四种不同的架构模式、各自的失效边界,以及一个被多数团队忽视的规律。

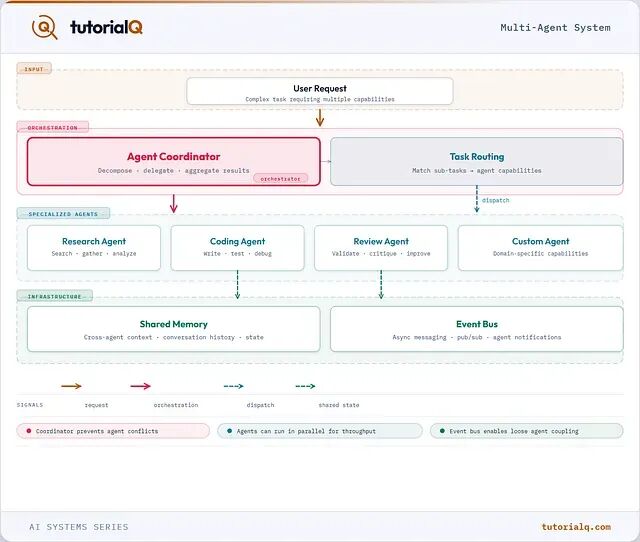

多智能体系统的核心设计:从任务分解到依赖图驱动的编排循环

多智能体系统将复杂任务分配给各自拥有独立角色、工具和评估标准的专门智能体。

AI Agent 架构详解:Chain-of-Thought、ReAct 与工具调用的协作机制

这篇文章填的就是这个空白。从用户输入"帮我订机票"到 AI 点击"确认",每一步都用架构图拆开来看。

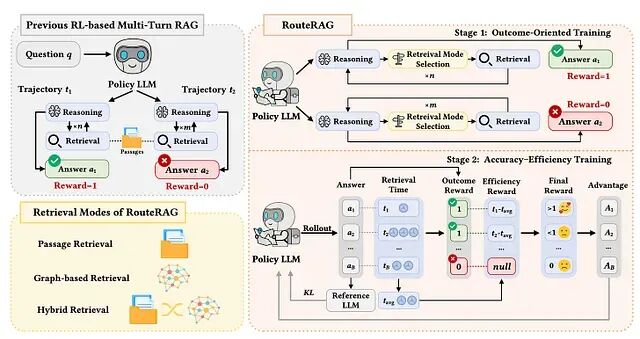

RouteRAG:用特殊 Token 和强化学习构建可学习的 RAG 检索策略

RouteRAG 把多轮 RAG 重新建模为序列决策过程。

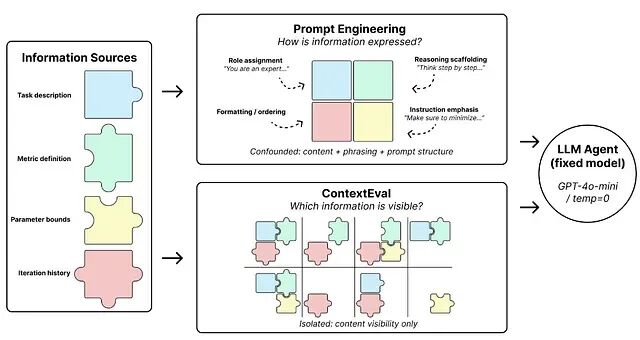

信息访问 vs. 推理能力:LLM Agent 性能归因的实验分析

LLM agent 看起来越来越智能了。但实际上它们可能只是拿到了更多信息。

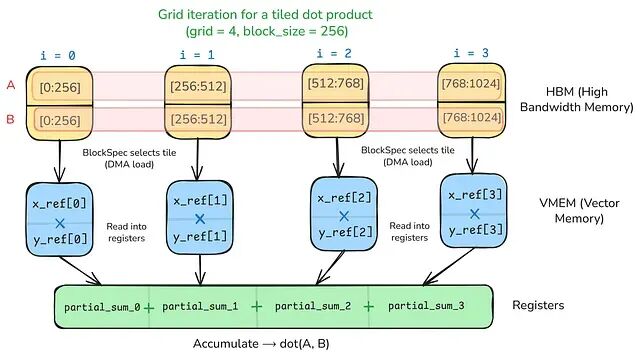

TPU 架构与 Pallas Kernel 编程入门:从内存层次结构到 FlashAttention

本文通过四个复杂度递增的 kernel 展示了 Pallas 的核心编程模式

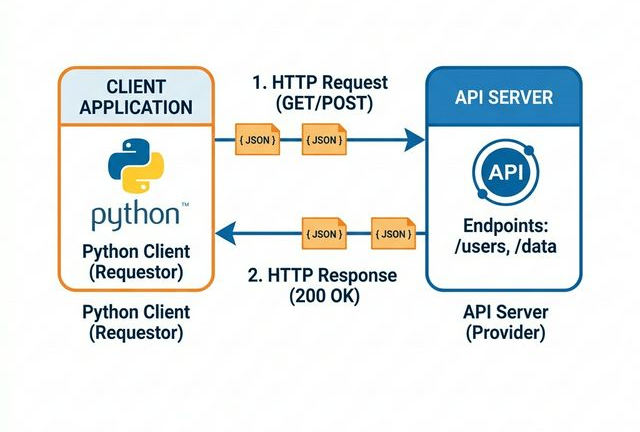

腾讯微信OpenClaw插件API通信过程剖析与Python原生代码复刻原理

本文将介绍如何不装 OpenClaw,直接把协议扒出来,并用 Python 复刻 。

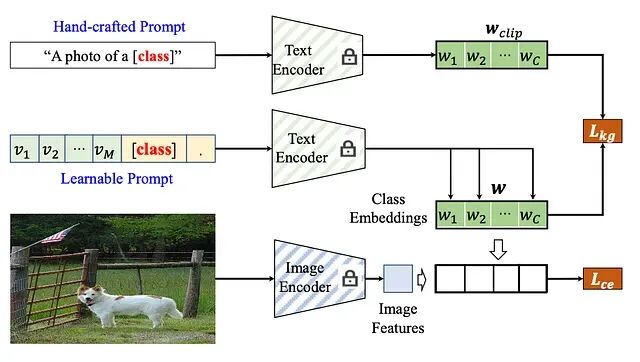

知识引导上下文优化(KgCoOp):一种解决灾难性遗忘的 Prompt Tuning 机制

如何使用知识引导损失对可学习 Prompt 进行正则化以保持泛化能力。

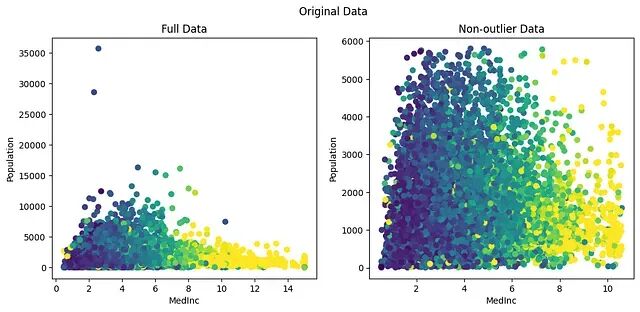

数值特征工程中的四种缩放方法:原理、适用场景与局限性

数值特征工程是机器学习模型训练中不可跳过的预处理环节。处理数值数据时需要面对两个核心问题:特征的量级差异和异常值。

9个提升Python代码生产质量的第三方库

这9个库覆盖了日常开发中几个反复出现的痛点:嵌套数据访问、标准库功能缺失、运行时类型安全、错误处理模式、时区陷阱、性能分析、测试断言、重试机制和数据管道。

Claude Code 命令体系解析:三种类型、七大分类、50+ 命令

这篇文章覆盖每一个斜杠命令、每一个 CLI 标志、每一个键盘快捷键,以及开发团队从未正式宣布就悄悄上线的隐藏功能

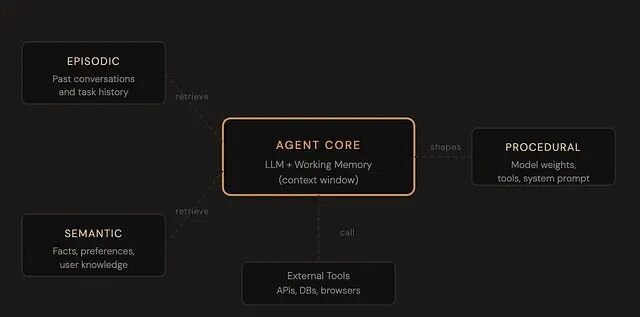

理解 Agent 记忆:从无状态模型到持久化记忆架构

Agent 记忆并非单一概念,它是一个四层体系,各层服务于不同目的。

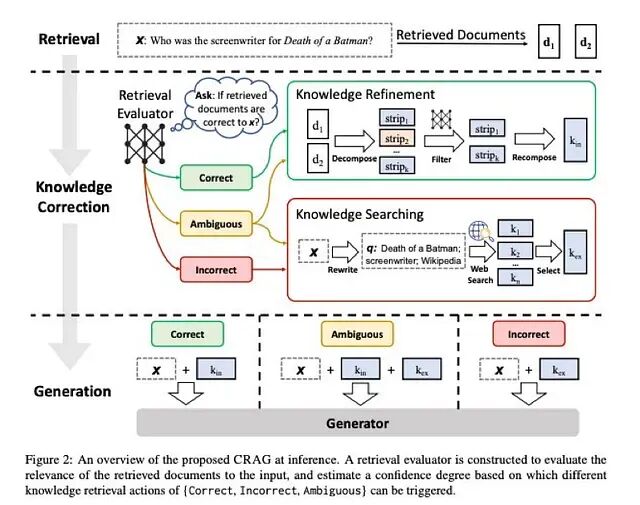

CRAG 架构解析:如何在生成器前修正错误检索结果

绝大多数 RAG 系统把检索当作不会出错的环节,无论拿到的文档是否真正切题,都会径直送入生成器。

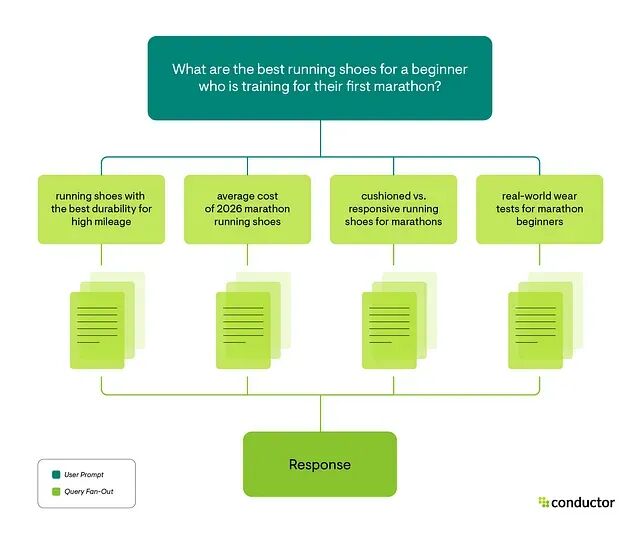

高级 RAG 技术:查询转换与查询分解

基础 RAG 的准确性受制于查询质量,查询模糊、表述不当,或者用户对问题的抽象层次把握不准,检索结果就会出偏差,LLM 拿到的上下文也跟着失真。

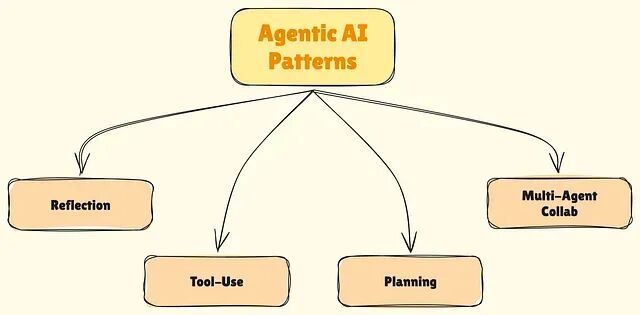

构建生产级 AI Agent 系统的4大主流技术:反思、工具、规划与多智能体协作

本文拆解当下重塑AI系统构建方式的4种核心 Agentic 模式,分析每种模式的工作机制、适用场景,以及如何将它们组合出真正可用的系统。

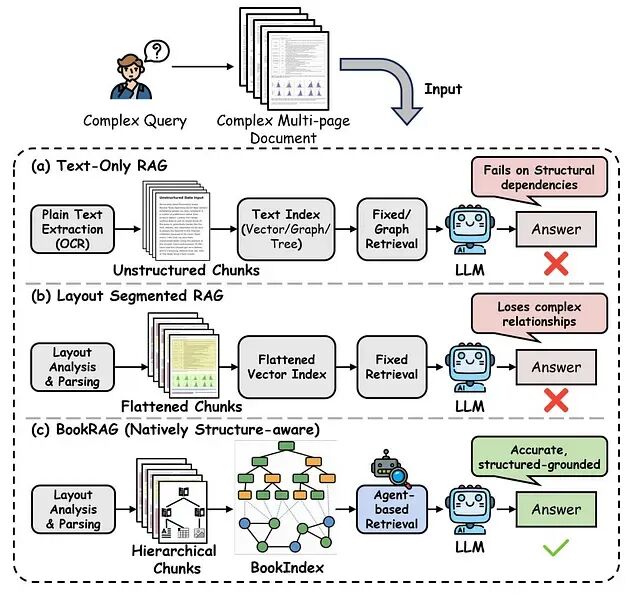

BookRAG:面向层级文档的树-图融合RAG框架

本文介绍的BookRAG或许能提供一个有用的视角。

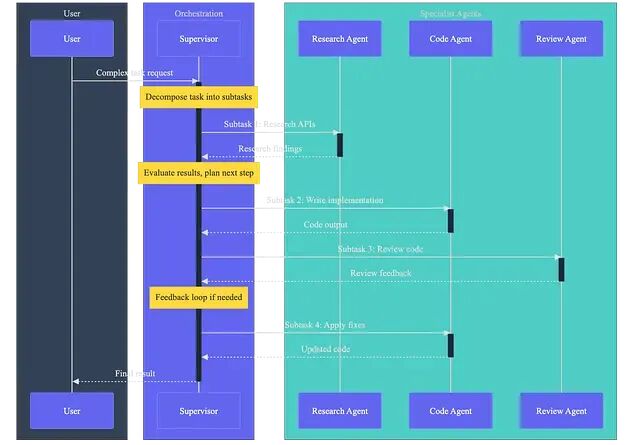

多智能体系统的三种编排模式:Supervisor、Pipeline 与 Swarm

当单个智能体确实力的确无法解决,任务需要多种能力、独立验证或动态路由,精心编排的智能体团队是目前见过的最可靠的解法。

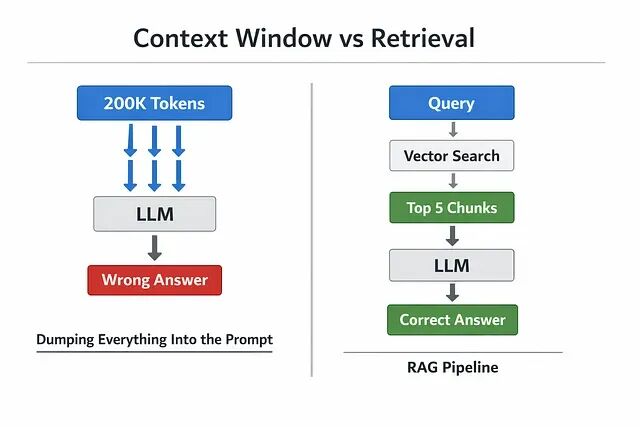

更大的上下文窗口为什么让RAG变得更重要而非更多余

在不少实际系统中,更大的上下文窗口反而拖累了模型表现。

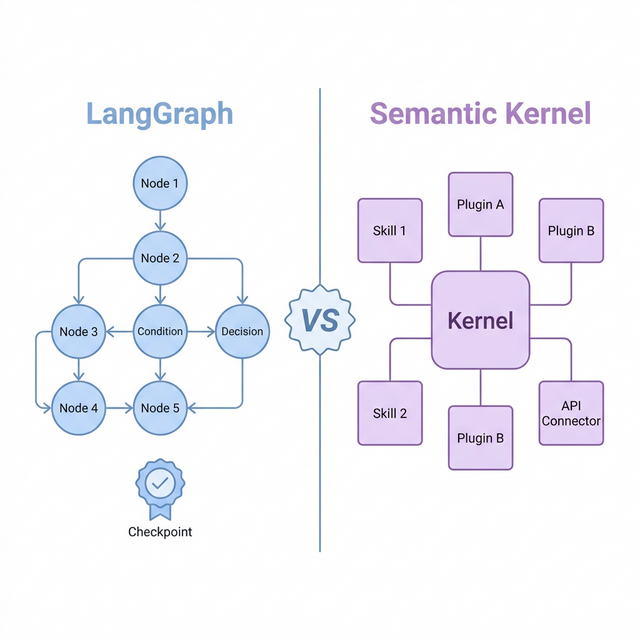

LangGraph vs Semantic Kernel:状态图与内核插件的两条技术路线对比

本文依据 LangGraph 官方文档、Semantic Kernel 官方文档以及两个框架的变更日志写成。

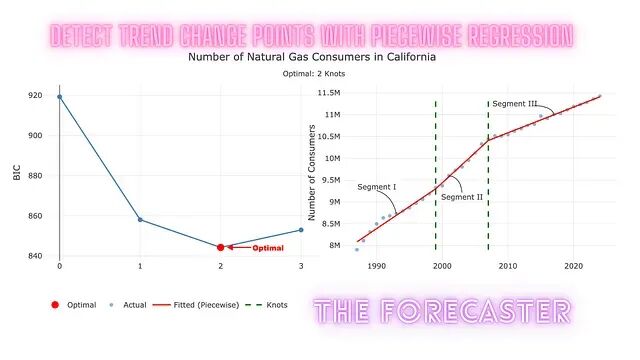

基于网格搜索与分段回归的时间序列变化点检测方法

传统统计方法在时间序列分析中既简洁又有力,但面对大规模时间序列集合时,扩展性往往不尽如人意。现实中的趋势变化往往微弱、带有噪声、数量也不止一个,靠肉眼判断既不可靠也不现实。