【人工智能】大模型的发展历史

2012年以后的深度学习热潮:2012年,AlexNet横空出世,以卷积神经网络(CNN)为代表的深度学习模型在计算机视觉任务中取得了巨大突破,吸引了越来越多的计算机科学家和工程师投入深度学习研究和应用。:2018年,Google推出了基于Transformer的预训练模型BERT,通过大量无标签文

基于ChatGPT实现AI软件研发 | 神经网络 | 数据

这是一本讲解以ChatGPT/GPT-4为代表的大模型如何为软件研发全生命周期赋能的实战性著作。它以软件研发全生命周期为主线,详细讲解了ChatGPT/GPT-4在软件产品的需求分析、架构设计、技术栈选择、高层设计、数据库设计、UI/UX 设计、后端应用开发、Web 前端开发、软件测试、系统运维、技

神经网络的发展历史

论文中提出了人工神经网络的概念,并给出了人工神经元的数学模型,从而开创了人工神经网络研究的时代。

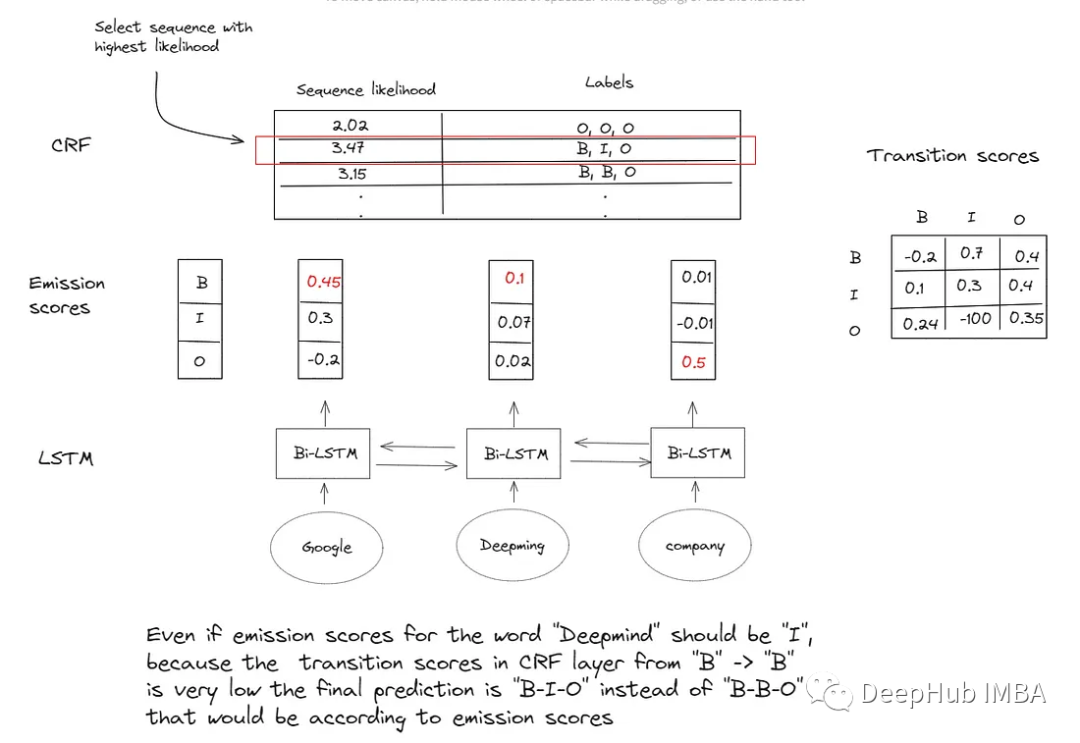

LSTM-CRF模型详解和Pytorch代码实现

本文中crf的实现并不是最有效的实现,也缺乏批处理功能,但是它相对容易阅读和理解,因为本文的目的是让我们了解crf的内部工作,所以它非常适合我们。

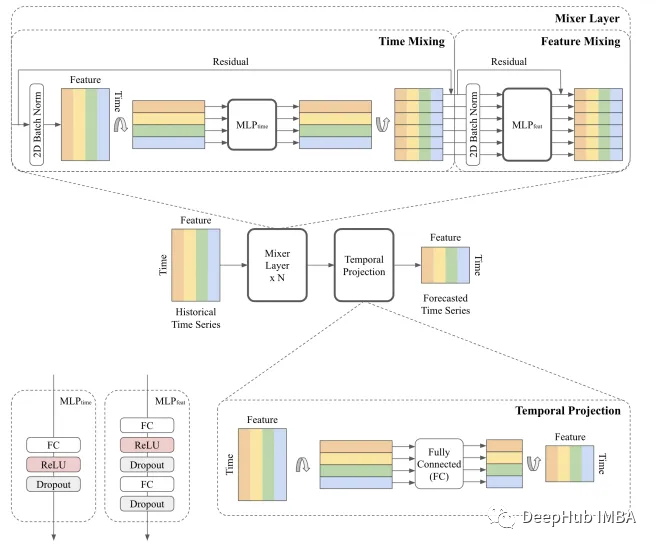

TSMixer:谷歌发布的用于时间序列预测的全新全mlp架构

这是谷歌在9月最近发布的一种新的架构 TSMixer: An all-MLP architecture for time series forecasting

深度学习技巧应用2-神经网络中的‘残差连接’

残差连接通过直接将前一层的输出加到后一层的输入中,使得梯度能够更容易地传递到前一层,从而使得深度神经网络的训练更加容易。由于深层网络容易出现梯度消失或梯度爆炸的问题,因此可以通过残差连接的方式,将网络的深度扩展到数十层以上,从而提高模型的性能。残差连接的基本思想是,在网络的某些层中,将输入的信号直接

常见注意力机制解析

详细解析多种注意力机制!

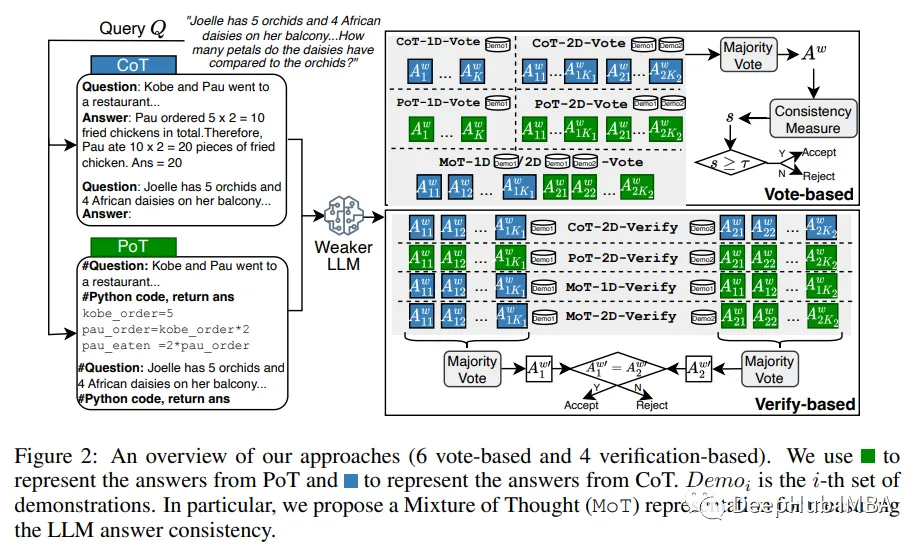

9月大型语言模型研究论文总结

这些论文涵盖了一系列语言模型的主题,从模型优化和缩放到推理、基准测试和增强性能。最后部分讨论了有关安全训练并确保其行为保持有益的论文。

机器学习和人工智能如何改变未来的就业和职业发展

在开始探讨人工智能和机器学习技术如何改变未来的就业和职业发展之前,我们先来了解一下这些技术的相关术语和概念。随着人工智能和机器学习技术的不断发展和普及,它们已经成为了未来职业发展的重要方向之一。无论是在生产制造、金融投资还是医疗保健领域,这些技术都将会带来更多的机遇和挑战。未来,人工智能和机器学习技

人工智能:神经细胞模型到神经网络模型

1969年,美国麻省理工学院(MIT)出版了关于感知机的专著《Perceptrons:An Introduction to Computational Geometry》,作者为明斯基(M.L.Minsky)等,对简单感知机的研究结果进行了总结与系统的分析,指出简单感知机有严重的缺陷,无法识别线性

什么是卷积

此文章简单讲解了卷积是什么、卷积为什么这么厉害、卷积神经网络是什么。

注意力机制

在神经网络学习中,一般而言模型的参数越多则模型的表达能力越强,模型所存储的信息量也越大,但这会带来信息过载的问题。通过引入注意力机制,在众多的输入信息中聚焦于对当前任务更为关键的信息,降低对其他信息的关注度,甚至过滤掉无关信息,就可以解决信息过载问题,并提高任务处理的效率和准确性。

【人工智能】深度强化学习的新突破:如何打造智能决策系统

在深度强化学习中,有很多的概念和术语需要我们去了解。本文介绍了深度强化学习技术的相关概念、原理及应用,以及如何使用深度强化学学实现智能决策系统。在深度强化学习中,模型设计、数据集选择、模型评估和应用场景都是需要我们注意的重要因素。通过实际案例的演示,我们可以看到深度强化学习技术在实践中的应用和实现过

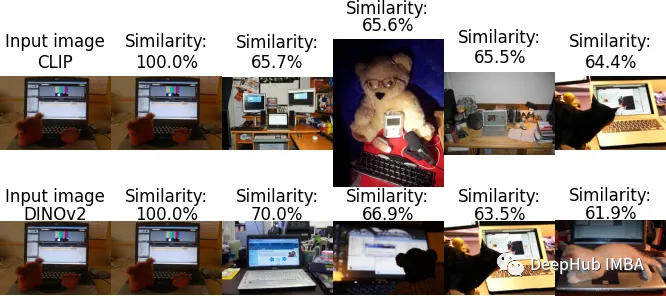

CLIP与DINOv2的图像相似度对比

在本文中,我们将探讨CLIP和DINOv2的优势和它们直接微妙的差别。我们的目标是发现哪些模型在图像相似任务中真正表现出色。

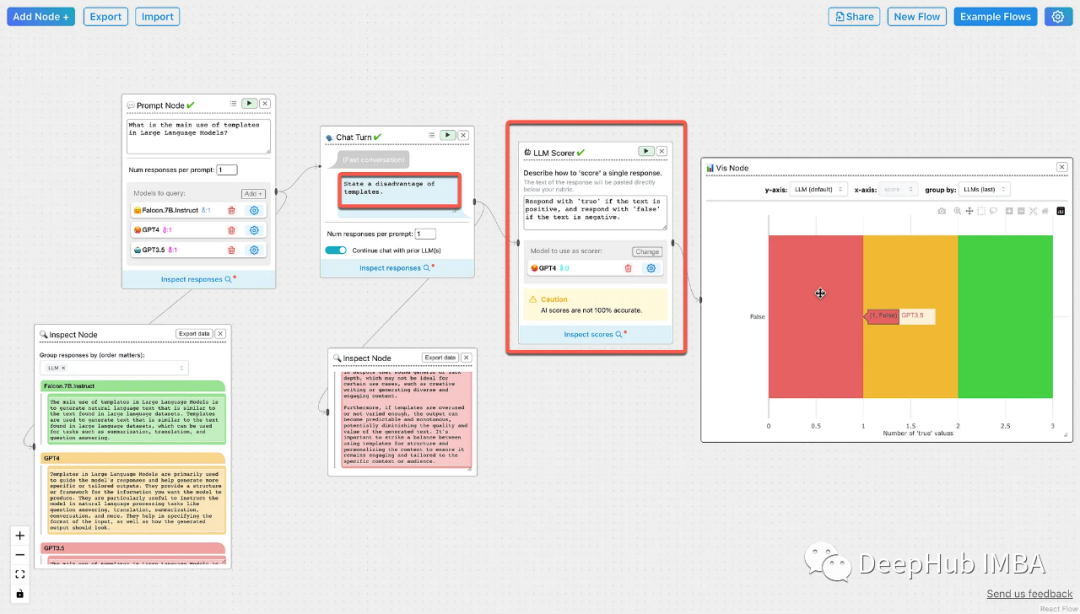

ChainForge:衡量Prompt性能和模型稳健性的GUI工具包

ChainForge是一个用于构建评估逻辑来衡量模型选择,提示模板和执行生成过程的GUI工具包。ChainForge可以安装在本地,也可以从chrome浏览器运行。

Batchnorm 和Layernorm 区别

对比Batchnorm和Layernorm的区别

9月人工智能论文和项目推荐

因为LLM的火爆,所以最近的论文都是和LLM相关的

基于Transformer(卷积神经网络、循环神经网络)的情感分类研究

把C:\Program Files\NVIDIA Corporation\NVSMI添加到环境变量的path中。再重新打开cmd窗口。'nvidia-smi' 不是内部或外部命令,也不是可运行的程序。注意:安装时勾选“Python开发”和“C++桌面开发”搭建虚拟环境和pytorch软件平台。下载之

【探索AI潜能,连结现代通讯】相隔万里,我们与AI一同赏月。

近年来,AI得到了迅猛的发展,尤其是大模型的出现受到了广泛的关注和讨论🚀。ChatGPT、文心一言等纷纷登场,可谓是百家争鸣❗而AI大模型所延申出的子项目如AI绘画、AI写作等,在各自的领域展示出了惊人的潜力⚙️。最圆的月亮在中秋🌔,最好的团聚在家里🏠。然而许多人为生活工作奔波,难得与家人相聚

深度学习模型复杂度评估(时间复杂度、空间复杂度)

由于维度灾难的限制,模型的参数越多,训练模型所需的数据量就越大,而现实生活中的数据集通常不会太大,这会导致模型的训练更容易过拟合。时间复杂度和空间复杂度是衡量一个算法的两个重要指标,用于表示算法的最差状态所需的时间增长量和所需辅助空间.如果复杂度过高,会导致模型训练和预测耗费大量时间,既无法快速的验