RAG 文本分块:七种主流策略的原理与适用场景

分块就是在生成 Embedding 之前,把大段文本拆成更小语义单元的过程。检索器真正搜索的对象而不是整篇文档就是这些分块。

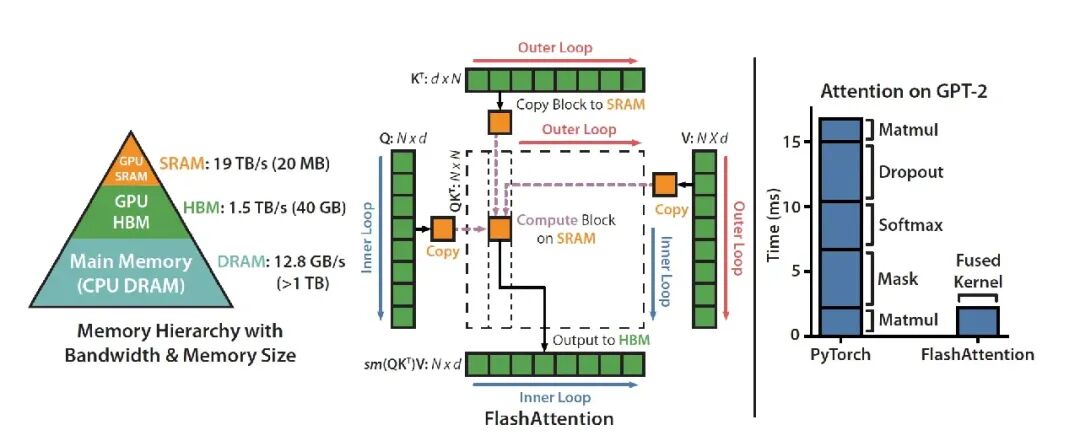

从零开始用自定义 Triton 内核编写 FlashAttention-2

本文只实现了前向传播。扩展到完整的训练级 FlashAttention(反向传播、dropout、各种 mask 变体)留待后续工作。

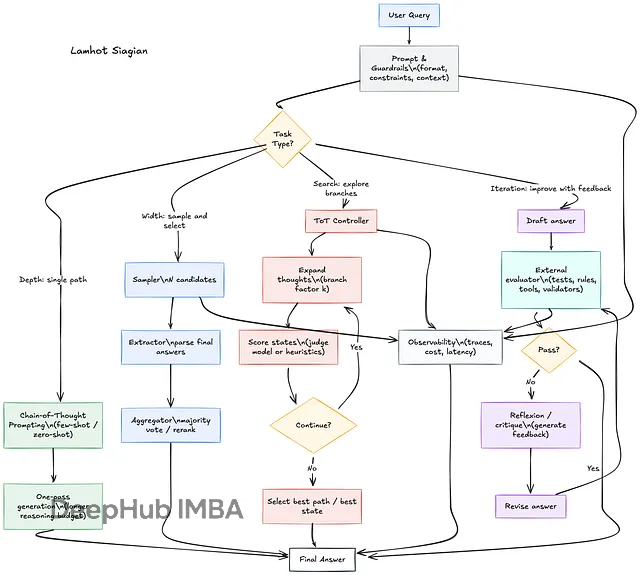

LLM推理时计算技术详解:四种提升大模型推理能力的方法

本文要讲四种主流的推理时计算技术:深度方向的Chain-of-Thought,宽度方向的Self-Consistency,搜索方向的Tree-of-Thoughts,以及迭代方向的Reflexion/Self-Refine。

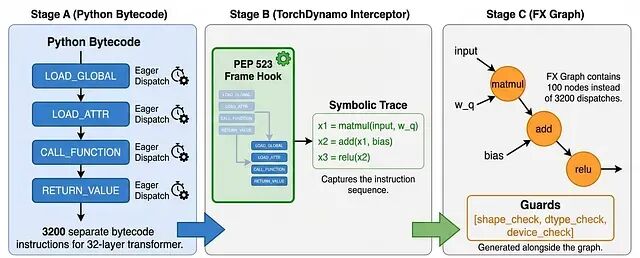

torch.compile 加速原理:kernel 融合与缓冲区复用

torch.compile 的价值在于:它把原本需要手写 CUDA 或 Triton 才能实现的优化,封装成了一行代码的事情。

让 AI 智能体学会自我进化:Agent Lightning 实战入门

本文将介绍 Agent Lightning 的核心架构和使用方法,并通过一个开源的"自修复 SQL 智能体"项目演示完整的训练流程。

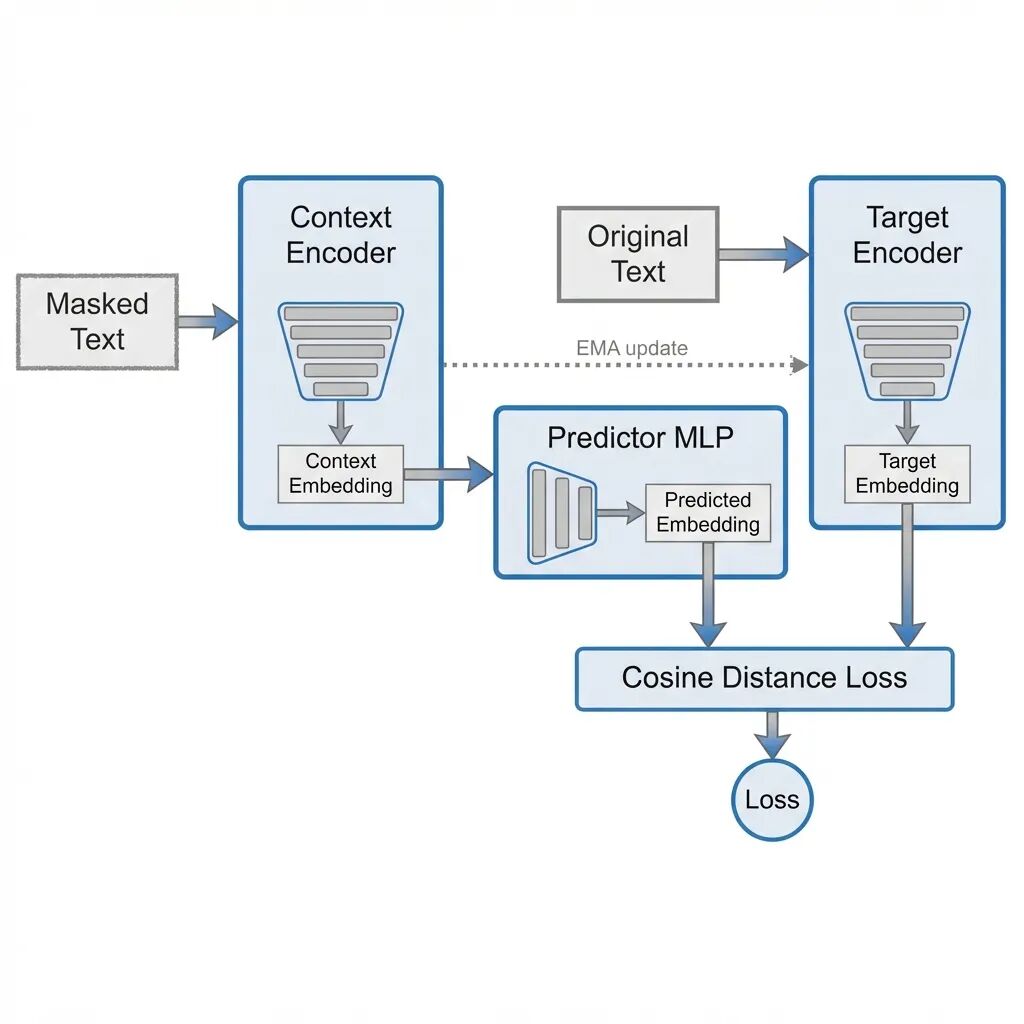

用 PyTorch 实现 LLM-JEPA:不预测 token,预测嵌入

这篇文章从头实现 LLM-JEPA: Large Language Models Meet Joint Embedding Predictive Architectures。

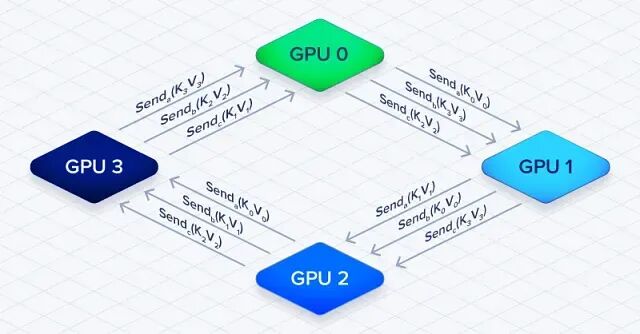

大模型如何训练百万 Token 上下文:上下文并行与 Ring Attention

上下文并行本质上是拿通信开销换内存空间,把输入序列切到多张 GPU 上,突破训练时的内存限制

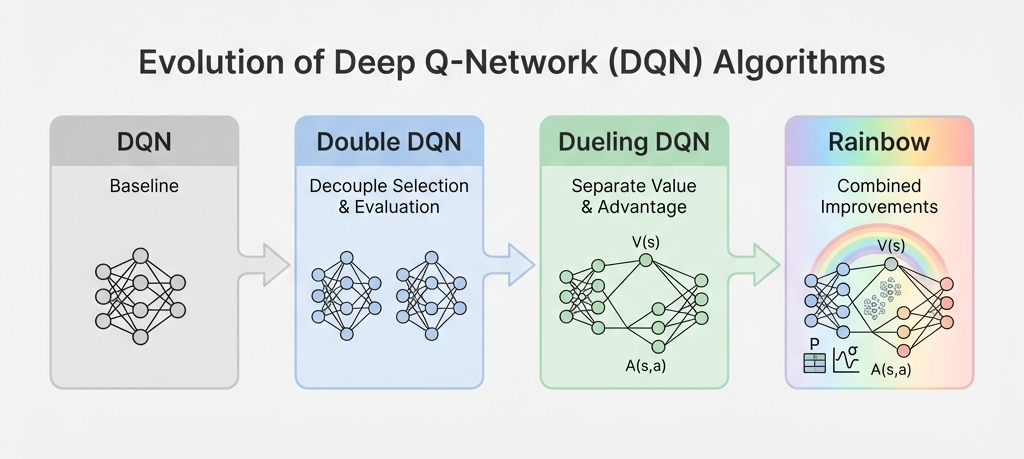

让 Q 值估计更准确:从 DQN 到 Double DQN 的改进方案

这篇文章要内容包括:DQN 为什么会过估计、Double DQN 怎么把动作选择和评估拆开、Dueling DQN 怎么分离状态值和动作优势、优先经验回放如何让采样更聪明,

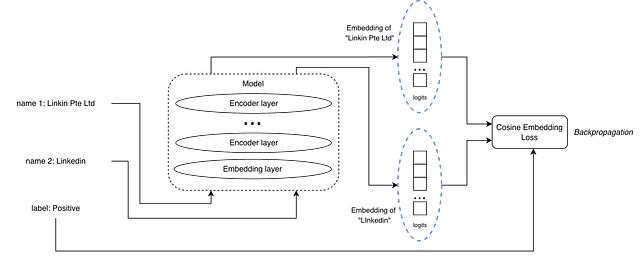

RAG 检索模型如何学习:三种损失函数的机制解析

本文将介绍我实验过的三种方法:Pairwise cosine embedding loss(成对余弦嵌入损失)、Triplet margin loss(三元组边距损失)、InfoNCE loss。

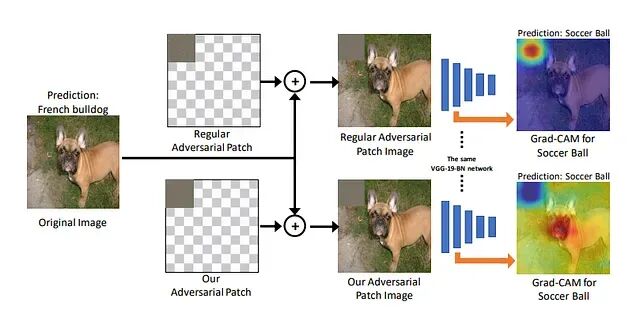

对抗样本:20行Python代码让95%准确率的图像分类器彻底失效

本文会用FGSM(快速梯度符号法)演示如何制作对抗样本,并解释神经网络为何如此脆弱。

用提示工程让大模型自己检查自己:CoVe方法有效减少幻觉

Chain-of-Verification(CoVe)的思路是既然模型会在生成时犯错,那就让它生成完之后再检查一遍自己的输出,把能发现的错误纠正掉,然后再给用户看。

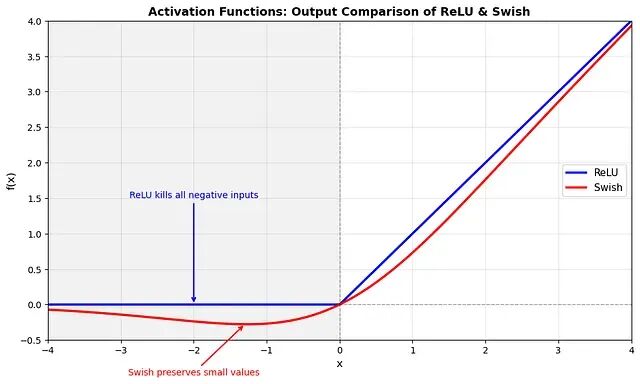

为什么所有主流LLM都使用SwiGLU?

本文的目标是解释为什么现代LLM架构在前馈部分使用 ``` SwiGLU ``` 作为激活函数并且已经放弃了 ``` ReLU ```

多智能体强化学习(MARL)核心概念与算法概览

单智能体 RL 适合系统只有一个"大脑"的情况,而MARL 则出现在世界有多个"大脑"的时候。

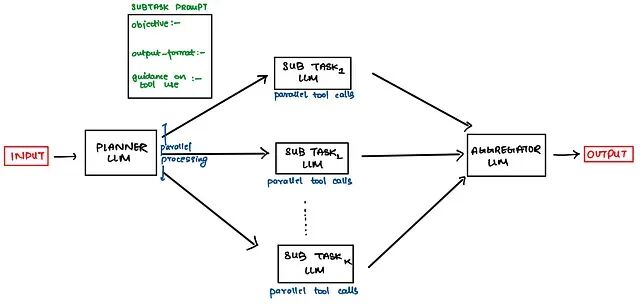

深度研究Agent架构解析:4种Agent架构介绍及实用Prompt模板

这篇文章将整理这些架构并顺便附上一些实用的prompt模板。

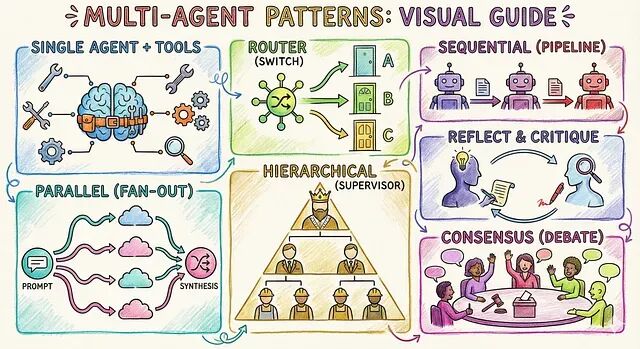

别再往一个智能体里塞功能了:6种多智能体模式技术解析与选型指南

这篇文章整理了 6 种经过验证的多智能体架构模式,可以有效的帮你解决问题。

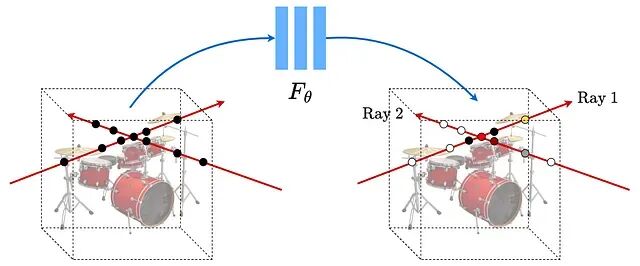

神经辐射场NeRF入门:3D视图合成的原理与PyTorch代码实现

NeRF(Neural Radiance Fields,神经辐射场)的核心思路是用一个全连接网络表示三维场景。

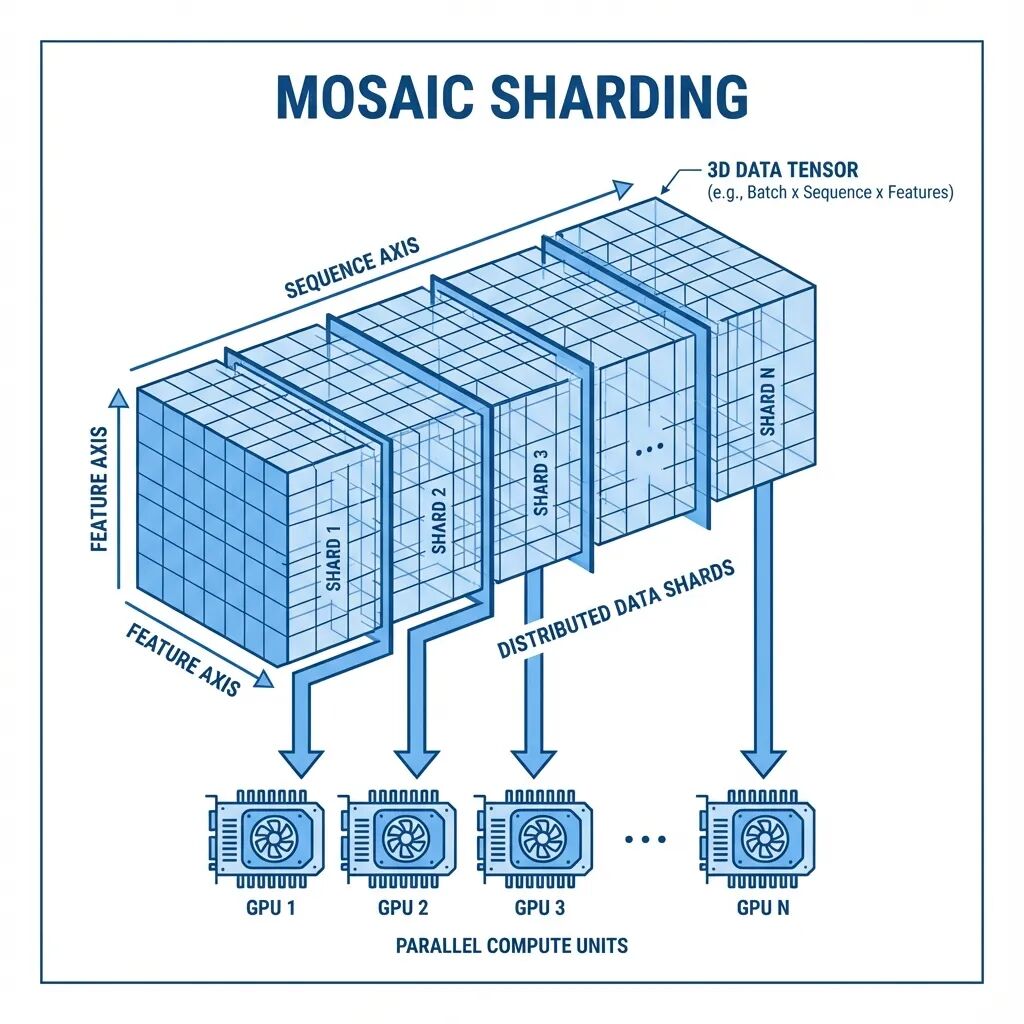

Mosaic:面向超长序列的多GPU注意力分片方案

本文从一个具体问题出发,介绍Mosaic这套多轴注意力分片方案的设计思路。

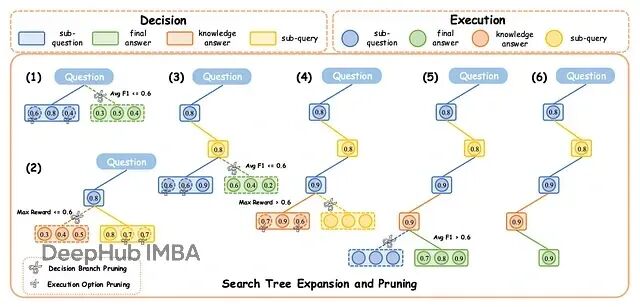

DecEx-RAG:过程监督+智能剪枝,让大模型检索推理快6倍

DecEx-RAG 把 RAG 建模成一个马尔可夫决策过程(MDP),分成决策和执行两个阶段。

JAX性能优化实战:7个变换让TPU/GPU吃满算力

我们今天就来总结7个能够提高运行速度的JAX变换组合

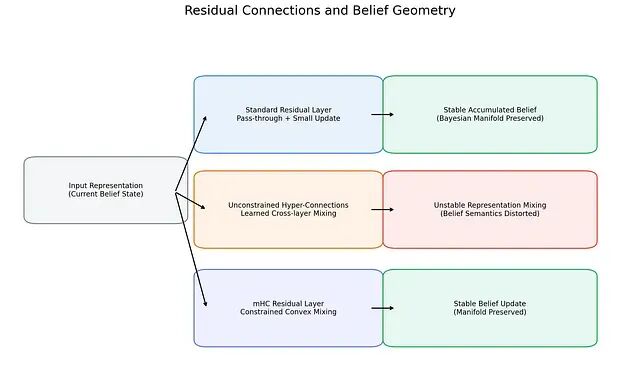

从贝叶斯视角解读Transformer的内部几何:mHC的流形约束与大模型训练稳定性

近期研究揭示了一个有趣的现象:Transformer内部确实在执行贝叶斯推理:只不过不是符号化的方式而是几何化的。