使用神经网络实现对天气的预测

使用神经网络实现对天气的预测

算法 | A*算法实现最优路径规划

启发式探索是利用问题拥有的启发信息来引导搜索,达到减少探索范围、降低问题复杂度的目的。A*寻路算法是启发式探索的一个典型实践,在寻路搜索的过程中,给每个节点绑定了一个估计值(即启发式),在对节点的遍历过程中采取估计值优先原则,估计值更优的节点会被优先遍历。...

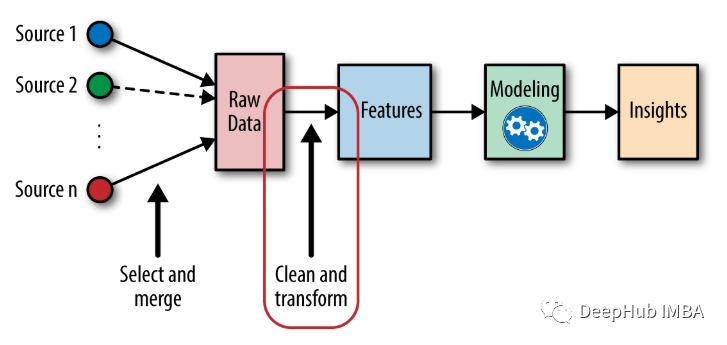

特征工程中的缩放和编码的方法总结

数据预处理是机器学习生命周期的非常重要的一个部分。特征工程又是数据预处理的一个重要组成,在本文中主要介绍特征缩放和特征编码的主要方法。

【机器学习算法】神经网络与深度学习-5 深度学习概述

深度学习概述,为之后普通深度网络DNN和深度信念网络DBN(会在自动特征学习中说其中的一种,它的变型太多了)和卷积神经网络CNN,打下框架

c语言:深度学习递归

此篇是针对递归的学习,希望大家可以通过这几个问题来加深对递归的理解!

【机器学习网络】BP神经网络与深度学习-6 深度神经网络(deep neural Networks DNN)

深度神经网络(deep neural Networks DNN)

100天精通Python(数据分析篇)——第48天:数据分析入门知识

数据分析入门知识:1. 为什么要学数据分析?2. 数据分析的概念3. 数据分析涉及哪些能力4. 数据分析的流程5. Python做数据分析学什么?

cpu和gpu已过时,npu和apu的时代开始

🌎CPU是中央处理器。其实就是机器的“大脑”,也是布局谋略、发号施令、控制行动的“总司令官”。CPU的结构主要包括运算器(ALU,ArithmeticandLogicUnit)、控制单元(CU,ControlUnit)、寄存器(Register)、高速缓存器(Cache)和它们之间通讯的数据、控制

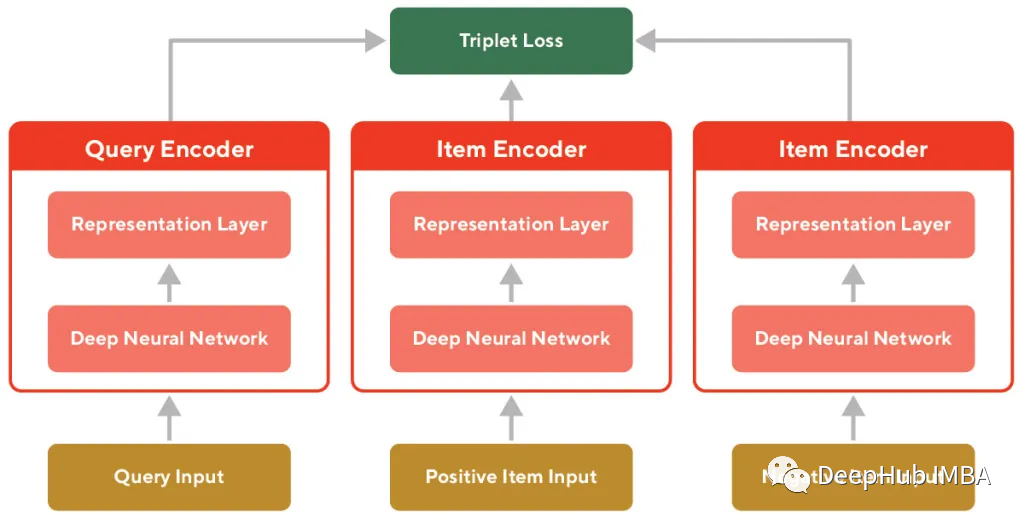

使用三重损失和孪生神经网络训练大型类目的嵌入表示

在这篇文章中,描述了一种通过在网站内部的用户搜索数据上使用自监督学习技术来训练高质量的可推广嵌入的方法。

【机器学习算法】神经网络和深度学习-4 重要的BP网络使用总结,了解BP神经网络的魅力

为什么我们把神经网络叫做黑盒子(black box),BP神经网络能解决哪几种类型的问题。本篇文章进行了总结

【Python数据科学快速入门系列 | 01】Numpy初窥——基础概念

NumPy是Python中科学计算的基础包。它是一个Python库,提供多维数组对象,各种派生对象(如掩码数组和矩阵),以及用于数组快速操作的各种API,包括数学、逻辑、形状操作、排序、选择、输入输出、离散傅立叶变换、基本线性代数,基本统计运算和随机模拟等等。Numpy底层是用C语言实现的,所以其计

机器学习强基计划0-4:通俗理解奥卡姆剃刀与没有免费午餐定理

脱离具体应用场景空谈学习算法的优劣毫无意义,这就是机器学习视角下的“天下没有免费午餐”定理”。本文详细总结机器学习领域的若干重要指导思想,为机器学习领域的探索建立理论指导

当opencv遇上打篮球

用opencv整个活,仅供娱乐

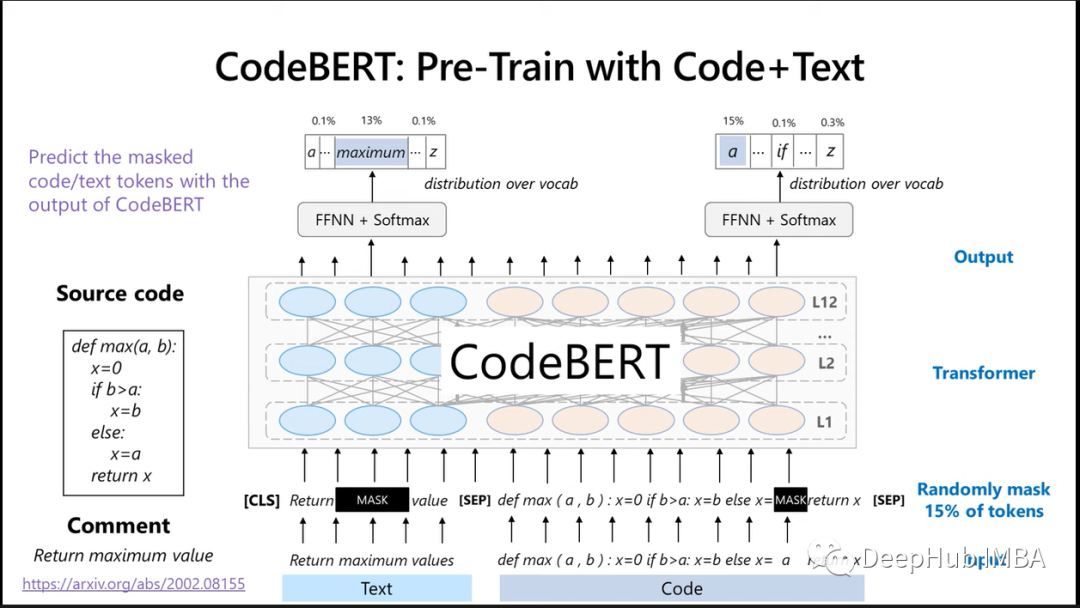

代码的表示学习:CodeBERT及其他相关模型介绍

本文将对论文进行简要概述,并使用一个例子展示如何使用。在最后除了CodeBert以外,还整理了最近一些关于他的研究之上的衍生模型。

【FreeSwitch开发实践】专栏简介

首先,FreeSwitch是一个软电话交换平台的开源框架,由C语言开发,可以用来开发智能客服、自动外呼系统等。本专栏主要介绍博主在实际项目中使用FreeSwitch开发外呼类项目的一些经验心得,主要涉及FreeSwitch的基本安装编译、基本配置、ESL、WSS、录音、自定义模块、mediabug、

【机器学习算法】神经网络和深度学习-1 神经网络概述和感知机介绍

神经网络与深度学习是最近的热门话题,产生了很多人工智能上的应用。神经网络概述和感知机介绍

【深度学习计算机指令系统,彻底搞懂指令十大寻址方式】

我在之前的文章专栏已经系统地为大家讲解了计算机最基本的组成框架、存储器、高速缓冲存储器,计算机的下一个重要部分就是CPU了,可是再介绍CPU之前,我们不得不先介绍一下计算机指令系统,因为这个可以说是使得计算机正常运转的核心,我们也可以借助指令系统对于之前的给大家讲解的内容也是一种巩固。例如以上就是今

CPU、GPU、NPU的区别

CPU、GPU、NPU的区别

利用opencv 做一个简单的人脸识别

opencv人脸识别