AI:155-基于深度学习的股票价格预测模型

AI:155-基于深度学习的股票价格预测模型股票价格预测一直是金融领域中备受关注的话题之一。随着人工智能技术的不断发展,特别是深度学习的兴起,利用神经网络进行股票价格预测成为了一种热门方法。本文将介绍如何利用深度学习构建股票价格预测模型,并提供一个简单的代码实例。

AI:152- 利用深度学习进行手势识别与控制

AI:152- 利用深度学习进行手势识别与控制随着人工智能技术的不断发展,深度学习在手势识别与控制领域的应用越来越广泛。本文将介绍深度学习在手势识别与控制中的原理和方法,并提供一个基于深度学习的手势识别与控制的简单代码示例。人工智能技术的快速发展为人们带来了许多新的应用场景,其中之一便是手势识别与控

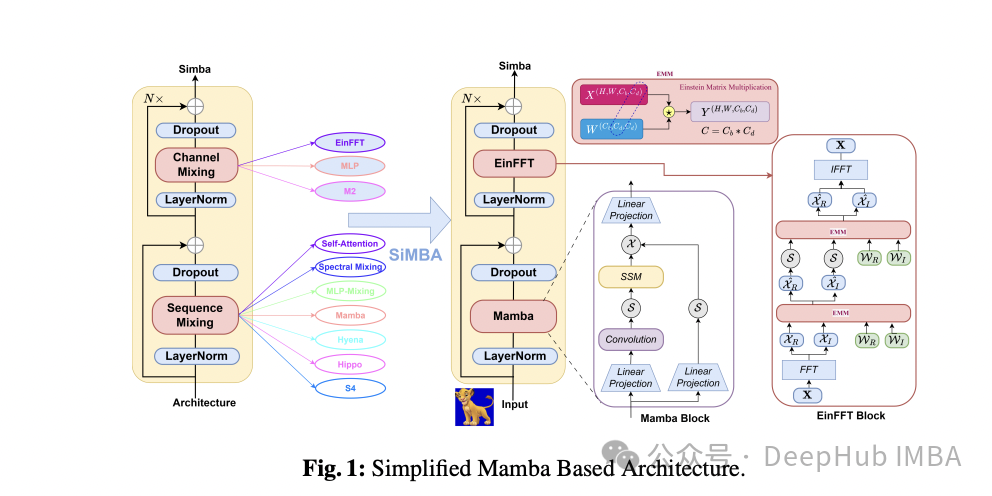

SiMBA:基于Mamba的跨图像和多元时间序列的预测模型

这是3月26日新发的的论文,微软的研究人员简化的基于mamba的体系结构,并且将其同时应用在图像和时间序列中并且取得了良好的成绩。

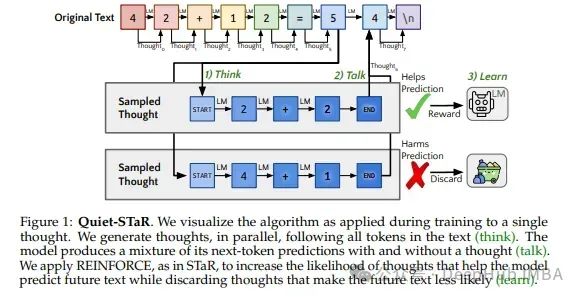

Quiet-STaR:让语言模型在“说话”前思考

本文将介绍一篇3月的论文Quiet-STaR:这是一种新的方法,通过鼓励LLM发展一种“内心独白”的形式来解决这一限制,这种基本原理生成有助于LLM通过完成任务或回答问题所涉及的步骤进行推理,最终获得更准确和结构良好的输出。

入局AI时代,先从了解AI工具入手(200 个免费的 AI 工具分享)

Clipdrop - AI 驱动的插件程序,帮助你从计算机或移动设备快速剪辑和编辑图像 ,在几分钟内将一流的 AI 集成到您的应用程序中(PS、Figma、IOS、安卓)。Character.io - 一种使用 AI 从用户照片生成自定义头像的工具 (https://characterio.neel

【Transformer系列(1)】encoder(编码器)和decoder(解码器)

一文带你学会encoder-decoder框架

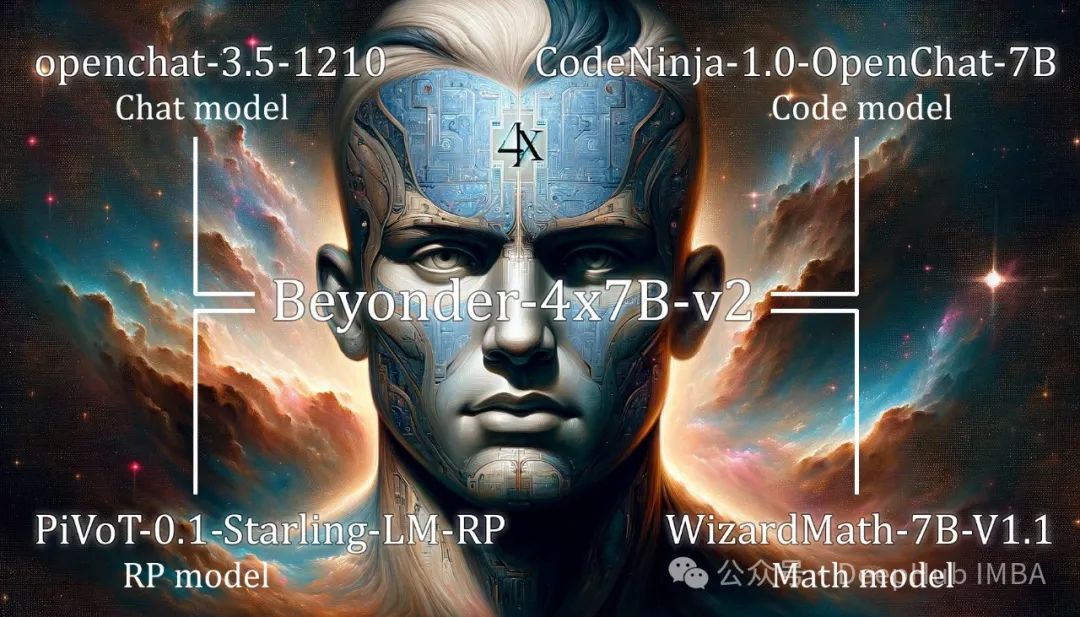

使用MergeKit创建自己的专家混合模型:将多个模型组合成单个MoE

在本文中,我们将详细介绍MoE架构是如何工作的,以及如何创建frankenmoe。最后将用MergeKit制作自己的frankenMoE,并在几个基准上对其进行评估。

详解AI Agent系列|(1)AI Agent到底是什么

从high-level来简明概括地介绍一下AI Agent

进阶课5——人工智能数据分类

数据类型是指数据在计算机中的存储方式,根据数据的不同特征和表示方式,可以将数据分为不同的类型。在IT领域中,随着数字化信息技术的应用不断扩大,数据的种类和格式也越来越多。从人机交互数据类型的视角来看,人工智能数据主要分为文本数据、语音数据、图像数据和视频数据等几大类别。

colab上利用conda管理环境

colab上的环境管理

如何开始定制你自己的大型语言模型

2023年的大型语言模型领域经历了许多快速的发展和创新,发展出了更大的模型规模并且获得了更好的性能,那么我们普通用户是否可以定制我们需要的大型语言模型呢?

毕业设计:基于深度学习的健身动作(引体向上)识别计数系统 人工智能

毕业设计:基于深度学习的健身动作(引体向上)识别计数系统利用深度学习技术和计算机视觉方法,实现了对健身者进行引体向上动作的实时识别和计数。通过深入研究动作识别的图像特征提取、卷积神经网络模型构建等关键技术,我们的系统能够在不同的环境和条件下,准确识别和计数健身者的引体向上动作。对于计算机专业、软件工

【图像配准】CVPRW21 - 深度特征匹配 DFM

论文解读《DFM: A Performance Baseline for Deep Feature Matching》,用于图像配准/图像匹配的深度特征匹配方法DFM。模型无需训练,利用预训练模型,采用DNNS和HRA策略即可达到SOTA性能。

奶奶看了都会,AI翻唱,RVC声音模型训练制作教学,附 派蒙模型

AI翻唱,AI模型训练

深度学习与机器学习:互补共进,共绘人工智能宏伟蓝图

深度学习和机器学习是人工智能领域的两个重要分支,它们各自具有独特的优势,并在多个层面紧密相连。深度学习通过深度神经网络结构,展现出强大的数据处理能力,能够自动学习数据的特征提取,适用于语音识别、自然语言处理、计算机视觉等领域。而传统机器学习则更加注重模型的简单性和可解释性,依赖于人工设计的特征和算法

【深度学习】BERT变体—RoBERTa

RoBERTa是的BERT的常用变体,出自Facebook的。来自Facebook的作者根据BERT训练不足的缺点提出了更有效的预训练方法,并发布了具有更强鲁棒性的BERT:RoBERTa。RoBERTa通过以下四个方面改变来改善BERT的预训练:在MLM任务中使用动态掩码而不是静态掩码;移除NSP

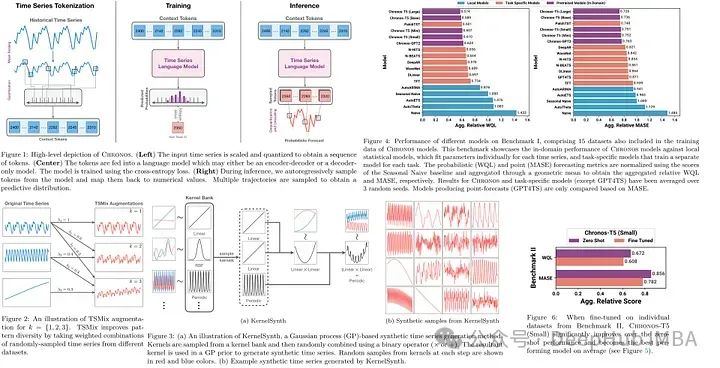

Chronos: 将时间序列作为一种语言进行学习

这是一篇非常有意思的论文,它将时间序列分块并作为语言模型中的一个token来进行学习,并且得到了很好的效果。

秒懂AI-深度学习五大模型:RNN、CNN、Transformer、BERT、GPT简介

BERT是一种基于Transformer的预训练语言模型,它的最大创新之处在于引入了双向Transformer编码器,这使得模型可以同时考虑输入序列的前后上下文信息。GPT也是一种基于Transformer的预训练语言模型,它的最大创新之处在于使用了单向Transformer编码器,这使得模型可以更

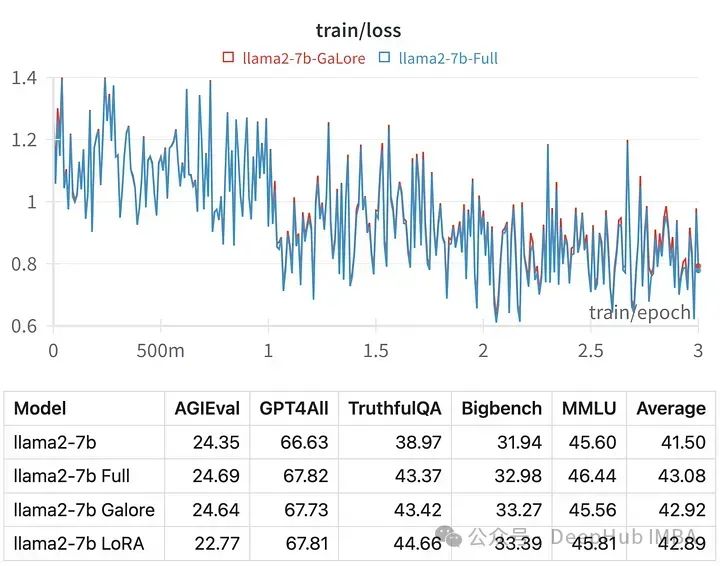

使用GaLore在本地GPU进行高效的LLM调优

,GaLore可以让我们在具有24 GB VRAM的消费级GPU上微调7B模型。结果模型的性能与全参数微调相当,并且似乎优于LoRA。