人工智能|深度学习——基于Xception算法模型实现一个图像分类识别系统

在计算机视觉领域,图像识别是一个非常重要的任务,其应用涵盖了人脸识别、物体检测、场景理解等众多领域。随着深度学习技术的发展,深度卷积神经网络(Convolutional Neural Networks,简称CNN)在图像识别任务上取得了巨大成功,其中Xception算法作为一种改进型CNN,被广泛应

AI辅写疑似度多少正常?从七个方面解读疑似度的合理范围!

为了降低疑似度,可以采取多种措施,如选择高水平的AI辅写工具、适当调整参数、加入个人思考和观点等。随着AI技术的发展,AI辅写工具在学术、写作等领域的应用越来越广泛。影响AI辅写疑似度的因素有很多,包括AI技术的水平、使用者的写作习惯、写作主题的难度等。AI辅写疑似度是指使用AI辅写工具生成的文本与

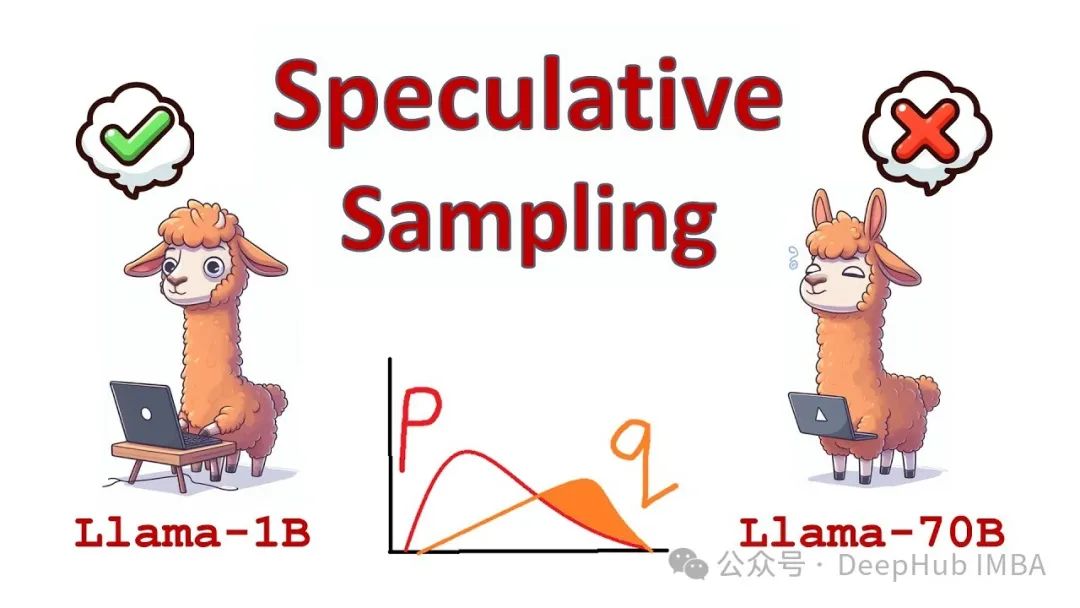

推测解码:在不降低准确性的情况下将LLM推理速度提高2 - 3倍

在本篇文章我们将详细讨论推测解码,这是一种可以将LLM推理速度提高约2 - 3倍而不降低任何准确性的方法。我们还将会介绍推测解码代码实现,并看看它与原始transformer 实现相比到底能快多少。

论文AI率多少算正常?七个维度解读

我们应该根据具体的研究领域、论文类型、写作目的以及审稿人和读者的期望来灵活看待论文AI率。在使用AI工具辅助写作时,我们应保持警惕,确保AI的使用不会损害论文的原创性和质量。不同类型的论文,如综述、实证研究、案例分析等,对AI工具的需求和使用方式也不同。因此,正常的论文AI率也需要考虑到审稿人和读者

论文AI率多少正常:深入解析与合理界定

通过明确写作目标、优化AI工具的使用、人工审查和修改以及关注AI技术的最新发展等方式,我们可以更好地平衡论文AI率与学术诚信的关系,提高论文的质量和原创性。然而,一般来说,如果AI生成或修改的内容占论文总字数的10%至20%,这通常被认为是正常的范围。过高的论文AI率可能引发学术不端行为的风险,因此

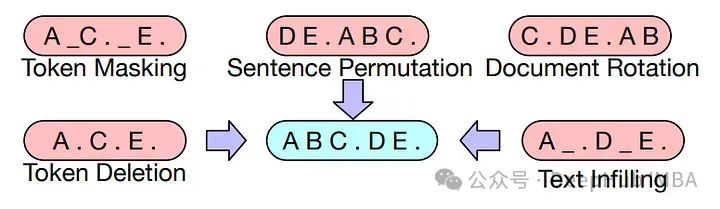

5种常用于LLM的令牌遮蔽技术介绍以及Pytorch的实现

本文将介绍大语言模型中使用的不同令牌遮蔽技术,并比较它们的优点,以及使用Pytorch实现以了解它们的底层工作原理。

存内计算为AI大模型提供的支持以及挑战

存内计算技术作为一种新型的计算范式,将存储器与处理器紧密地集成在一起,实现了数据的高效处理和低延迟访问。这种技术有效地缓解了传统计算模式下存储器与处理器之间的带宽瓶颈问题,为大规模数据处理和人工智能应用提供了更高效的计算支持。存内计算技术的核心思想是在存储器中实现简单的计算操作,以降低数据传输的功耗

怎么用AI写文献综述?智能AI写文献综述免费

内含多种参考文献格式可以自由选择,同时支持引入除了文献之外的多种资源,包括网页、书籍等,使用时除了可以直接搜索文献,也可以导入下载好的文献PDF,Mybib会从PDF中自动提取内容。Citation machine列举了57种引用类型,选择类型进行搜索后即可自动生成引文,若没有搜索到需要的结果,也可

为什么大型语言模型都在使用 SwiGLU 作为激活函数?

SwiGLU可以说是在大语言模型中最常用到的激活函数,我们本篇文章就来对他进行详细的介绍。

Real-ESRGAN超分辨网络

超分辨率论文阅读—Real-ESRGAN(2021ICCV) - 知乎Real-ESRGAN: Training Real-World Blind Super-Resolution with Pure Synthetic Data-----阅读阶段_MengYa_DreamZ的博客-CSDN博客虽然

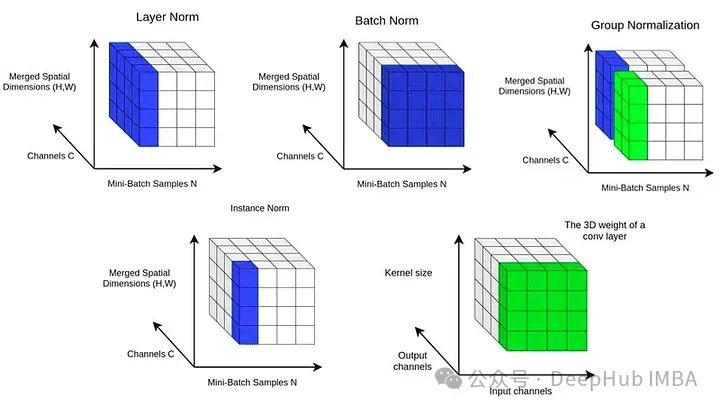

归一化技术比较研究:Batch Norm, Layer Norm, Group Norm

本文将使用合成数据集对三种归一化技术进行比较,并在每种配置下分别训练模型。记录训练损失,并比较模型的性能。

AI深度学习部署全记录

AI深度学习部署的全记录,给黑暗中前行的人一束烛光

毕业设计:基于深度学习的森林火灾预测系统 人工智能 算法

毕业设计:基于深度学习的森林火灾预测系统通过引入深度学习算法对森林环境数据进行高效处理,实现了对火灾发生的精准预测。该系统结合了计算机视觉技术和深度学习算法,对森林图像、气象数据等多源信息进行融合分析,有效提高了预测准确率。此外,该系统还具备良好的可扩展性和实时性,能够为森林火灾预警和防控提供有力支

AI模型部署实战:利用CV-CUDA加速视觉模型部署流程

随着深度学习技术在计算机视觉领域的发展,越来越多的AI算法模型被用于目标检测、图像分割、图像生成等任务中,如何高效地在云端或者边缘设备上部署这些模型是工程师迫切需要解决的问题。一个完整的AI模型部署流程一般分为三个阶段:预处理、模型推理、后处理,一般情况下会把模型推理放在GPU或者专用的硬件上进行处

基于深度学习的AI生成式人脸图像鉴别

AIGC(AI内容生成)技术的快速发展确实为创作者提供了高效生产力工具,但同时也引发了一些问题和挑战。这些技术可以生成以假乱真的图像、视频换脸等,给不法分子提供了滥用的机会。其中,一些不法分子可能利用AIGC技术制造虚假新闻、违反版权、绕过活体身份验证、散布谣言和诽谤他人、进行敲诈勒索等非法活动,以

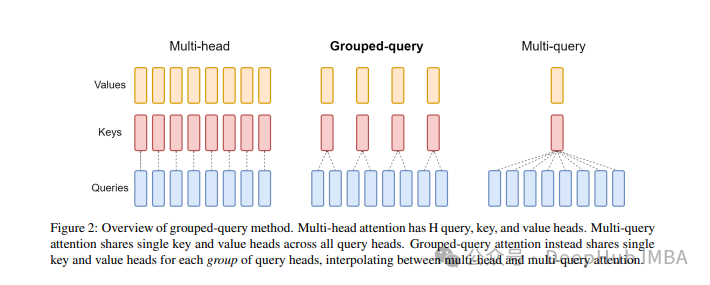

大模型中常用的注意力机制GQA详解以及Pytorch代码实现

分组查询注意力 (Grouped Query Attention) 是一种在大型语言模型中的多查询注意力 (MQA) 和多头注意力 (MHA) 之间进行插值的方法,它的目标是在保持 MQA 速度的同时实现 MHA 的质量。

论文查重部分都包括哪些内容 神码ai

在学术领域,论文查重是保证学术诚信和论文质量的重要环节。随着互联网的发展,许多论文查重网站应运而生,提供了便捷的查重服务。这些查重网站一般使用的都是伪原创技术,如小发猫伪原创或小狗伪原创等软件,进行论文的检测。那么,论文查重部分都包括哪些内容呢?大家好,今天来聊聊论文查重部分都包括哪些内容,希望能给

想训练AI模型,实验室GPU显存不够怎么办

一般的高校实验室,的确是可能存在显存不足的情况,特别是全量训练或者微调时问题尤为突出。此时想让实验室新购置设备更是遥遥无期,估计开会还没讨论出结果,好多炼丹侠的deadline就到了。

AI大预言模型——ChatGPT在地学、GIS、气象、农业、生态、环境应用

AI大预言模型——ChatGPT在地学、GIS、气象、农业、生态、环境应用

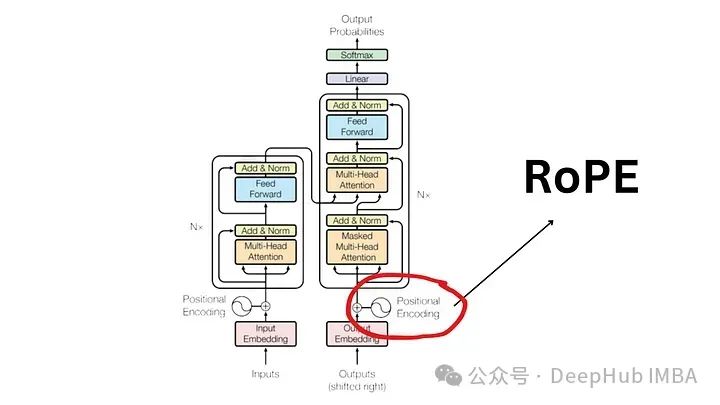

大语言模型中常用的旋转位置编码RoPE详解:为什么它比绝对或相对位置编码更好?

旋转位置嵌入是最先进的 NLP 位置嵌入技术。大多数流行的大型语言模型(如 Llama、Llama2、PaLM 和 CodeGen)已经在使用它。在本文中,我们将深入探讨什么是旋转位置编码,以及它们如何巧妙地融合绝对位置嵌入和相对位置嵌入的优点。