基于PyTorch的大语言模型微调指南:Torchtune完整教程与代码示例

**Torchtune**是由PyTorch团队开发的一个专门用于LLM微调的库。它旨在简化LLM的微调流程,提供了一系列高级API和预置的最佳实践,使得研究人员和开发者能够更加便捷地对LLM进行调试、训练和部署。

[Pytorch案例实践005]蚂蚁&蜜蜂图像分类

pytorch实现蚂蚁&蜜蜂图像分类

Macbook配置李沐动手做深度学习环境

Macbook M3pro配置李沐:动手做深度学习

安装pytorch (GPU版本)

这我就很疑惑了,后来我在.conda同级的文件.condarc中发现了,我在第二次安装时,anaconda 的路径名是小写,在这个文件后添加导致了错误,你们没有重复安装的经历,应该没有这样的错误。我的机子cuda版本为12.3,算是比较高的那个,但是pytorch官网现阶段只放出了cuda11.8和

免费GPU平台教程,助力你的AI, pytorch tensorflow 支持cuda

Colab:https://drive.google.com/drive/home 阿里天池实验室:https://tianchi.aliyun.com/ 移动九天:https://jiutian.10086.cn/edu/#/home kagglekaggle.com baidu aistudio

pytorch安装GPU版本 (Cuda12.1)方法

怎么安装pytorch?选择匹配的cude

Resnet结构介绍

ResNet,全称为残差网络(Residual Networks),是一种深度卷积神经网络架构,由微软研究院的Kaiming He等人于2015年提出。ResNet在多个视觉识别任务中取得了当时的最佳性能,并在深度学习领域产生了深远的影响。

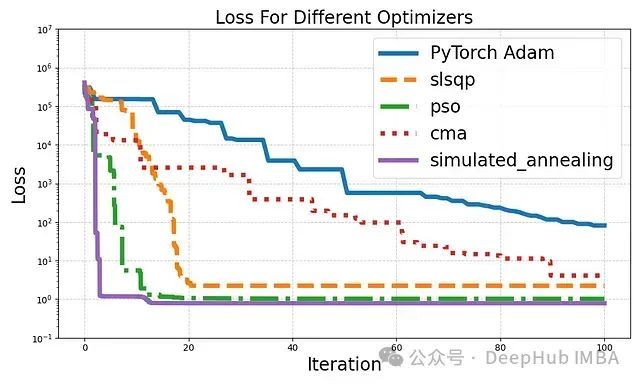

如果你的PyTorch优化器效果欠佳,试试这4种深度学习中的高级优化技术吧

在深度学习领域,优化器的选择对模型性能至关重要。

【AI小项目4】用Pytorch从头实现Transformer(详细注解)

阅读Transformer论文并用Pytorch从头实现了简单的Transformer模型

经典CNN模型(七):MobileNetV1(PyTorch详细注释版)

在传统卷积神经网络因内存和运算量庞大而难以适配移动及嵌入式设备的背景下,2017 年,Google 团队应运推出了 MobileNetV1,这是一种专为资源受限环境设计的轻量级深度学习模型。相较于传统网络如 VGG16,MobileNetV1 在仅牺牲 0.9%的准确率的前提下,实现了模型参数精简至

CUDA-MODE 第一课课后实战(上)

Nsight Compute是一个CUDA kernel分析器,它通过硬件计数器和软件收集指标。它使用内置的专业知识来检测kernel常见的性能问题并指出发生这些问题的位置并给出一些解决方法的建议。这一内置规则集和指南就是我们所说的Guided Analysis。下面就结合Lecture1的例子来深

在Pytorch中为不同层设置不同学习率来提升性能,优化深度学习模型

为网络的不同层设置不同的学习率可能会带来显著的性能提升。本文将详细探讨这一策略的实施方法及其在PyTorch框架中的具体应用

【torch.quantile】分位数计算

torch.quantile 分位数计算方法。

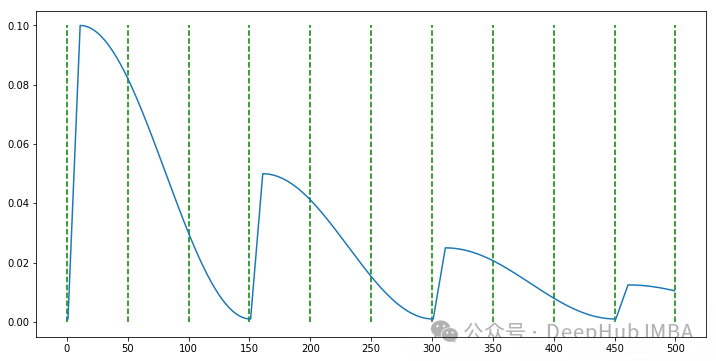

PyTorch自定义学习率调度器实现指南

本文将详细介绍如何通过扩展PyTorch的 ``` LRScheduler ``` 类来实现一个具有预热阶段的余弦衰减调度器。我们将分五个关键步骤来完成这个过程。

大模型获取embdding

以qwen为例:本文将使用 Hugging Face 的库来完成这些步骤。这是一个非常流行且功能强大的库,用于处理各种预训练语言模型。

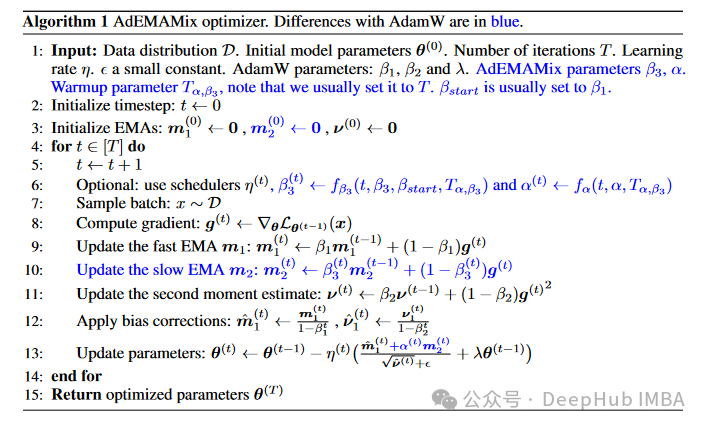

AdEMAMix: 一种创新的神经网络优化器

这种算法旨在解决当前广泛使用的Adam及其变体(如AdamW)在利用长期梯度信息方面的局限性。研究者们通过巧妙地结合两个不同衰减率的指数移动平均(EMA),设计出了这种新的优化器,以更有效地利用历史梯度信息。

PyTorch 模型调试与故障排除指南

本文旨在为 PyTorch 开发者提供一个全面的调试指南,涵盖从基础概念到高级技术的广泛内容。

【AI】Pytorch_损失函数&优化器

持续更新至pytorch大部分内容更完。本文已达到10w字,故按模块拆开,详见目录导航。整体框架如下损失函数及优化器。

【深度学习入门篇 ④ 】Pytorch实现手写数字识别

通过前面的学习,我们已经掌握了PyTorch API的基本使用,今天我们使用PyTorch实现手写数字识别案例!通过前面的内容可知,调用MNIST返回的结果中图形数据是一个Image对象,需要对其进行处理,为了进行数据的处理,接下来学习的方法~是PyTorch中用于图像预处理和增强的一个重要模块,它

用定制开发板通过vitis ai 2.0部署自己训练的yolov3(pytorch框架)

本文介绍如何用定制开发板通过vitis ai 2.0部署自己训练的yolov3(pytorch框架)