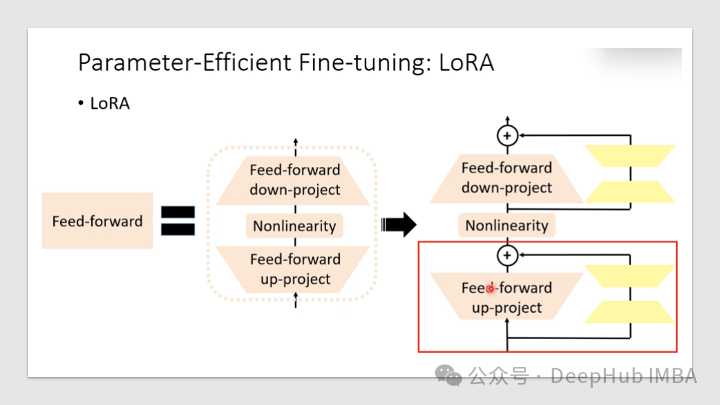

使用LORA微调RoBERTa

LORA可以大大减少了可训练参数的数量,节省了训练时间、存储和计算成本,并且可以与其他模型自适应技术(如前缀调优)一起使用,以进一步增强模型。

使用PyOD进行异常值检测

异常值检测各个领域的关键任务之一。PyOD是Python Outlier Detection的缩写,可以简化多变量数据集中识别异常值的过程。在本文中,我们将介绍PyOD包,并通过实际给出详细的代码示例

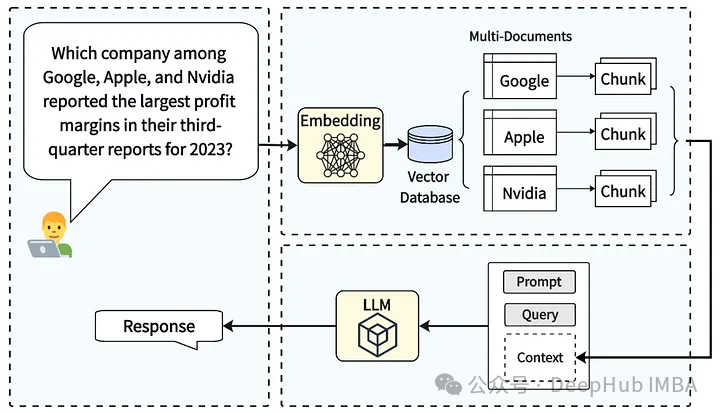

使用UMAP降维可视化RAG嵌入

在本文中,我们使用LangChain构建RAG应用,并在2D中可视化嵌入,分析查询和文档片段之间的关系和接近度。

2024年应该关注的十大人工智能创新

今年是大年初一,我们将探讨2024年可能出现的十大人工智能创新,拥抱这些即将到来的人工智能创新,可以为一个充满激动和变革的未来做好准备。

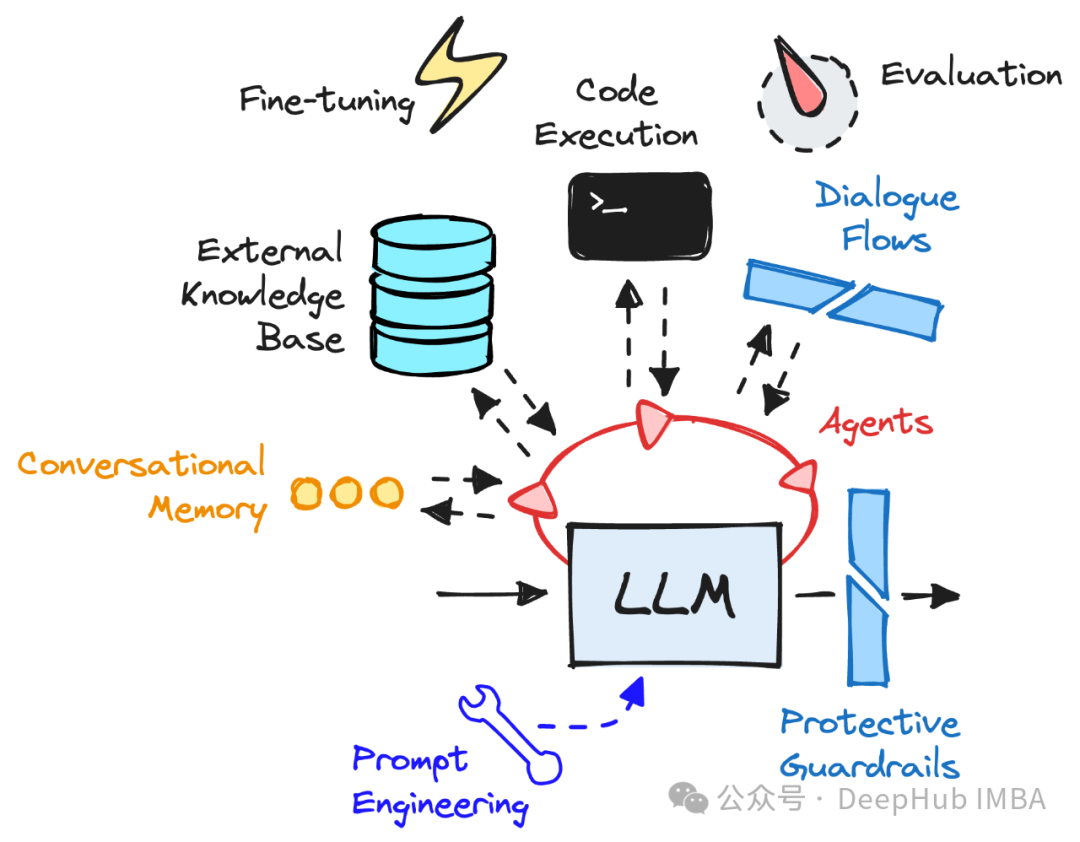

从模型到前端,你应该知道的LLM生态系统指南

本文通过介绍这个生态系统的核心组成部分,来详细整理LLM的发展。

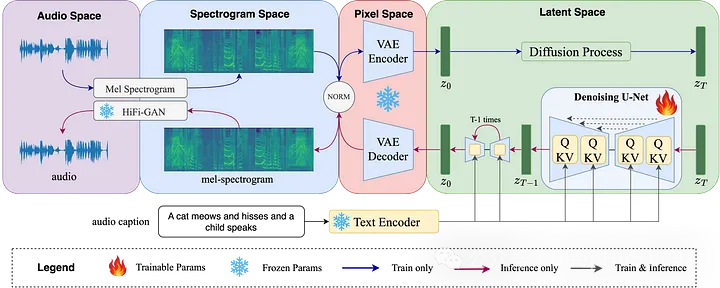

Python进行AI声音克隆的端到端指南

人工智能语音克隆是一种捕捉声音的独特特征,然后准确性复制它的技术。

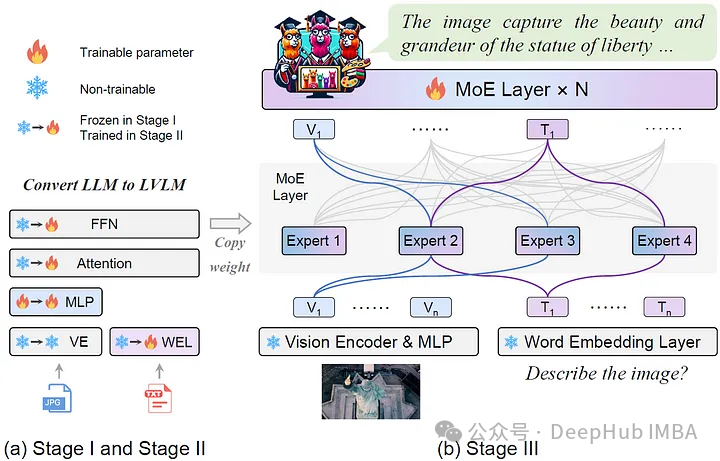

MoE-LLaVA:具有高效缩放和多模态专业知识的大型视觉语言模型

MoE-LLaVA利用了“专家混合”策略融合视觉和语言数据,实现对多媒体内容的复杂理解和交互。

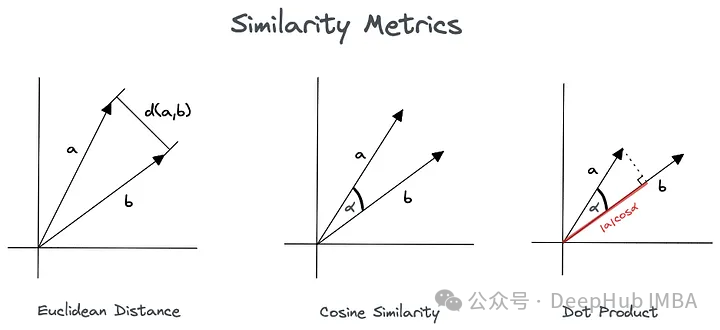

NLP中的嵌入和距离度量

本文将深入研究嵌入、矢量数据库和各种距离度量的概念,并提供示例和演示代码。

PyTorch的10个基本张量操作

本文将介绍一些Pytorch的基本张量操作。

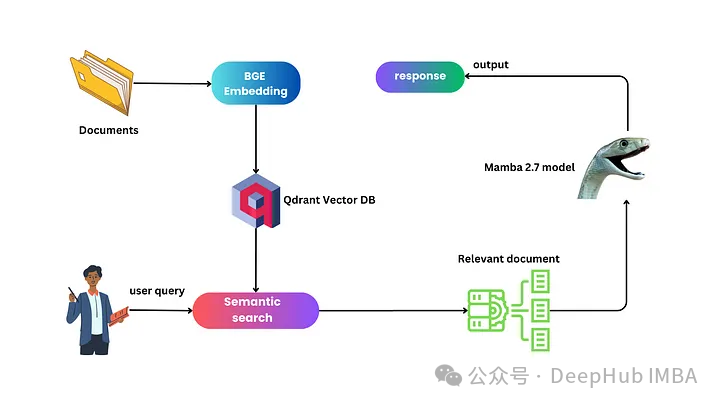

使用Mamba和Qdrant数据库实现RAG的代码示例

我们今天来研究一下RAG、Mamba和Qdrant的协同工作,它们的有效组合保证了效率和可扩展性。

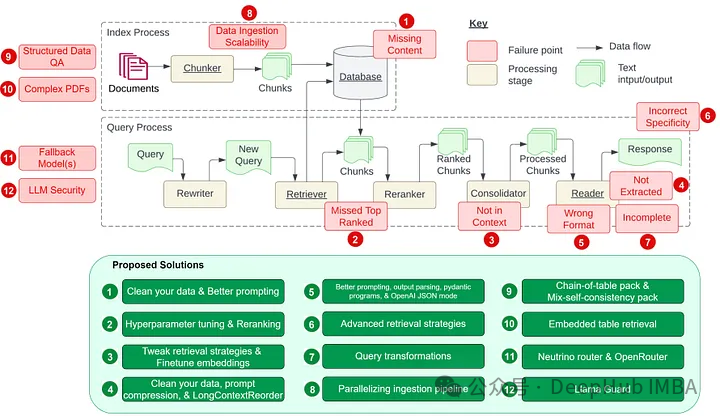

12个RAG常见痛点及解决方案

这里使用“痛点”而不是“失败点”,主要是因为我们总结的问题都有相应的建议解决方案。

10个Pandas的高级技巧

pandas是一个非常庞大的库,有许多尚未探索的实用方法。本文介绍的10各高级技巧可以帮你更有效地处理各种数据

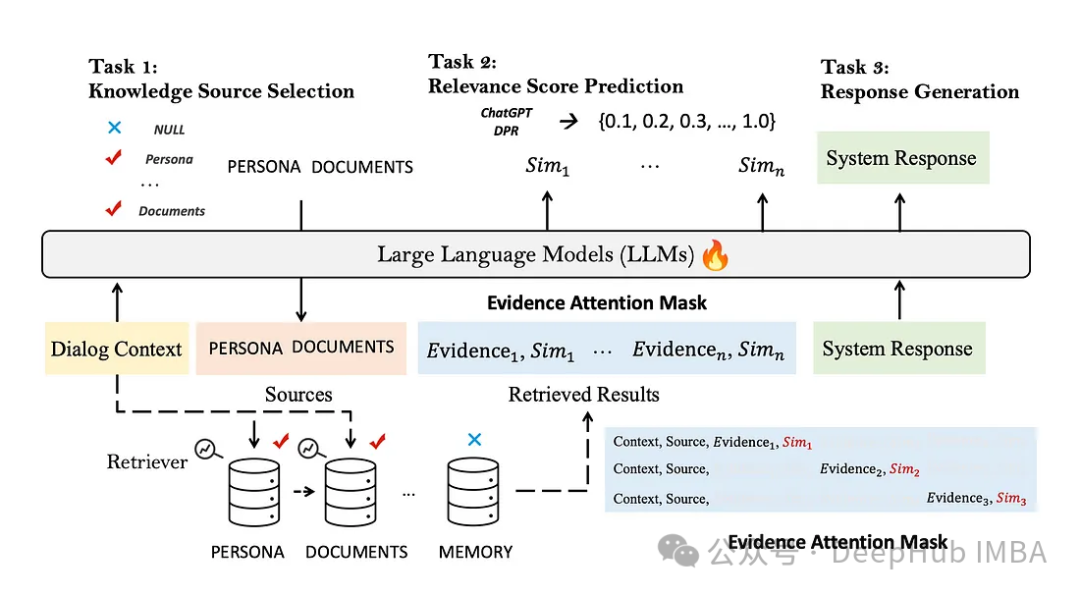

UniMS-RAG:用于个性化对话的统一多源RAG框架

UniMS-RAG统一了计划、检索和阅读任务的训练过程,并将它们集成到一个综合框架中。

Langchain中改进RAG能力的3种常用的扩展查询方法

有多种方法可以提高检索增强生成(RAG)的能力,其中一种方法称为查询扩展。我们这里主要介绍在Langchain中常用的3种方法

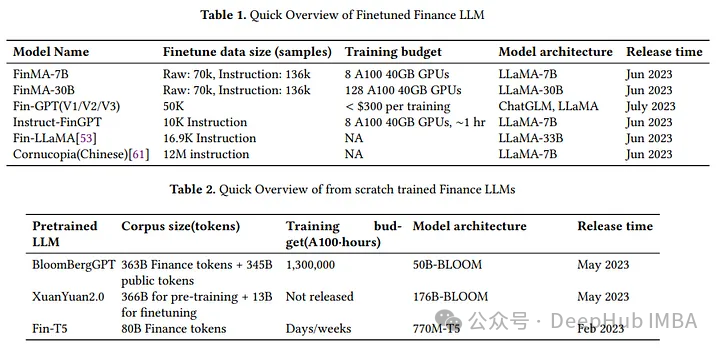

论文推荐:大语言模型在金融领域的应用调查

这篇论文总结了现有LLM在金融领域的应用现状,推荐和金融相关或者有兴趣的朋友都看看

使用核模型高斯过程(KMGPs)进行数据建模

核模型高斯过程是机器学习和统计学中对传统高斯过程的一种扩展。要理解kmgp,首先掌握高斯过程的基础知识,然后了解核模型是如何发挥作用的。

2024年1月的论文推荐

又到月底了,在月初推荐论文的基础上又整理了10篇推荐阅读的论文

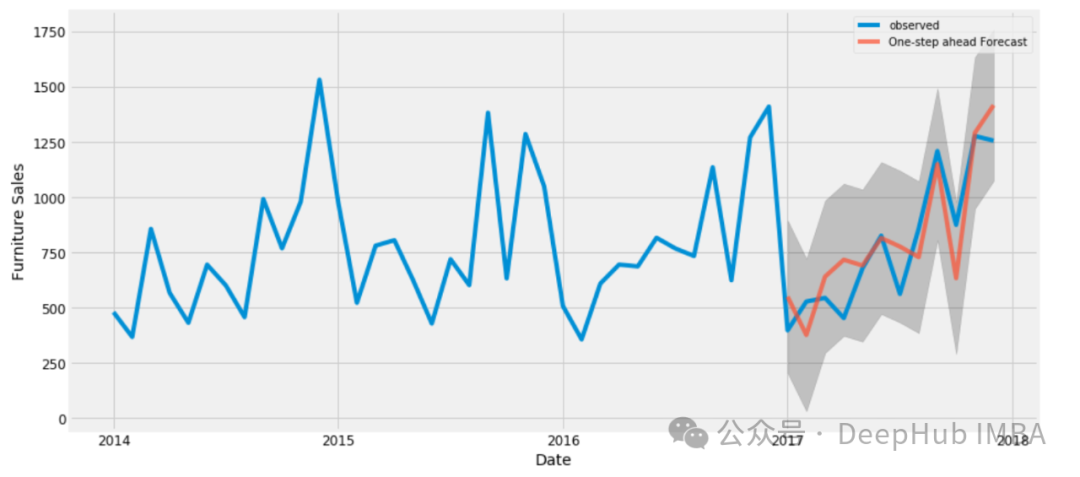

使用Transformer 模型进行时间序列预测的Pytorch代码示例

本文可以作为学习使用Transformer 模型的时间序列预测的一个起点。

使用mergekit 合并大型语言模型

在本文中我们将介绍各种合并算法,研究如何实现它们,并深入研究它们的工作原理。还将使用mergekit工具合并Mistral、WizardMath和CodeLlama模型。

Mistral AI vs. Meta:顶级开源LLM比较

本文将比较Mistral 7B vs Llama 2 7B and Mixtral 8x7B vs Llama 2 70B