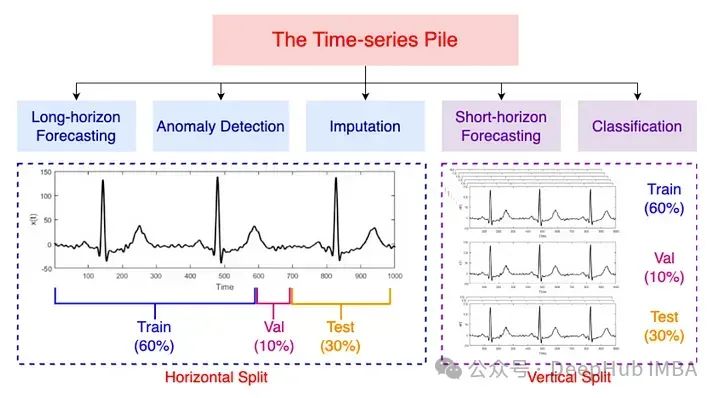

Moment:又一个开源的时间序列基础模型

根据作者的介绍,MOMENT则是第一个开源,大型预训练时间序列模型家族。

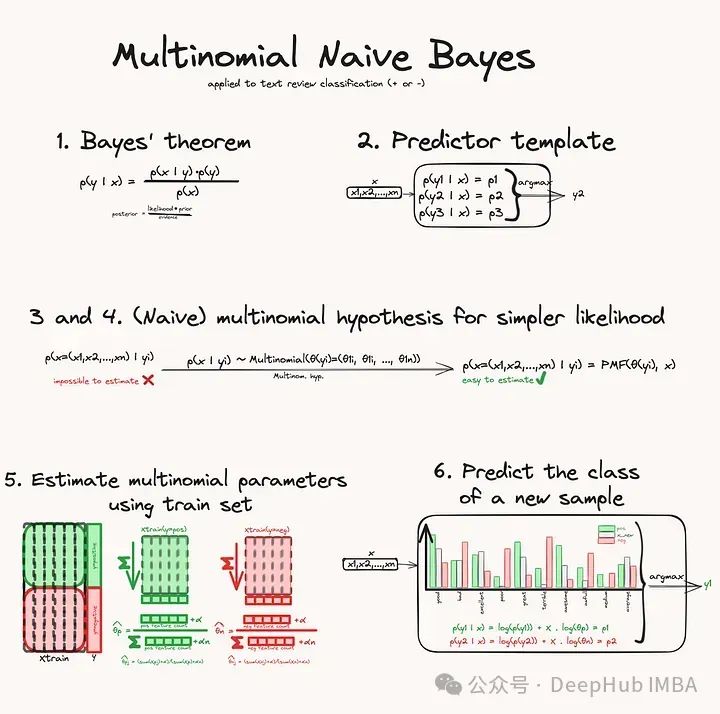

多项式朴素贝叶斯分类器

在这篇文章中,我们介绍多项式朴素贝叶斯分类器是如何工作的,然后使用scikit-learn作为实际工作的示例来介绍如何使用。

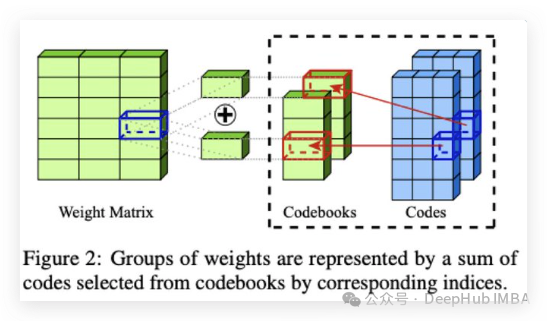

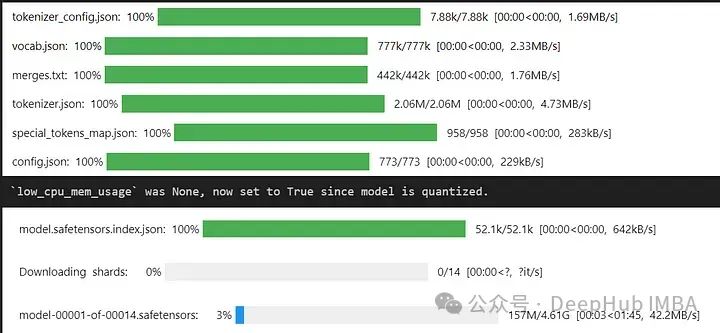

在16G的GPU上微调Mixtral-8x7B

在本文中,我将展示如何仅使用16 GB的GPU RAM对使用AQLM进行量化的Mixtral-8x7B进行微调。

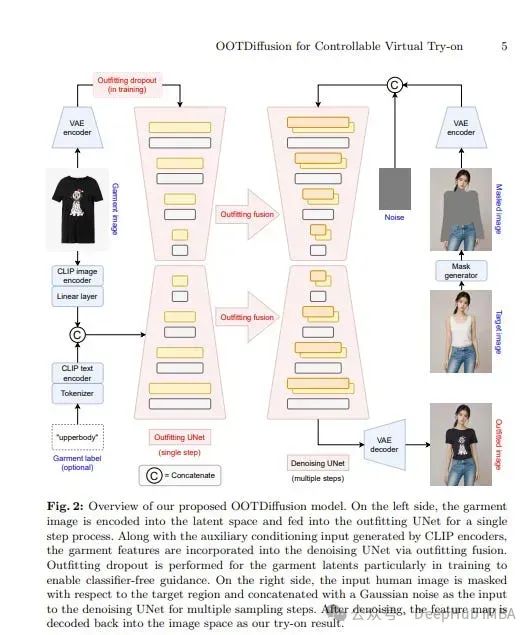

2024年3月的计算机视觉论文推荐

我们今天来总结一下2024年3月上半月份发表的最重要的论文,无论您是研究人员、从业者还是爱好者,本文都将提供有关计算机视觉中最先进的技术和工具重要信息。

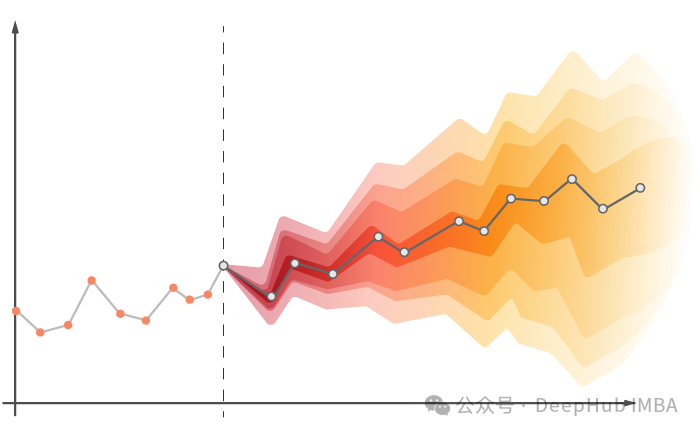

时间序列预测的零样本学习是未来还是炒作:TimeGPT和TiDE的综合比较

在本文中,我们将讨论一个通用的预训练模型能否解决预测任务的范式转变。使用TimeGPT进行零样本学习然后将TimeGPT的性能与TiDE进行比较

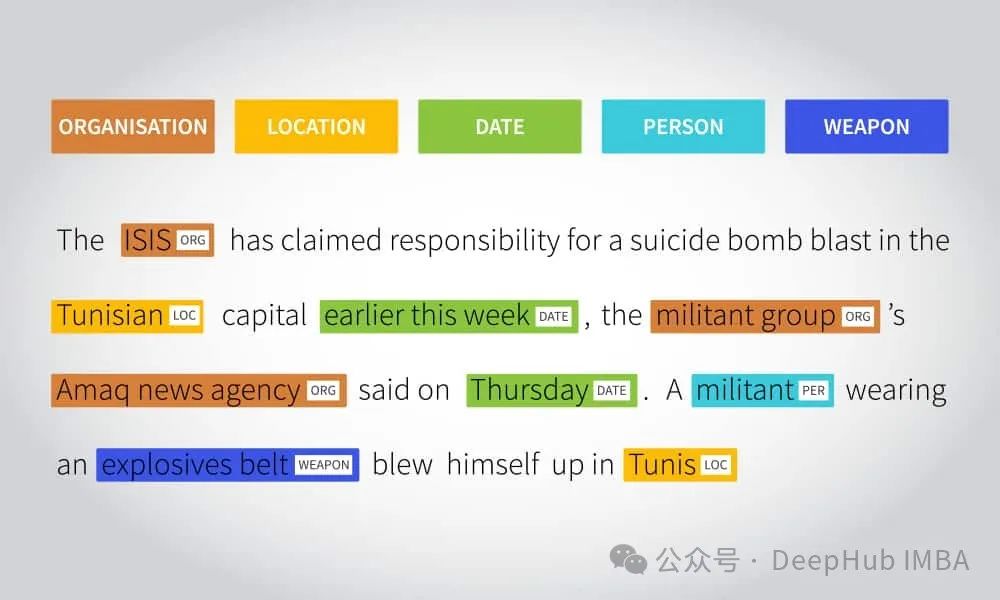

微调大型语言模型进行命名实体识别

这篇文章总结了命名实体识别(NER)问题微调大型语言模型的经验。我们将以个人身份信息(PII)为例来介绍大型语言模型进行NER微调的方法。

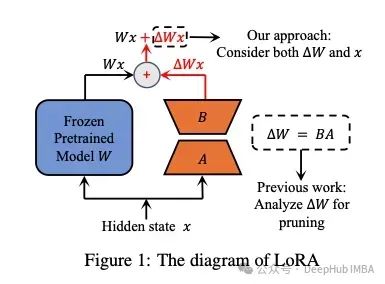

LoRA及其变体概述:LoRA, DoRA, AdaLoRA, Delta-LoRA

在本文中,我们将解释LoRA本身的基本概念,然后介绍一些以不同的方式改进LoRA的功能的变体,包括LoRA+、VeRA、LoRA- fa、LoRA-drop、AdaLoRA、DoRA和Delta-LoRA。

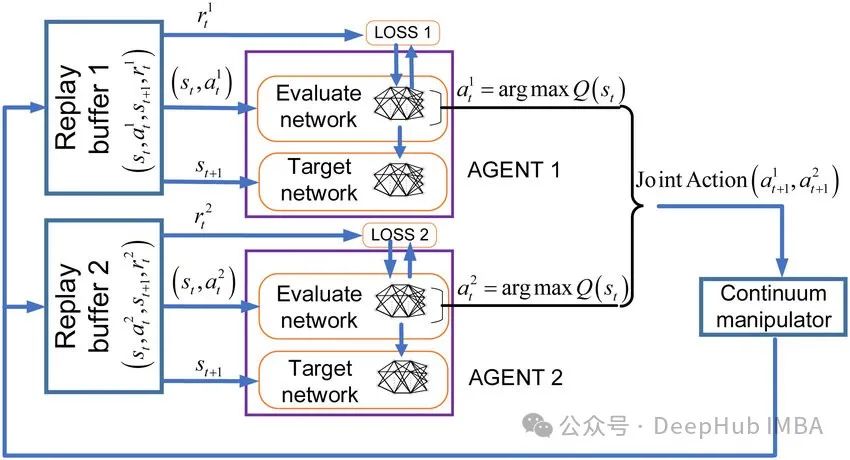

MADQN:多代理合作强化学习

在本文中我们将只关注合作多代理学习的问题,不仅因为它在我们日常生活中更常见,而对于我们学习来说也相对的简单一些。

2024年3月最新的深度学习论文推荐

现在已经是3月中旬了,我们这次推荐一些2月和3月发布的论文。

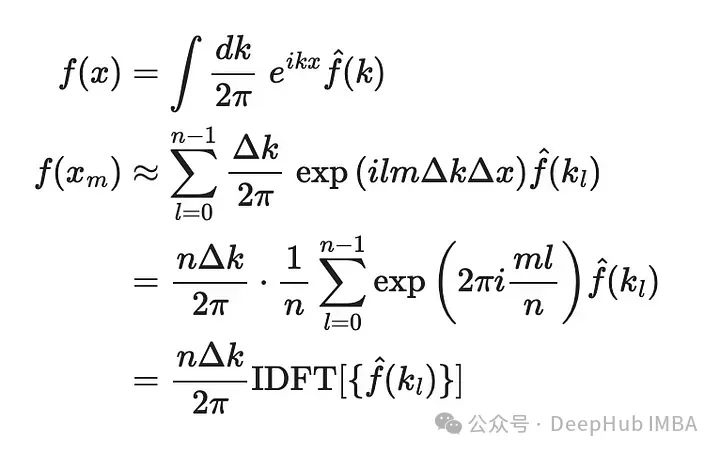

傅里叶变换算法和Python代码实现

本篇文章我们将使用Python来实现一个连续函数的傅立叶变换。

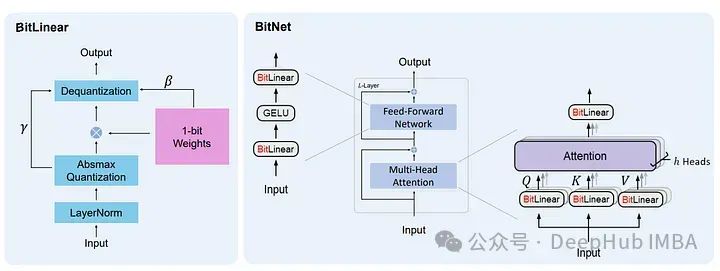

从16-bit 到 1.58-bit :大模型内存效率和准确性之间的最佳权衡

在本文中,我们将通过使用GPTQ对Mistral 7B、Llama 27b和Llama 13B进行8位、4位、3位和2位量化实验,还要介绍一个大模型的最新研究1.58 Bits,它只用 -1,0,1来保存权重

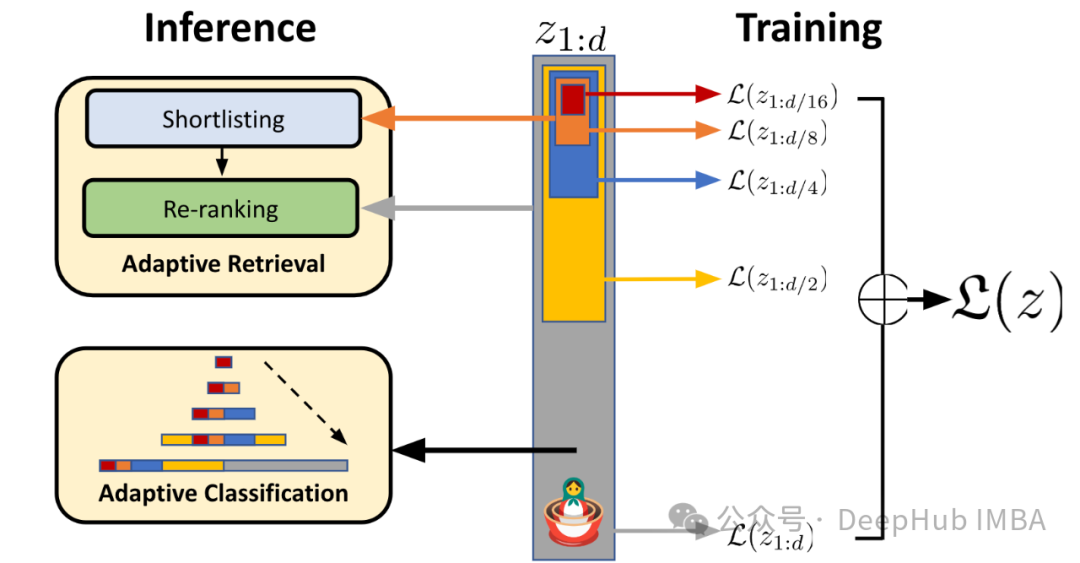

Nomic Embed:能够复现的SOTA开源嵌入模型

Nomic-embed-text是2月份刚发布的,并且是一个完全开源的英文文本嵌入模型,上下文长度为8192.该模型有137M个参数在现在可以算是非常小的模型了。

使用Tokeniser估算GPT和LLM服务的查询成本

Tokeniser包可以有效地计算文本输入中的令牌来估算这些成本。本文将介绍如何使用Tokeniser有效地预测和管理费用。

StarCoder 2:GitHub Copilot本地开源LLM替代方案

在本文中,我们将介绍StarCoder2的一些基本信息,然后建立一个本地环境,搭建StarCoder2-15B模型并用Python, JavaScript, SQL, c++和Java测试其编码能力。

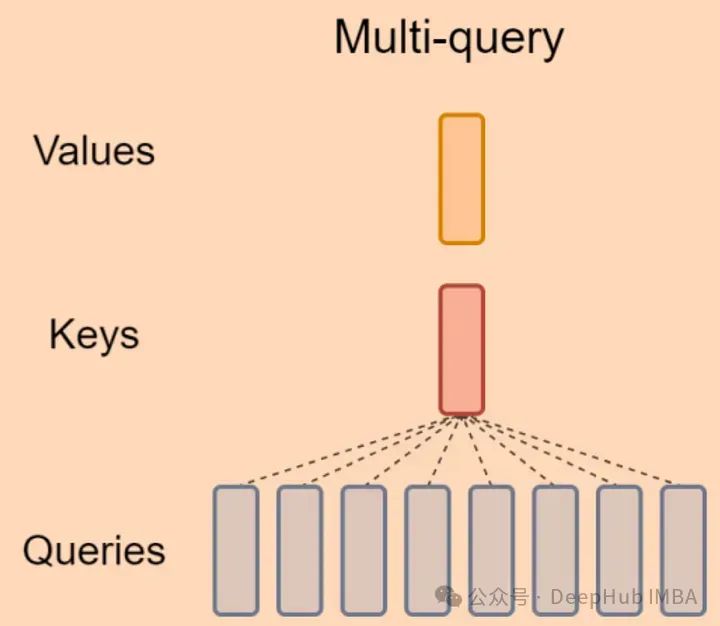

LLM 加速技巧:Muti Query Attention

MQA 是 19 年提出的一种新的 Attention 机制,其能够在保证模型效果的同时加快 decoder 生成 token 的速度。在大语言模型时代被广泛使用,很多LLM都采用了MQA,如Falcon、PaLM、StarCoder等。

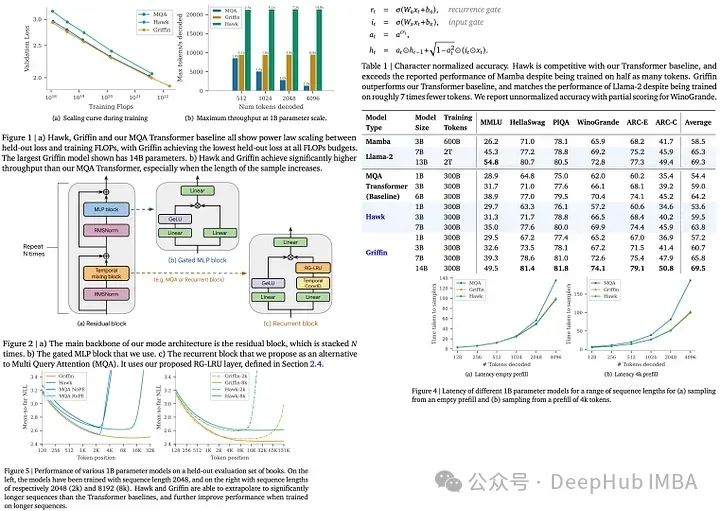

RNN又行了!DeepMind新发布的Griffin可以与同级别的LLM性能相当

Hawk和Griffin是DeepMind推出的新型循环神经网络(RNNs),2月刚刚发布在arxiv上。

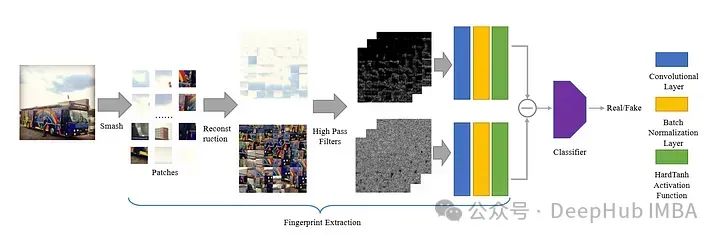

使用纹理对比度检测检测AI生成的图像

在本篇文章中我们将介绍如何开发一个深度学习模型来检测人工智能生成的图像

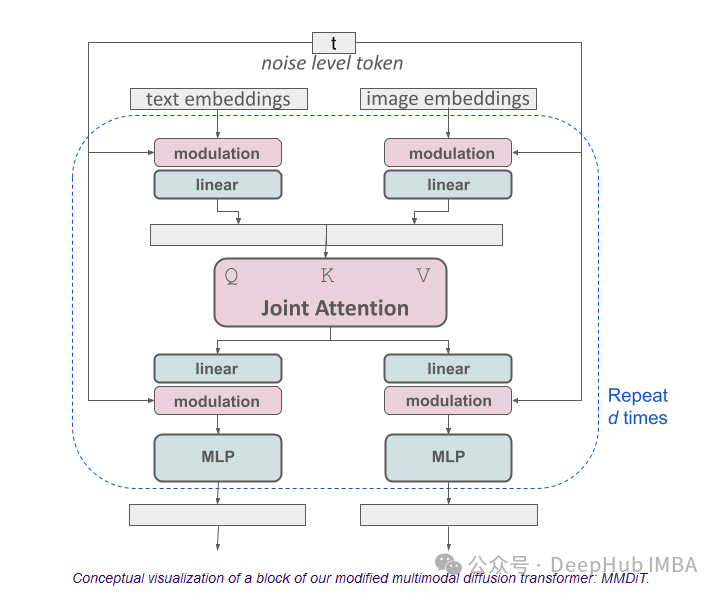

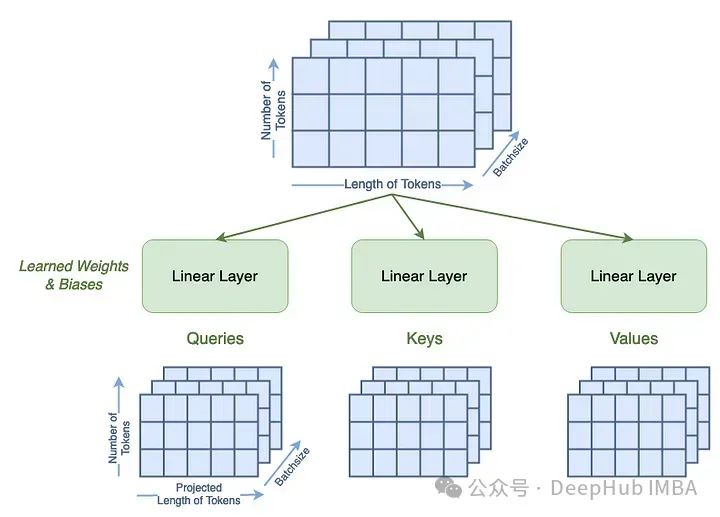

Vision Transformers的注意力层概念解释和代码实现

本文将深入探讨注意力层在计算机视觉环境中的工作原理。我们将讨论单头注意力和多头注意力。它包括注意力层的代码,以及基础数学的概念解释。

使用TensorRT-LLM进行生产环境的部署指南

TensorRT-LLM是一个由Nvidia设计的开源框架,用于在生产环境中提高大型语言模型的性能。

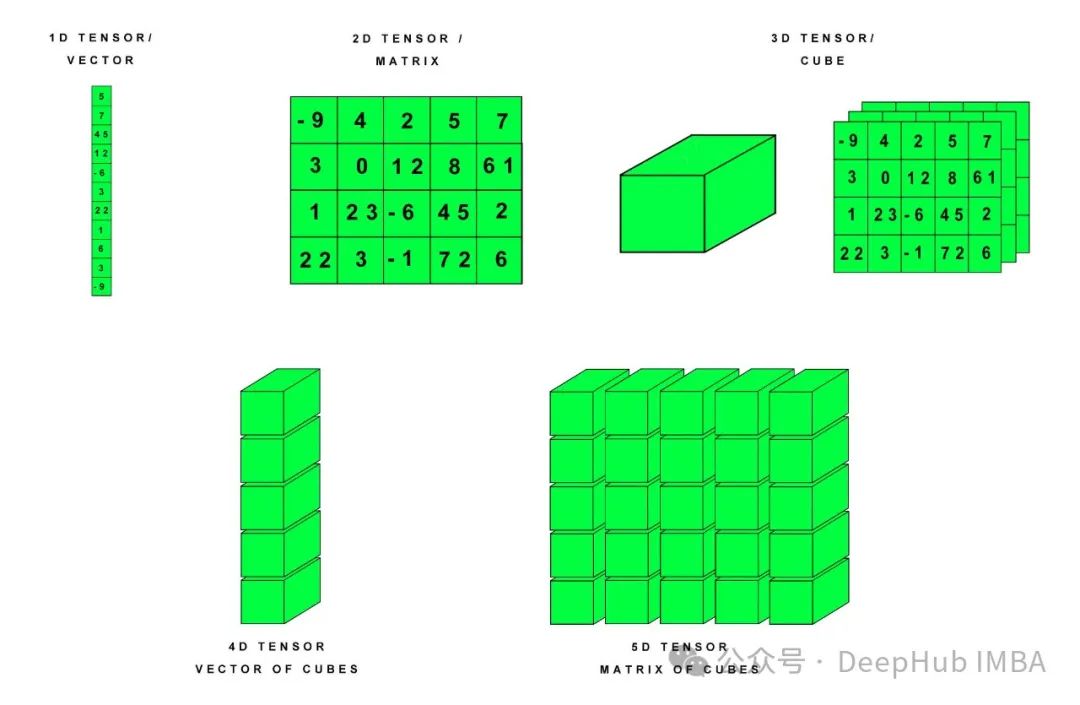

Pytorch中张量的高级选择操作

在某些情况下,我们需要用Pytorch做一些高级的索引/选择,所以在这篇文章中,我们将介绍这类任务的三种最常见的方法:torch.index_select, torch.gather and torch.take