通过强化学习策略进行特征选择

在本文中,我们将介绍并实现一种新的通过强化学习策略的特征选择。

微调真的能让LLM学到新东西吗:引入新知识可能让模型产生更多的幻觉

论文详细研究了一个经过微调的模型会发生什么,以及它在获得新知识后的反应会发生什么。

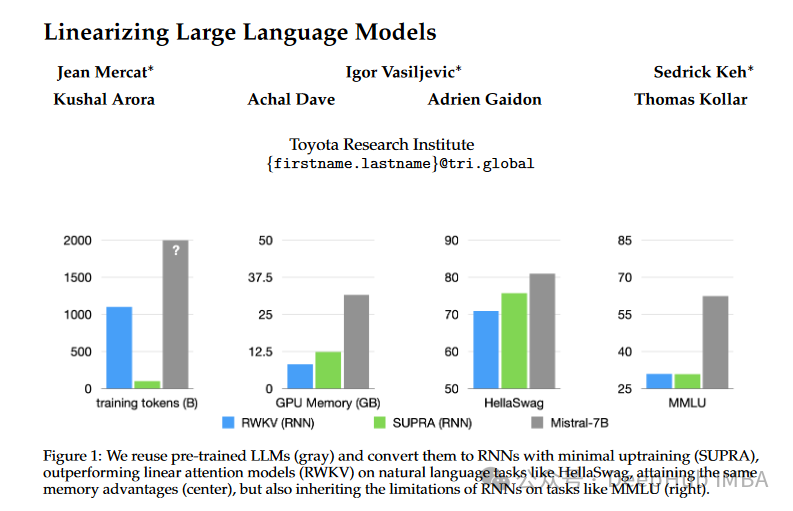

SUPRA:无须额外训练,将Transformer变为高效RNN,推理速度倍增

SUPRA方法旨在将预训练的大型语言模型(LLMs)转化为RNNs,具体步骤包括替换softmax归一化为GroupNorm,使用一个小型MLP投影queries和keys。

2024年5月大语言模型论文推荐:模型优化、缩放到推理、基准测试和增强性能

这篇文章将要总结了2024年5月发表的一些最重要的大语言模型的论文。这些论文涵盖了塑造下一代语言模型的各种主题,从模型优化和缩放到推理、基准测试和增强性能。

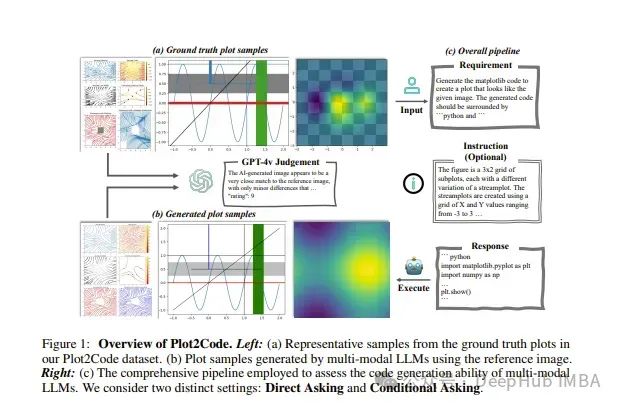

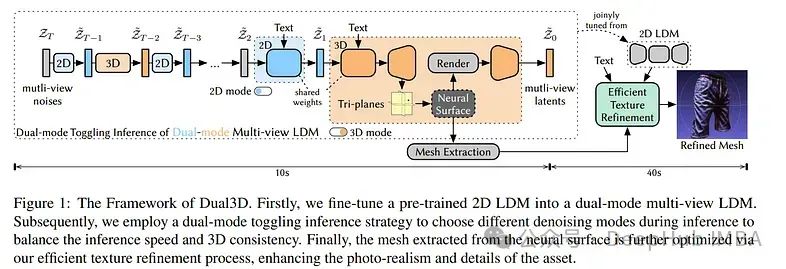

2024年5月计算机视觉论文推荐:包括扩散模型、视觉语言模型、图像编辑和生成、视频处理和生成以及图像识别等各个主题

我们今天总结下2024年5月发表的最重要的论文,重点介绍了计算机视觉领域的最新研究和进展,包括扩散模型、视觉语言模型、图像编辑和生成、视频处理和生成以及图像识别等各个主题。

使用FP8加速PyTorch训练的两种方法总结

在PyTorch中,FP8(8-bit 浮点数)是一个较新的数据类型,用于实现高效的神经网络训练和推理。它主要被设计来降低模型运行时的内存占用,并加快计算速度

MambaOut:状态空间模型并不适合图像的分类任务

该论文探讨了Mamba架构(包含状态空间模型SSM)是否有必要用于视觉任务,如图像分类、目标检测和语义分割。通过实验证实了了Mamba在视觉识别任务中的效果,认为其不如传统的卷积和注意力模型。

整合LlamaIndex与LangChain构建高级的查询处理系统

本篇文章将介绍如何将LlamaIndex和LangChain整合使用,创建一个既可扩展又可定制的代理RAG(Retrieval-Augmented Generation)应用程序,利用两种技术的强大功能,开发出能够处理复杂查询并提供精准答案的高效应用程序。

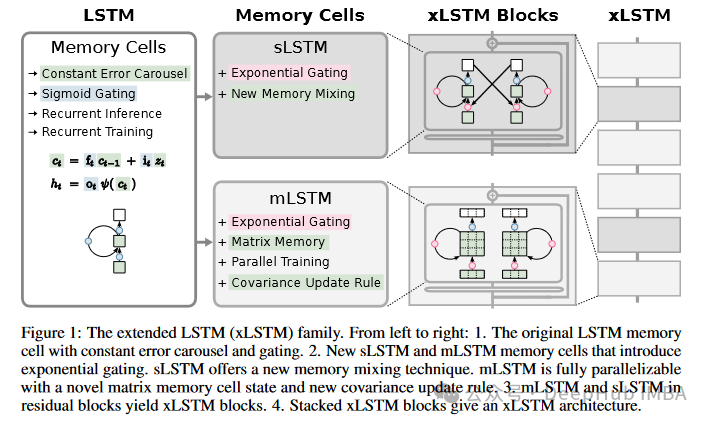

深入解析xLSTM:LSTM架构的演进及PyTorch代码实现详解

xLSTM的新闻大家可能前几天都已经看过了,原作者提出更强的xLSTM,可以将LSTM扩展到数十亿参数规模,我们今天就来将其与原始的lstm进行一个详细的对比,然后再使用Pytorch实现一个简单的xLSTM。

DeepSparse: 通过剪枝和稀疏预训练,在不损失精度的情况下减少70%的模型大小,提升三倍速度

这篇论文提出了一种高稀疏性基础大型语言模型(LLMs)的新方法,通过有效的预训练和部署,实现了模型在保持高准确度的同时,显著提升了处理速度。

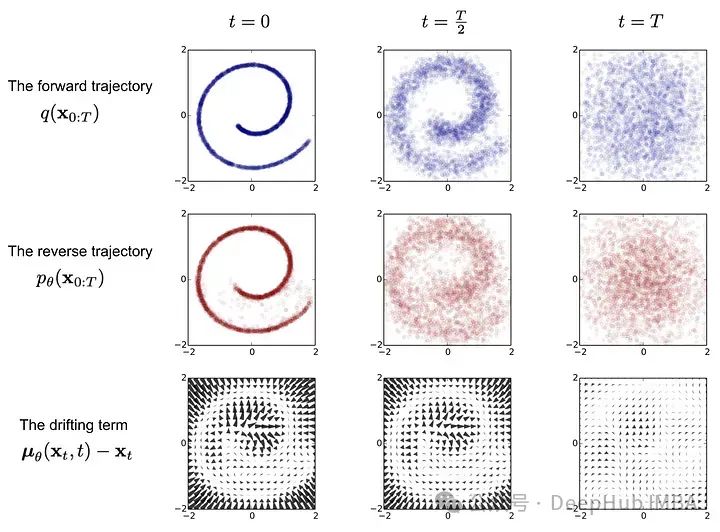

扩散模型的多元化应用:药物发现、文本生成、时间序列预测等

今天我们就来研究一下扩散模型的多元化应用。

图神经网络入门示例:使用PyTorch Geometric 进行节点分类

本文介绍的主要流程是我们训练图神经网络的基本流程,尤其是前期的数据处理和加载,通过扩展本文的基本流程可以应对几乎所有图神经网络问题。

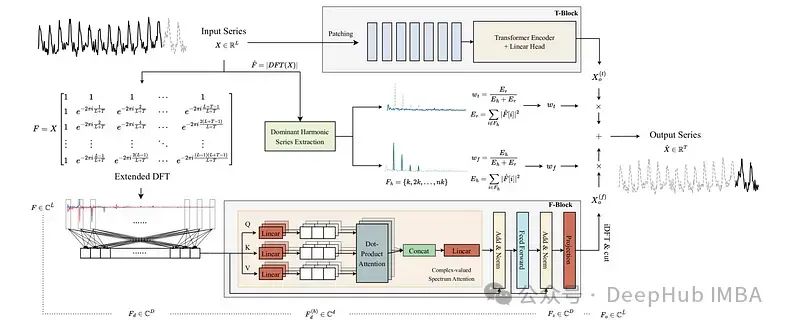

ATFNet:长时间序列预测的自适应时频集成网络

ATFNet是一个深度学习模型,它结合了时间域和频域模块来捕获时间序列数据中的依赖关系。这是4月发布在arxiv上的论文,还包含了源代码。

时间序列预测:探索性数据分析和特征工程的实用指南

我在本文中我们将EDA总结为六个步骤:描述性统计、时间图、季节图、箱形图、时间序列分解、滞后分析。

Transformers 加速的一些常用技巧

我们今天来总结以下一些常用的加速策略

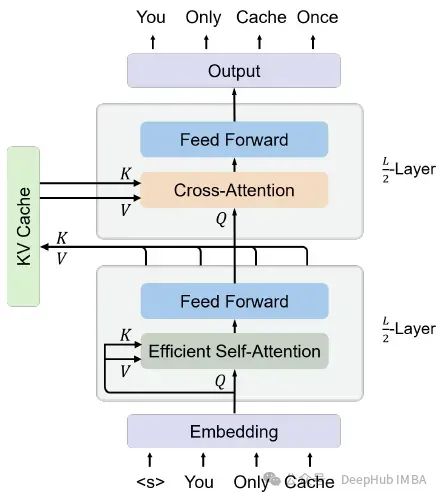

You Only Cache Once:YOCO 基于Decoder-Decoder 的一个新的大语言模型架构

这是微软再5月刚刚发布的一篇论文提出了一种解码器-解码器架构YOCO,因为只缓存一次KV对,所以可以大量的节省内存。

图机器学习入门:基本概念介绍

本篇文章将从基础开始介绍什么是图,我们如何描述和表示它们,以及它们的属性是什么。

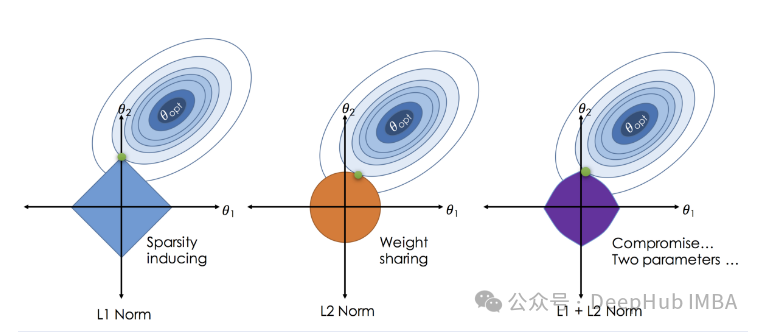

使用PyTorch实现L1, L2和Elastic Net正则化

在机器学习中,L1正则化、L2正则化和Elastic Net正则化是用来避免过拟合的技术,它们通过在损失函数中添加一个惩罚项来实现。

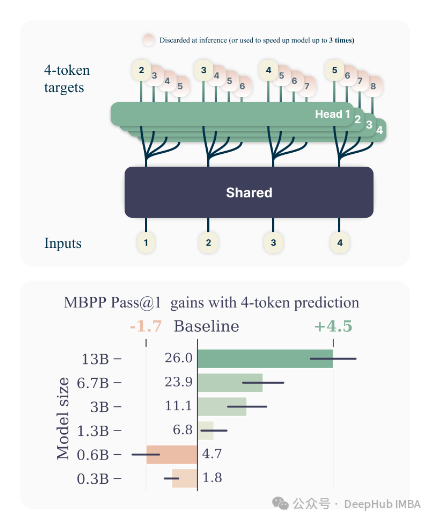

论文推荐:用多词元预测法提高模型效率与速度

作者们提出了一种创新的多词元预测方法,该方法在提高大型语言模型(LLMs)的样本效率和推理速度方面展示了显著优势。

号称能打败MLP的KAN到底行不行?数学核心原理全面解析

这篇文章将涉及大量的数学知识,主要介绍KAN背后的数学原理。