Hugging Face中的Accelerate:让训练速度飞起来

Hugging Face是人工智能领域中一个非常受欢迎的开源工具库,提供了许多方便的自然语言处理和深度学习模型,如BERT、GPT-3等。其中,Accelerate是Hugging Face中非常有用的一个工具,它可以大幅提高模型的训练速度。本文将详细介绍Accelerate的原理、用法以及代码实现

语义分割学习篇

主要是记录笔记,对语义分割进行的学习,包括经典模型的介绍

基于VideoReTalking+GFPGAN的AI数字人

VideoReTalking 是一个新颖的系统,用于根据输入音频编辑真实世界中的说话头部视频,生成具有不同情感的高质量和唇部同步的输出视频。wav2lip和VideoReTalking超分后效果对比。

Prompt、RAG、微调还是重新训练?如何选择正确的生成式AI的使用方法

从以上所有的比较中可以明显看出,没有明显的输赢。因为最终的选择取决于设计解决方案时最重要的指标是什么,我们的建议如下:当希望在更改模型和提示模板方面具有更高的灵活性,并且用例不包含大量域上下文时,可以使用Prompt Engineering。当想要在更改不同组件(数据源,嵌入,FM,矢量引擎)方面具

cv::Mat的四种复制操作和cv::Mat作为函数形参的四种形式

cv::Mat的四种复制操作及其cv::Mat作为函数形参的四种形式

MoveNet流程解析

第三步:根据粗略的关键点信息,构造一个以这个关键点坐标为中心生成一个权重矩阵,直接以等差数列0-47(47的原因是当关键点信息在边界时能够覆盖整个特征图(48*28)),中心点最小为0,往外依次递增的权重系数矩阵。原因:如果Heatmap中这个关键点与粗略关键点最靠近,说明这个关键点就属于最靠近图像

人工智能大模型和数据中台结合,实现“智能数据中台”的AI时代的数字化解决方案

在当今数字化时代,企业面临着海量数据的挑战,如何高效地管理和利用这些数据成为了企业发展的关键。数据中台是解决这一问题的重要手段,它可以等方面的工作,实现。而的出现,为数据中台的发展带来了新的机遇和挑战。本文将介绍人工智能大模型和数据中台的结合,探讨如何实现“”的数字化解决方案。

倍福位置记忆--TwinCAT对绝对值编码器溢出圈数的处理--以汇川IS620N为例

因此在实际对于多圈绝对值编码器中,若未超出圈数,则可以基于编码器反馈脉冲直接计算,若是超出了圈数则需要进行溢出圈数的计算,该数值需要在PLC中进行断电保持。共32位:其中精度站23位,圈数占9位,所以是8388608。反应到NC的为:即低32位为编码器的当前反馈。最小:-2149498568。编码器

T5模型简单介绍

谷歌公司的研究人员提出的T5(Text-to-Text Transfer Transformer,有5个T开头的单词,所以叫做T5)模型采用了一种与前述模型截然不同的策略:将不同形式的任务统一转化为条件式生成任务。

Halcon中亚像素边缘,轮廓提取处理的各种方法

halcon中亚像素轮廓提取目前来看,提取亚像素轮廓有三种思路

open3d,读取stl/ply/obj/off/gltf/glb三维模型,并转换成点云,保存

open3d,读取stl/ply/obj/off/gltf/glb三维模型,并转换成点云,保存

MIM(掩码图像建模)

MIM无法从更大的数据中获益?本文系统地研究了不同模型大小和训练长度下 MIM 方法的数据缩放能力,验证了掩码图像建模 (MIM) 不仅具有模型缩放的能力,也同样具有数据缩放的能力。本文是一篇实验探究类的工作,研究的问题是自监督学习 (掩码图像建模类方法) 的数据缩放问题。自监督学习的一个重要目标是

切比雪夫(Chebyshev)不等式

标准化设随机变量x具有数学期望E(x)=μE(x) = \muE(x)=μ,方差D(x)=σ2D(x) = \sigma^{2}D(x)=σ2。记X∗=X−μσX^{* } =\frac{X-\mu }{\sigma }X∗=σX−μ, 则X*的期望和方差为:E(X∗)=1σE(X−μ)=1σ[E

【AI大模型】训练Al大模型

目前所指的大模型,是“大规模深度学习模型”的简称,指具有大量参数和复杂结构的机器学习模型,可以处理大规模的数据和复杂的问题,多应用于自然语言处理、计算机视觉、语音识别等领域。

人工智能学习框架—飞桨Paddle人工智能

机器学习的三要素:模型、学习策略、优化算法。

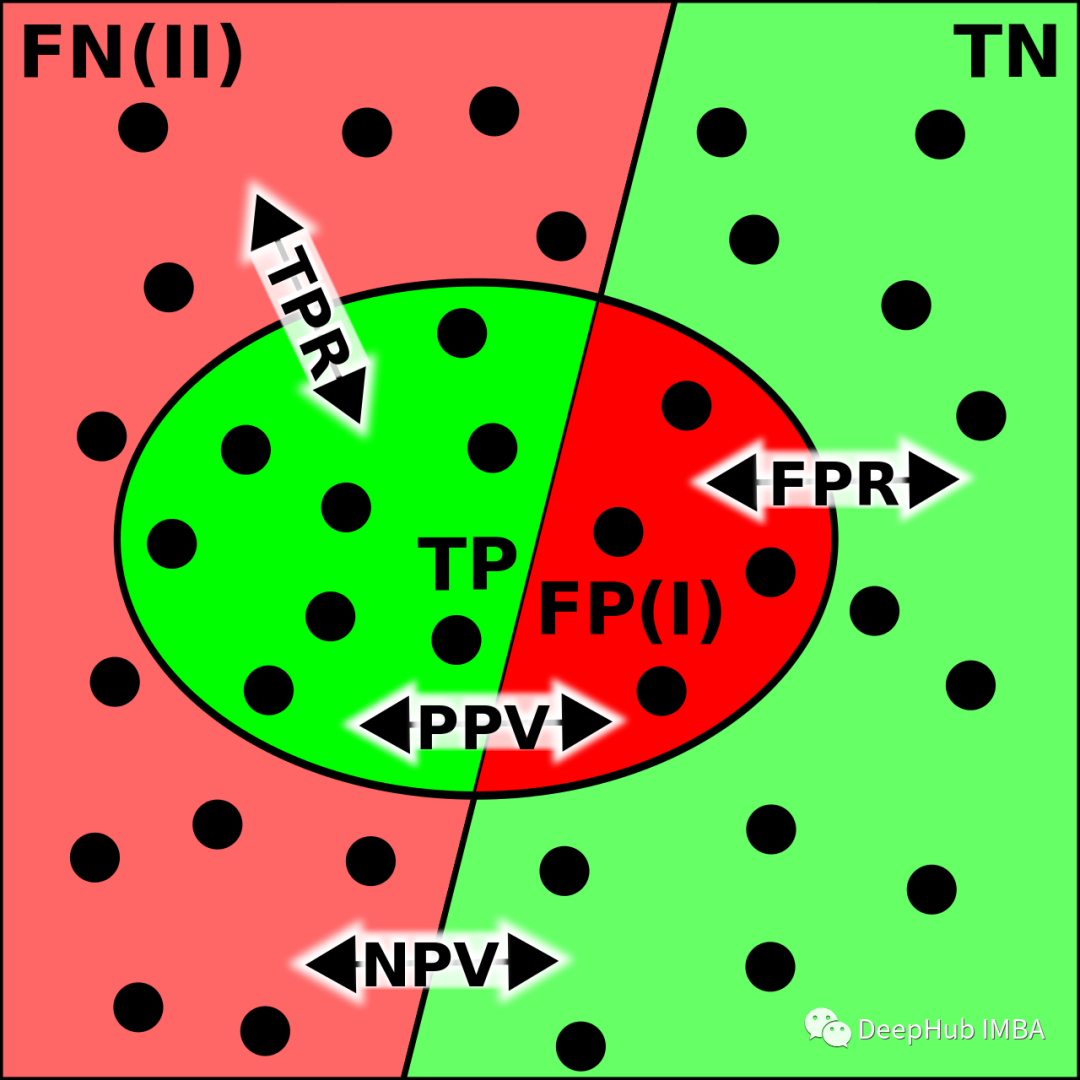

马修斯相关系数MCC简介

在评估机器学习模型的性能时,F1score都被首选指标。在本文中,我们将介绍一个值得更多关注和认可的替代度量:马修斯相关系数(MCC)。

中国大学生服务外包创新创业大赛丨借 AI 之力,助“记账”难题

从技术层面来说,无论是从技术栈的选择到整体系统架构的设计,都使用了前沿 IT 技术,包括团队在开发期间训练了四个模型用于 NLP 领域的文本分类与命名实体识别两个任务,并分别测试了其性能,都可以看出在保证项目的开发效率以及产品质量的同时,中国计量大学参赛团队对项目开发的精益求精。这一举措得到了积极的

大语言模型(LLM)分布式训练框架总结

©PaperWeekly 原创 ·作者 |避暑山庄梁朝伟背景随着 ChatGPT 的火爆出圈,大模型也逐渐受到越来越多研究者的关注。有一份来自 OpenAI 的研究报告 (Scaling laws for neural language models) 曾经指出模型的性能常与模型的参数规模息息相关,

锂电池寿命预测 | Pytorch实现基于Transformer 的锂电池寿命预测(NASA数据集)

锂电池寿命预测 | Pytorch实现基于Transformer 的锂电池寿命预测(NASA数据集)

模拟退火算法介绍和实例实现

一、模拟退火算法简介模拟退火算法(SA)来源于固体退火原理,是一种基于概率的算法。将固体加温至充分高的温度,再让其徐徐冷却,加温时,固体内部粒子随温升变为无序状,内能增大,分子和原子越不稳定。而徐徐冷却时粒子渐趋有序,能量减少,原子越稳定。在冷却(降温)过程中,固体在每个温度都达到平衡态,最后在常温