goldfish loss:减少训练数据泄漏,提高大语言模型输出的多样性

论文作者引入了一种名为"goldfish loss"的微妙修改,在训练过程中,随机抽样的一部分标记被排除在损失计算之外。这些被舍弃的标记不会被模型记忆,从而防止模型完整复制训练集中的一整个标记序列。

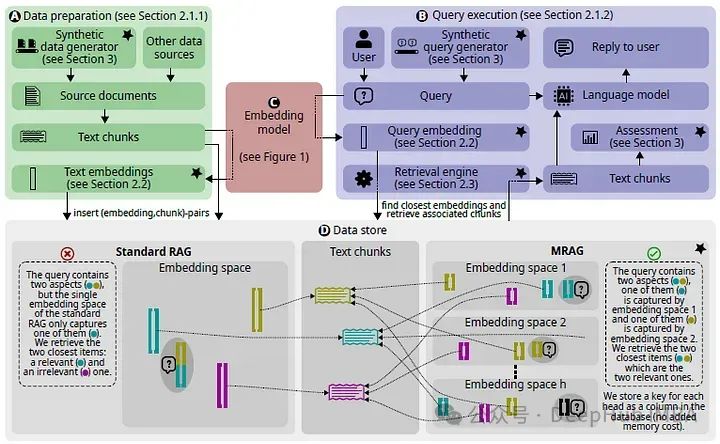

Multi-Head RAG:多头注意力的激活层作为嵌入进行文档检索

论文引入了多头RAG (MRAG),这是一种利用Transformer的多头注意层的激活而不是解码器层作为获取多方面文档的新方案。

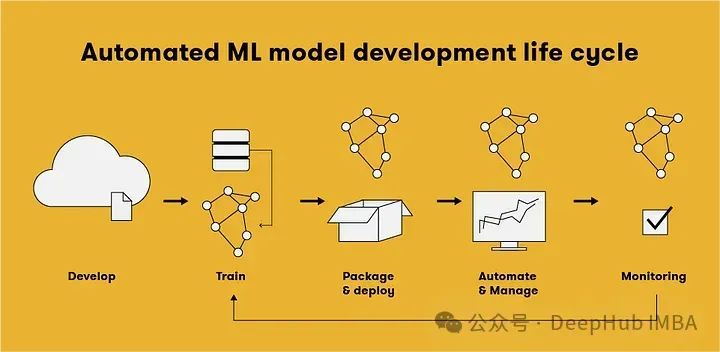

MLOps模型部署的三种策略:批处理、实时、边缘计算

在这篇文章中,我们将探讨三种常见的模型部署策略:批处理、实时和边缘计算。

Pixel Transformer:用像素代替补丁可以提升图像分类精度

本文将讨论Pixel Transformer的复杂性,创新方法,以及它对人工智能和计算机视觉未来的重要影响。

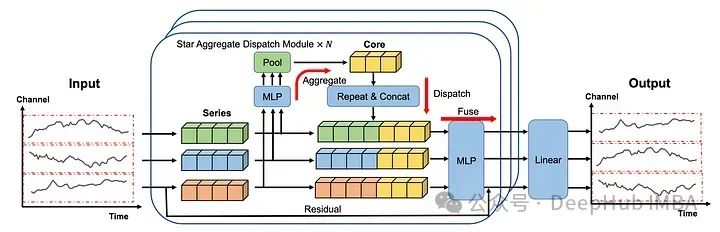

SOFTS: 时间序列预测的最新模型以及Python使用示例

这是2024年4月提出的新模型,采用集中策略来学习不同序列之间的交互,从而在多变量预测任务中获得最先进的性能。

使用‘消除’技术绕过LLM的安全机制,不用训练就可以创建自己的nsfw模型

在本文中,我们将探索一种称为“abliteration”的技术,它可以在不进行再训练的情况下取消LLM审查。这种技术有效地消除了模型的内置拒绝机制,允许它响应所有类型的提示。

通过元学习优化增益模型的性能:基础到高级应用总结

因果推断帮助我们理解不同变量间的因果关系,而增益模型则专注于评估干预措施对个体的影响,从而优化策略和行动。

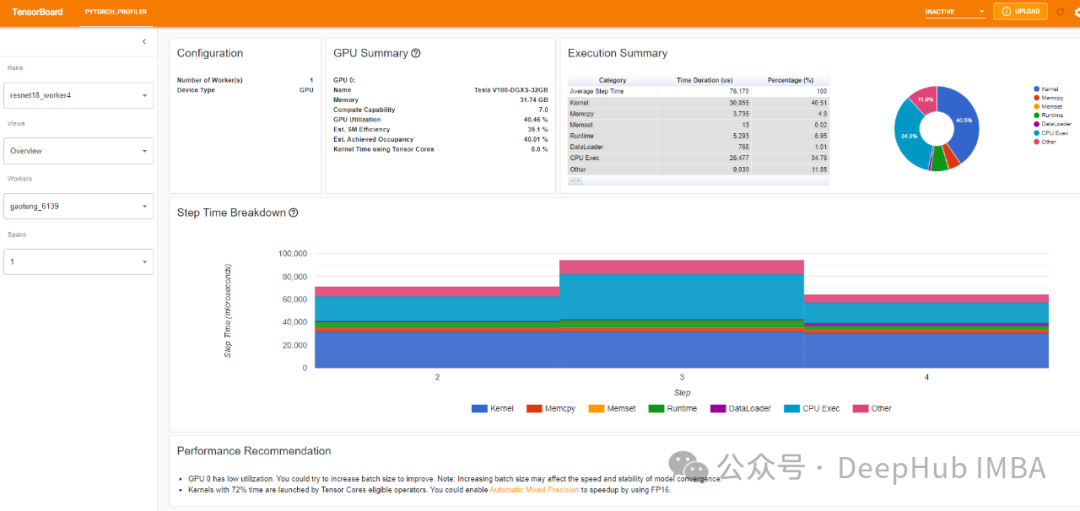

使用PyTorch Profiler进行模型性能分析,改善并加速PyTorch训练

加速机器学习模型训练是所有机器学习工程师想要的一件事。更快的训练等于更快的实验,更快的产品迭代,还有最重要的一点需要更少的资源,也就是更省钱。

Tiny Time Mixers (TTM)轻量级时间序列基础模型:无需注意力机制,并且在零样本预测方面表现出色

TTM是一个轻量级的,基于mlp的基础TS模型(≤1M参数),在零样本预测方面表现出色,甚至优于较大的SOTA模型。

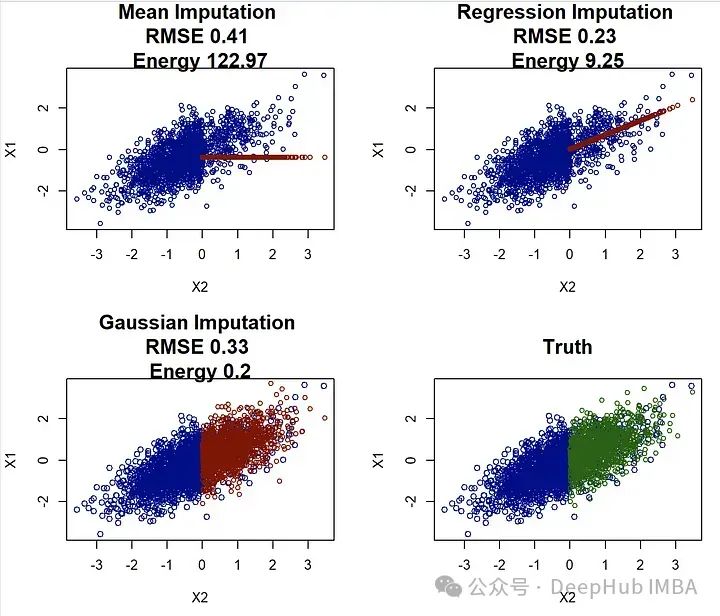

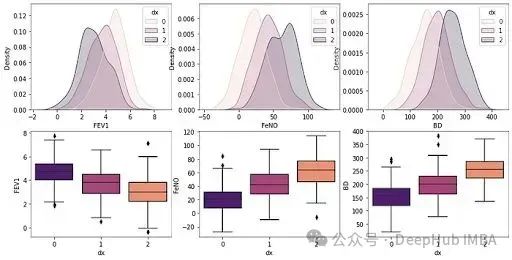

如何应对缺失值带来的分布变化?探索填充缺失值的最佳插补算法

本文将探讨了缺失值插补的不同方法,并比较了它们在复原数据真实分布方面的效果,处理插补是一个不确定性的问题,尤其是在样本量较小或数据复杂性高时的挑战,应选择能够适应数据分布变化并准确插补缺失值的方法。

数据并非都是正态分布:三种常见的统计分布及其应用

本文我们研究三种常见分布以及我们如何使用它们:正态分布、泊松分布和卡方分布。

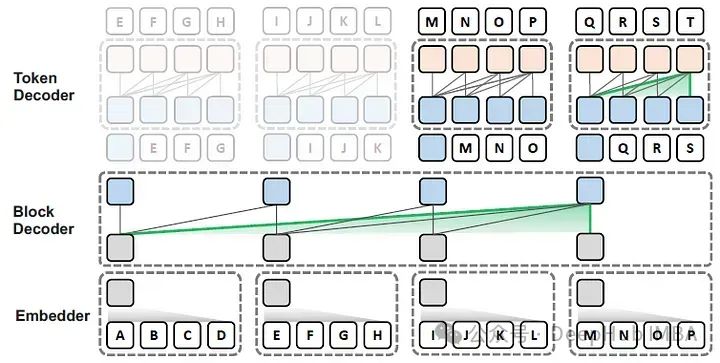

Block Transformer:通过全局到局部的语言建模加速LLM推理

在这篇论文中,作者提出了Block Transformer架构,该架构通过在较低层次之间的粗糙块(每个块代表多个令牌)的自注意力来模拟全局依赖性,并在较高层次的每个局部块内解码细粒度的令牌,

CNN依旧能战:nnU-Net团队新研究揭示医学图像分割的验证误区,设定先进的验证标准与基线模型

这篇论文研究了在3D医学图像分割领近年引入了许多新的架构和方法,但大多数方法并没有超过2018年的原始nnU-Net基准。作者指出,许多关于新方法的优越性的声称在进行严格验证后并不成立,这揭示了当前在方法验证上存在的不严谨性。

从提示工程到代理工程:构建高效AI代理的策略框架概述

本框架旨在提供一个实用的思维模型,虽不全面,但足以作为一个起点,随后可根据实际需要进行细化和扩展。

一切模型皆可联邦化:高斯朴素贝叶斯代码示例

一般情况下我们对联邦学习的理解都是大模型和深度学习模型才可以进行联邦学习,其实基本上只要包含参数的机器学习方法都可以使用联邦学习的方法保证数据隐私。

为什么你的RAG不起作用?失败的主要原因和解决方案

本文的目标是揭示普通RAG失败的主要原因,并提供具体策略和方法,使您的RAG更接近生产阶段。

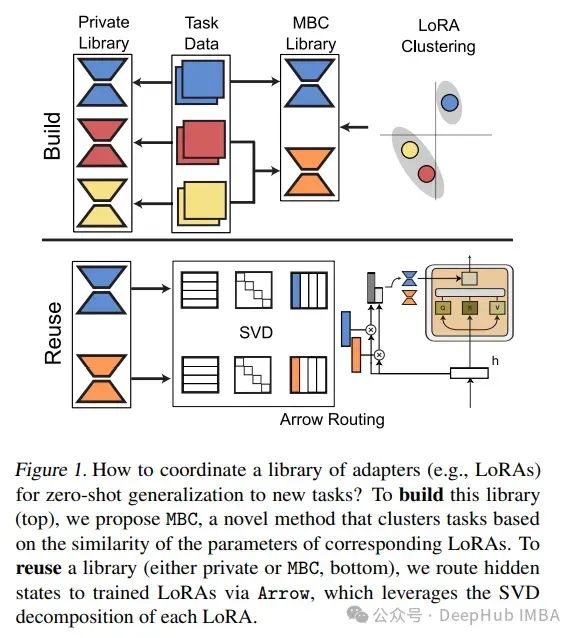

2024年5月第四周LLM重要论文总结

本文总结了2024年5月第四周发表的一些最重要的LLM论文。这些论文的主题包括模型优化和缩放到推理、基准测试和增强性能。

通过f-string编写简洁高效的Python格式化输出代码

Python 3.6中引入的f-string是Python中最常用的特征之一,它可以让我们编写更干净、更高效和更易于维护的代码,我们今天就由浅入深来详细介绍使用它的一些技巧。

长序列中Transformers的高级注意力机制总结

本文的重点是深入研究长序列种应用的高级注意力机制的数学复杂性和理论基础