Pytorch 2.0来了!来看看新特性怎么应用到自己的代码里

Pytorch2.0和GPT4、文心一言同一时间段发布,可谓是热闹至极,我看了看Pytorch 2.0的文档,一句话概括下,2.0的功能介绍,核心就是加入这行代码就能优化你的模型,优化后的模型和往常使用方式一样,推理速度会提升,比较重要的一点是,可以用于训练或者部署,训练可以传梯度,这次是带有AOT

基于深度学习方法的车道线检测综述(2022)

车道线算法综述,一问入门车道线检测算法。

论文学习——Tune-A-Video

通过文本生成视频的深度学习方法

手把手带你调参Yolo v5(二)

这次主要解析源码中train.py文件中包含的参数。

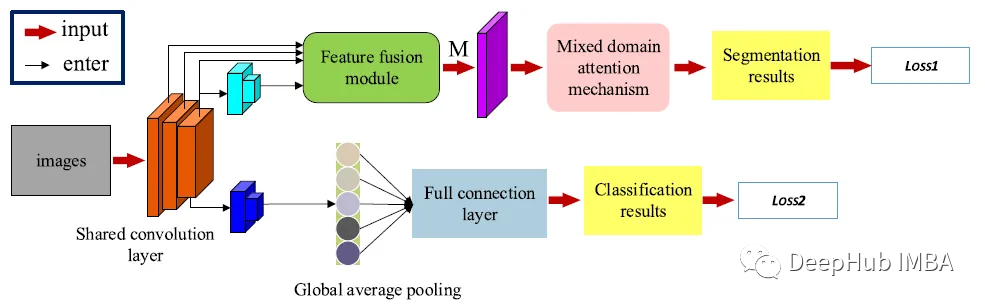

论文推荐:基于联合损失函数的多任务肿瘤分割

以FFANet为主干,加入分类的分支,将模型扩展为多任务图像分割框架,设计了用于分类和分割的联合损失函数。

【深度学习】ResNet网络详解

ResNet

CVPR 2023 | OpenGait: 步态识别开源框架介绍

如果您也对人工智能和计算机视觉全栈领域感兴趣,强烈推荐您关注有料、有趣、有爱的公众号『CVHub』,每日为大家带来精品原创、多领域、有深度的前沿科技论文解读及工业成熟解决方案!同时欢迎添加小编微信: cv_huber,备注CSDN,加入官方学术|技术|招聘交流群,一起探讨更多有趣的话题!

【深度学习】Stable Diffusion AI 绘画项目搭建详解,并运行案例

先把人家的git放过来:https://github.com/CompVis/stable-diffusion40.7k 的stars, flask 和 django 两个web框架也不过如此数量级吧。就是给一段文字,它能按照文字描述给你画画。画出来的还挺好看,是一个text-to-image di

YOLOv5图像分割中的NMS处理

在上一篇文章有讲到图像经过YOLOv5网络后得到的输出形式,主要是调用了BaseModel类下的forward得到的输出,输出的shape为【batch,25200,117】,这里的25200相当于总的anchors数量【以640*640的输入为例,共有anchors=80*80*3+40*40*3

基于图片翘曲的后门攻击WaNet源码分析

对于WaNet后门攻击测试一些基本架构源码分析

ChatGLM-6B:颠覆聊天AI的全新模型

ChatGLM-6B是一个基于GPT-3的生成式对话模型。它由清华大学的研究团队开发,旨在改进聊天机器人的生成质量和对话逻辑。ChatGLM-6B采用了全新的训练方法,通过在大规模对话数据集上进行预训练,提升了模型的生成能力和对话质量。

【已解决】探究CUDA out of memory背后原因,如何释放GPU显存?

本文探究CUDA的内存管理机制,总结RuntimeError: CUDA out of memory的背后原因,并给出解决方案

经典分类模型回顾4-Resnet实现图像分类(matlab)

ResNet(Residual Network)是由Microsoft Research团队提出的一种深度卷积神经网络结构,它在ImageNet图像分类比赛中获得了第一名的成绩。ResNet的主要特点是引入了残差块(Residual Block)的概念,使得网络可以更深,并且训练效果更好。在ResN

计算机视觉之姿态识别(原理+代码实操)

计算机视觉中的姿态识别原理+模型介绍,同时通过代码实操简单的演示基于mediapipe的单人姿态识别。

Tensorflow1 搭建Cuda11

Tensorflow1中默认支持cuda10及以下的,最高的版本Tensorflow1.15默认使用cuda10;但是一些高性能的显卡,比如A100、3090等,它们只支持Cuda11的,这就不太友善了,毕竟不少项目依赖Tensorflow1搭建的。本文整理2种方法,一种是基于Conda搭建的,一种

Pytorch对预训练好的VGG16模型进行微调

对于一个复杂的卷积神经网络来说,通常网络的层数非常大,网络的深度非常深、网络的参数非常多,单单设计一个卷积网络就需要颇费心思,何况网络还需要大量的数据集进行漫长时间的训练,若没有一个好的算力平台也很难迅速训练出模型。可见,从头到尾搭建一个中等规模的卷积神经网络对于我们来说绝非易事。幸运的是PyTor

基于PyTorch+CNN一维卷积实现短期电力负荷预测

本项目使用了一种基于一维卷积CNN短期电力负荷预测方法,该方法将历史负荷数据作为输入,将输入向量构造为时间序列形式作为 Conv1D 网络的输入,建模学习特征内部动态变化规律,最后完成短期负荷预测。

BERT模型基本理念、工作原理、配置讲解(图文解释)

BERT模型基本理念、工作原理、配置讲解(图文解释)

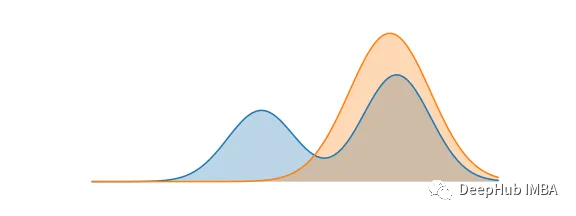

KL散度和交叉熵的对比介绍

KL散度(Kullback-Leibler Divergence)和交叉熵(Cross Entropy)是在机器学习中广泛使用的概念。这两者都用于比较两个概率分布之间的相似性,但在一些方面,它们也有所不同。本文将对KL散度和交叉熵的详细解释和比较。

优化器SGD、Adam和AdamW的区别和联系

优化器是用来更新和计算影响模型训练和模型输出的网络参数,使其逼近或达到最优值,从而最小化(或最大化)损失函数。