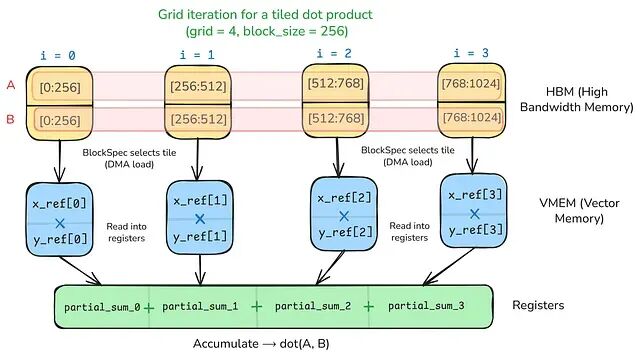

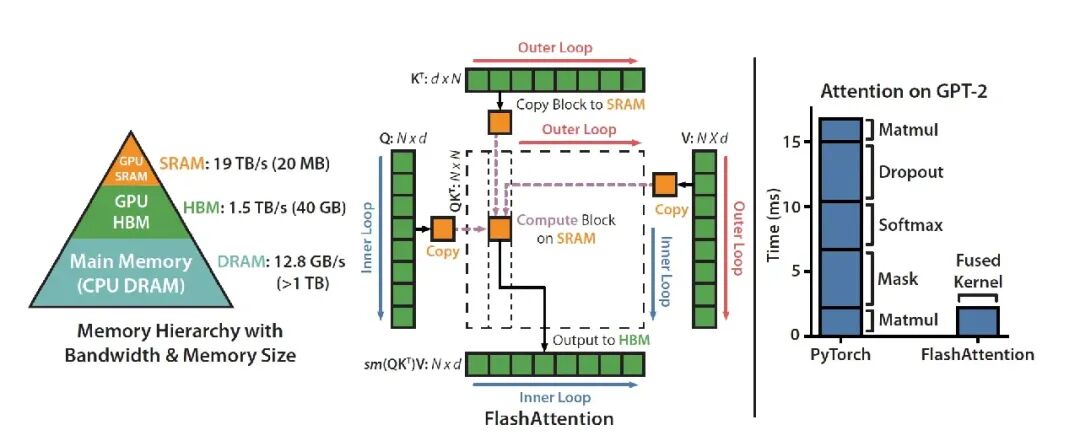

TPU 架构与 Pallas Kernel 编程入门:从内存层次结构到 FlashAttention

本文通过四个复杂度递增的 kernel 展示了 Pallas 的核心编程模式

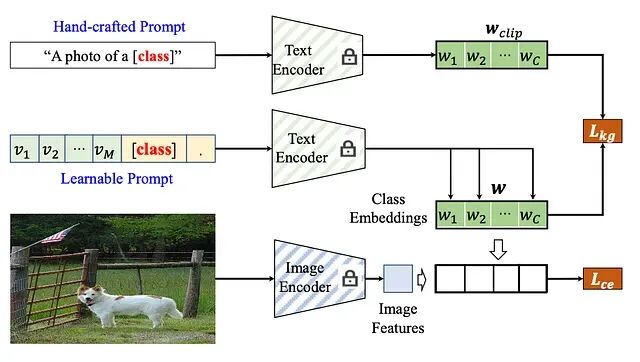

知识引导上下文优化(KgCoOp):一种解决灾难性遗忘的 Prompt Tuning 机制

如何使用知识引导损失对可学习 Prompt 进行正则化以保持泛化能力。

Claude Code 命令体系解析:三种类型、七大分类、50+ 命令

这篇文章覆盖每一个斜杠命令、每一个 CLI 标志、每一个键盘快捷键,以及开发团队从未正式宣布就悄悄上线的隐藏功能

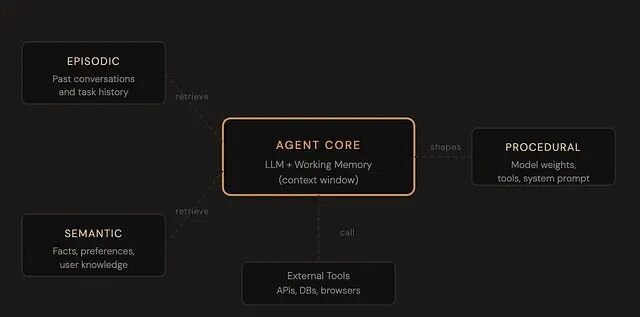

理解 Agent 记忆:从无状态模型到持久化记忆架构

Agent 记忆并非单一概念,它是一个四层体系,各层服务于不同目的。

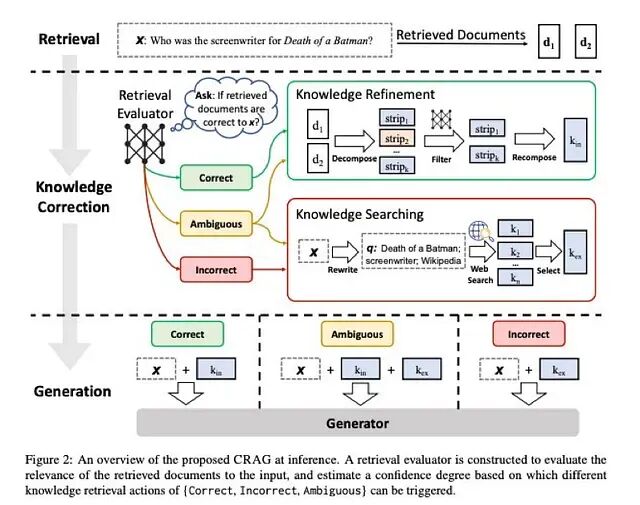

CRAG 架构解析:如何在生成器前修正错误检索结果

绝大多数 RAG 系统把检索当作不会出错的环节,无论拿到的文档是否真正切题,都会径直送入生成器。

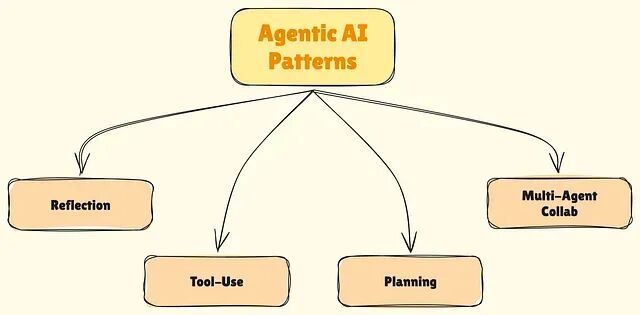

构建生产级 AI Agent 系统的4大主流技术:反思、工具、规划与多智能体协作

本文拆解当下重塑AI系统构建方式的4种核心 Agentic 模式,分析每种模式的工作机制、适用场景,以及如何将它们组合出真正可用的系统。

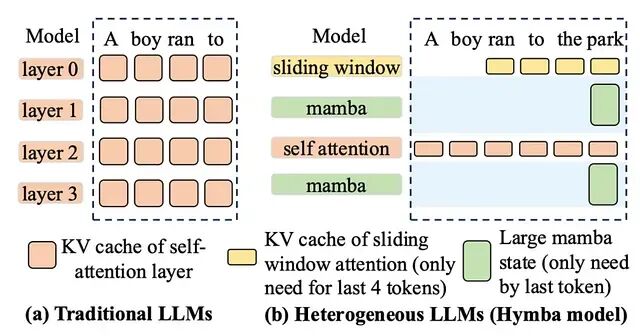

KV Cache管理架构演进:从连续分配到统一混合内存架构

本文梳理KV cache管理经历的5个时代,从它根本不存在的阶段,到今天正在成型的统一内存架构。文中会结合多个模型的部署经验,对比vLLM、SGLang和TensorRT-LLM在各阶段的应对思路。

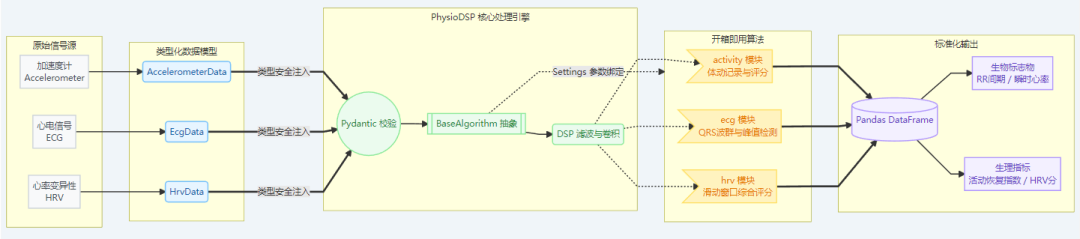

PhysioDSP:一个面向可穿戴设备的 Python 信号处理库

PhysioDSP 是一个开源 Python 库,它给出了一套统一、可扩展的框架来处理和分析生理传感器数据

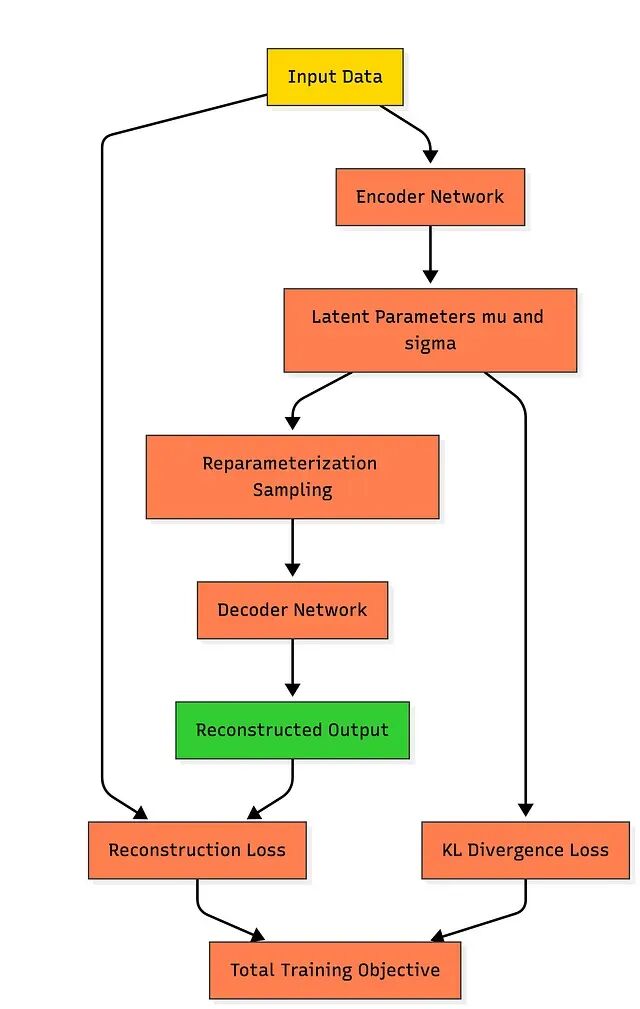

VAE 原理拆解:从概率编码到潜在空间正则化

这篇文章从基本原理出发完整拆解变分自编码器(VAE)的构建过程。

基于能量的模型(EBM):用能量函数替代概率分布的建模框架

Yann LeCun 反复强调过一个观点:当前LLM基于概率、逐 Token 预测的设计路线,很可能走不到人类水平的AI。他的团队更看好另一条路,基于能量的模型(EBM)。

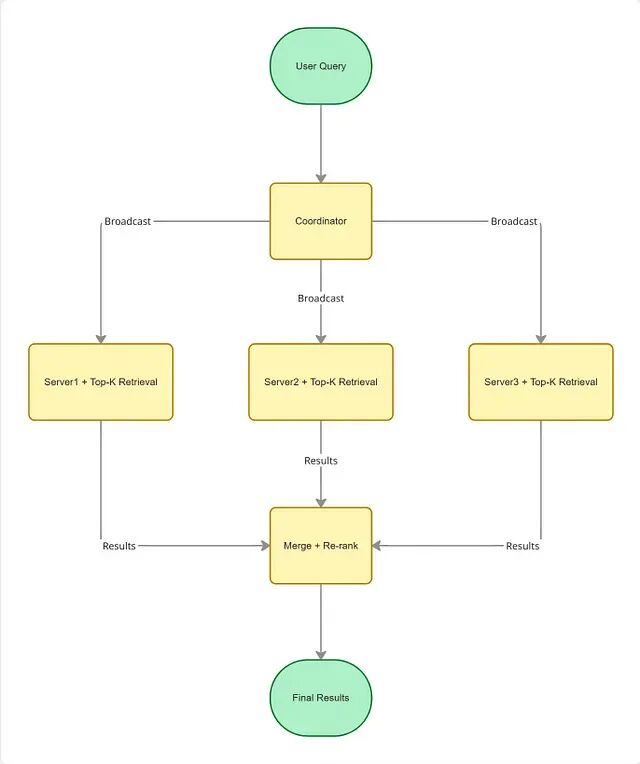

向量搜索系统的三个核心优化维度:速度、精度与规模

向量搜索把信息检索从字面匹配带进了语义理解的时代。但光有 Embedding 还不够,真正让系统在生产环境中跑起来的是背后的工程优化

RAG 文本分块:七种主流策略的原理与适用场景

分块就是在生成 Embedding 之前,把大段文本拆成更小语义单元的过程。检索器真正搜索的对象而不是整篇文档就是这些分块。

从零开始用自定义 Triton 内核编写 FlashAttention-2

本文只实现了前向传播。扩展到完整的训练级 FlashAttention(反向传播、dropout、各种 mask 变体)留待后续工作。

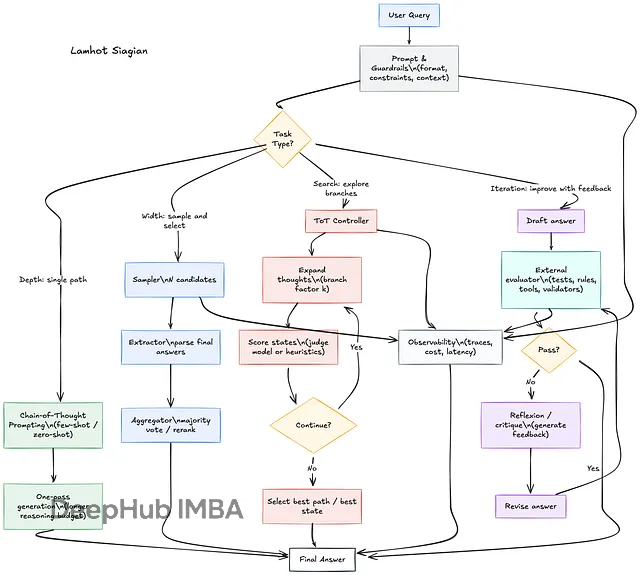

LLM推理时计算技术详解:四种提升大模型推理能力的方法

本文要讲四种主流的推理时计算技术:深度方向的Chain-of-Thought,宽度方向的Self-Consistency,搜索方向的Tree-of-Thoughts,以及迭代方向的Reflexion/Self-Refine。

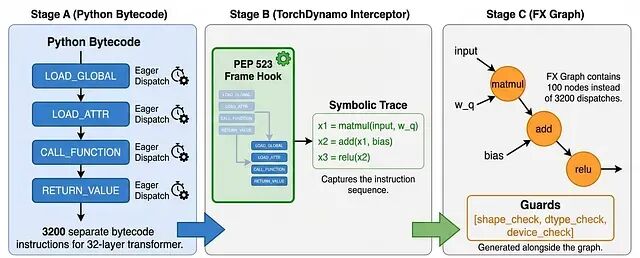

torch.compile 加速原理:kernel 融合与缓冲区复用

torch.compile 的价值在于:它把原本需要手写 CUDA 或 Triton 才能实现的优化,封装成了一行代码的事情。

让 AI 智能体学会自我进化:Agent Lightning 实战入门

本文将介绍 Agent Lightning 的核心架构和使用方法,并通过一个开源的"自修复 SQL 智能体"项目演示完整的训练流程。

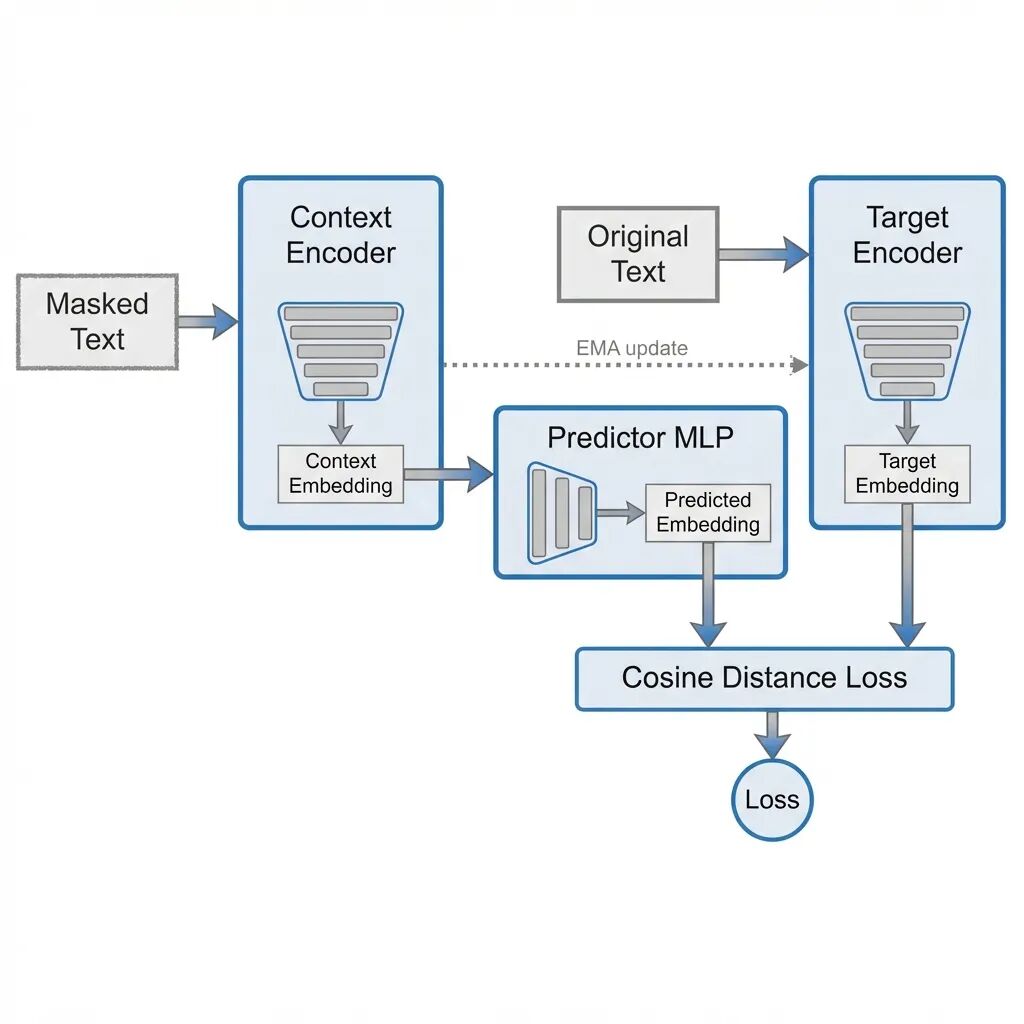

用 PyTorch 实现 LLM-JEPA:不预测 token,预测嵌入

这篇文章从头实现 LLM-JEPA: Large Language Models Meet Joint Embedding Predictive Architectures。

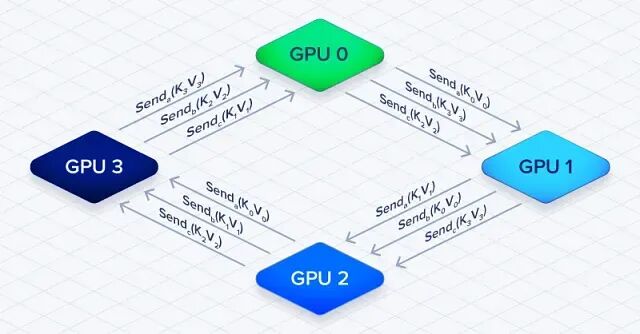

大模型如何训练百万 Token 上下文:上下文并行与 Ring Attention

上下文并行本质上是拿通信开销换内存空间,把输入序列切到多张 GPU 上,突破训练时的内存限制

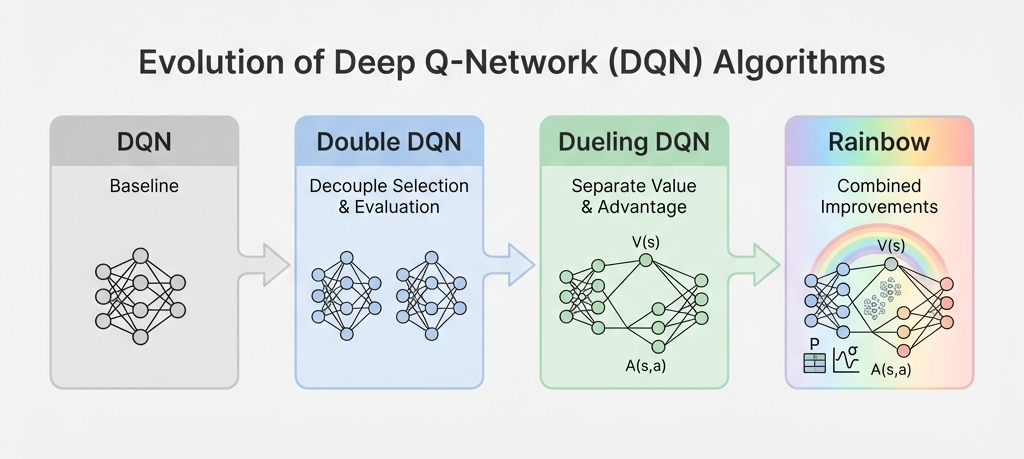

让 Q 值估计更准确:从 DQN 到 Double DQN 的改进方案

这篇文章要内容包括:DQN 为什么会过估计、Double DQN 怎么把动作选择和评估拆开、Dueling DQN 怎么分离状态值和动作优势、优先经验回放如何让采样更聪明,

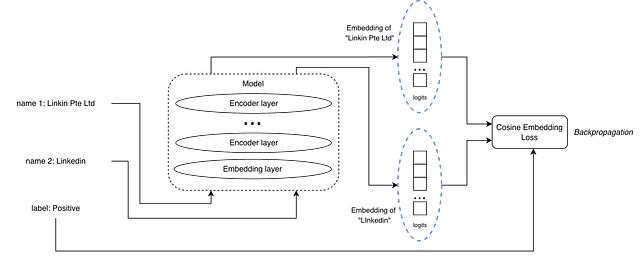

RAG 检索模型如何学习:三种损失函数的机制解析

本文将介绍我实验过的三种方法:Pairwise cosine embedding loss(成对余弦嵌入损失)、Triplet margin loss(三元组边距损失)、InfoNCE loss。