从零开始构建图注意力网络:GAT算法原理与数值实现详解

本文文会详细拆解GAT的工作机制,用一个具体的4节点图例来演示整个计算过程。如果你读过原论文觉得数学公式比较抽象,这里的数值例子应该能让你看清楚GAT到底是怎么运作的。

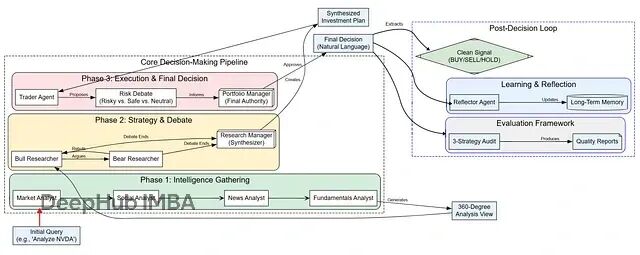

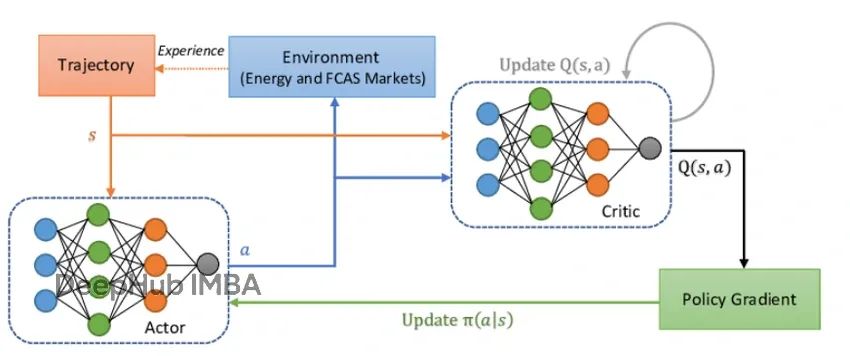

LangGraph实战:从零构建智能交易机器人,让多个AI智能体像投资团队一样协作

这个基于LangGraph的多智能体量化交易系统代表了AI在金融决策领域的一个重要进展本文展示的完整实现代码已经为读者提供了一个可运行的起点。

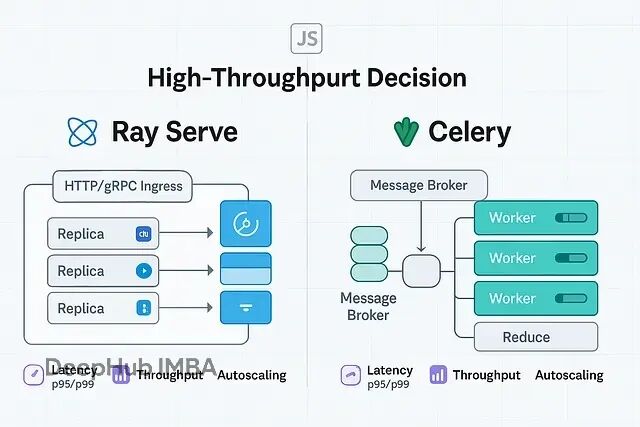

GPU集群扩展:Ray Serve与Celery的技术选型与应用场景分析

当你需要处理大规模并行任务,特别是涉及GPU集群的场景时,Ray Serve和Celery是两个主要选择。但它们的设计理念完全不同

DINOv3上手指南:改变视觉模型使用方式,一个模型搞定分割、检测、深度估计

DINOv3是Meta推出的自监督视觉骨干网络,最大的亮点是你可以把整个backbone冻住不动,只训练一个很小的任务头就能在各种密集预测任务上拿到SOTA结果。

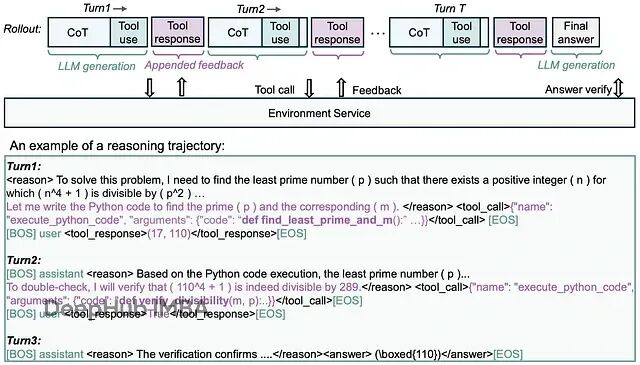

微软rStar2-Agent:新的GRPO-RoC算法让14B模型在复杂推理时超越了前沿大模型

Microsoft Research最近发布的rStar2-Agent展示了一个令人瞩目的结果:一个仅有14B参数的模型在AIME24数学基准测试上达到了80.6%的准确率,超越了671B参数的DeepSeek-R1(79.8%)。

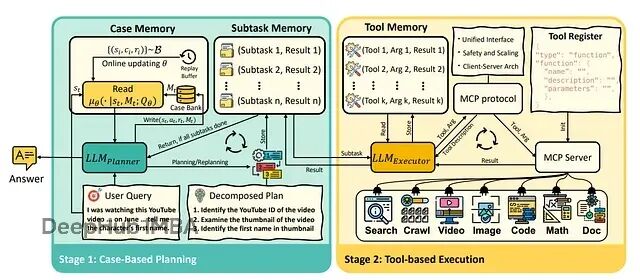

Memento:基于记忆无需微调即可让大语言模型智能体持续学习的框架

Memento框架通过基于记忆的在线强化学习实现低成本持续适应,完全避免了对LLM的微调需求。

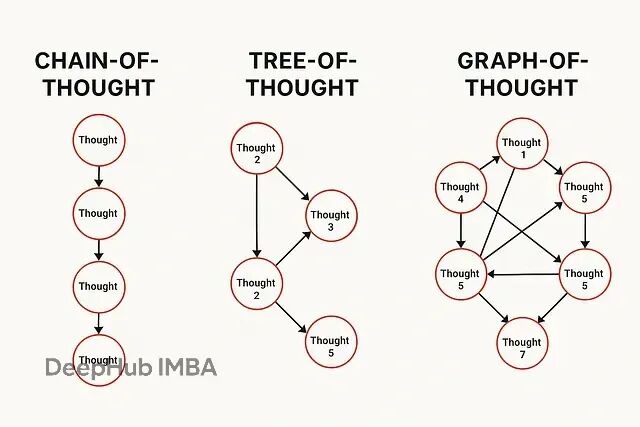

AI推理方法演进:CoT、ToT与GoT技术对比分析

从CoT到GoT的演进轨迹展现了AI推理范式的根本性变革:从单一路径的顺序推理转向多维度的并行思维模拟。这一进程标志着大语言模型研究重心从参数规模竞争转向认知机制建模。

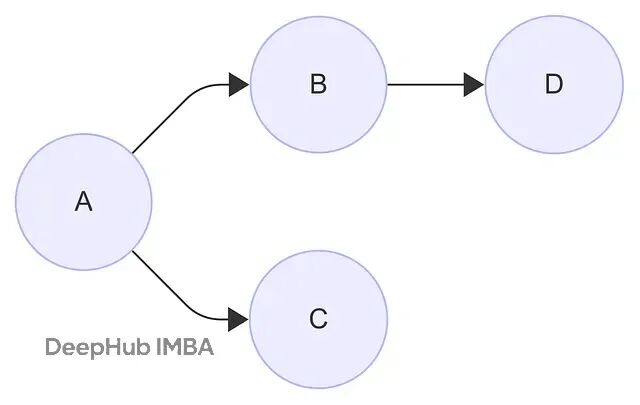

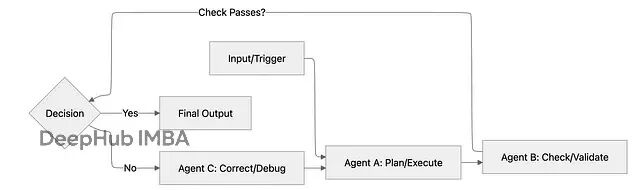

多智能体系统设计:5种编排模式解决复杂AI任务

我们这里分析5种主流的智能体编排模式,每种都有其适用场景和技术特点。

神经架构搜索NAS详解:三种核心算法原理与Python实战代码

最近好多论文开始将 **神经架构搜索(NAS)** 应用于**大模型**或 **大型语言/视觉语言模型**的设计中。所以我来回顾一下NAS的基础技术。

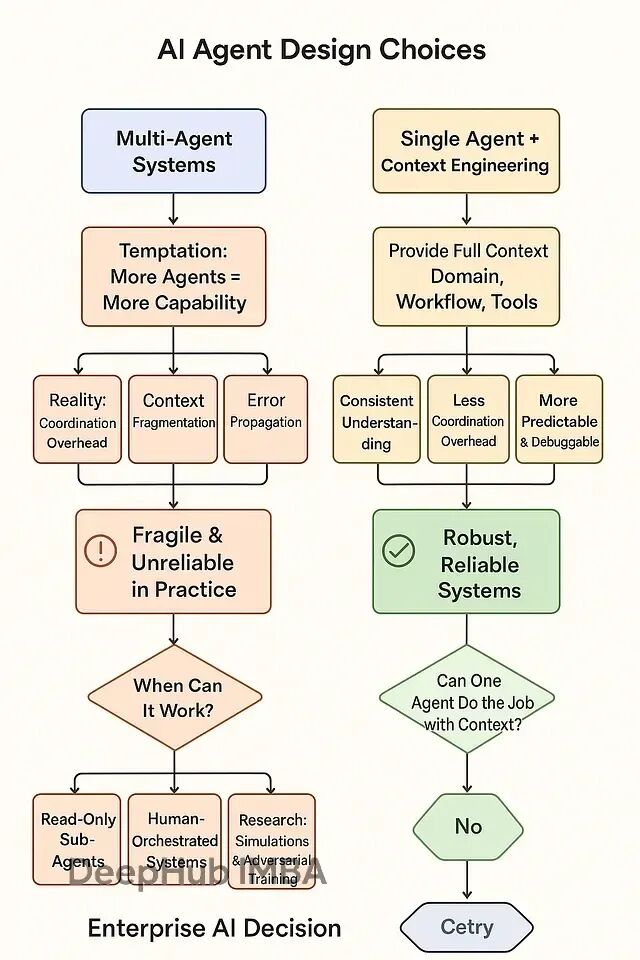

多智能体协作为什么这么难:系统频繁失败的原因分析与解决思路

在AI系统设计初期,将智能体数量与系统能力划等号是一种直观但错误的思维模式。但是根据AI研究领域的实证结果,这种多智能体分工模式在实际应用中暴露出严重的系统性缺陷。多智能体系统的根本性问题在于协调机制的复杂性往往超过其带来的功能收益

NVFP4量化技术深度解析:4位精度下实现2.3倍推理加速

本文将从技术角度深入分析NVFP4与主流4位量化方法(AWQ、AutoRound、bitsandbytes)的性能对比,并探讨在Blackwell GPU环境下采用NVFP4方案的实际价值。

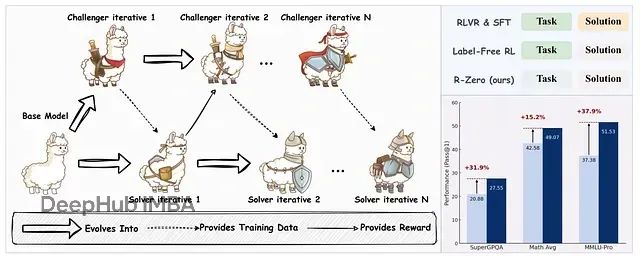

R-Zero:通过自博弈机制让大语言模型无需外部数据实现自我进化训练

R-Zero框架实现了大语言模型在无外部训练数据条件下的自主进化与推理能力提升。

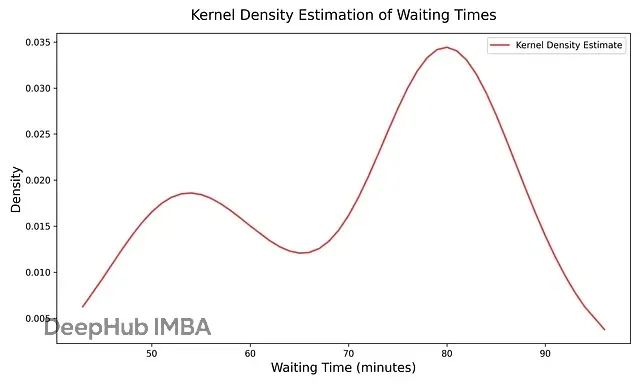

数据分布平滑化技术:核密度估计KDE解决直方图不连续问题

直方图提供了分布的粗略概念,但存在跳跃性和块状特征。核密度估计通过在数据点上放置平滑曲线并求和的方式解决了这一问题,提供了密度的连续视图。

匹配网络处理不平衡数据集的6种优化策略:有效提升分类准确率

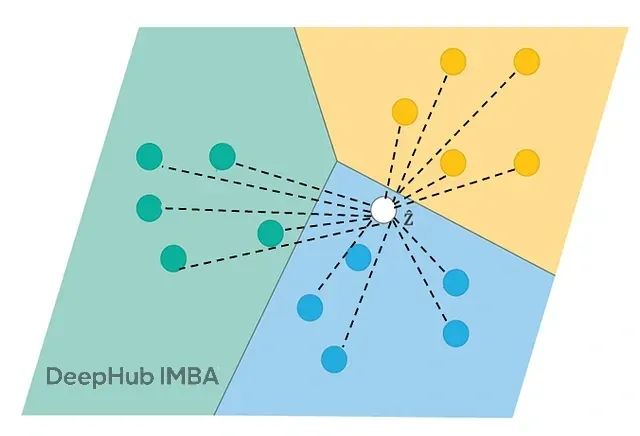

匹配网络(**Matching Networks**)是基于度量的元学习方法,通过计算查询样本与支持集中各样本的相似性实现分类。

HiRAG:用分层知识图解决复杂推理问题

该系统基于图检索增强生成(GraphRAG)的核心思想,通过引入层次化架构来处理不同抽象层次的知识复杂度。

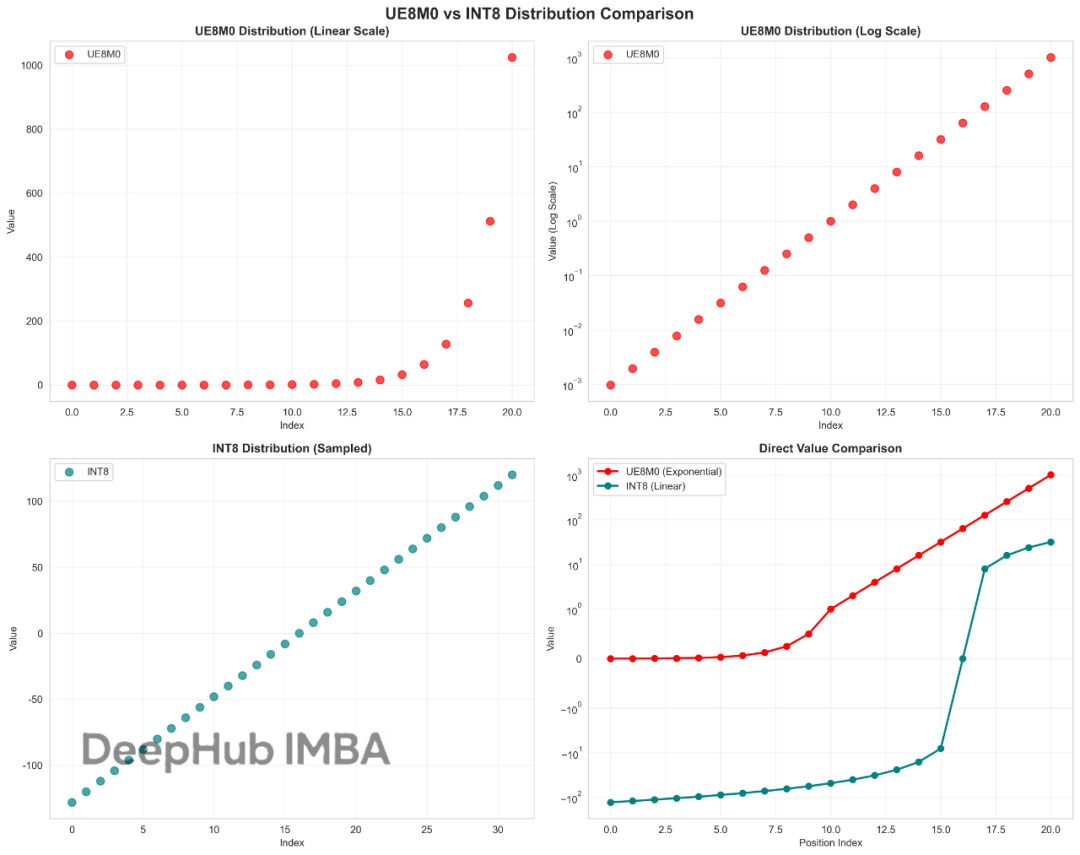

这也许就是DeepSeek V3.1性能提升的关键:UE8M0与INT8量化技术对比与优势分析

UE8M0作为FP8格式家族中的一个特殊变体,我们今天来看看这个UE8M0到底是什么。

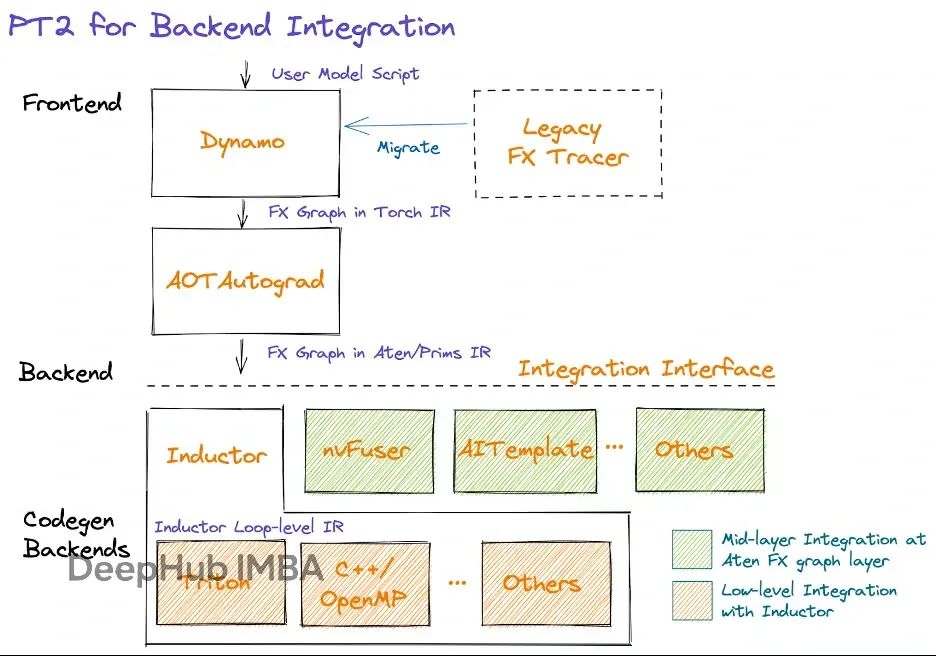

PyTorch 2.0性能优化实战:4种常见代码错误严重拖慢模型

我们将深入探讨图中断(graph breaks)和多图问题对性能的负面影响,并分析PyTorch模型开发中应当避免的常见错误模式。

近端策略优化算法PPO的核心概念和PyTorch实现详解

本文提供了PPO算法的完整PyTorch实现方案,涵盖了从理论基础到实际应用的全流程。

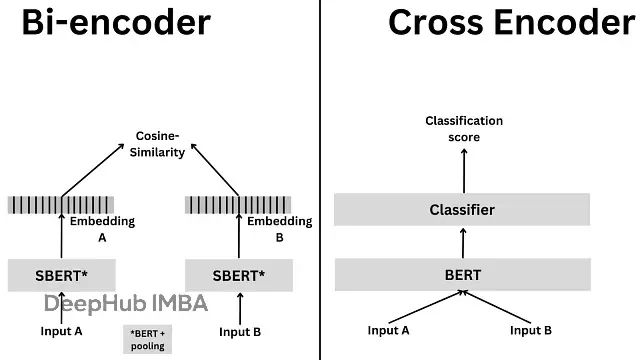

RAG系统文本检索优化:Cross-Encoder与Bi-Encoder架构技术对比与选择指南

本文将深入分析这两种编码架构的技术原理、数学基础、实现流程以及各自的优势与局限性,并探讨混合架构的应用策略。

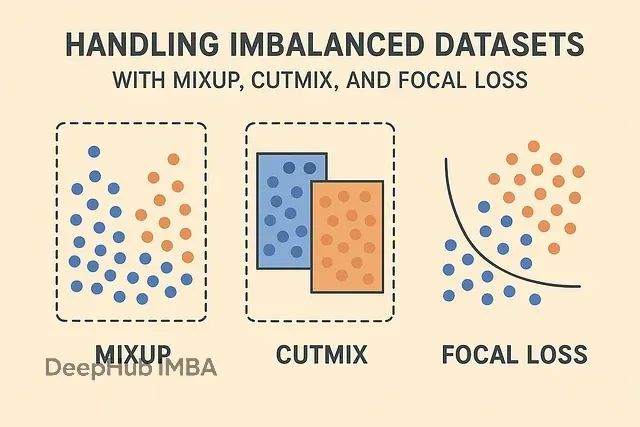

让模型不再忽视少数类:MixUp、CutMix、Focal Loss三种技术解决数据不平衡问题

针对不平衡数据集的挑战,研究界通常采用数据增强技术与损失函数优化相结合的策略。