你知道ChatGPT里面的G、P、T分别代表什么吗?

早期,知识以结构化的方式存储在数据库中。我们通过 SQL获取。后来,随着互联网的诞生,更多文本、图片、视频等非结构化知识存储在互联网中。我们通过搜索引擎获取。现在,知识以参数的形式存储在大模型中。我们用自然语言直接调用这些知识。

从UIE模型理解到UIE工业实战

UIE模型,文本-结构化数据

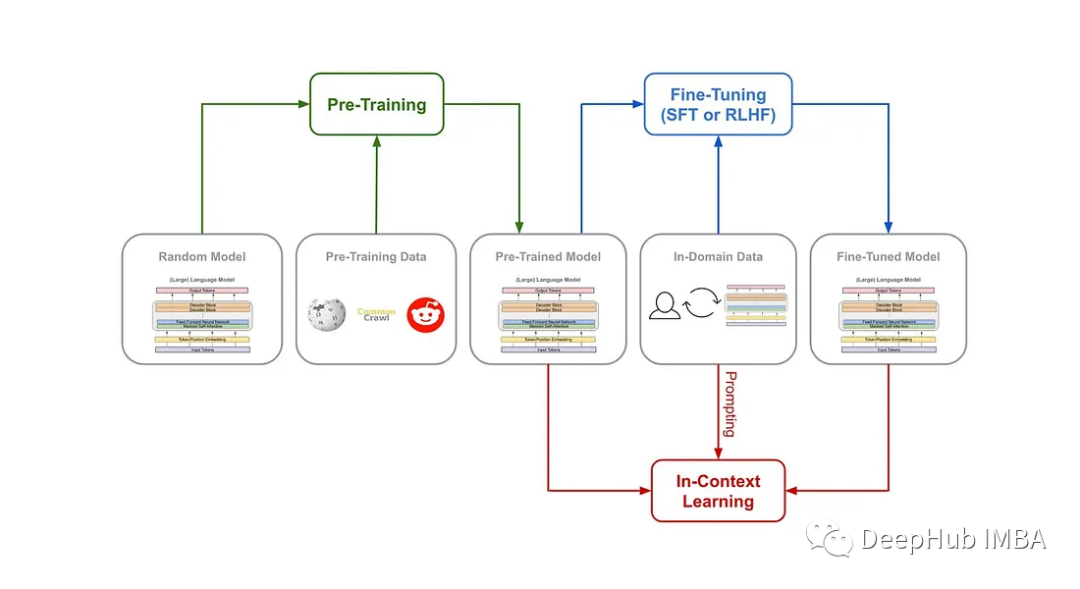

预训练、微调和上下文学习

最近语言模型在自然语言理解和生成方面取得了显著进展。这些模型通过预训练、微调和上下文学习的组合来学习。在本文中将深入研究这三种主要方法,了解它们之间的差异,并探讨它们如何有助于语言模型的学习过程。

开源大语言模型完整列表

Large Language Model (LLM) 即大规模语言模型,是一种基于深度学习的自然语言处理模型,它能够学习到自然语言的语法和语义,从而可以生成人类可读的文本。LLM 通常基于神经网络模型,使用大规模的语料库进行训练,比如使用互联网上的海量文本数据。这些模型通常拥有数十亿到数万亿个参数,

近3三年多模态情感分析论文及其代码

star:444;CMU-MOSEI的sota4;CMU-MOSEI排行第3。MOSI数据排行第1。在CMU-MOSE数据集排行榜。在MOSI数据集排行榜。

一文带你读懂什么是ChatGPT?

ChatGPT是一款基于人工智能的聊天机器人,它可以回答各种问题和话题,是目前最流行的聊天机器人之一。ChatGPT的历史可以追溯到2015年,当时谷歌推出了一款名为Google Assistant的聊天机器人,它使用了一种叫做人工神经网络的技术,以更自然的方式与用户交互。这引发了人们对聊天机器人的

ACE2005数据集介绍、预处理及事件抽取

ACE2005数据集的介绍、中英文的预处理以及事件抽取的样例参考

爆红的chatgpt是如何诞生的?

未来,随着 ChatGPT性能进一步提升和应用范围扩大,其应用范围还将不断扩展到其他语言环境下的问答系统等领域,比如面向自然语言处理领域的多语言问答系统、面向机器翻译领域的多语言翻译系统、面向聊天机器人领域的多语言聊天机器人等。ChatGPT系统在文本生成过程中采用了基于 Transformer架构

使用NLPAUG 进行文本数据的扩充增强

数据增强可以通过添加对现有数据进行略微修改的副本或从现有数据中新创建的合成数据来增加数据量。这种数据扩充的方式在CV中十分常见,因为对于图像来说可以使用很多现成的技术,在保证图像信息的情况下进行图像的扩充。

GPT-3.5-turbo小白连接教程

以上就是全部内容了,也是参考官网的教程来搞得,没啥技术含量,就当记录一下小白的成长经历吧。

GLM-130B-一个开放的双语通用预训练模型-论文精读

本文为作为类ChatGPT的模型ChatGLM的前期基础论文2《AN OPEN BILINGUAL PRE-TRAINED MODEL》的精读笔记。GLM-130B,主要思想概述:一个双语(英文和中文)的基于GLM的双向稠密模型。并没有使用GPT风格的架构,而是采用通用语言模型(GLM)算法(Du

免费可用的ChatGPT网页版

chat:表示“聊天”。GPT:则是Generative、Pre-trained、Transformer的缩写,表示“预训练语言模型”,可以理解成一个“会说话”的人工智能。本质上是人工智能技术驱动的自然语言处理工具,通过理解和学习人类的语言来进行对话,根据聊天的上下文进行互动。

GPT3.5, InstructGPT和ChatGPT的关系

GPT-3.5 系列是一系列模型,从 2021 年第四季度开始就使用文本和代一起进行训练。

为什么是ChatGPT引发了AI浪潮?

Encoder-Decoder是NLP中的经典架构:Encoder对文本进行编码,输出Embedding;Decoder基于Embedding进行计算,完成各种任务,得到输出。示例如下:之所以会诞生这种架构,个人认为,是因为对文本进行特征工程,转化为机器可以处理的向量,是一件反人类的事情。因此,专门

国内免费可用的ChatGPT网页版

GPT:则是Generative、Pre-trained、Transformer的缩写,表示“预训练语言模型”,可以理解成一个“会说话”的人工智能。本质上是人工智能技术驱动的自然语言处理工具,通过理解和学习人类的语言来进行对话,根据聊天的上下文进行互动。chat:表示“聊天”。7)AskAI智能站点

[NLP]如何训练自己的大型语言模型

大型语言模型,如OpenAI的GPT-4或谷歌的PaLM,已经在人工智能领域掀起了一场风暴。然而,大多数公司目前没有能力训练这些模型,而且完全依赖少数几家大型科技公司作为技术提供者。在Replit,我们已经大量投资于所需的基础设施,以从头开始训练我们自己的大型语言模型。在这篇博文中,我们将概述我们如

用LangChain构建大语言模型应用

LangChain 是一个开源 Python 库,任何可以编写代码的人都可以使用它来构建 LLM 支持的应用程序。 该包为许多基础模型提供了通用接口,支持提示管理,并在撰写本文时充当其他组件(如提示模板、其他 LLM、外部数据和其他工具)的中央接口。

调用ChatGpt的API接口遇到问题详解

调用openai的API接口,由于科学上网导致的无法访问问题

小白也能看懂的ChatGPT知识介绍

ChatGPT 是一款由 OpenAI 开发的人工智能技术驱动的语言模型应用。以下是 ChatGPT 的主要特点和功能:自然语言处理:ChatGPT 可以识别和理解自然语言,包括英语、法语、德语、西班牙语等多种语言。它可以回答各种问题、提供各种建议,并与人类进行自然的对话。语言模型:ChatGPT

NLP与GPT联合碰撞:大模型与小模型联合发力

NLP是自然语言处理,而GPT是自然语言生成模型。它们的联合碰撞结果是大模型与小模型联合发力,是因为大模型可以提供更好的语言理解和生成能力,而小模型则可以更快地进行推理和预测。因此,将它们结合起来,可以充分发挥它们各自的优势,提高模型的性能和效率。