经典神经网络论文超详细解读(六)——DenseNet学习笔记(翻译+精读+代码复现)

DenseNet论文(《Densely connected convolutional networks》)超详细解读。翻译+总结。文末有代码复现

目标检测评价指标

检测精度指标:IoU、TP、TN、FP、FN、查准率、查全率、F1-Score、ROC曲线、P-R曲线、AP、mAP以及MS COCO评价指标和PASCAL VOC的评价指标的理解;检测速度指标:FPS、FLOPS和FLOPs

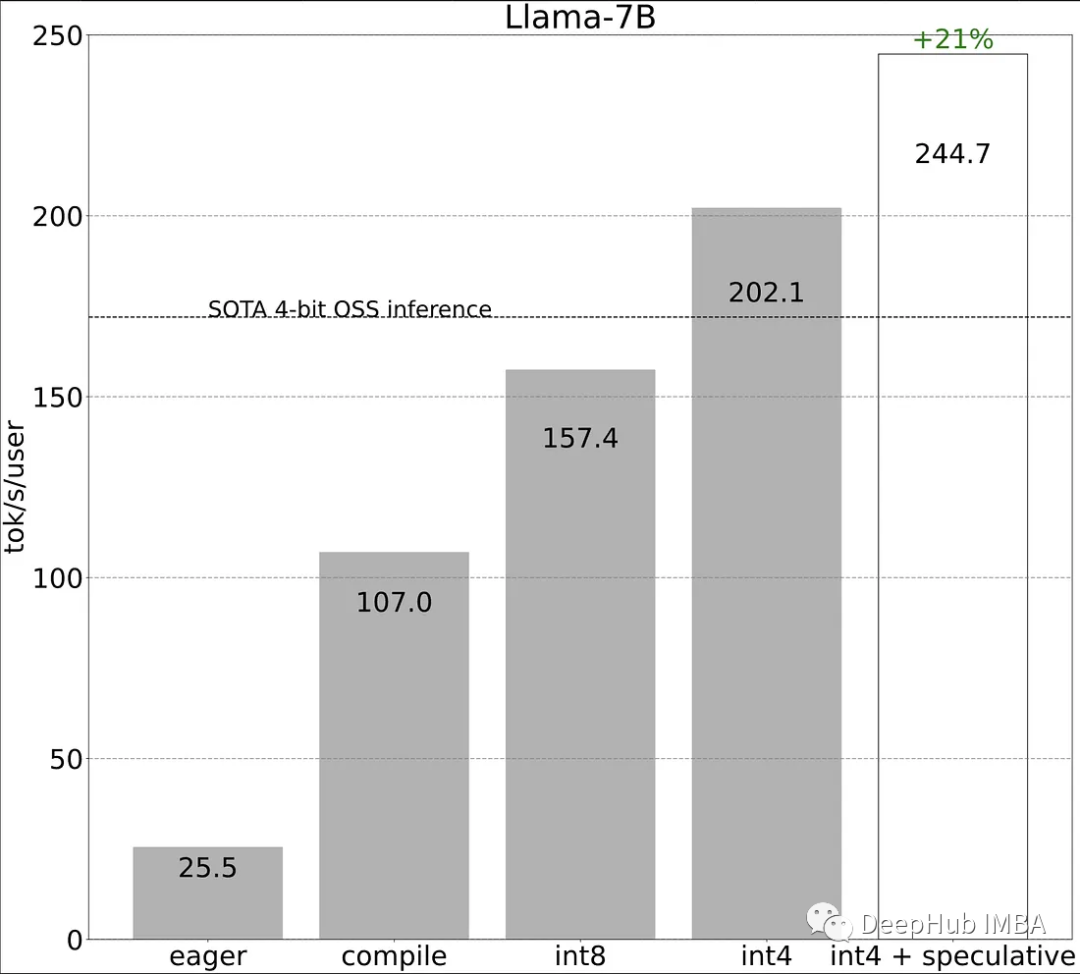

使用PyTorch II的新特性加快LLM推理速度

Pytorch团队提出了一种纯粹通过PyTorch新特性在的自下而上的优化LLM方法

深度学习环境配置(Anaconda+pytorch+pycharm+cuda)

首先查看电脑的显卡版本,步骤为:此电脑右击-->管理-->设备管理器-->显示适配器。就可以看到电脑显卡的版本了。然后按照电脑信息,到去安装相应的驱动,Notebooks是笔记本的意思,然后下载即可;

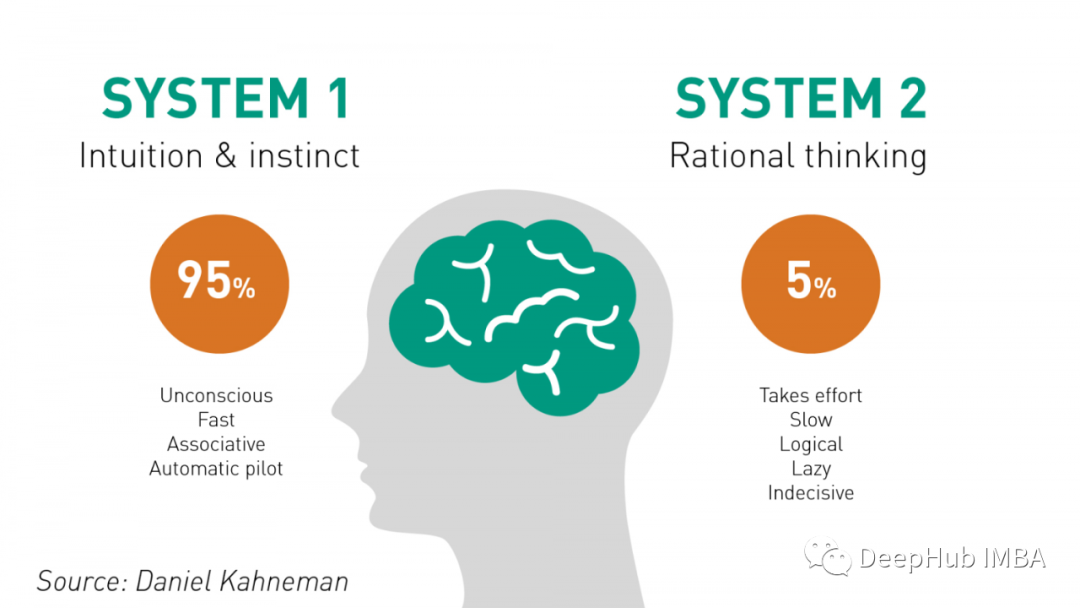

System 2 Attention:可以提高不同LLM问题的推理能力

S2A是LLM推理方法发展的一个重要里程碑。该方法与人类推理非常相似,避免了干扰。我们应该期待S2A在最近几个月成为推理研究的重要基线。

【边缘注意:深度多尺度特征】

仅供自己参考

【PyTorch】切记:GeForce RTX 3090 显卡仅支持 CUDA 11 以上的版本!

得知 PyTorch 1.7.0 开始才支持 CUDA 11,所以要使用 GPU 训练的话,必须安装 PyTorch 1.7.0 及以上版本。前不久给新来的 2台 8 张 GeForce RTX 3090 服务器配置了深度学习环境(配置教程参考。原来是 GeForce RTX 3090 显卡仅支持

Pytorch 中 expand和repeat

在中,如果要改变某一个tensor的维度,可以利用view、expand、repeat、transpose和permute等方法,这里对这些方法的一些容易混淆的地方做个总结。expand和repeat函数是pytorch中常用于进行张量数据复制和维度扩展的函数,但其工作机制差别很大,本文对这两个函

深度学习中的学习率设置技巧与实现详解

深度学习中的学习率是一个非常重要的超参数,对模型的训练和结果影响极大。在深度学习模型中,学习率决定了参数更新的步长,因此合理设置学习率对于优化算法的收敛速度、模型的训练效果以及泛化性能都有很大的影响。本文将介绍深度学习中的学习率设置技巧,包括常用的学习率衰减方法、自适应学习率方法以及学习率预热等。

(纯小白向)Windows配置GPU深度学习环境:Cuda+Anaconda+pytorch+Vscode

下载的Cuda版本为11.8(为什么不下载驱动支持的最高版本12.1.1,因为下载pytorch时,当时的pytorch的支持Cuda最高版本仅为11.8,两者作匹配。通过conda创建一个名为pytorch的虚拟环境(-n 后面是创建的虚拟环境的名字),3.9是python的版本,都可以按自己需求

Vit极简原理+pytorch代码

Vit比它爹Transformer步骤要简单的多,需要注意的点也要少得多,最令人兴奋的是它在代码中没有令人头疼的MASK,还有许多简化的操作,容我慢慢道来。

语义分割之RandLANet深度解读

语义分割任务是计算机视觉里的一个比较基础的任务,其相比于物体检测任务主要有以下几个优点:输出的结果是稠密的,是针对于所有像素点的K分类问题,物体检测任务只输出前景类物体的信息忽略了背景点的信息在自动驾驶任务中可以实现可行驶区域的识别,大部分区域都是以背景的形式存在,而这些背景同样是非行驶区域可以输出

RAG应用程序的12种调优策略:使用“超参数”和策略优化来提高检索性能

本文从数据科学家的角度来研究检索增强生成(retrieve - augmented Generation, RAG)管道。讨论潜在的“超参数”,这些参数都可以通过实验来提高RAG管道的性能。

2023-2024年最全的人工智能深度学习毕业设计选题大全

这两年开始计算机毕业设计要求越来越高,有的题目甚至专业的老师和研究生也难以应对。为了各位同学以最少的精力通过毕设,为各位分享一些优质的毕业设计选题方向。深度学习,计算机视觉,目标检测,图像分割,图像分类,卷积神经网络具体课题如下:手写数字识别,手写字母识别,图片识别,水果识别,花卉识别,手势识别,安

梯度消失与梯度爆炸产生、原理和解决方案

本文章总结了梯度消失与梯度爆炸产生、原理和解决方案。

分布式版本管理系统---->Git(Linux---centos(保姆式)讲解1)

git分布式版本控制系统保姆式详解

python深度学习【transforms所有用法介绍】

python深度学习【transforms所有用法介绍】

毕设 深度学习的水果识别 opencv python

🔥 这两年开始毕业设计和毕业答辩的要求和难度不断提升,传统的毕设题目缺少创新和亮点,往往达不到毕业答辩的要求,这两年不断有学弟学妹告诉学长自己做的项目系统达不到老师的要求。为了大家能够顺利以及最少的精力通过毕设,学长分享优质毕业设计项目,今天要分享的是🚩深度学习的水果识别 opencv pyth

AI:87-基于深度学习的街景图像地理位置识别

基于深度学习的街景图像地理位置识别随着深度学习技术的飞速发展,人工智能在各个领域展现出强大的潜力。其中,基于深度学习的街景图像地理位置识别成为近年来备受关注的研究方向之一。本文将深入探讨深度学习在街景图像地理位置识别中的应用,介绍相关算法和技术,并附上实际代码示例。街景图像地理位置识别是指通过分析街