【深度学习错误:CUDNN_STATUS_INTERNAL_ERROR】- 如何解决?

总之,【深度学习错误:CUDNN_STATUS_INTERNAL_ERROR】可能会让您的深度学习项目受到影响,但是通过上述方法进行诊断和修复,您可以轻松地解决这个问题,并继续推进您的项目。如果您仍然遇到【深度学习错误:CUDNN_STATUS_INTERNAL_ERROR】,您可以尝试降低 CUD

PyTorch:通过pth文件查看网络结构(查看输入输出维度)

显示pth文件的模型参数

使用QLoRa微调Llama 2

上篇文章我们介绍了Llama 2的量化和部署,本篇文章将介绍使用PEFT库和QLoRa方法对Llama 27b预训练模型进行微调。我们将使用自定义数据集来构建情感分析模型。

2023年!自然语言处理(NLP)10 大预训练模型

来源:(每日干货分享!!编辑: ShuYini校稿: ShuYini时间: 2022-10-23。

YOLOv5训练速度慢 GPU占用率低

用Yolo5跑自己的数据集,torch_GPU和CUDA都安装了,使用GPU跑模型,GPU的占用率为1%,设置的epoch为300,batch size为32,大概6min多/epoch,数据集很小,刚过一千。在网上查了相关的文章,发现可能是读取数据造成的,把cache-image的action='

yolov7-tiny结合mobilenetV3(降参提速)

在各处看到关于yolo的魔改都是基于yolov5版本的,于是借鉴学习一下用在yolov7-tiny版本上,做一下学习记录;同时感谢一下各位大佬对开源做出的贡献!

深度学习实战38-基于清华ChatGLM-6b开源模型做体检报告解读任务,让体检报告解读变得轻松

大家好,我是微学AI,今天给大家介绍一下深度学习实战38-基于清华ChatGLM-6b开源模型做体检报告解读任务,让体检报告解读变得轻松。ChatGLM-6b是清华大学团队开源的一个语言大模型。本文将介绍一种基于ChatGLM-6B的体检报告智能解读应用项目。首先,我们将讨论体检报告解读的背景和重要

Diffusion Model原理详解

Diffusion Model(扩散模型 )对标的是生成对抗网络(GAN),本文将用通俗的语言和公式为大家介绍Diffusion Model,并且结合公式为大家梳理Diffusion Model的代码。

YOLOV8改进:顶刊TIP 2023 | CFP:即插即用的多尺度融合模块,有效涨点!

与现有的方法不同,本文方法不仅关注不同层之间的特征交互,还考虑了同一层内的特征调节,该调节在密集预测任务中被证明是有益的。则依赖于自下而上的特征金字塔结构,通过建立自上而下的路径和横向连接从多尺度高级语义特征图中获取特征信息。提出了一种额外的自下而上路径,使高级特征图也可以从低级特征图中获得足够的细

深度学习apex包安装问题

深度学习中apex安装问题

bevfusion单显卡训练/测试

bevfusion单显卡

动手学深度学习(李沐)的pytorch版本(包含代码和PDF版本)

动手学深度学习(李沐)的pytorch版本(包含代码和PDF版本),《动手学深度学习》PyTorch版本TendorFlow版本(内有所有代码和PDF版下载地址)

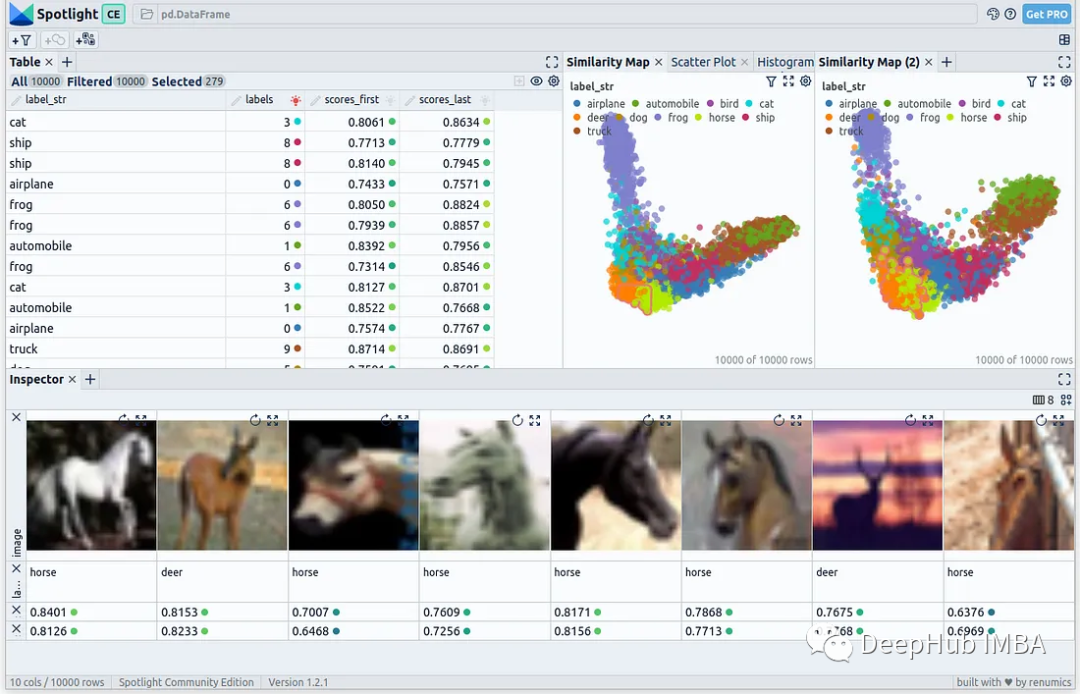

使用Cleanlab、PCA和Procrustes可视化ViT微调

在本文中,我们将介绍如何创建这样一个动画,主要包括:微调、创建嵌入、异常值检测、PCA、Procrustes、创建动画。

YOLO-NAS讲解

这些 YOLO-NAS 模型是使用 Deci 的 AutoNAC™ NAS 技术构建的,性能优于 YOLOv7 和 YOLOv8 等模型,包括最近推出的 YOLOv6-v3.0。准确的比较将在 YOLO-NAS 系列的下一篇文章中进行,我们将在自定义任务上训练这些模型,并记录与当前巨头相比训练的难易

Anaconda Prompt 怎样切换环境,工作路径,以及怎样修改默认环境和默认路径

在win环境下安装的Anaconda,打开其提供的Anaconda Prompt窗口,默认环境为base,默认路径是你的用户名,如下图:conda activate env_name 可以切换环境E: 切换到你的指定目录的盘符cd 切换到你指定路径下,即可成功: 同样是Anaconda Promp

ESM2蛋白预训练模型 蛋白质、氨基酸向量表示

参考:https://github.com/facebookresearch/esmhttps://huggingface.co/facebook/esm2_t33_650M_UR50Dhttps://esmatlas.com/resources?action=foldtokenizer_对输入蛋白

一文搞懂 神经辐射场(Neural Radiance Fields,NeRF)

一文搞懂 神经辐射场(Neural Radiance Fields,NeRF)

Xilinx Vitis AI量化部署Yolov5至DPU (PYNQ)

本文章记述了从YOLOv5源代码使用Xilinx Vitis AI进行量化并部署到DPU上的全流程。在开Pynq环境下运行测试通过。

使用GGML和LangChain在CPU上运行量化的llama2

在本文,我们将紧跟趋势介绍如何在本地CPU推理上运行量化版本的开源Llama 2。

【高效炼丹】指数移动平均(EMA):深度学习中的神器

EMA的本质是对历史数据进行加权平均,其中每个数据点的权重随着它距离当前时间点的远近而不断减小。这样做的好处是可以有效地平滑时间序列数据,使其更加连续和稳定。在深度学习中,EMA被广泛应用于优化器的更新、模型参数的平均等方面,可以帮助提高模型的性能和泛化能力。同时,由于EMA的计算方式简单且易于实现