一张图了解GPU、CUDA、CUDA toolkit和pytorch的关系

现在的理解就是我可以装多个版本的cuda toolkit,,然后不同的框架会自动调用。

什么是人工智能领域的 Foundation Model?

GPT 模型采用了预训练加微调的方式,通过大规模的语料库训练出来的模型,可以在多种 NLP 任务中表现出色,如文本分类、机器翻译、摘要生成等。人工智能领域的 Foundation Model,通常指的是一类被广泛使用的基础模型(或称基础架构模型),是在海量数据和计算资源的基础上训练出来的通用、通用性

docker中使用gpu

本机想要启用gpu加速计算,需要由一张多余的nVidia显卡。需要提前禁用nouveau:lsmod | grep nouveau没有输出即禁用了需要安装1、显卡驱动、2、cuda库(安装cuda会自动安装显卡驱动)3、cudnn(深度神经网络的GPU加速库,需要神经网络则安否则可以不安)安装完成后

神经辐射场(NERF)模型:一个令人惊叹的三维场景重建方法

简单来说,NERF 模型是一种基于神经网络的三维场景重建方法。与传统方法不同,NERF 模型 只需要从单个或少数几个 2D 视角中预测每个像素点的颜色和深度值,而不需要使用多个 2D 图像或视角。它通过学习一个表示场景中每个点的神经辐射场函数来实现这一点。

10分钟训练属于你的AI变声器

模型的话,可以使用其他人分享的,也可以自己训练模型。下面介绍怎么训练模型。

对卡尔曼滤波的理解:平滑插值、滤波和预测!想用的来看啦!

对卡尔曼滤波的理解:平滑插值、滤波和预测!想用的来看啦!

Stable Diffusion模型运算量分析

StableDiffusion运算量分析

YOLOV5的FPS计算问题

pre-process:图像预处理时间,包括图像保持长宽比缩放和padding填充,通道变换(HWC->CHW)和升维处理等;inference:推理速度,指预处理之后的图像输入模型到模型输出结果的时间;NMS :你可以理解为后处理时间,对模型输出结果经行转换等;data换为自己的数据集对应的yam

基于onnx模型和onnx runtime推理stable diffusion

基于onnx模型和onnx runtime推理stable diffusion

torch 1.13.0 对应的torchvision版本

奈何官网也没有说对应的torchvision版本是啥,如果想要。由于torch版本肯定是会快速迭代更新的,比起记住特定版本,倒不如记住这个思路。torch最新的stable版本是。

【深度学习环境】如何查看CUDA版本 | 两个CUDA版本各表示什么 | 是否可以在同一设备安装多个CUDA版本

【深度学习环境】如何查看CUDA版本 | 两个CUDA版本各表示什么 | 是否可以在同一设备安装多个CUDA版本

改进YOLO系列:改进YOLOv8,教你YOLOv8如何添加20多种注意力机制,并实验不同位置。

注意力机制(Attention Mechanism)是深度学习中一种重要的技术,它可以帮助模型更好地关注输入数据中的关键信息,从而提高模型的性能。注意力机制最早在自然语言处理领域的序列到序列(seq2seq)模型中得到广泛应用,后来逐渐扩展到了计算机视觉、语音识别等多个领域。注意力机制的基本思想是为

Wandb是啥,怎么用

使用Wandb非常简单,首先需要安装Wandb的Python包,可以通过pip或conda来安装。安装完成后,需要在Python脚本中导入wandb库,登录Wandb,创建一个项目并设置实验。在实验中,可以记录各种指标、超参数、模型权重等,并进行可视化分析。最后,可以将实验的结果保存在Wandb的云

LabelImg安装使用教程:

LabelImg

CUDA与TensorRT(5)之TensorRT介绍

CUDA与TensorRT(5)之TensorRT介绍

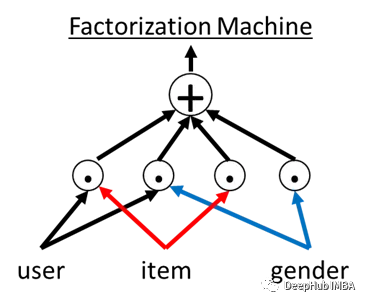

因子分解机介绍和PyTorch代码实现

因子分解机(Factorization Machines,简称FM)是一种用于解决推荐系统、回归和分类等机器学习任务的模型

如何利用ChatGPT进行论文润色-ChatGPT润色文章怎么样

ChatGPT可以润色文章,使用其润色功能可以为用户提供更加整洁、清晰、文采动人的文本。但需要注意以下几点:需要保持文本的一致性和完整性。当使用ChatGPT进行润色时,需要注意保持文本的一致性和完整性。不应改变原始文章的意义、论点和逻辑结构,尤其是在非常规文章类型上,比较灵活的润色方式和人为的润色

手把手教学YOLOV5在RK3568的部署应用及代码实现

YOLOV5模型移植在RK3568

3. conda新建,删除,查看虚拟环境

在训练神经网络时,不同的实验和baseline对于环境的设置不同。我们不能把所有的python版本,各种库都封装在一个全局环境里,因此有了虚拟环境envs。conda可以创建和命名若干个虚拟环境,各个环境互不打扰。下面是常见的查看,创建,激活,退出以及删除虚拟环境的操作。