RAG 检索模型如何学习:三种损失函数的机制解析

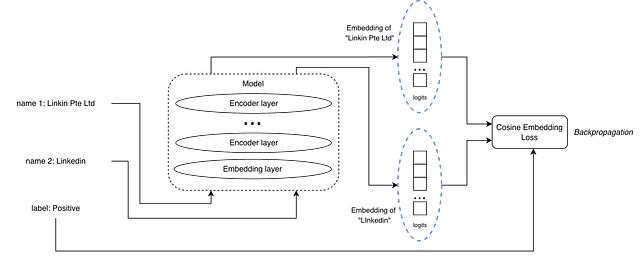

本文将介绍我实验过的三种方法:Pairwise cosine embedding loss(成对余弦嵌入损失)、Triplet margin loss(三元组边距损失)、InfoNCE loss。

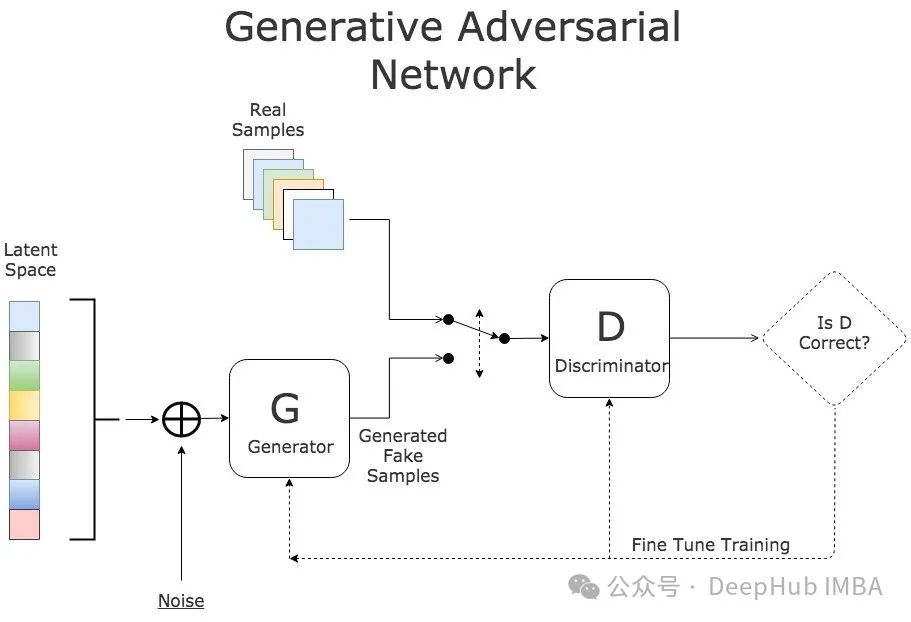

9个主流GAN损失函数的数学原理和Pytorch代码实现:从经典模型到现代变体

本研究首先介绍经典GAN损失函数的理论基础,随后使用PyTorch实现包括原始GAN、最小二乘GAN(LS-GAN)、Wasserstein GAN(WGAN)及带梯度惩罚的WGAN(WGAN-GP)在内的多种损失函数。

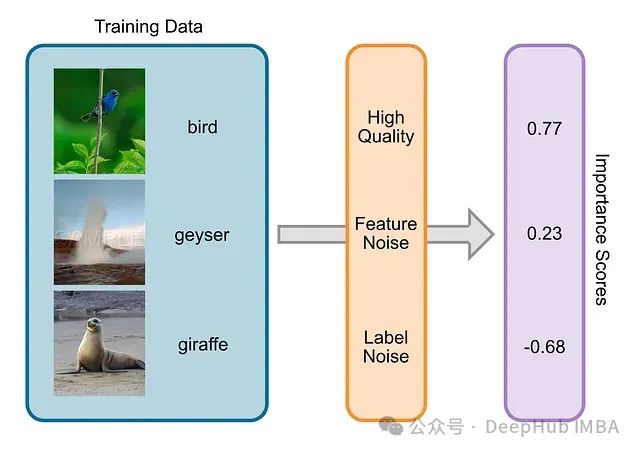

LossVal:一种集成于损失函数的高效数据价值评估方法

*LossVal*提出了一种创新方法,通过将数据价值评估过程直接集成到神经网络的损失函数中,实现了高效的数据价值评估。

一文理解多标签分类损失函数ASL(Asymmetric Loss)

一文理解asl,从ce到focal loss到asl

评估指标:精确率(Precision)、召回率(Recall)、F1分数(F1 Score)

人工智能、评估指标、精确率(Precision)、召回率(Recall)、F1分数(F1 Score)

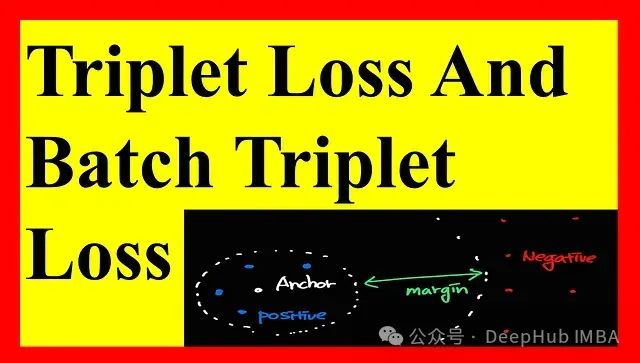

三元组损失Triplet loss 详解

在这篇文章中,我们将以简单的技术术语解析三元组损失及其变体批量三元组损失,并提供一个相关的例子来帮助你理解这些概念。

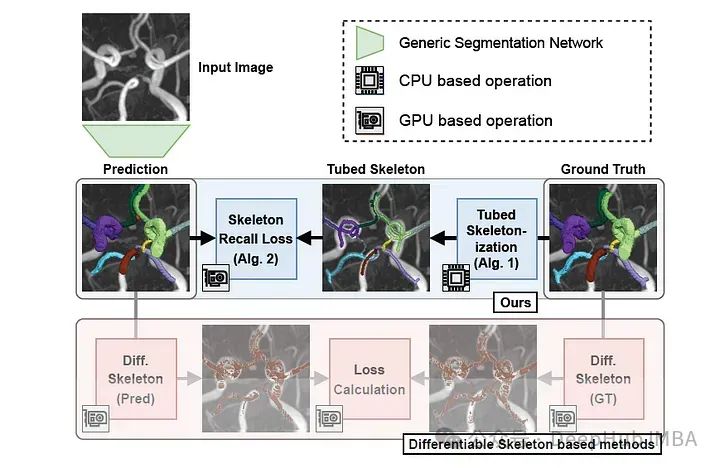

Skeleton Recall Loss 分割领域的新突破:极大的减少了资源消耗,还能提高性能

精确分割在当今众多领域都是一项关键需求比如说自动驾驶汽车的训练、医学图像识别系统,以及通过卫星图像进行监测。在许多其他领域,当感兴趣的对象微小但至关重要时,例如研究血管流动、手术规划、检测建筑结构中的裂缝或优化路线规划,需要更高的精度。此前已经做了大量工作来解决这种具有挑战性的分割问题。此前已经做了

Skeleton Recall Loss 分割领域的新突破:极大的减少了资源消耗,还能提高性能

这篇论文则介绍了一个新的损失:Skeleton Recall Loss,我把它翻译成骨架召回损失.这个损失目前获得了最先进的整体性能,并且通过取代密集的计算**他的计算开销减少超过90% !**

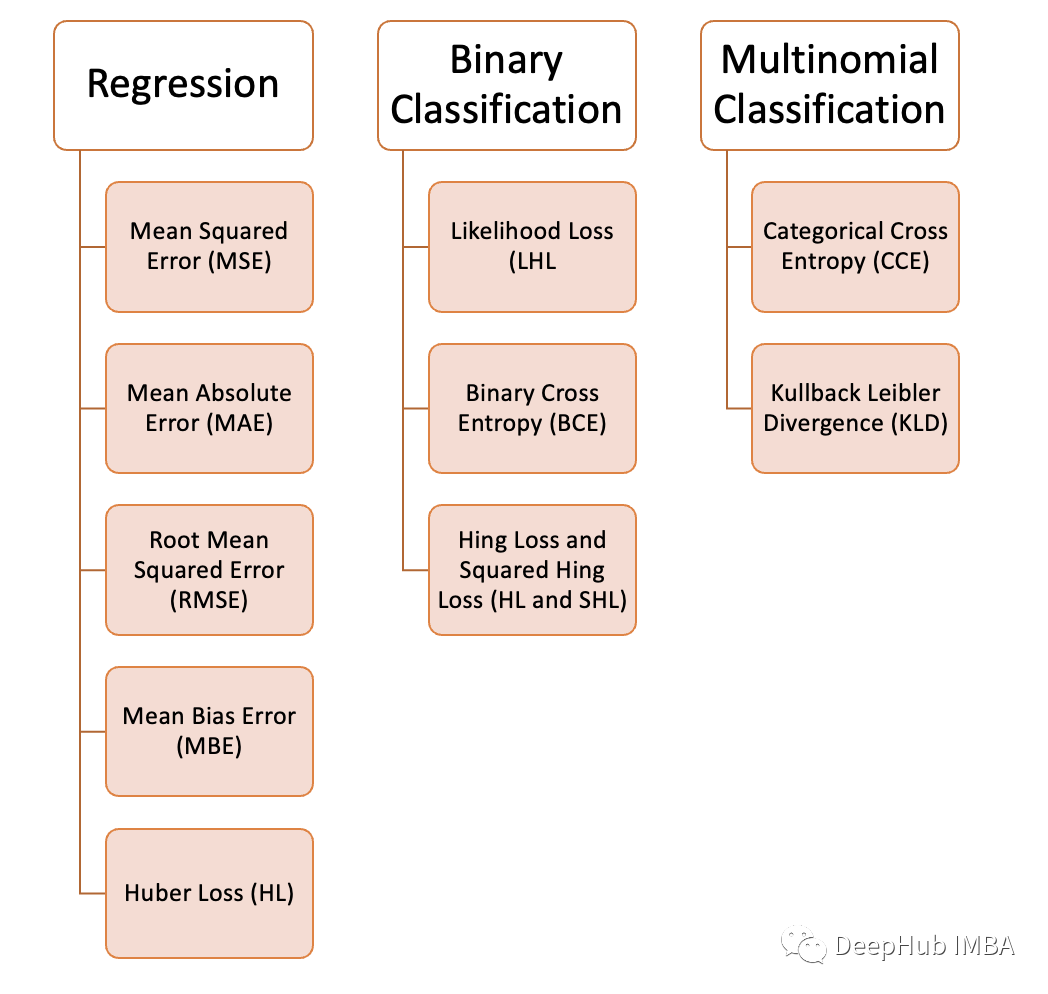

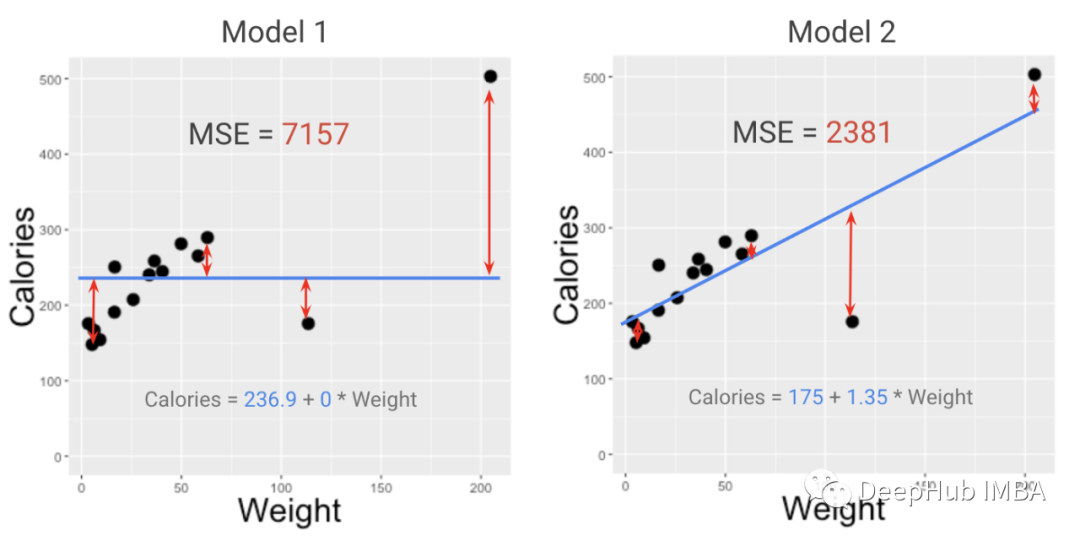

深度学习中常用损失函数介绍

选择正确的损失函数对于训练机器学习模型非常重要。不同的损失函数适用于不同类型的问题。本文将总结一些常见的损失函数,并附有易于理解的解释、用法和示例

损失函数 - 二元交叉熵损失函数 nn.BCELoss() 与 torch.nn.BCEWithLogitsLoss()

二元交叉熵损失函数 nn.BCELoss() 与 torch.nn.BCEWithLogitsLoss()

损失函数解读 之 Focal Loss

前言Focal loss 是一个在目标检测领域常用的损失函数,它是何凯明大佬在RetinaNet网络中提出的,解决了目标检测中正负样本极不平衡和 难分类样本学习的问题。论文名称:Focal Loss for Dense Object Detection目录什么是正负样本极不平衡?two-stage

训练深度学习神经网络的常用5个损失函数

损失函数的选择与神经网络模型从示例中学习的特定预测建模问题(例如分类或回归)有关。在本文中我们将介绍常用的一些损失函数

10个常用的损失函数解释以及Python代码实现

理解机器学习中的损失函数

模型的度量指标和损失函数有什么区别?为什么在项目中两者都很重要?

在本文中,我将解释为什么需要两个独立的模型评分函数来进行评估和优化……甚至还可能需要第三个模型评分函数来进行统计测试。

2022年关于损失函数的5篇最新论文推荐

2022年最新的损失函数论文总结

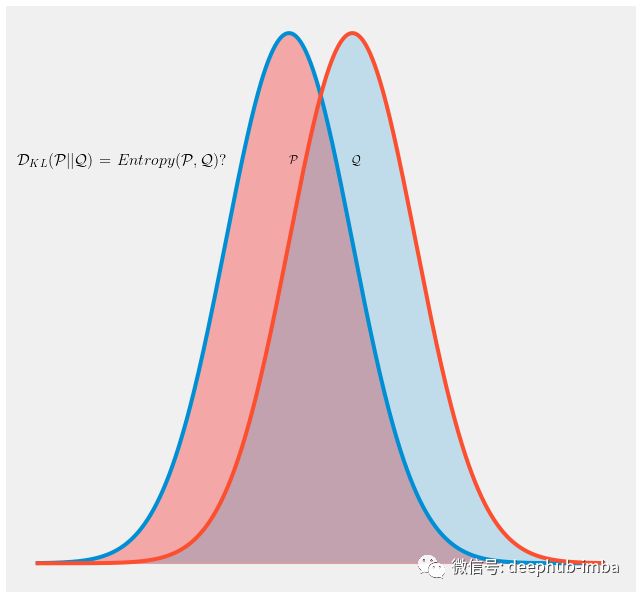

为什么交叉熵和KL散度在作为损失函数时是近似相等的

在本文中,我们将介绍熵、交叉熵和 Kullback-Leibler Divergence [2] 的概念,并了解如何将它们近似为相等。