机器学习:基于神经网络对用户评论情感分析预测

神经网络模型的思想来源于模仿人类大脑思考的方式。神经元是神经系统最基本的结构和功能单位,分为突起和细胞体两部分。突起作用是接受冲动并传递给细胞体,细胞体整合输入的信息并传出。人类大脑在思考时,神经元会接受外部的刺激,当传入的冲动使神经元的电位超过阈值时,神经元就会从抑制转向兴奋,并将信号向下一个神经

YOLOv5核心基础知识讲解

江大白永远的神!

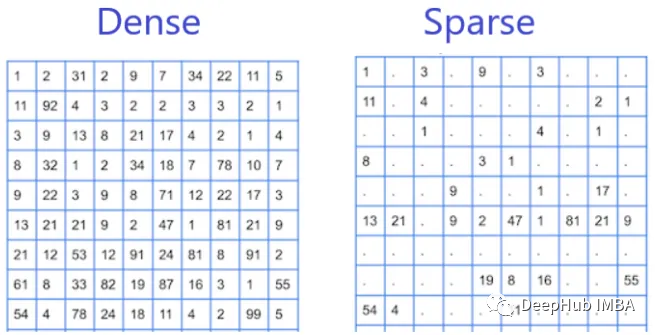

稀疏特征和密集特征

在机器学习中,特征是指对象、人或现象的可测量和可量化的属性或特征。特征可以大致分为两类:稀疏特征和密集特征。

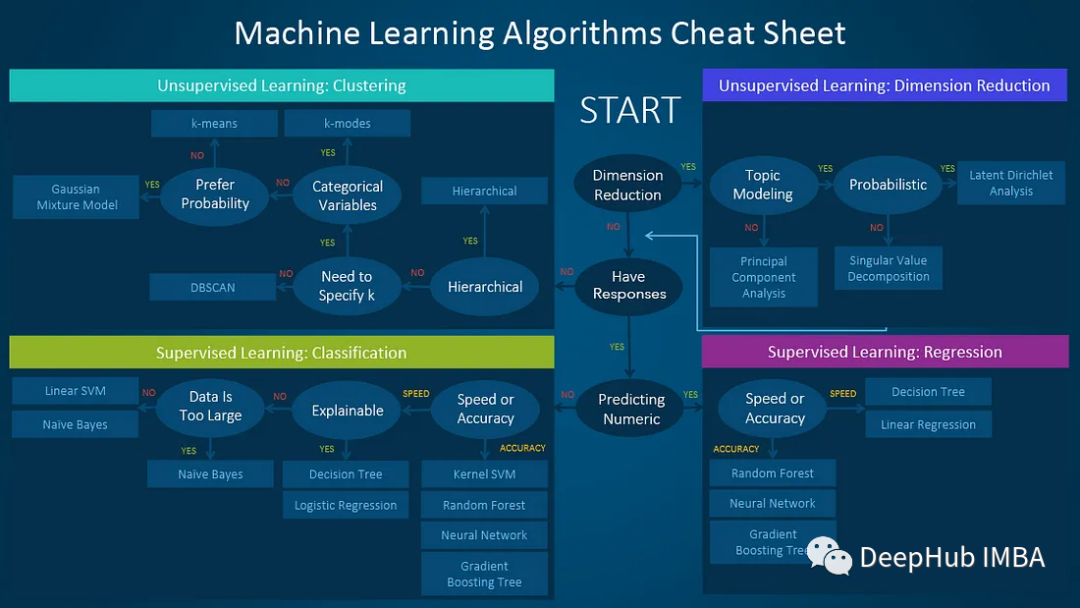

选择最佳机器学习模型的10步指南

机器学习可以用来解决广泛的问题。但是有很多多不同的模型可以选择,要知道哪一个适合是一个非常麻烦的事情。本文的总结将帮助你选择最适合需求的机器学习模型。

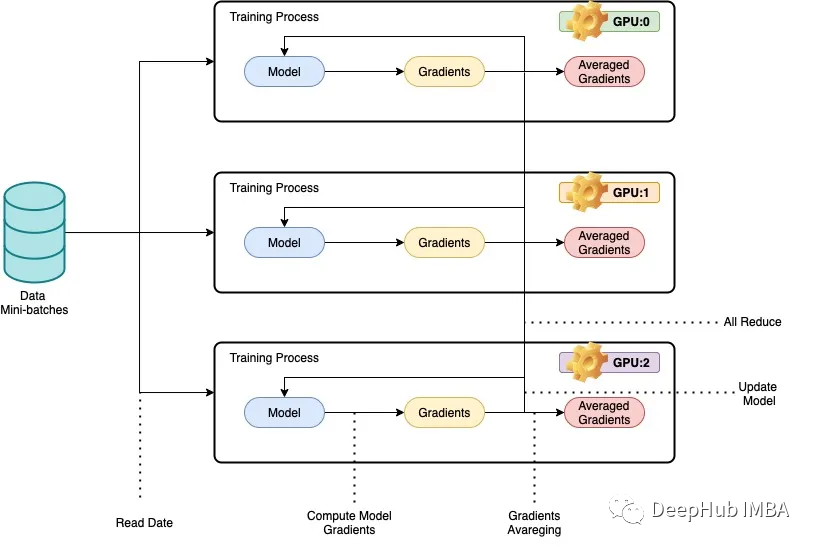

PyTorch 并行训练 DistributedDataParallel完整代码示例

使用大型数据集训练大型深度神经网络 (DNN) 的问题是深度学习领域的主要挑战。在本文中我们将演示使用 PyTorch 的数据并行性和模型并行性。

YOLOv7保姆级教程(个人踩坑无数)----训练自己的数据集

从零开始,保姆级yolov7教程助你脱离新手村。

YOLO v8详解

通过C3代码可以看出,对于cv1卷积和cv2卷积的通道数是一致的,而cv3的输入通道数是前者的2倍,因为cv3的输入是由主梯度流分支(BottleNeck分支)依旧次梯度流分支(CBS,cv2分支)cat得到的,因此是2倍的通道数,而输出则是一样的。C3模块,其主要是借助CSPNet提取分流的思想,

PyTorch+PyG实现图神经网络经典模型目录

本专栏整理了《图神经网络代码实战》,内包含了不同图神经网络的相关代码实现(PyG以及自实现),理论与实践相结合,如GCN、GAT、GraphSAGE等经典图网络,每一个代码实例都附带有完整的代码。

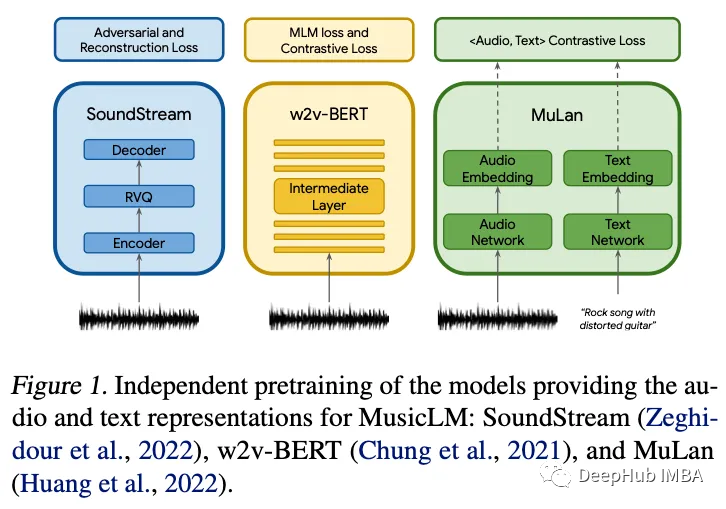

2023年2月的十篇深度学习论文推荐

本月的论文包括语言模型、扩散模型、音乐生成、多模态等主题。

语义分割系列6-Unet++(pytorch实现)

本文介绍了Unet++网络,在pytorch框架上复现Unet++,并在Camvid数据集上进行训练。

机器学习中的数学原理——对数似然函数

通过这一篇博客,带你详细理解最大似然函数!通过博文的推导,我们学习了最大似然函数,这与我们之前接触的最小二乘法不同,最小二乘法以误差作为评判标准,误差越小越好,而最大似然函数以概率作为评判标准,概率越大越好。在计算概率时,我们求了一次对数log计算,避免了连乘概率越来越小,受计算机计算进度影响也越来

神经网络--从0开始搭建全连接网络和CNN网络

今天来学习一下如何从0开始搭建全连接网络和CNN网络,并通过实验简单对比一下两种神经网络的不同之处,本文目录较长,可以根据需要自动选取要看的内容

yolov5模型训练结果分析

模型训练结束后怎么看训练结果

cpu和gpu已过时,npu和apu的时代开始

🌎CPU是中央处理器。其实就是机器的“大脑”,也是布局谋略、发号施令、控制行动的“总司令官”。CPU的结构主要包括运算器(ALU,ArithmeticandLogicUnit)、控制单元(CU,ControlUnit)、寄存器(Register)、高速缓存器(Cache)和它们之间通讯的数据、控制

对抗生成网络(GAN)中的损失函数

L1损失函数又称为MAE(mean abs error),即平均绝对误差,也就是预测值和真实值之间差值的绝对值。 L2损失函数又称为MSE(mean square error),即平均平方误差,也就是预测值和真实值之间差值的平方。

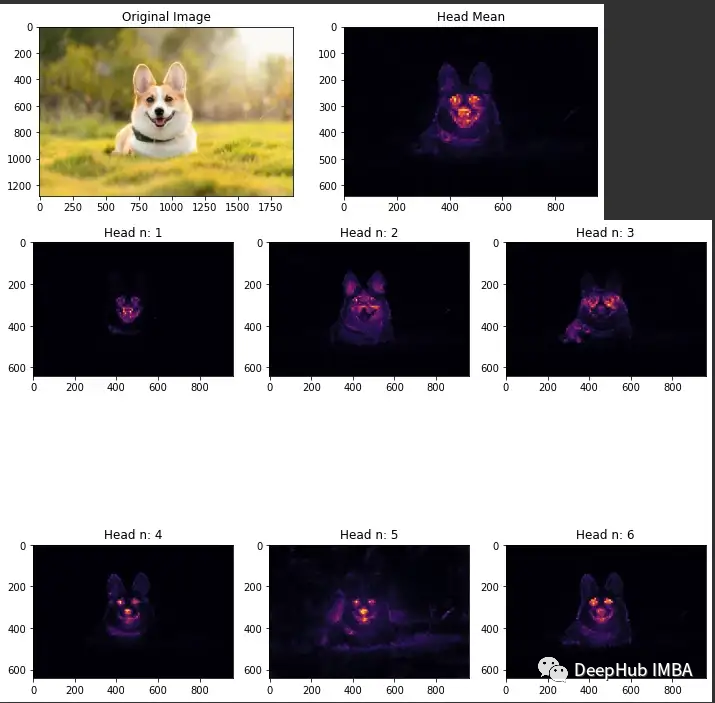

可视化VIT中的注意力

ViT中最主要的就是注意力机制,所以可视化注意力就成为了解ViT的重要步骤,所以我们这里介绍如何可视化ViT中的注意力

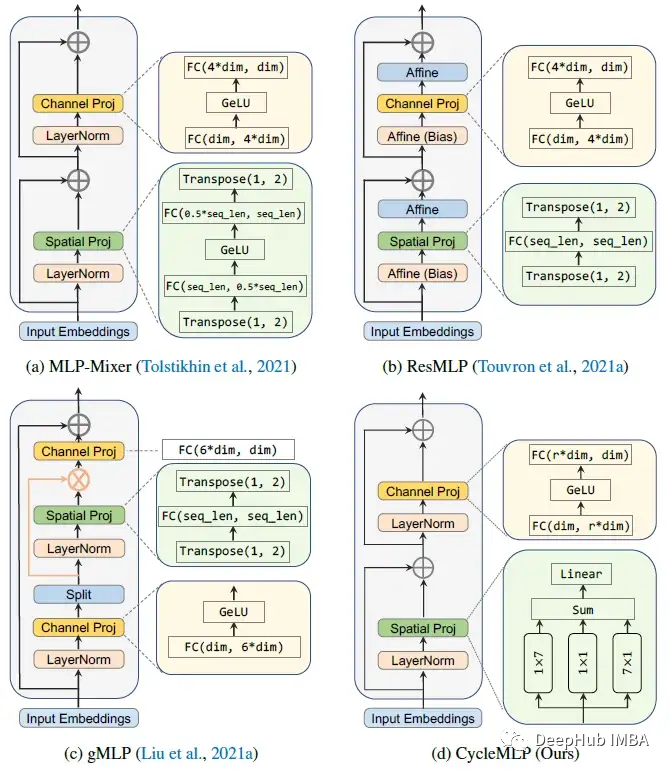

CycleMLP:一种用于密集预测的mlp架构

CycleMLP有两个优点。(1)可以处理各种大小的图像。(2)利用局部窗口实现了计算复杂度与图像大小的线性关系。

一文通俗入门·脉冲神经网络(SNN)·第三代神经网络

一文通俗入门脉冲神经网络(snn)动力学方程,前向传播过程,学习算法,脉冲编码方式

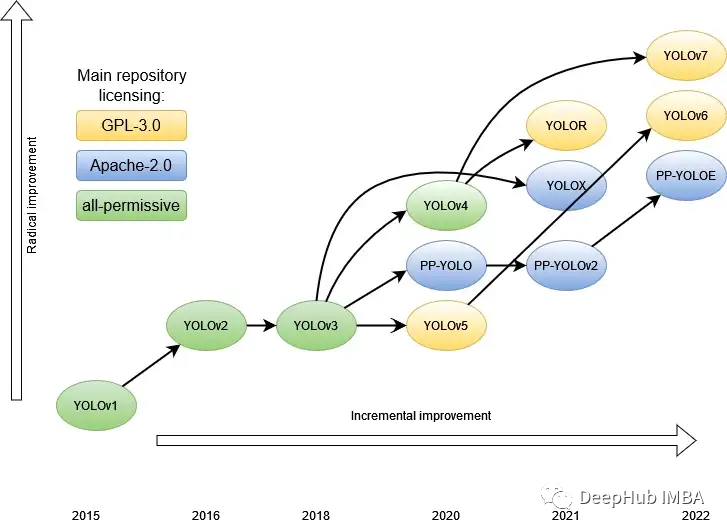

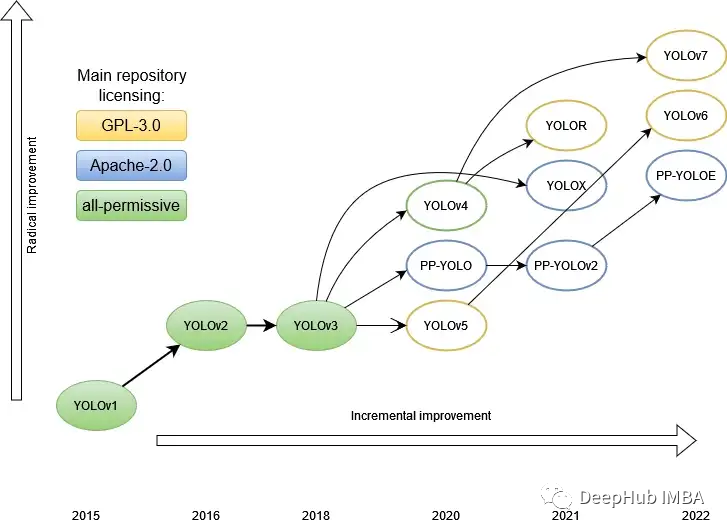

YOLO家族系列模型的演变:从v1到v8(下)

昨天的文章中,我们回顾了 YOLO 家族的前 9 个架构。本文中将继续总结最后3个框架,还有本月最新发布的YOLO V8.

YOLO家族系列模型的演变:从v1到v8(上)

YOLO V8已经在本月发布了,我们这篇文章的目的是对整个YOLO家族进行比较分析。