Lag-Llama:第一个时间序列预测的开源基础模型介绍和性能测试

在本文中,我们将探讨Lag-Llama的架构、功能以及训练方式。还会将lagllama应用于一个预测项目中,并将其与其他深度学习方法Temporal Fusion Transformer (TFT) 和DeepAR进行性能比较。

神经网络与人类智能的融合:实现人工智能的高峰

1.背景介绍人工智能(Artificial Intelligence, AI)是一门研究如何让计算机模拟人类智能行为的科学。人类智能包括学习、理解语言、认知、决策等多种能力。在过去几十年中,人工智能研究取得了显著的进展,尤其是在图像识别、语音识别、自然语言处理等领域。然而,人工智能仍然远远不及人类在

数据预处理和特征工程在AI大模型中的重要性

1.背景介绍在AI领域,数据预处理和特征工程是构建高性能模型的关键环节。在本文中,我们将深入探讨数据预处理和特征工程在AI大模型中的重要性,并揭示一些最佳实践、技巧和技术洞察。1. 背景介绍AI大模型通常需要处理大量、复杂的数据,以实现高性能和准确度。数据预处理和特征工程是将原始数据转换为模型可以理

引用率高怎么降重 神码ai

引用前人的研究,可以帮助我们更好地支持自己的观点,但过高的引用率可能会让我们的论文显得冗余。如何有效降低引用率呢?通过合理使用脚注和参考文献,我们可以向读者展示我们引用的内容的来源和依据,同时避免过度引用他人的研究成果。通过理解引用的目的、使用伪原创功能、修改句子结构、用自己的语言表述、删除不必要的

人工智能之配置环境教程二:在Anaconda中创建虚拟环境并在VsCode中使用

孟莉苹,女,西安工程大学电子信息学院,2021级硕士研究生,张宏伟人工智能课题组。研究方向:机器视觉与人工智能。电子邮件:[email protected]安装前先下载安装包,建议在博主已准备好的百度网盘链接中下载:百度网盘链接:https://pan.baidu.com/s/1FgjTixyrP0

毕业设计选题-基于深度学习的车道线检测算法识别系统 人工智能 机器学习 卷积神经网络

毕业设计选题:基于深度学习的车道线识别系统的毕业设计。该系统利用先进的计算机视觉技术,通过深度学习算法,准确识别道路上的车道线,为自动驾驶和驾驶辅助系统提供重要的信息。为计算机专业、软件工程专业、人工智能专业和大数据专业的毕业生提供了一个令人兴奋和有意义的研究课题。不论您是对深度学习技术着迷的同学,

【GNN/深度学习】常用的图数据集(资源包)

【GNN/深度学习】常用的图数据集(资源包)

AI:126-基于深度学习的人体情绪识别与分析

随着人工智能技术的不断发展,深度学习成为人体情绪识别与分析领域的关键工具。通过深度学习算法,计算机能够更准确地理解人体的情绪表达,为情感计算、人机交互等领域提供了新的可能性。本文将探讨基于深度学习的人体情绪识别与分析,并提供相关的代码实例。

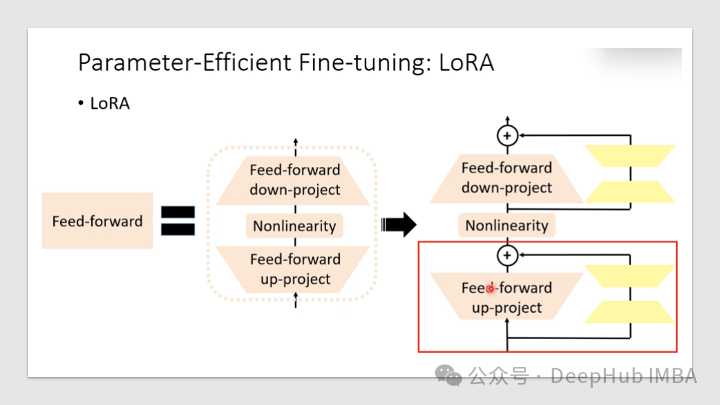

使用LORA微调RoBERTa

LORA可以大大减少了可训练参数的数量,节省了训练时间、存储和计算成本,并且可以与其他模型自适应技术(如前缀调优)一起使用,以进一步增强模型。

论文投稿被退稿但有修改意见 神码ai

通过仔细阅读修改意见、制定详细的修改计划、关注重点、使用小发猫伪原创或快码论文等软件辅助修改、请教导师或同行、重新审查结构和逻辑以及及时提交修改后的论文等方法,您可以有效地进行修改工作并提高论文的质量和水平。同时,这也是一个学习和进步的机会,通过这次经历,您可以更好地了解学术论文的要求和规范,为未来

浅谈人工智能之深度学习~

深度学习是人工智能领域的一个重要分支,它利用神经网络模拟人类大脑的学习过程,通过大量数据训练模型,使其能够自动提取特征、识别模式、进行分类和预测等任务。近年来,深度学习在多个领域取得了显著的进展,尤其在自然语言处理、计算机视觉、语音识别和机器翻译等领域取得了突破性的进展。随着算法和模型的改进、计算能

【深度学习与人工智能】

深度学习作为人工智能的核心技术之一,正在不断推动科技的发展和社会的进步。随着深度学习算法和技术的不断演进,相信它将会在更多领域发挥重要作用,为人类带来更多便利和创新。在自然语言处理领域,深度学习能够通过分析大量的文本数据,进行情感分析、文本生成和机器翻译等任务;在计算机视觉领域,深度学习能够通过训练

【AI】深度学习在图像编码中的应用(1)

视频行业在AI技术的推动下正在经历前所未有的变革,不仅传统的娱乐、媒体、教育等领域得到深度渗透,更在工业、安防、生产办公等垂直市场中开辟出众多新型应用场景。

Stable-diffusion-WebUI 的API调用(内含文生图和图生图实例)

使用Diffusers库来进行stable-diffusion的接口调用以及各种插件功能实现,但发现diffusers库中各复杂功能的添加较为麻烦,而且难以实现对采样器的添加,safetensors格式模型的读取。使用webui专门的api接口,能够极大方便我们进行类似webui界面的api调用。

AI:125-基于深度学习的航拍图像中地物变化检测

随着无人机技术的飞速发展,航拍图像成为获取地表信息的重要手段之一。然而,由于地球表面的不断变化,监测和识别航拍图像中的地物变化成为一项具有挑战性的任务。在人工智能领域,深度学习技术的兴起为地物变化检测提供了全新的解决方案。本文将介绍基于深度学习的航拍图像中地物变化检测的方法,并附上相应的代码实例。

【机器学习】1、AI鲜为人知的秘密:机器学习与深度学习概论

讲解人工智能、机器学习、深度学习三者的概念和定义,并解释一些基本术语

深度学习网络模型————Swin-Transformer详细讲解与代码实现

经典网络模型系列——Swin-Transformer详细讲解与代码实现

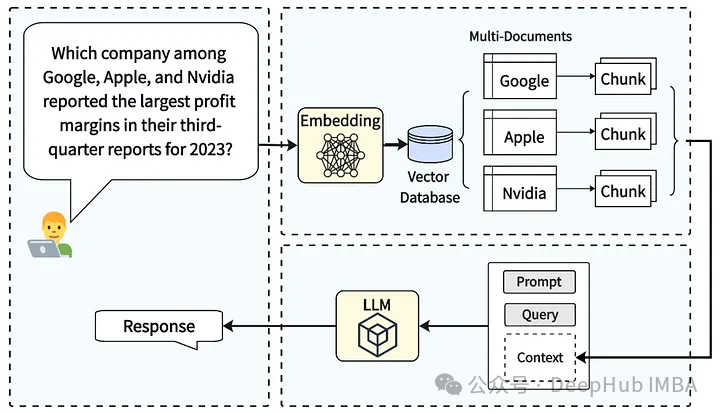

使用UMAP降维可视化RAG嵌入

在本文中,我们使用LangChain构建RAG应用,并在2D中可视化嵌入,分析查询和文档片段之间的关系和接近度。

毕业设计-基于深度学习的交通路面障碍物目标检测系统 YOLO python 卷积神经网络 人工智能

基于深度学习的交通路面障碍物目标检测系统的毕业设计。随着交通事故的日益增多,减少交通意外的发生成为当务之急。本设计基于YOLOv5算法,通过训练深度学习模型实现对交通路面障碍物的准确检测。通过采集大量的路面障碍物图像数据,使用YOLOv5模型进行训练和优化,实现了高精度和实时性的障碍物检测。该系统具

大模型:合成数据、安全挑战与知识注入

根据"Sleeper Agents: Training Deceptive LLMs that Persist Through Safety Training"这篇论文,即便LLM经过了广泛的安全调教,被提前训练进模型中的后门攻击仍然能留存下来,只是等待被特定的指令触发后就能做出恶意行为,例如生成一