学习Transformer:自注意力与多头自注意力的原理及实现

自从Transformer[3]模型在NLP领域问世后,基于Transformer的深度学习模型性能逐渐在NLP和CV领域(Vision Transformer)取得了令人惊叹的提升。本文的主要目的是介绍经典Transformer模型和Vision Transformer的技术细节及基本原理,以方便

【动手深度学习-笔记】注意力机制(四)自注意力、交叉注意力和位置编码

像这样的,查询、键和值来自同一组输入的注意力机制,被称为自注意力(self-attention)或者内部注意力(intra-attention)。总而言之,卷积神经网络和自注意力都拥有并行计算的优势,而且自注意力的最大路径长度最短。DETR中,为了保留特征的空间信息,没有将二维数据平铺为一维,而是分

DeepSpeed使用指南(简略版)

Zero Redundancy Optimizer (ZeRO)是DeepSpeed的workhorse. 用户可以提供不同的ZeRO config文件,来实现DeepSpeed的不同功能特性。来看一下官网教程对ZeRO的描述:一句话总结:,划分而不是复制。即,传统的深度学习,模型训练并行,是将模型

【CBAM 解读】混合注意力机制:Convolutional Block Attention Module

本文提出了卷积块注意模块(CBAM),这是一种简单而有效的前馈卷积神经网络注意模块。

Repvgg详解及其实现(pytorch)

原论文中的结构图很直观的展示了repvgg到底是什么意思,对比Resnet它仍然有着类似残差的结构,就是在3*3的卷积基础上弄了一个1*1的分支和一个identity分支(在步长不等于2且输入输出通道相等的情况下),这样除了方便推理过程的融合,似乎还有多分支的好处,因为有丰富的梯度信息(狗头保命),

对Transformer中Add&Norm层的理解

首先我们还是先来回顾一下Transformer的结构:Transformer结构主要分为两大部分,一是Encoder层结构,另一个则是Decoder层结构,Encoder 的输入由 Input Embedding 和 Positional Embedding 求和输入Multi-Head-Atten

YOLOv5 6.0/6.1结合ASFF

YOLO小白纯干货分享!!!YOLOv5 6.0/6.1结合ASFF。本人在多个数据集上做了大量实验,针对不同的数据集效果不同,需要大家进行实验。有效果有提升的情况占大多数。最后,希望能互粉一下,做个朋友,一起学习交流。

2023年3月的10篇论文推荐

本文整理的是本月应该阅读的10篇论文,将包括多模态语言模型、扩散模型、机器翻译等主题。

图像超分辨率重建(pytorch)

本文在原论文的基础上进行了代码补充,并提供了整个流程的代码运行方法以完成图像超分辨率工作。

YOLOv5-v6.0学习笔记

YOLOv5-6.0版本的Backbone主要分为Conv模块、CSPDarkNet53和SPPF模块。YOLOv5在Conv模块中封装了三个功能:包括卷积(Conv2d)、Batch Normalization和激活函数,同时使用autopad(k, p)实现了padding的效果。其中YOLOv

pytorch 多GPU并行训练代码讲解

pytorch 多GPU并行训练介绍,参考我之前的博客:pytorch中使用多GPU并行训练。本文主要针对代码部分进行讲解。1. 首先判断有没有可用的GPU,如果没有的话,这边会报错提醒,因为我们的脚本对针对多GPU训练的场景的。2. 初始化各进程环境。

【损失函数:3】感知损失:Perceptual Loss、总变分损失(TV Loss)(附Pytorch实现)

提出感知损失的概念,用于实时超分辨任务和风格迁移任务,后来也被应用于更多的领域,在图像去雾方向也有不少工作使用到了感知损失,所以这里就细看一下感知损失具体是什么,该如何构造(说个题外话:我之前做实验,用VGG提取特征构造感知损失狂爆内存,然后直接放弃了,都怪设备太垃圾啊!!!)。

yolov5损失函数详解【附代码】

本文章将结合代码对yolov5损失函数部分进行详细说明,包含其中的样本匹配问题。如果还需要学习关于yolov5其他部分内容,可以参考我其他文章。yolov5语义分割:yolov5 trt 学习:yolov5剪枝:通过yaml修改yolov5:iou样本匹配:下面的3个feature_map是仿照v5

从0到1实现GCN——最详细的代码实现

从0到1的GCN代码实现。详细介绍了基于GCN公式的代码实现,以及更加简单高效的基于Pytorch Geometric(PyG)的GCN的代码实现。帮助小白快速入手GCN!!!

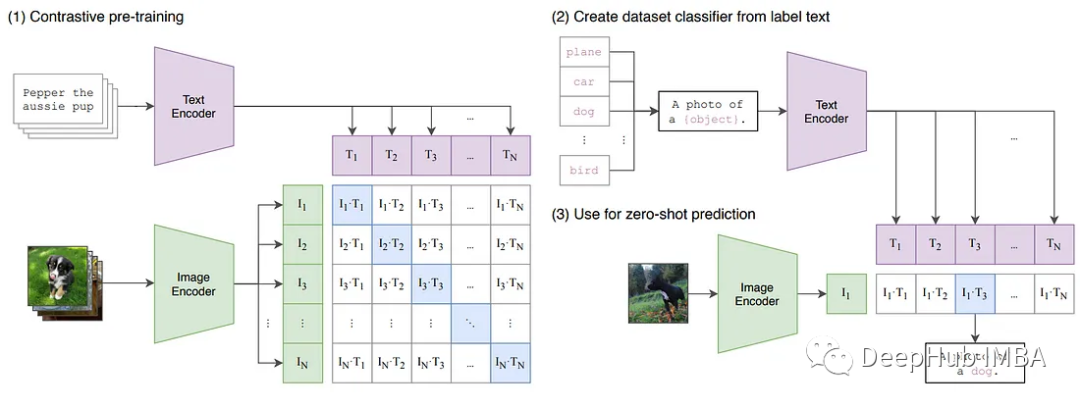

CLIP:语言-图像表示之间的桥梁

然而CLIP的多模态架构通过在相同的潜在空间中学习语言和视觉表现在二者之间建立了桥梁。因此,CLIP允许我们利用其他架构,使用它的“语言-图像表示”进行下游任务。

人工智能大模型之ChatGPT原理解析

当前阶段ChatGPT已经大大的降低了很多行业的门槛,可以辅助专业人士大大提高效率,它很有可能成为改变世界的一项技术我们每个人都应该学习ChatGPT,它的解决问题方式完全符合大数据思维,生活在当今的信息社会,有了大数据思维会让我们如虎添翼。

MRR@K P@K R@K意义阐述与对比

首先需要说的是,这几个东西都是评价标准,在我当前工作的领域而言,其衡量的是推荐系统的性能。R(Recall)

PyTorch深度学习实战 | 自然语言处理与强化学习

PyTorch是当前主流深度学习框架之一,其设计追求最少的封装、最直观的设计,其简洁优美的特性使得PyTorch代码更易理解,对新手非常友好。本文主要介绍深度学习领域中自然语言处理与强化学习部分。

人工智能前沿知识

人工智能(Artificial Intelligence, AI)是指通过模拟、延伸和扩展人类智能的理论、方法、技术和应用系统,使机器能够感知环境、理解自然语言、分析数据、学习知识、做出决策和行动,从而实现智能化的机器系统。通常包括知识表示、推理与规划、机器学习、计算机视觉、自然语言处理、智能控制、

GPT-4 和ChatGPT API的定价分析

OpenAI发布了他们的ChatGPT新机器学习模型GPT-4。GPT-4是GPT-3的一大进步,GPT-3是当前ChatGPT免费版本(GPT 3.5 Turbo)所运行的模型的基础,今天我们也来凑个热点,研究一下它们的定价