YOLO系列 --- YOLOV7算法(三):YOLO V7算法train.py代码解析

YOLO系列 --- YOLOV7算法(三):YOLO V7算法train.py代码解析

Pytroch进行模型权重初始化

Pytroch常见的模型参数初始化方法有apply和model.modules()。Pytroch会自动给模型进行初始化,当需要自己定义模型初始化时才需要这两个方法。

Cursor太强了,从零开始写ChatGLM大模型的微调代码

初试基于chatgpt4的写代码神器

可分离卷积(Separable convolution)详解

可分离卷积包括空间可分离卷积(Spatially Separable Convolutions)和深度可分离卷积(depthwise separable convolution)。

详解可变形注意力模块(Deformable Attention Module)

Deformable Attention(可变形注意力)首先在2020年10月初商汤研究院的《Deformable DETR: Deformable Transformers for End-to-End Object Detection》论文中提出,在2022CVPR中《Vision Transf

Pytorch 深度学习注意力机制的解析与代码实现

深度学习Attention注意力机制的解析及其Pytorch代码实现

踩雷日记:Pytorch mmcv-full简易安装

因为mmcv-full版本与pytorch和cuda版本不匹配,导致mmcv-full安装失败。提示:安装mmcv-full前,先把mmcv卸掉例如:以上就是今天要讲的内容,本文简单介绍了mmcv-full的安装,希望对你有所帮助。

【深度学习】详解 MAE

【深度学习】详解 MAE - Masked Autoencoders Are Scalable Vision Learners

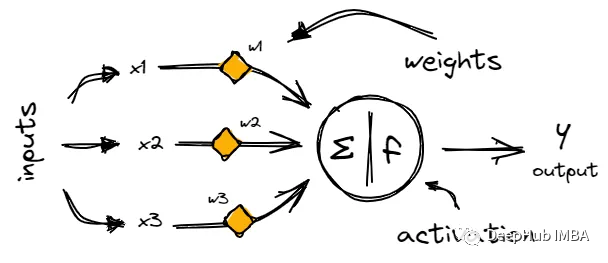

神经网络初学者的激活函数指南

如果你刚刚开始学习神经网络,激活函数的原理一开始可能很难理解。但是如果你想开发强大的神经网络,理解它们是很重要的。

学习笔记 | 多层感知机(MLP)、Transformer

多层感知机(MLP)、Transformer、Memory Bank

Segment Anything CV界的GPT—prompt-based里程碑式研究成果

Segment Anything由Meta AI发布,估计将成为计算机视觉界颠覆性成果,甚至可能重塑“计算机视觉”的概念。本文主要描述Segment AI的研究成果和简单应用,简明扼要提取有关论文的信息。

物理信息神经网络PINNs : Physics Informed Neural Networks 详解

本博客主要分为两部分:1、PINN模型论文解读2、PINN模型相关总结一、PINN模型论文解读1、摘要:基于物理信息的神经网络(Physics-informed Neural Network, 简称PINN),是一类用于解决有监督学习任务的神经网络,同时尊重由一般非线性偏微分方程描述的任何给定的物理

Ubuntu22.04设置独显用于深度学习运算,核显用于屏幕显示

目前有需求配置台式机win11+Ubuntu的双系统,安装双系统的教程比较多,安装n卡驱动的教程也比较多,但是大多数的教程都到独显驱动安装完毕为止,这意味着按照教程配置好之后桌面会占用独显的现存大概100-200M,对于显存比较紧张的深度学习运算的情况下很有可能是致命的。因此,本篇教程旨在通过设置使

带你一文透彻学习【PyTorch深度学习实践】分篇——线性模型 & 梯度下降

鉴于PyTorch深度学习实践系列文章,篇幅较长,有粉丝朋友反馈说不便阅读。因此这里将会分篇发布,以便于大家阅读。本次发布的是 “基础 模型&算法 回顾”章节中的线性模型、Gradient Descent(梯度下降)。

【ChatGPT】ChatGPT-5 强到什么地步?

ChatGPT的能力,为什么停止训练ChatGPT

Swin Transformer原理详解篇

CV攻城狮入门VIT(vision transformer)之旅——近年超火的Transformer你再不了解就晚了!🍁🍁🍁CV攻城狮入门VIT(vision transformer)之旅——VIT原理详解篇🍁🍁🍁CV攻城狮入门VIT(vision transformer)之旅——VIT

超越ShuffleNet、MobileNet、MobileViT等模型的新backbone FasterNet

为了设计快速神经网络,许多工作都集中在减少浮点运算(FLOPs)的数量上。然而,作者观察到FLOPs的这种减少不一定会带来延迟的类似程度的减少。这主要源于每秒低浮点运算(FLOPS)效率低下。为了实现更快的网络,作者重新回顾了FLOPs的运算符,并证明了如此低的FLOPS主要是由于运算符的频繁内存访

扩散模型DDPM开源代码的剖析【对应公式与作者给的开源项目,diffusion model】

论文地址:https://proceedings.neurips.cc/paper/2020/hash/4c5bcfec8584af0d967f1ab10179ca4b-Abstract.html项目地址:https://github.com/hojonathanho/diffusion公式推导参考

深度学习中的卷积神经网络

2012年,AlexNet横空出世,卷积神经网络从此火遍大江南北。此后无数人开始研究,卷积神经网络终于在图像识别领域超过人类,那么卷积神经网络有什么神奇?下面我们来了解了解。

PyTorch之F.pad的使用与报错记录

这一函数用于实现对高维tensor的形状补齐操作。模式中,padding的数量不得超出原始tensor对应维度的大小。常见的错误主要是因为padding的数量超过了对应模式的要求。模式中,padding的数量必须小于对应维度的大小。对于padding并没有限制。