基于时间图神经网络多的产品需求预测:跨序列依赖性建模实战指南

本文展示了如何通过学习稀疏影响图、应用图卷积融合邻居节点信息,并结合时间卷积捕获演化模式的完整技术路径,深入分析每个步骤的机制原理和数学基础。

基于图神经网络的自然语言处理:融合LangGraph与大型概念模型的情感分析实践

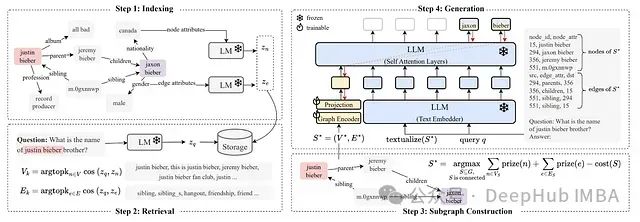

大型概念模型(Large Concept Models, LCMs)与图神经网络的融合为这一挑战提供了创新解决方案,通过构建基于LangGraph的混合符号-语义处理管道,实现了更精准的情感分析、实体识别和主题建模能力。

图神经网络在信息检索重排序中的应用:原理、架构与Python代码解析

基于图的重排序是信息检索和图机器学习交叉领域一个令人兴奋的发展。通过明确表示检索到的文档以及外部知识之间的关系,这些方法解决了传统检索器孤立地考虑每个文档的局限性。

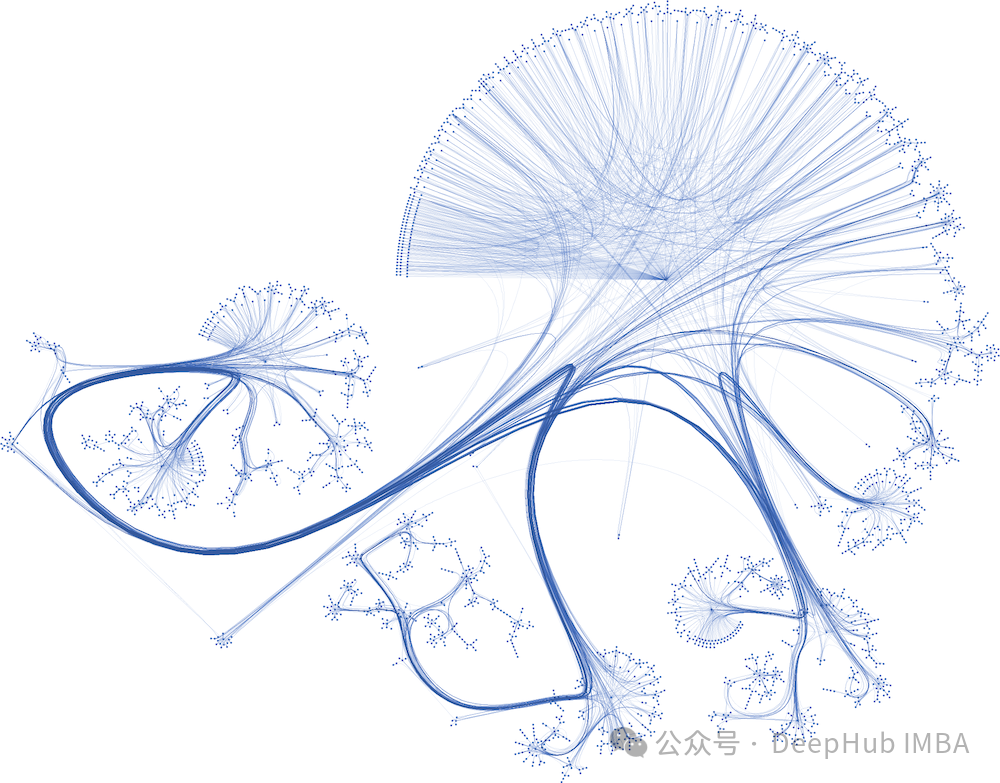

深入解析图神经网络注意力机制:数学原理与可视化实现

本文旨在通过可视化方法和数学推导,揭示图神经网络自注意力层的内部运作机制。我们将采用"位置-转移图"的概念框架,结合NumPy编程实现,一步步拆解自注意力层的计算过程,使读者能够直观理解注意力权重是如何生成并应用于图结构数据的。

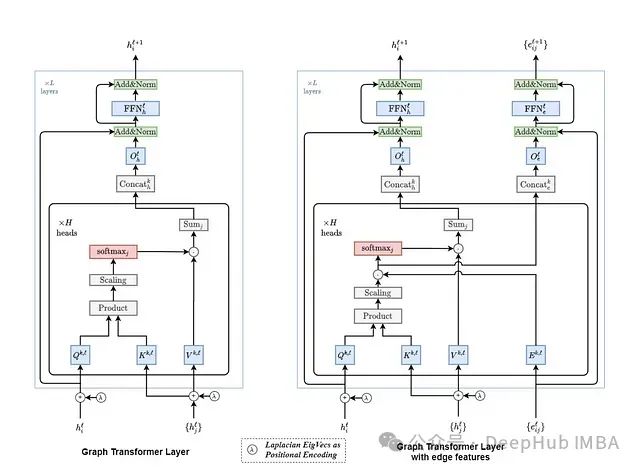

深入解析图神经网络:Graph Transformer的算法基础与工程实践

本文不仅是对Graph Transformer技术的深入解析,更是一份从理论到实践的完整技术指南,为那些希望在图神经网络领域深入发展的技术人员提供了宝贵的学习资源。

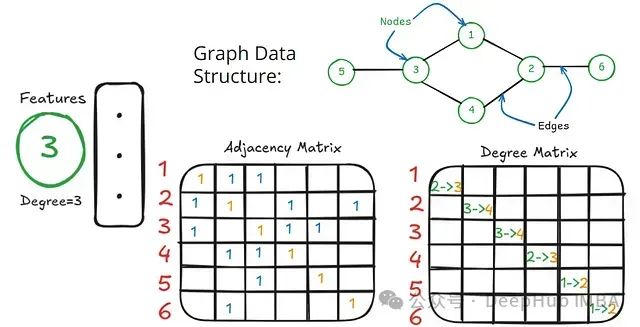

图卷积网络入门:数学基础与架构设计

本文系统地阐述了图卷积网络的架构原理。通过简化数学表述并聚焦于矩阵运算的核心概念,详细解析了GCN的工作机制。

图神经网络在欺诈检测与蛋白质功能预测中的应用概述

本文将深入探讨GNNs在欺诈检测和生物信息学领域的应用机制与技术原理。

图神经网络版本的Kolmogorov Arnold(KAN)代码实现和效果对比

今天我们就来使用KAN创建一个图神经网络Graph Kolmogorov Arnold(GKAN),来测试下KAN是否可以在图神经网络方面有所作为。

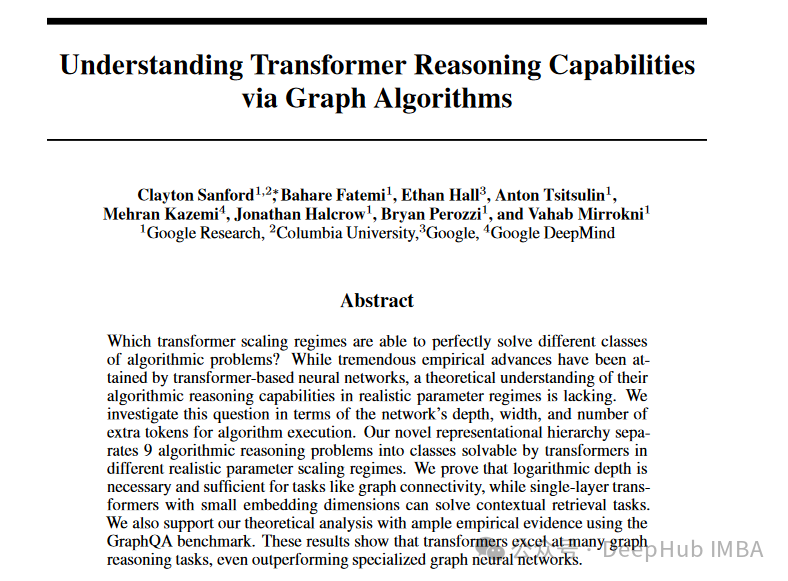

Transformer 能代替图神经网络吗?

今天介绍的这篇论文叫“Understanding Transformer Reasoning Capabilities via Graph Algorithms”

图神经网络入门示例:使用PyTorch Geometric 进行节点分类

本文介绍的主要流程是我们训练图神经网络的基本流程,尤其是前期的数据处理和加载,通过扩展本文的基本流程可以应对几乎所有图神经网络问题。

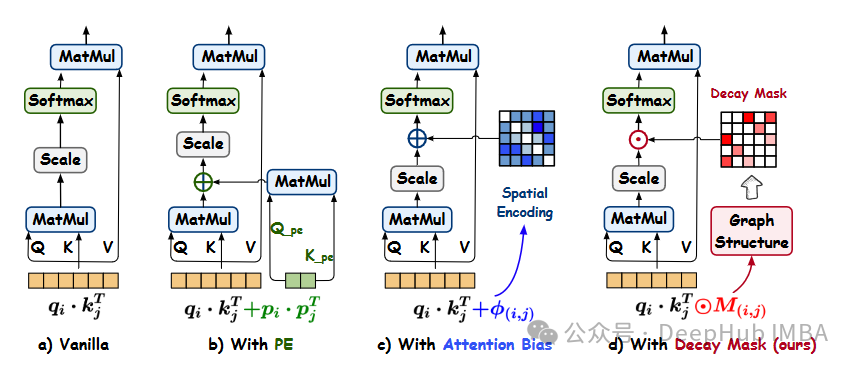

Gradformer: 通过图结构归纳偏差提升自注意力机制的图Transformer

Gradformer通过引入带有可学习约束的指数衰减掩码,为图Transformer提供了一种新的方法,有效地捕捉了图结构中的本地和全局信息。

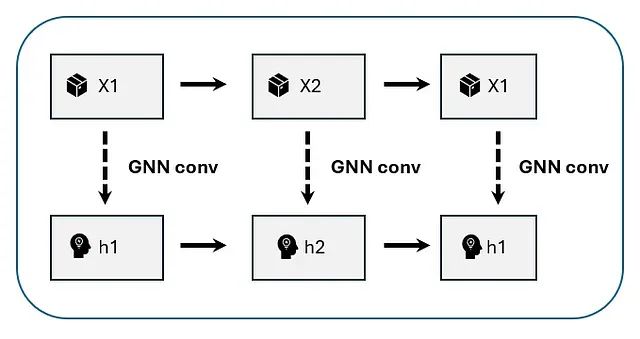

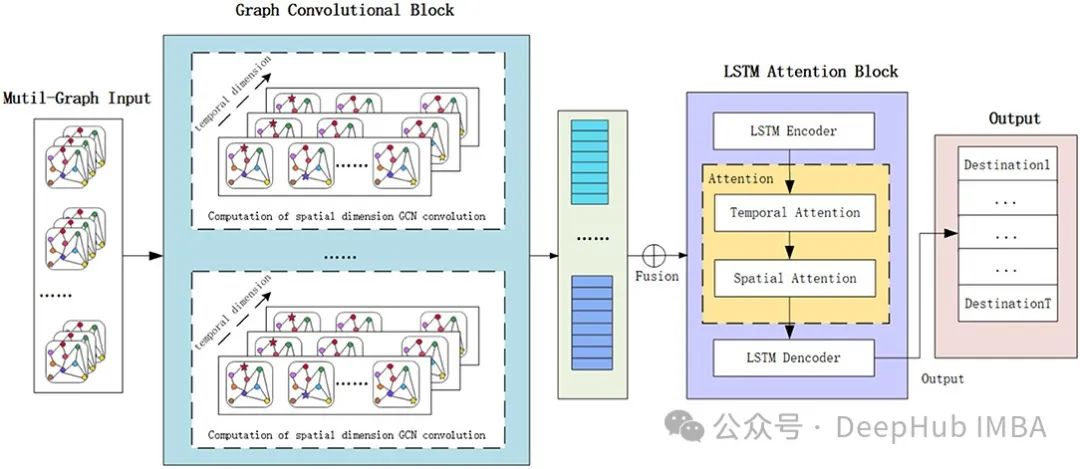

时空图神经网络ST-GNN的概念以及Pytorch实现

对于时空图神经网络Spatail-Temporal Graph来说,最简单的描述就是在原来的Graph基础上增加了时间这一个维度,也就是说我们的Graph的节点特征是会随着时间而变化的。

使用Pytorch Geometric 进行链接预测代码示例

PyTorch Geometric (PyG)是构建图神经网络模型和实验各种图卷积的主要工具。在本文中我们将通过链接预测来对其进行介绍。

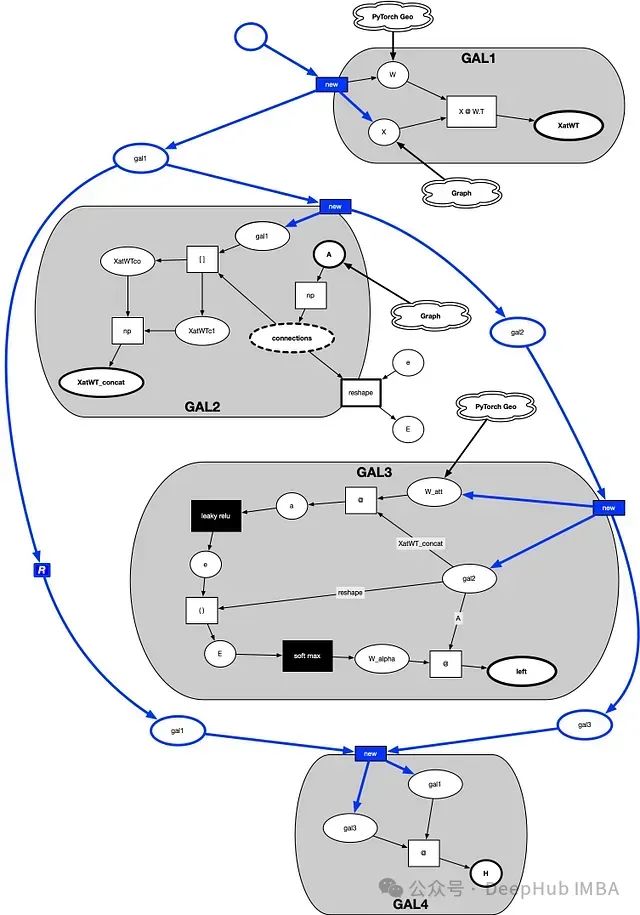

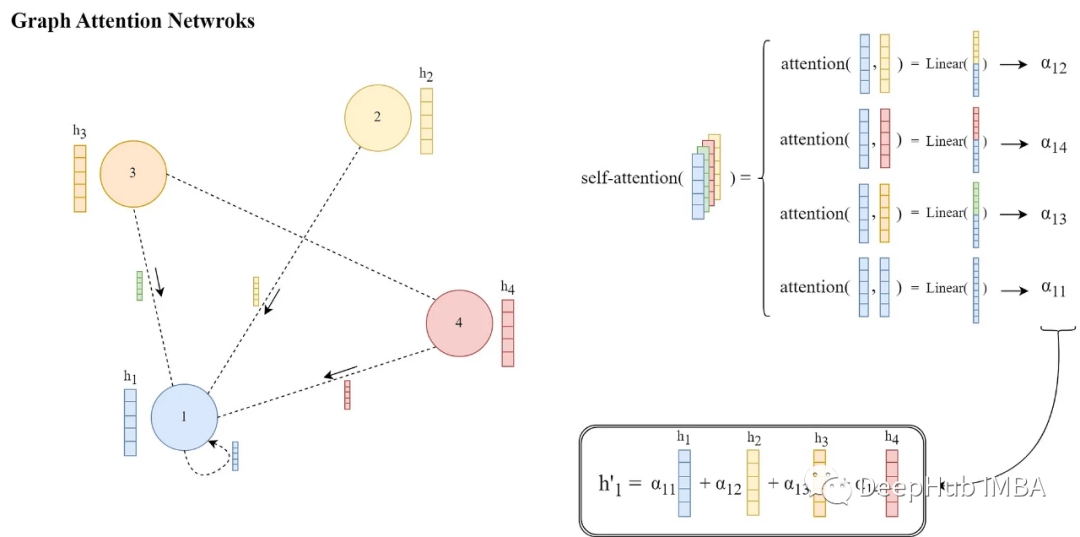

图注意网络(GAT)的可视化实现详解

本文介绍二零单个GNN层和GAT层的可视化实现。在论文中,他们还解释了是如何扩展多头注意方法的,我们这里没有进行演示。Graphbook是用于AI和深度学习模型开发的可视化IDE,Graphbook仍处于测试阶段,但是他却是一个很有意思的工具,通过可视化的实现,我们可以了解更多的细节。作者:Davi

图注意力网络论文详解和PyTorch实现

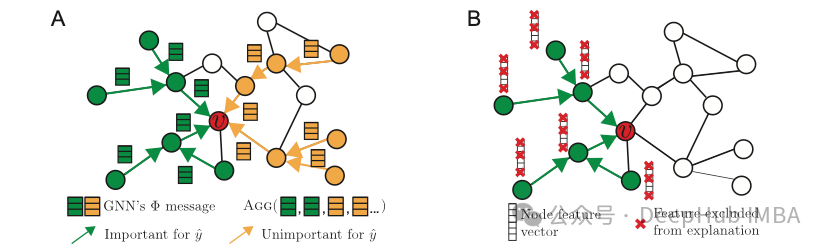

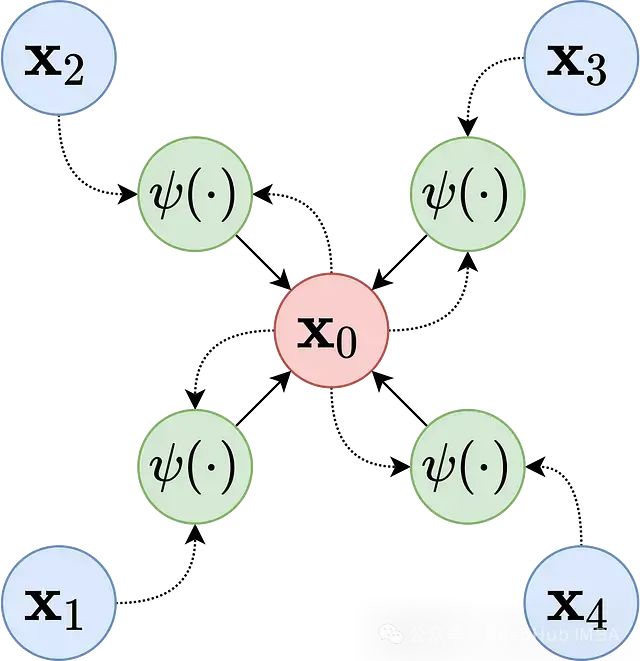

图注意力网络(GAT)[1]是一类特殊的gnn,主要的改进是消息传递的方式。他们引入了一种可学习的注意力机制,通过在每个源节点和目标节点之间分配权重,

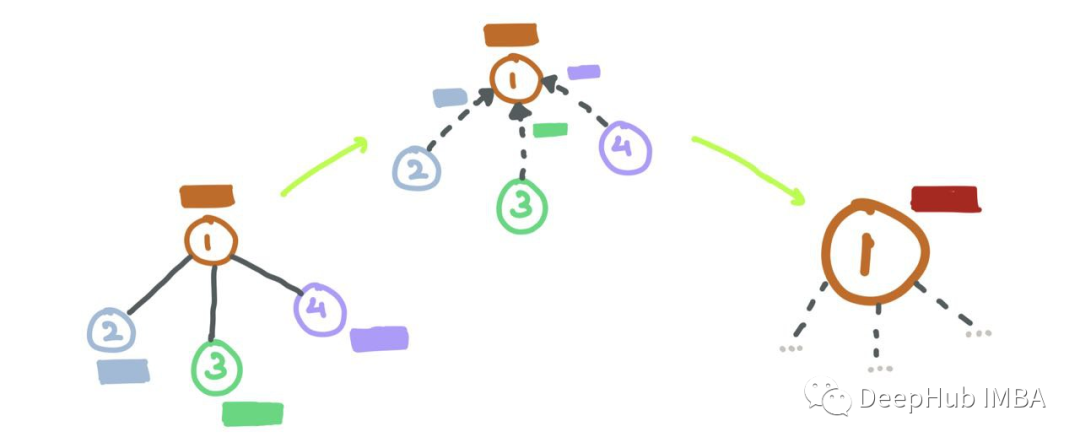

【图神经网络实战】深入浅出地学习图神经网络GNN(下)

最简单的思路是:我们可以将每个时刻的序列先送入GCN进行特征提取,然后再将提取后的特征送入GRU单元往后传递,依此类推。图中的注意力机制相当于在某个点进行特征重构时,其邻接点都加上一个权重,使得其在重构特征时受权重较大的邻接点影响更大,起到注意力的效果。对于动态图,传统的GNN就不太好用了,想想在时

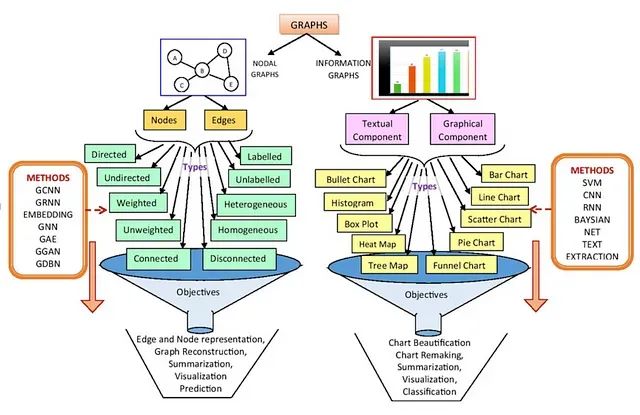

图神经网络的数学原理总结

图深度学习(Graph Deep Learning) 多年来一直在加速发展。本文将流行的图神经网络及其数学细微差别的进行详细的梳理和解释

【图神经网络实战】深入浅出地学习图神经网络GNN(上)

V:点,每个点都有自己的特征向量(特征举例:邻居点数量、一阶二阶相似度)E:边,每个边都有自己的特征向量(特征举例:边的权重值、边的定义)U:整个图,每个图都有自己的特征向量(特征举例:节点数量、图直径)传统神经网络(CNN、RNN、DNN)要求输入格式是固定的(如2424、128128等)。但在实

- 1

- 2