深入BERT内核:用数学解密掩码语言模型的工作原理

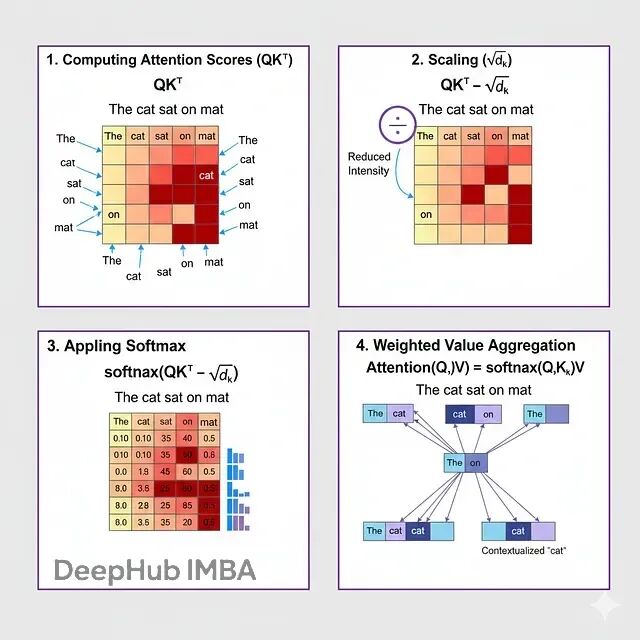

这篇文章会把MLM的数学机制拆开来逐一讲解。从一个被遮住的句子开始,经过注意力计算、概率分布、梯度下降,看看这些数学操作到底怎么让BERT达到接近人类的语言理解能力。搞懂这些数学原理,对于想要调优BERT或者设计类似模型的人来说很关键。

mmBERT:307M参数覆盖1800+语言,3万亿tokens训练

mmBERT是一个纯编码器架构的语言模型,在1800多种语言、3万亿tokens的文本上完成了预训练。

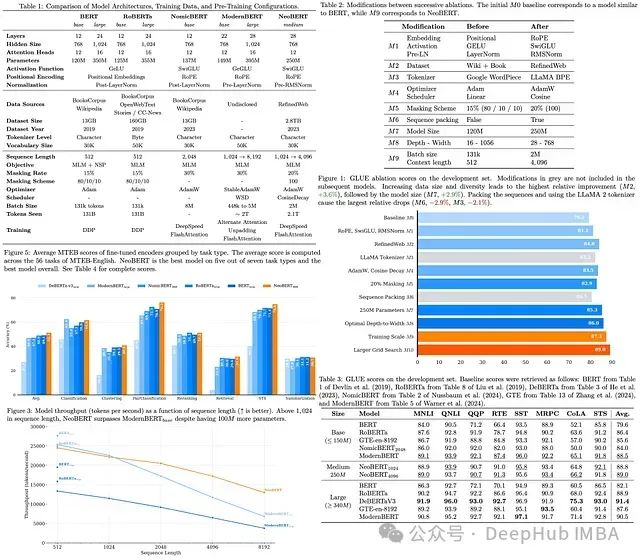

NeoBERT:4096 tokens上下文窗口,参数更少但性能翻倍

NeoBERT代表了双向编码器模型的新一代技术发展,通过整合前沿架构改进、现代大规模数据集和优化的预训练策略,有效缩小了传统编码器与高性能自回归语言模型之间的性能差距。

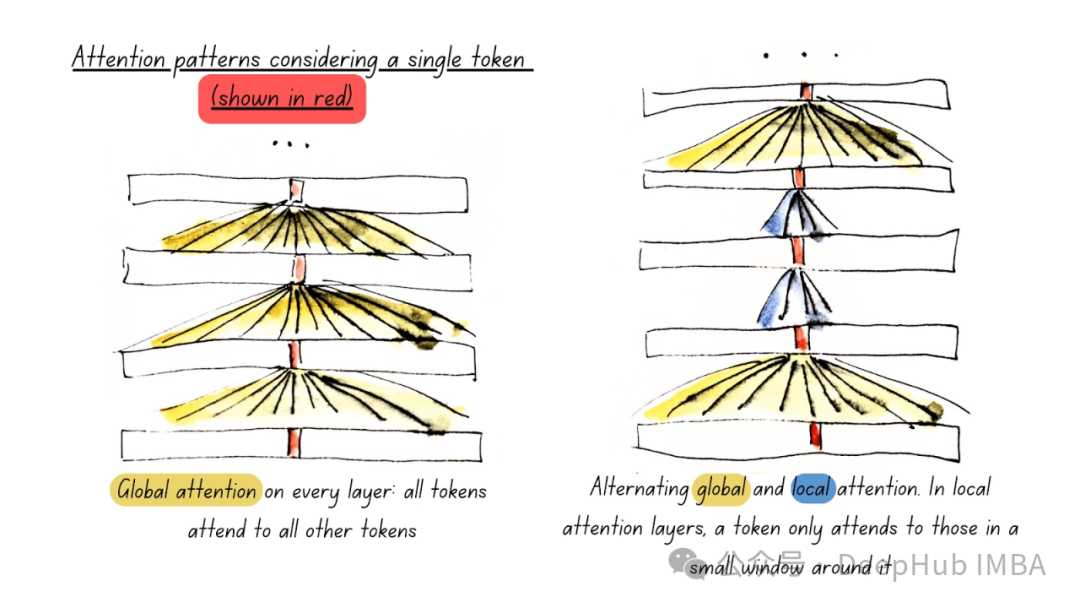

BERT的继任者ModernBERT:融合长序列处理、代码理解与高效计算的新一代双向编码器

。ModernBERT 是一个全新的模型系列,在**速度**和**准确性**两个维度上全面超越了 BERT 及其后继模型。

基于Joint BERT模型的意图识别技术实践

意图识别在诸多领域已经有了非常广泛的应用,例如各个品牌的智能语音助手,如今多模态模型能力迅猛增长,与LLM交流方式变得多样化,为了给LLM提供高质量有价值的上下文嵌入信息,引入意图识别变得尤为重要,其不仅能够过滤掉大部分无用但又不得不加入pipline的工具,还可以极大优化整个pipline的响应时

【AI大模型】解锁AI智能:从注意力机制到Transformer,再到BERT与GPT的较量

在AI技术的迅猛发展中,注意力机制成为了关键驱动力,赋予机器高效处理复杂信息的能力。本文深入探索注意力机制及其核心应用——Transformer架构,解析其如何通过自注意力机制革新自然语言处理。同时,对比分析GPT与BERT两大热门模型,揭示它们在策略上的差异与共识,探讨其在未来智能技术中的潜力。此

制作TTS前端模型数据集,预训练bert模型的字典数据是怎么调用的-chatgpt问答生成

这行代码的主要作用是加载和初始化一个预训练的 BERT 中文模型的分词器,使得你可以将自然语言文本转换为模型可以理解的 token 格式,从而进行进一步的自然语言处理任务,如文本分类、命名实体识别等。上述步骤包括数据预处理、数据编码、构建训练数据集和训练模型。通过这些步骤,可以将韵律标签和多音字标签

基于MindSpore实现BERT对话情绪识别

基于MindSpore实现BERT对话情绪识别。

AI:182-利用Python进行自然语言处理(NLP)(BERT与GPT的应用)

BERT是由Google开发的预训练语言表示模型,其突出特点是双向编码器结构,能够更好地理解上下文信息。BERT可以应用于各种NLP任务,如文本分类、命名实体识别、问答系统等。GPT是由OpenAI提出的生成式预训练转换模型,其核心思想是使用自回归模型生成文本。GPT模型在文本生成、对话系统等领域有

【好书推荐2】AI提示工程实战:从零开始利用提示工程学习应用大语言模型

随着大语言模型的快速发展,语言AI已经进入了新的阶段。这种新型的语言AI模型具有强大的自然语言处理能力,能够理解和生成人类语言,从而在许多领域中都有广泛的应用前景。大语言模型的出现将深刻影响人类的生产和生活方式。本书将介绍提示工程的基本概念和实践,旨在帮助读者了解如何构建高质量的提示内容,以便更高效

【深度学习应用】基于Bert模型的中文语义相似度匹配算法[离线模式]

【代码】基于Bert模型的中文语义相似度匹配算法(离线模式)

AI大模型中的Bert

AI大模型中的Bert

BERT+TextCNN实现医疗意图识别项目

BERT+TextCNN实现医疗意图识别项目

基于Milvus和BERT搭建AI智能问答系统(基础概念与架构)

基于Milvus和BERT搭建AI智能问答系统(基础概念与架构)

BERT详解

主要介绍了什么是Bert模型,它的优点,输入输出和预训练方法。

AI数字人:基于VITS模型的中文语音生成训练

VITS(Variational Inference with adversarial learning for end-to-end Text-to-Speech)是一种结合变分推理(variational inference)、标准化流(normalizing flows)和对抗训练的高表现力语

【科研】ET-BERT代码分析

论文使用的TLS1.3数据集是从 2021 年 3 月到 2021 年 7 月在中国科技网 (CSTNET) 上收集的。【困惑点1】执行代码里使用的encryptd_vocab.txt不造从哪里生成的,,待我看看代码。:由于可能存在原始PCAP数据的复杂性,建议在报错时执行以下步骤检查代码执行情况。

BERT模型基本理念、工作原理、配置讲解(图文解释)

BERT模型基本理念、工作原理、配置讲解(图文解释)

【深度学习】预训练语言模型-BERT

BERT是一种预训练语言模型(pre-trained language model, PLM),其全称是Bidirectional Encoder Representations from Transformers。