OpenPose笔记——在编译好的OpenPose C++代码上跑自己的图片和视频

前面自编译好了OpenPose 的python,但是没找到用python跑视频的代码。。。最终,还是需要在C++工程里来跑。编译好的解决方案里面有很多例子上面一共17个例子,图片、文件夹、手、脸、热力图、输入流(摄像头)等多个例子包含在内,但是没有视频的例子。第一种运行的方式是 命令行运行打开cmd

独家丨前美团联合创始人王慧文“正在收购”国产AI框架OneFlow,光年之外欲添新大将...

文丨谭婧以ChatGPT为代表的AI大模型是2023年的科技C位。2023年3月27日,ChatGPT引发的“抓马连续剧”,又有新剧更新。前情提要:前美团联合创始人、高级副总裁王慧文发文宣布进入AI领域,称将打造中国的OpenAI。新闻标题一:《王慧文放话:我先投3个亿》当然,他现在的身份是美团非执

联邦学习:FedProx框架

联邦学习不同于传统的分布式优化的两个关键挑战:高度的系统和统计异构性。引入了一个框架,FedProx以解决异构性难题(统计异构 系统异构)。FedProx可以看作是FedAvg的泛化、重构。对于非独立分布(统计异质性)的训练数据,框架提供收敛性保证(统计异构);允许每个参与的设备执行可变数量的工作(

【Pytorch基础知识】数据的归一化和反归一化

搞清数据的归一化和反归一化,快速掌握将图片转为tensor进行系列操作后,再转为图片

PyTorch 深度学习实战 |用 TensorFlow 训练神经网络

为了更好地理解神经网络如何解决现实世界中的问题,同时也为了熟悉 TensorFlow 的 API,本篇我们将会做一个有关如何训练神经网络的练习,并以此为例,训练一个类似的神经网络。

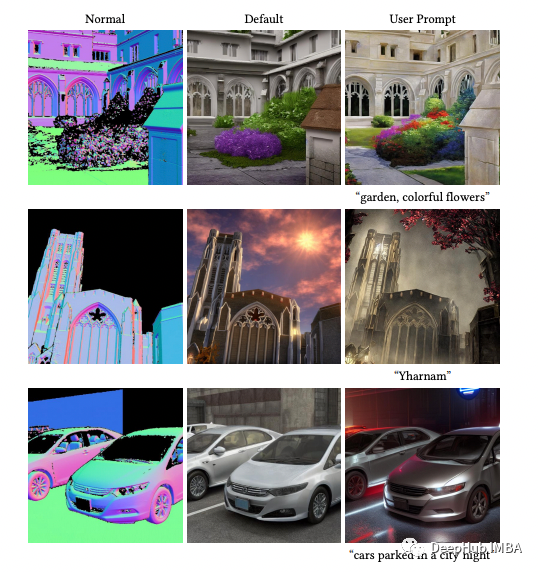

常用的ControlNet以及如何在Stable Diffusion WebUI中使用

ControlNet是斯坦福大学研究人员开发的Stable Diffusion的扩展,使创作者能够轻松地控制AI图像和视频中的对象

深度学习中FLOPS和FLOPs的区别与计算

我们在购买GPU或者计算目标检测模型复杂度的时候,一般会遇到FLOPS和FLOPs这两个指标,在此加以区分。

Windows端CUDA11.3+CUDNN+pytorch环境搭建

1、显卡驱动的安装最近,在学习pytorch深度学习,遇到很多的坑,环境配置也出现过问题,忍不住和大家进行分享,现在把环境搭建过程分享给大家。1.1、查看自己的显卡。具体操作:我的电脑-——属性——设备管理器——显示适配器1.2、驱动的下载、安装。在找到自己的显卡后,去NVIDIA官网下载安装驱动选

nerf训练自己的数据,过程记录十分详细

用nerf渲染自己拍摄的数据,过程详细且配图解释!!!

AI绘画黑科技Stable Diffusion WebUI在线部署使用教程

AI绘画黑科技Stable Diffusion,能够根据文字描述生成精美图像,开源且在消费级GPU上就能运行。Stable Diffusion WebUI是Stable Diffusion的Web版,提供了便捷的WebUI交互界面,部署使用方便,支持中文汉化插件,而且通过Stable Diffusi

深度解析预训练权重的本质和作用:你真的了解它们吗?

为了训练自定义模型,通常需要使用大量标注好的图像数据来训练模型。但是,当可用的训练数据不够多时,可以使用预训练权重来提高模型的性能。

变化检测(Change Detection,CD) 综述2篇 & CD代码 & 常用CD数据集及链接

CD best paper 。综述1,介绍变化检测流程、各种类型的CD数据集、分析不同的算法框架与当前AI主流网络,实际应用,机遇与挑战(无监督、异构数据、是否可靠),内容丰富。综述2,包括,遥感领域中变化检测的应用,深度学习算法概述(历史、deep models、DBNs、SAEs、CNNs),已

强化学习PPO从理论到代码详解(2)---PPO1和PPO2

上一节我们了解了什么是策略梯度,本节开始讲PPO理论之前,我们先提出一个概念,什么在线学习,什么离线学习。

GPT-4 API 接口调用及价格分析

对开发者来说,GPT-4最激动人心的是API接口同步发布。我今天获得了API访问权限,本文将跟大家分享GPT-4 API接口的使用以及大家关心的价格分析。

ConvNeXt网络详解

今年(2022)一月份,Facebook AI Research和UC Berkeley一起发表了一篇文章A ConvNet for the 2020s,在文章中提出了ConvNeXt纯卷积神经网络,它对标的是2021年非常火的Swin Transformer,通过一系列实验比对,在相同的FLOPs

【pytorch】Vision Transformer实现图像分类+可视化+训练数据保存

一、Vision Transformer介绍Transformer的核心是 “自注意力” 机制。论文地址:https://arxiv.org/pdf/2010.11929.pdf自注意力(self-attention)相比 卷积神经网络 和 循环神经网络 同时具有并行计算和最短的最大路径⻓度这两个优

基于深度学习的图像配准

基于深度学习的图像配准技术

Batch Norm的原理和作用

Batch Normalization做了什么?怎么用?

Pytorch实现GAT(基于PyTorch实现)

本专栏整理了《图神经网络代码实战》,内包含了不同图神经网络的相关代码实现(PyG以及自实现),理论与实践相结合,如GCN、GAT、GraphSAGE等经典图网络,每一个代码实例都附带有完整的代码。

yolov7训练自己的数据集

yolov7训练自己的数据集并使用labellmg标注工具的安装和使用