Pytorch:手把手教你搭建简单的全连接网络

利用pytorch搭建简单全连接网络的步骤,适合初学者快速上手

YOLOv5训练结果分析

YOLOv5训练结果分析

目标检测算法——YOLOv5/YOLOv7改进之结合Swin Transformer V2(涨点神器)

目标检测算法——YOLOv5/YOLOv7结合Swin Transformer V2

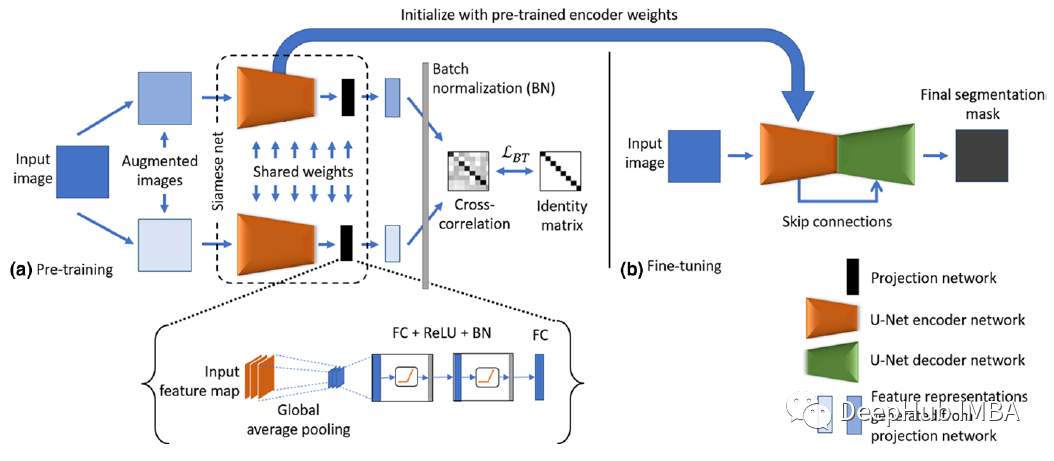

BT - Unet:生物医学图像分割的自监督学习框架

BT-Unet采用Barlow twin方法对U-Net模型的编码器进行无监督的预训练减少冗余信息,以学习数据表示。之后,对完整网络进行微调以执行实际的分割。

Pytorch文档解读|torch.nn.MultiheadAttention的使用和参数解析

整体称为一个单注意力头,因为运算结束后只对每个输入产生一个输出结果,一般在网络中,输出可以被称为网络提取的特征,那我们肯定希望提取多种特征,[ 比如说我输入是一个修狗狗图片的向量序列,我肯定希望网络提取到特征有形状、颜色、纹理等等,所以单次注意肯定是不够的 ]因为是拼接而成的,所以每个单注意力头其实

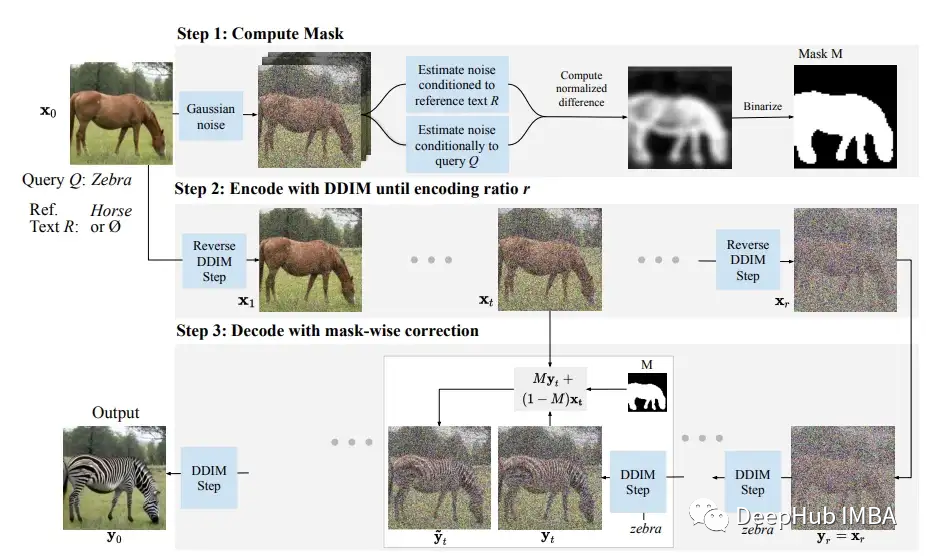

使用HuggingFace实现 DiffEdit论文的掩码引导语义图像编辑

在本文中,我们将实现Meta AI和Sorbonne Universite的研究人员最近发表的一篇名为DIFFEDIT的论文。对于那些熟悉稳定扩散过程或者想了解DiffEdit是如何工作的人来说,这篇文章将对你有所帮助。

KITTI数据集解析和可视化

文章链接概述KITTI数据集是目前国际上最大的自动驾驶场景下的计算机视觉算法评测数据集。该数据集用于评测立体图像(stereo),光流(optical flow),视觉测距(visual odometry),3D物体检测(object detection)和3D跟踪(tracking)等计算机视觉技

机器学习【期末复习总结】——知识点和算法例题(详细整理)

【电子科技大学、机器学习课程】(期末复习、知识点和算法例题、详细总结)

计算机视觉项目实战-基于特征点匹配的图像拼接

之前我们介绍过基于OpenCv的特征匹配操作,我们通过特征匹配可以精确的找到目标。本节我们继续探索基于特征匹配还可以做哪些事情。我们都在拍一个集体的过程中使用过苹果手机的全图效果进行拍照留念。那么苹果手机这个效果它是基于什么技术来做的呢?没错其实就是特征匹配。他是实时拍取多个照片,然后使用特征匹配操

yolo 车辆测距+车辆识别+单目测距(双目测距)

基于yolo目标检测算法实现的车前道路中的车辆和行人检测,并且可以估测出目标与本车之间的距离。

detectron2安装详细教程+demo测试

win10 下 detectron2 安装详细教程,手把手教你配置!!

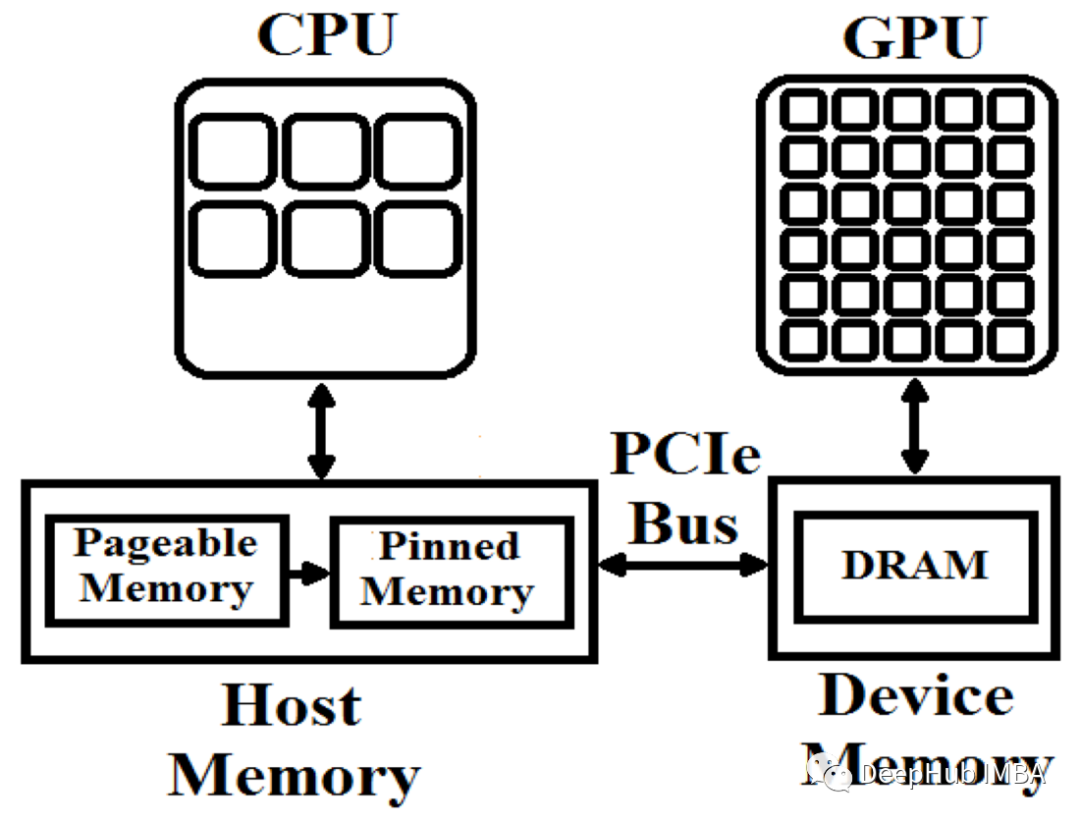

从头开始进行CUDA编程:流和事件

为了提高我们的并行处理能力,本文介绍CUDA事件和如何使用它们

YOLOv5 Head解耦

【代码】YOLOv5 Head解耦。

CNN中的底层、高层特征、上下文信息、多尺度

分类要求特征有较多的高级信息,回归(定位)要求特征包含更多的细节信息。

YOLOv5中的SPP/SPPF结构详解

深度学习入门小菜鸟,希望像做笔记记录自己学的东西,也希望能帮助到同样入门的人,更希望大佬们帮忙纠错啦~侵权立删。目录一、SPP的应用的背景二、SPP结构分析三、YOLOv5中SPP结构源码解析(内含注释分析)一、SPP的应用的背景在卷积神经网络中我们经常看到固定输入的设计,但是如果我们输入的不能是固

2022年顶会、顶刊SNN相关论文----------持续更新中

2022年顶会、顶刊脉冲神经网络相关优秀论文收集

BERT详解:概念、原理与应用

对bert的原理,结构,预训练过程进行介绍

图像处理中常见的几种插值方法:最近邻插值、双线性插值、双三次插值(附Pytorch测试代码)

在学习可变形卷积时,因为学习到的位移量Δpn可能是小数,因此作者采用双线性插值算法确定卷积操作最终采样的位置。通过插值算法我们可以根据现有已知的数据估计未知位置的数据,并且可以利用这种方法对图像进行缩放、旋转以及几何校正等任务。此处我通过这篇文章学习总结常见的三种插值方法,包括最近邻插值、双线性插值

yolov7训练自己的数据集及报错处理

yolov7训练自己的数据集及报错处理,其实和yolov5差不太多

Pytorch实战100例-第6天:好莱坞明星识别

本文为内部限免文章,参考本文所写记录性文章,请在文章开头注明以下内容,复制粘贴即可。