SadTalker AI模型使用一张图片与一段音频便可以自动生成视频

SadTalker模型是一个使用图片与音频文件自动合成人物说话动画的开源模型,我们自己给模型一张图片以及一段音频文件,模型会根据音频文件把传递的图片进行人脸的相应动作,比如张嘴,眨眼,移动头部等动作。然后就可以git sadtalker的工程目录,并安装相应的第三方库,这里主要是torch相关的库,

【YOLOv5】LabVIEW+TensorRT的yolov5部署实战(含源码)

【YOLOv5】LabVIEW+TensorRT的yolov5部署实战(含源码)

ONNXRuntime介绍及如何使用ONNXRuntime进行模型推理

本文介绍了ONNXRuntime的基本使用方法,包括安装ONNXRuntime、加载模型和进行模型推理。ONNXRuntime提供了简单易用的API,使得使用者可以方便地进行模型推理。同时,其高性能、可扩展、跨平台的特点也让其成为一个优秀的深度学习推理引擎。

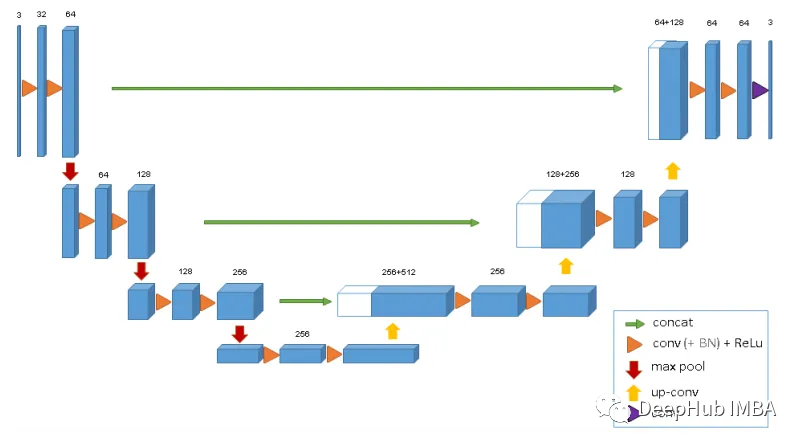

用于3D MRI和CT扫描的深度学习模型总结

本文中将介绍6种神经网络架构,可以使用它们来训练3D医疗数据上的深度学习模型。

k8s英伟达GPU插件(nvidia-device-plugin)

k8s英伟达GPU插件(nvidia-device-plugin)

手把手教你如何0基础编写基于AI机器视觉的--王者荣耀百里守约的自瞄程序,我家村头的傻X都能学会的教程!

手把手教你如何0基础编写基于AI机器视觉的--王者荣耀百里守约的自瞄程序,我家村头的傻X都能学会的教程!

Yolov5 数据增强 - Mosaic

Mosaic

YOLOV8改进对比 vs v5 X

YOLOv8与YOLOX的对比

MMdetection 环境配置、config文件解析以及训练自定义VOC数据集

MMDetection是针对目标检测任务推出的一个开源项目,它基于Pytorch实现了大量的目标检测算法,把数据集构建、模型搭建、训练策略等过程都封装成了一个个模块,通过模块调用的方式,我们能够以很少的代码量实现一个新算法,大大提高了代码复用率。本文根据我自己最近的使用经验,记录一下关于MMdete

深度学习——损伤函数(dice_loss)

深度学习——损伤函数(dice_loss)

人工智能生成内容(AIGC):概念、发展历史及其机遇、挑战与未来方向

人工智能生成内容(Artificial Intelligence Generated Content, AIGC), AIGC 是指使用生成式 AI (Generative Artificial Intelligence, GAI) 技术生成的内容,而不是由人类创作者创作的内容。

自动驾驶算法 -撞前预警论文解读与项目应用

1.1 深度估计应用场景之一(特斯拉撞前预警)1.2 深度估计概念1.3 深度估计整体架构1.4 深度估计架构流程论文解读1.5 深度估计项目应用

解决没有NVSMI文件夹以及nvidia-smi‘ 不是内部或外部命令,也不是可运行的程序 或批处理文件

nvidia-smi‘ 不是内部或外部命令,也不是可运行的程序 或批处理文件

使用Automatic1111在本地PC上运行SDXL 1.0

这是我们部署Stable Diffusion的第三篇文章了,前两篇文章都详细介绍了Automatic1111的stable-diffusion-webui的安装,这次主要介绍如何使用SDXL 1.0模型。

几种文本向量化方式原理简要介绍

几种文本向量化方式原理简要介绍

深度学习调参指南《Deep Learning Tuning Playbook》

这份指南的主要内容是调整超参数,也涉及深度学习训练的其他方面,例如 pipeline 实现和优化。指南假设机器学习问题是一个监督学习问题或自监督学习问题,但其中的一些规定也适用于其他类型的问题。

【已解决】ERROR:The testing results of the whole dataset is empty

已解决:ERROR:The testing results of the whole dataset is empty

pycharm全局搜索方法

pycharm全局搜索方法

ResNet代码复现+超详细注释(PyTorch)

ResNet代码复现(PyTorch),每一行都有超详细注释,新手小白都能看懂,亲测可运行

【深度学习】如何分配训练集、验证集、测试集比例

对于传统机器学习阶段(数据集在万这个数量级),一般分配比例为训练集和测试集的比例为7:3或是8:2。为了进一步降低信息泄露同时更准确的反应模型的效能,更为常见的划分比例是训练集、验证集、测试的比例为6:2:2。对于小规模样本集(几万量级),常用的分配比例是 60% 训练集、20% 验证集、20% 测